Viviamo in un’epoca in cui l’Intelligenza Artificiale Generativa sembra non avere più alcun limite. Dai paesaggi iperrealistici di mondi alieni ai ritratti di persone mai esistite, i sistemi odierni sono in grado di sintetizzare qualsiasi input visivo con una precisione disarmante. Eppure, in questo vasto oceano di possibilità cromatiche e compositive, esiste un’anomalia affascinante: un colore specifico, una singola sfumatura che le macchine si rifiutano categoricamente di riprodurre nella sua forma pura. Non si tratta di una limitazione hardware dei nostri monitor, ma di un vero e proprio blocco psicologico-digitale insito nel codice stesso di queste reti. Per comprendere questo mistero, dobbiamo immergerci nei meandri della computazione visiva e scoprire cosa accade quando la logica matematica si scontra con la storia dell’informatica.

Il paradosso della creatività sintetica

Per capire perché esista un colore “impossibile”, è fondamentale comprendere come l’intelligenza artificiale immagina e crea le immagini. A differenza di un pittore umano che mescola pigmenti su una tavolozza, i modelli generativi operano all’interno di uno spazio matematico multidimensionale chiamato spazio latente. In questo spazio, ogni concetto, forma e colore è rappresentato da coordinate numeriche. Attraverso un processo noto come diffusione, l’AI parte da un rumore visivo casuale (simile all’effetto neve dei vecchi televisori) e lo raffina progressivamente fino a far emergere l’immagine richiesta.

In teoria, poiché i monitor moderni utilizzano il modello RGB (Rosso, Verde, Blu) per generare oltre 16 milioni di colori, un algoritmo dovrebbe essere in grado di accendere qualsiasi pixel con qualsiasi combinazione numerica da 0 a 255. Tuttavia, la teoria si scontra con la pratica dell’addestramento. Le macchine non imparano nel vuoto, ma assimilano terabyte di dati creati dall’uomo. E proprio in questi dati si nasconde il seme del rifiuto.

Il fantasma nel codice: la sfumatura proibita

Qual è, dunque, questo colore impossibile? Si tratta del Magenta Puro, noto in esadecimale come #FF00FF (o RGB 255, 0, 255). Se chiedete a un generatore di immagini di creare una tela riempita esclusivamente e perfettamente di questo specifico e vibrante punto di fucsia/magenta, senza alcuna variazione, ombra o rumore, il sistema andrà in confusione. Invece di restituire una campitura piatta, l’algoritmo introdurrà imperfezioni, sfumature, texture indesiderate o altererà leggermente il codice colore, portandolo magari a un #FE00FE o aggiungendo artefatti visivi.

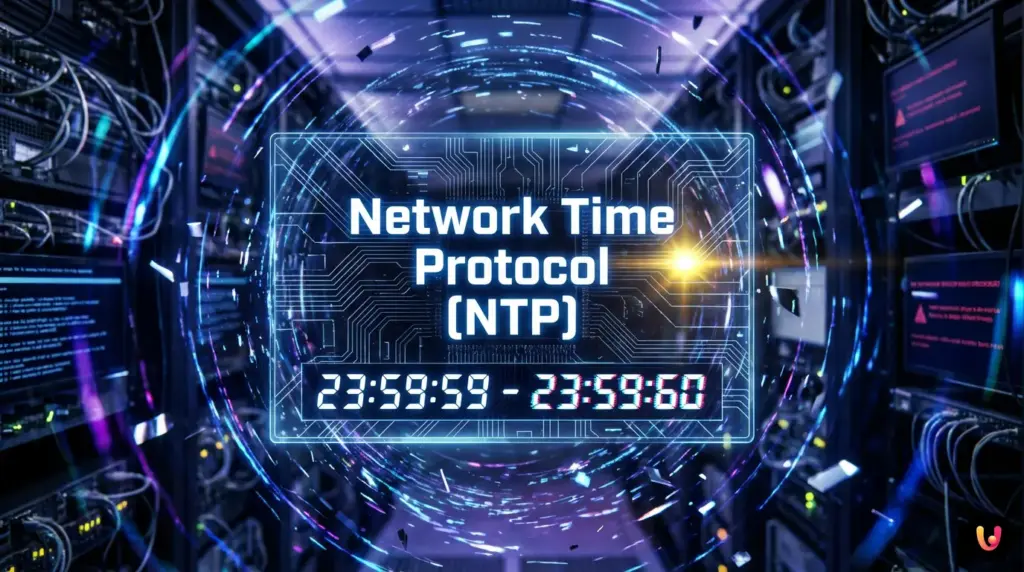

Ma perché proprio il magenta puro? La risposta non risiede nella fisica della luce (sebbene il magenta sia di per sé un colore extraspettrale, ovvero non presente nello spettro visibile ma creato dal nostro cervello), bensì nella storia della computer grafica. Fin dagli albori dello sviluppo dei videogiochi e del rendering 3D, il colore #FF00FF è stato utilizzato come maschera di trasparenza (chroma key) o come indicatore di missing texture (texture mancante). Era un colore così innaturale e raro nel mondo reale che i programmatori lo usavano per dire al computer: “Ignora questa parte” oppure “Attenzione, qui c’è un errore”.

Come l’architettura neurale reagisce all’errore

Quando i ricercatori hanno iniziato a raccogliere miliardi di immagini per addestrare i moderni modelli di deep learning, hanno inavvertitamente incluso milioni di screenshot, asset di videogiochi e file grafici in cui il magenta puro rappresentava un vuoto o un errore. L’architettura neurale di questi sistemi ha quindi appreso un’associazione semantica profonda e inconscia: il colore #FF00FF non è un colore da disegnare, ma un’anomalia da correggere o un buco da riempire.

Di conseguenza, quando l’algoritmo viene forzato a generare quel colore esatto, i suoi filtri interni di correzione degli errori scattano in automatico. La rete neurale “pensa” di trovarsi di fronte a un’immagine corrotta e tenta disperatamente di ripararla aggiungendo dettagli, rumore gaussiano o modificando la tonalità per renderla più “naturale” e accettabile secondo i parametri appresi durante la fase di training.

Machine Learning e la paura del vuoto perfetto

C’è anche un secondo livello di complessità legato al funzionamento intrinseco del machine learning applicato alla generazione di immagini. I modelli di diffusione sono progettati per creare dettagli a partire dal caos. La loro natura è quella di aggiungere informazione. Chiedere a questi algoritmi di generare un colore puro, piatto e matematicamente perfetto equivale a chiedere loro di non fare il proprio lavoro.

Il sistema interpreta l’assenza di variazioni (il colore piatto) come un fallimento del processo di denoising (rimozione del rumore). Per l’algoritmo, un’immagine senza texture o gradienti è un’immagine non finita. Pertanto, si rifiuta di consegnare un risultato che, secondo i suoi parametri matematici, è incompleto, inserendo micro-variazioni che distruggono la purezza del colore richiesto.

Il ruolo dei LLM e la percezione del colore

Questo fenomeno diventa ancora più affascinante quando analizziamo i modelli multimodali odierni. Se interroghiamo un LLM avanzato, come le versioni più recenti di ChatGPT dotate di capacità di analisi visiva, esso è perfettamente in grado di spiegare cos’è il magenta puro, di scriverne il codice esatto e di descriverne la storia informatica. L’intelligenza testuale comprende il concetto in modo impeccabile.

Tuttavia, quando l’automazione passa dal testo alla generazione dei pixel, il blocco si manifesta. Questo dimostra una disconnessione affascinante tra la comprensione semantica (il linguaggio) e la sintesi visiva (la generazione). L’intelligenza artificiale sa cos’è il colore, sa come si chiama, ma il suo “braccio pittorico” è fisicamente (o meglio, digitalmente) impossibilitato a tracciarlo senza alterarlo, vittima dei propri pregiudizi di addestramento.

Un benchmark per il progresso tecnologico

Lungi dall’essere un semplice difetto divertente, l’incapacità di generare il magenta puro è diventata un vero e proprio benchmark non ufficiale per gli sviluppatori. Testare come un modello gestisce i colori di errore o le campiture piatte aiuta gli ingegneri a comprendere quanto l’algoritmo sia schiavo dei bias presenti nei dati di addestramento.

Il progresso tecnologico nel campo dell’intelligenza artificiale non si misura solo nella capacità di creare immagini sempre più complesse, ma anche nella capacità di disimparare associazioni errate. Riuscire a forzare una rete neurale a generare un perfetto quadrato #FF00FF senza che essa tenti di “ripararlo” significa aver ottenuto un controllo più granulare e preciso sullo spazio latente, separando finalmente la logica del colore dalla semantica dell’errore informatico.

In Breve (TL;DR)

Nonostante le infinite capacità dell’Intelligenza Artificiale generativa, esiste un colore specifico che le macchine si rifiutano di riprodurre nella sua forma pura.

Il magenta puro viene percepito dagli algoritmi come un errore digitale, a causa del suo storico utilizzo informatico per indicare texture mancanti.

I modelli di diffusione interpretano l’assenza di variazioni cromatiche come un processo incompleto, aggiungendo inevitabilmente imperfezioni per correggere questa anomalia visiva.

Conclusioni

Il caso del colore impossibile ci ricorda che l’intelligenza artificiale, per quanto aliena e onnipotente possa sembrare, è profondamente radicata nella storia umana e nelle nostre idiosincrasie tecnologiche. Il rifiuto di generare il magenta puro non è un atto di ribellione della macchina, ma l’eco di decenni di programmazione in cui quel colore significava “errore”. Mentre continuiamo a spingere i confini di ciò che queste reti possono creare, queste piccole anomalie ci offrono una finestra preziosa su come le macchine “pensano” e su come, a volte, i fantasmi del passato informatico continuino a infestare i codici del futuro.

Domande frequenti

Il colore impossibile per le macchine generative è il magenta puro, identificato dal codice esadecimale FF00FF. Se si richiede a un software di creare una immagine composta solo da questa specifica tonalità senza sfumature, il sistema andrà in confusione. Invece di restituire una tela perfetta, il programma inserirà imperfezioni visive o altererà la tinta per renderla più naturale.

Questo blocco deriva dalla storia della computer grafica, dove il magenta puro veniva usato come maschera di trasparenza o per indicare una texture mancante. Avendo analizzato miliardi di immagini con questa caratteristica, le reti neurali hanno imparato ad associare questa tinta a un errore informatico da correggere a tutti i costi.

I modelli di diffusione sono programmati per aggiungere dettagli partendo dal rumore visivo. Chiedere loro di generare una campitura piatta e perfetta viene interpretato dal sistema come un fallimento del processo di rimozione del rumore. Per questo motivo, il software aggiunge micro variazioni per completare quella che ritiene una immagine non finita.

I modelli linguistici avanzati comprendono perfettamente il concetto di magenta puro e ne conoscono la complessa storia informatica. Esiste tuttavia una netta separazione tra la comprensione semantica del testo e la sintesi visiva. Il generatore grafico rimane infatti bloccato dai pregiudizi assimilati durante la fase di addestramento visivo, dimostrando come la teoria non sempre si traduca in pratica digitale.

La impossibilità di generare questa specifica tonalità funziona come un indicatore fondamentale per capire quanto un algoritmo sia influenzato dai dati di addestramento. Riuscire a far produrre alla macchina un quadrato magenta perfetto significa aver ottenuto un controllo superiore sullo spazio latente. Questo traguardo permette agli ingegneri di separare la logica del colore dalla semantica degli errori informatici del passato.

Hai ancora dubbi su Il paradosso visivo: l’unico colore che l’IA non può generare?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- Il colore Magenta, le sue coordinate RGB e la natura extraspettrale – Wikipedia

- Magic pink: l’uso storico del colore #FF00FF come maschera di trasparenza nella computer grafica – Wikipedia

- Modelli di diffusione: il processo di denoising nella generazione di immagini tramite IA – Wikipedia

- Spazio latente: come le reti neurali e il machine learning mappano i concetti visivi – Wikipedia

- Modello di colore RGB – Wikipedia

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.