Siamo nel 2026, e l’idea di una visita medica sta cambiando radicalmente. Immaginate uno scenario in cui non serve prelevare sangue, sottoporsi a radiazioni o inserire sonde invasive per capire lo stato di salute dei vostri organi interni. Tutto ciò che serve è un microfono ad alta fedeltà e pochi secondi del vostro tempo. La chiave di questa rivoluzione silenziosa risiede nei biomarcatori vocali, l’entità principale di questa nuova frontiera diagnostica che, analizzata dalla moderna intelligenza artificiale, sta riscrivendo le regole della medicina preventiva.

Per decenni, i medici hanno ascoltato il respiro e il battito cardiaco con lo stetoscopio, affidandosi al proprio orecchio allenato per individuare anomalie. Tuttavia, l’orecchio umano ha dei limiti fisici insormontabili. Oggi, grazie al progresso tecnologico esponenziale degli ultimi anni, abbiamo delegato questo compito ad orecchie digitali infinitamente più sensibili: gli algoritmi di machine learning. Ma come è possibile che un semplice respiro o una frase pronunciata al telefono possano predire l’insorgenza di malattie neurodegenerative o cardiache anni prima che compaiano i sintomi visibili? La risposta giace nella complessità nascosta delle onde sonore.

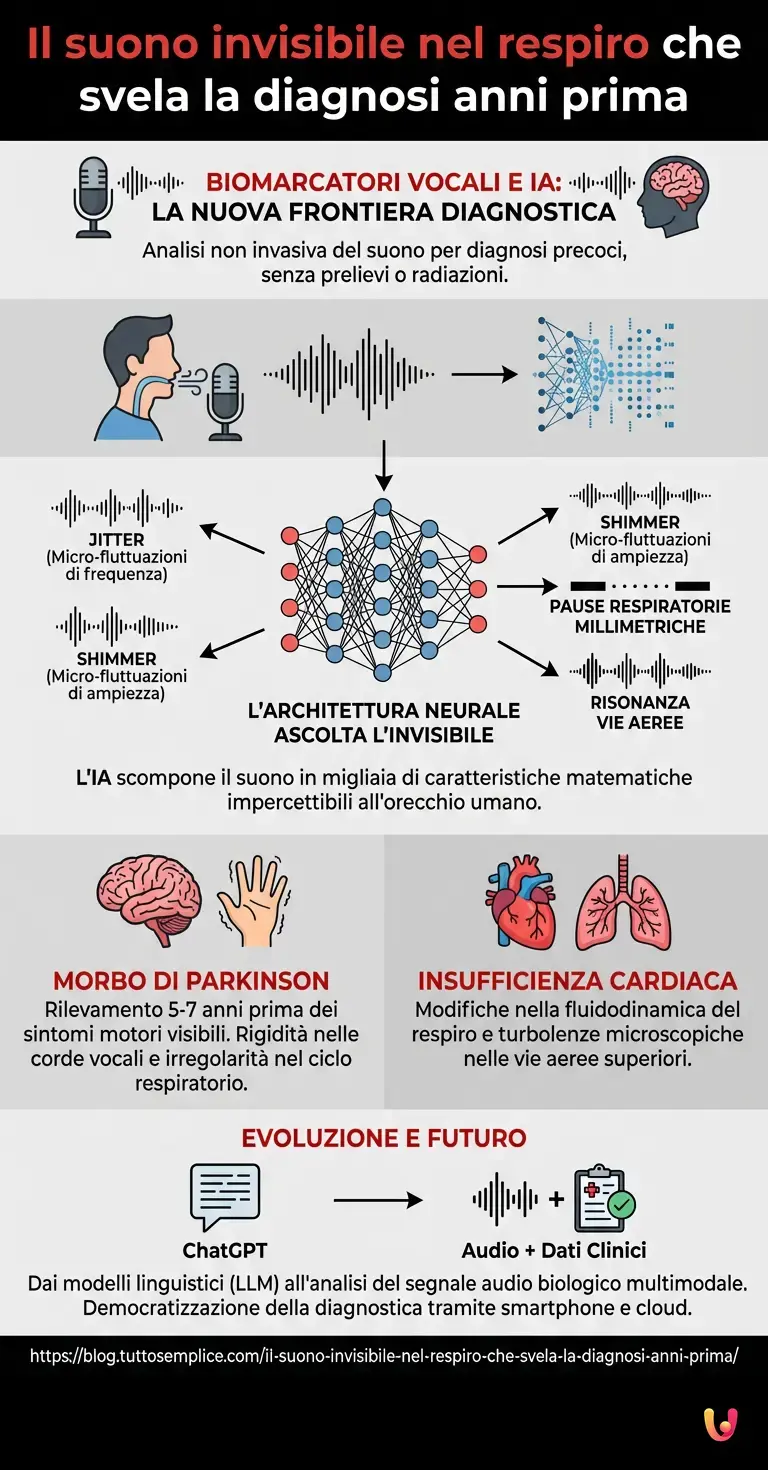

L’architettura neurale che ascolta l’invisibile

Quando parliamo o respiriamo, non emettiamo solo suoni udibili. Il nostro apparato fonatorio e respiratorio è un sistema meccanico complesso, influenzato dalla coordinazione muscolare, dalla capacità polmonare e dallo stato neurologico. Una malattia, anche nelle sue fasi embrionali, altera impercettibilmente questo sistema. Queste alterazioni sono invisibili per noi, ma evidenti per un sistema di deep learning ben addestrato.

L’architettura neurale di questi modelli AI non si limita ad analizzare il tono o il volume. Scompone il suono in migliaia di caratteristiche matematiche: la stabilità del jitter (micro-fluttuazioni di frequenza), lo shimmer (micro-fluttuazioni di ampiezza), le pause respiratorie millimetriche e la risonanza delle vie aeree. Laddove un medico sente un “respiro un po’ affannoso”, l’AI vede uno spettrogramma ricco di dati, identificando pattern che correlano statisticamente con specifiche patologie.

Oltre ChatGPT: L’evoluzione dei modelli multimodali

Se fino a qualche anno fa ci stupivamo delle capacità linguistiche di sistemi come ChatGPT, oggi assistiamo all’applicazione di quei principi (i cosiddetti LLM o Large Language Models) non più solo al testo, ma al segnale audio biologico. L’evoluzione verso modelli multimodali ha permesso di incrociare i dati acustici con la storia clinica del paziente. Non si tratta più solo di riconoscere parole, ma di interpretare la “texture” biologica del suono.

Ad esempio, nel caso del morbo di Parkinson, la rigidità muscolare e il tremore iniziano a manifestarsi nelle corde vocali molto prima che diventino visibili nelle mani. L’automazione di questo screening permette di rilevare la malattia fino a 5-7 anni prima della diagnosi tradizionale. L’algoritmo nota una rigidità nella fonazione o una specifica irregolarità nel ciclo respiratorio che funge da campanello d’allarme precoce, superando spesso i benchmark di accuratezza dei neurologi umani nelle fasi pre-sintomatiche.

Il respiro come impronta digitale della salute

Non è solo una questione neurologica. Il modo in cui l’aria esce dai nostri polmoni racconta lo stato del nostro cuore e delle nostre arterie. Studi recenti hanno dimostrato che l’insufficienza cardiaca modifica la fluidodinamica del respiro, creando turbolenze microscopiche nelle vie aeree superiori. L’intelligenza artificiale è in grado di isolare queste turbolenze dal rumore di fondo.

Questa tecnologia solleva interrogativi affascinanti e inquietanti. Se il vostro assistente vocale domestico potesse sentire che le vostre coronarie si stanno indurendo semplicemente ascoltando come date il comando di accendere la luce, vorreste saperlo? Il confine tra monitoraggio utile e sorveglianza invasiva è sottile, ma dal punto di vista puramente tecnico, la capacità predittiva è innegabile. Stiamo parlando di una democratizzazione della diagnostica: strumenti che un tempo richiedevano ospedali specializzati ora possono risiedere nel cloud, accessibili tramite uno smartphone.

In Breve (TL;DR)

L’intelligenza artificiale analizza i biomarcatori vocali e il respiro per diagnosticare patologie complesse senza procedure invasive.

Modelli neurali avanzati identificano alterazioni impercettibili nel suono per anticipare diagnosi gravi anni prima dei sintomi.

Questa tecnologia trasforma la medicina da reattiva a proattiva, rendendo la diagnostica avanzata accessibile a tutti tramite smartphone.

Conclusioni

La medicina del futuro non sarà fatta solo di bisturi e farmaci, ma di dati e frequenze. Il “respiro che ti tradisce” non è un nemico, ma un alleato prezioso che, grazie alla potenza di calcolo dell’AI, ci offre il bene più prezioso di tutti: il tempo. Anticipare una diagnosi significa poter intervenire quando la malattia è ancora vulnerabile, trasformando la medicina da reattiva a proattiva. Mentre la tecnologia continua a perfezionarsi, la sfida sarà integrare questi potenti strumenti nella pratica clinica quotidiana, garantendo che l’innovazione rimanga al servizio dell’essere umano.

Domande frequenti

I biomarcatori vocali sono caratteristiche impercettibili della voce e del respiro che l intelligenza artificiale analizza per rilevare malattie. A differenza dell orecchio umano, gli algoritmi scompongono il suono in dati matematici come micro-fluttuazioni e risonanze, identificando pattern associati a patologie specifiche molto prima che compaiano sintomi visibili.

L intelligenza artificiale rileva la rigidità muscolare e i tremori nelle corde vocali che si manifestano fino a sette anni prima dei tremori alle mani. Analizzando la fonazione e le irregolarità respiratorie, gli algoritmi superano spesso l accuratezza dei neurologi nelle fasi pre-sintomatiche, permettendo un intervento medico tempestivo.

Oltre alle malattie neurodegenerative come il Parkinson, l analisi del respiro può rivelare condizioni cardiache come l insufficienza cardiaca. Questo avviene perché le patologie del cuore modificano la fluidodinamica respiratoria, creando turbolenze microscopiche nelle vie aeree che i moderni modelli multimodali riescono a isolare e interpretare.

Mentre lo stetoscopio si affida all orecchio del medico, che ha limiti fisici naturali, la diagnosi AI utilizza orecchie digitali capaci di analizzare migliaia di caratteristiche matematiche del suono. Questa tecnologia trasforma la medicina da reattiva a proattiva, offrendo uno screening continuo e non invasivo accessibile anche tramite smartphone.

L IA democratizza la diagnostica permettendo controlli avanzati senza procedure invasive come prelievi o radiazioni. Grazie alla capacità di incrociare dati acustici con la storia clinica, questi sistemi offrono il vantaggio del tempo, anticipando le diagnosi e permettendo cure quando la malattia è ancora in fase iniziale e più vulnerabile.

Hai ancora dubbi su Il suono invisibile nel respiro che svela la diagnosi anni prima?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.