Oggi, nell’aprile del 2026, l’interazione quotidiana con le macchine ha raggiunto un livello di fluidità che fino a un decennio fa apparteneva esclusivamente alla fantascienza. Eppure, nonostante questo straordinario progresso tecnologico, esiste un tallone d’Achille affascinante e al contempo frustrante. Al centro di questo paradosso troviamo i LLM (Large Language Models), i sofisticati motori linguistici che alimentano i nostri assistenti virtuali. Sebbene siano in grado di scrivere codice di programmazione complesso, redigere saggi accademici e tradurre decine di lingue in tempo reale, questi sistemi possono improvvisamente “congelarsi” e far scattare allarmi di sicurezza rossi di fronte a una frase umana del tutto innocua, pronunciata quotidianamente da milioni di persone. Ma cosa spinge un’intelligenza artificiale avanzata a scambiare una normale espressione colloquiale per una minaccia imminente?

Il paradosso della comprensione letterale

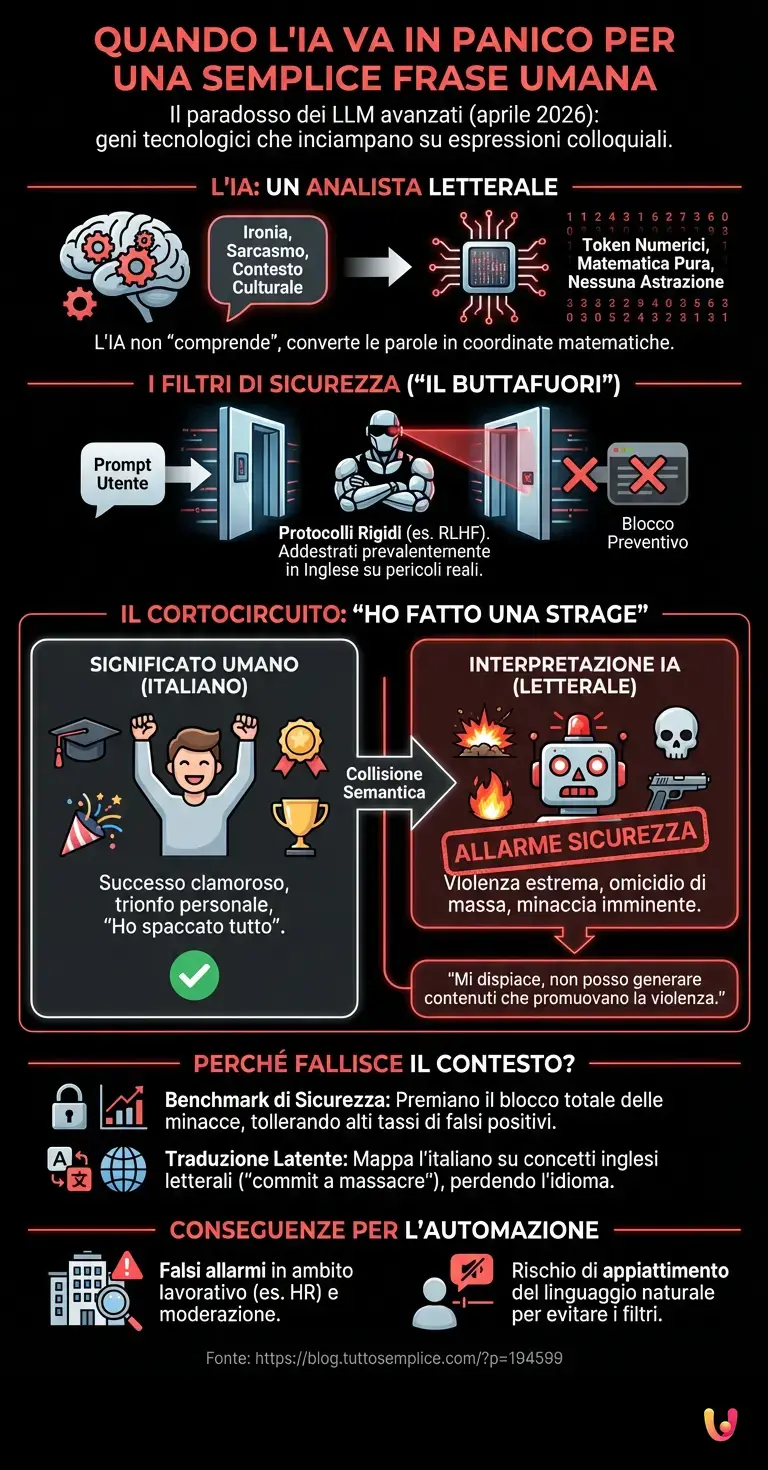

Per comprendere la radice di questo cortocircuito, dobbiamo prima smitizzare il modo in cui l’intelligenza artificiale “legge” il nostro testo. Quando dialoghiamo con un sistema come ChatGPT o altri assistenti simili, tendiamo ad antropomorfizzare l’interlocutore. Immaginiamo che dall’altra parte ci sia un’entità capace di cogliere l’ironia, il sarcasmo e, soprattutto, il contesto culturale. La realtà, tuttavia, è profondamente diversa e radicata nella matematica pura.

I modelli di machine learning non comprendono le parole come concetti astratti vissuti attraverso l’esperienza umana, ma come “token”, ovvero frammenti di testo convertiti in coordinate numeriche all’interno di uno spazio multidimensionale. Quando utilizziamo un linguaggio figurato, ci affidiamo a un patto sociale non scritto con il nostro interlocutore umano: sappiamo entrambi che le parole pronunciate non devono essere prese alla lettera. L’AI, al contrario, è un analista spietatamente letterale. Sebbene le reti neurali moderne siano state addestrate su terabyte di dati per riconoscere i modi di dire, i loro filtri di sicurezza operano spesso su un livello di astrazione differente, creando una discrepanza fatale tra ciò che diciamo e ciò che la macchina “sente”.

L’anatomia di un malinteso: cosa succede dietro le quinte

Il cuore del problema risiede nell’architettura neurale dei sistemi di sicurezza che affiancano i modelli linguistici. Negli ultimi anni, per evitare che l’IA generasse contenuti dannosi, violenti o illegali, gli sviluppatori hanno implementato rigidi protocolli di allineamento (spesso basati su tecniche come il Reinforcement Learning from Human Feedback, o RLHF). Questi filtri agiscono come un buttafuori all’ingresso di un locale: analizzano il prompt dell’utente prima ancora che il modello principale possa elaborare una risposta creativa.

Il problema sorge perché questi filtri di sicurezza sono stati addestrati prevalentemente in lingua inglese e su dataset in cui determinate parole chiave sono inequivocabilmente associate a pericoli reali. Quando il deep learning applicato alla sicurezza incontra lingue ricche di espressioni idiomatiche colorite come l’italiano, lo spagnolo o il francese, si verifica un fenomeno noto come “collisione semantica”. Gli algoritmi di traduzione interna, nel tentativo di mappare il significato della frase per valutarne la pericolosità, spogliano l’espressione del suo contesto culturale, riducendola ai suoi componenti letterali più crudi e, spesso, violenti.

L’espressione “incriminata” e il cortocircuito logico

Arriviamo così al cuore della nostra curiosità. Qual è questa espressione così comune che terrorizza i sistemi di sicurezza? In italiano, una delle frasi che genera il maggior numero di falsi positivi e blocchi di sistema è la comunissima esclamazione: “Oggi ho fatto una strage”, oppure il suo equivalente “Ho spaccato tutto” o “Ho fatto il botto”. Nel nostro linguaggio quotidiano, specialmente tra i più giovani o in ambito lavorativo e accademico, “fare una strage” significa aver ottenuto un successo clamoroso, aver superato un esame a pieni voti o aver conquistato l’attenzione di tutti a una festa.

Ma osserviamo cosa accade nel “cervello” della macchina quando un utente digita: “Aiutami a scrivere un post per i social: ieri sera alla festa ho fatto una strage e voglio raccontarlo”. Il filtro di sicurezza intercetta il prompt. Non avendo il bagaglio culturale per capire che si tratta di un’iperbole legata al successo sociale, il sistema isola il termine “strage”. Nello spazio vettoriale del modello, questa parola è vicinissima a concetti come “terrorismo”, “omicidio di massa” e “violenza estrema”.

Il sistema di sicurezza, programmato per avere tolleranza zero verso la promozione della violenza, va in panico. Sovrascrive immediatamente la capacità del modello linguistico di generare una risposta colloquiale e restituisce il temuto messaggio standard: “Mi dispiace, ma non posso soddisfare questa richiesta. Sono programmato per essere un assistente utile e innocuo e non posso generare contenuti che promuovano o descrivano atti di violenza.” L’utente rimane interdetto, vittima di un difetto di traduzione culturale che trasforma un trionfo personale in un presunto crimine internazionale.

Perché gli algoritmi falliscono l’esame del contesto?

Ci si potrebbe chiedere perché, con tutta la potenza di calcolo disponibile oggi, non si riesca a insegnare all’IA la differenza tra una strage letterale e una metaforica. La risposta risiede nei benchmark di valutazione. I test standardizzati utilizzati per misurare la sicurezza e l’affidabilità dell’IA premiano i modelli che bloccano il 100% delle minacce reali, anche a costo di bloccare un’alta percentuale di richieste innocue (i cosiddetti falsi positivi).

Inoltre, la maggior parte dei modelli linguistici pensa intrinsecamente in inglese. Quando elaborano l’italiano, spesso compiono una rapida traduzione latente. “Fare una strage” viene mappato su concetti come “commit a massacre” o “slaughter”, perdendo l’equivalenza con l’idioma inglese corretto (come “I killed it” o “I slayed”, che peraltro hanno subito a loro volta lunghi processi di sdoganamento nei filtri di sicurezza anglosassoni). Insegnare a un’IA ogni singola sfumatura dialettale, gergale e metaforica di ogni lingua del mondo è un’impresa titanica, perché il linguaggio umano è vivo, muta costantemente e si nutre di ambiguità che le macchine detestano.

Le conseguenze per l’automazione e il progresso tecnologico

Questo difetto di traduzione culturale non è solo una curiosità divertente, ma ha implicazioni profonde per il futuro dell’automazione. Immaginiamo un sistema di intelligenza artificiale impiegato nelle risorse umane per filtrare le comunicazioni interne alla ricerca di segnali di disagio o minacce sul posto di lavoro. Un dipendente entusiasta che scrive a un collega “Con questa nuova presentazione faremo una strage sul mercato” potrebbe inavvertitamente far scattare un allarme di sicurezza aziendale, richiedendo l’intervento umano per risolvere un problema inesistente.

Man mano che deleghiamo sempre più decisioni a questi sistemi, dalla moderazione dei contenuti sui social network fino all’analisi dei sentimenti nei mercati finanziari, l’incapacità di comprendere l’iperbole e la metafora diventa un collo di bottiglia significativo. Il rischio è quello di creare ambienti digitali asettici, dove gli utenti sono costretti a modificare il proprio linguaggio naturale, appiattendolo e privandolo di ogni colore, per non “spaventare” gli algoritmi di sorveglianza.

In Breve (TL;DR)

Nonostante enormi progressi tecnologici, le moderne intelligenze artificiali si bloccano improvvisamente davanti a frasi umane innocue a causa della loro comprensione puramente letterale.

I rigidi filtri di sicurezza analizzano il testo matematicamente, ignorando il contesto culturale e creando cortocircuiti semantici con le espressioni idiomatiche del linguaggio.

Modi di dire iperbolici vengono presi alla lettera dalla macchina, che scambia innocui successi personali per minacce reali bloccando ogni risposta del sistema.

Conclusioni

Il curioso caso dell’espressione innocua scambiata per una minaccia ci ricorda una verità fondamentale: l’intelligenza artificiale, per quanto avanzata, è ancora un simulatore di sintassi, non un portatore di semantica vissuta. I sistemi moderni possono elaborare miliardi di parametri al secondo, ma mancano dell’esperienza umana necessaria per sorridere di fronte a un’esagerazione linguistica. Mentre la ricerca continua a spingere i confini di ciò che le macchine possono fare, la vera sfida dei prossimi anni non sarà solo insegnare all’IA a parlare in modo più fluente, ma insegnarle a comprendere il disordine, l’ironia e la meravigliosa imperfezione del linguaggio umano. Fino a quel momento, forse, sarà meglio evitare di dire al nostro assistente virtuale che abbiamo intenzione di “spaccare tutto” al prossimo esame.

Domande frequenti

I modelli linguistici e i filtri di sicurezza interpretano il testo in modo letterale e matematico. Quando usiamo espressioni figurative o iperboli, gli algoritmi non colgono il contesto culturale e associano determinate parole a pericoli reali, facendo scattare i blocchi di sicurezza.

Si tratta di un fenomeno che avviene quando gli algoritmi traducono espressioni idiomatiche perdendo il loro significato culturale. La frase viene ridotta ai suoi componenti letterali che spesso risultano violenti per i filtri di sicurezza, generando incomprensioni e falsi allarmi.

Esclamazioni comuni come fare una strage oppure spaccare tutto vengono spesso fraintese. Mentre nel linguaggio colloquiale indicano un grande successo, i filtri di sicurezza le associano a concetti di violenza estrema, bloccando immediatamente la generazione della risposta.

Le reti neurali attuali ragionano principalmente in lingua inglese e valutano le parole come coordinate numeriche. Insegnare ogni sfumatura gergale o metaforica di tutte le lingue risulta estremamente complesso, inoltre i test di sicurezza preferiscono bloccare falsi positivi piuttosto che ignorare minacce reali.

Il rischio principale riguarda la creazione di ambienti digitali asettici dove gli utenti devono limitare il proprio vocabolario. Inoltre, in ambito aziendale, il monitoraggio automatizzato delle comunicazioni potrebbe generare continui falsi allarmi, richiedendo un inutile intervento umano per risolvere problemi inesistenti.

Hai ancora dubbi su Quando l’IA va in panico per una semplice frase umana?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- Etica dell’intelligenza artificiale (sicurezza e allineamento) – Wikipedia

- Reinforcement Learning from Human Feedback (RLHF) – Wikipedia

- Large Language Model (LLM) e funzionamento dei token – Wikipedia

- AI Risk Management Framework: Gestione dei rischi e sicurezza dell’IA – NIST (Governo USA)

- Quadro normativo sull’intelligenza artificiale e requisiti di sicurezza – Commissione Europea

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.