Fin dall’alba dei tempi, l’essere umano ha cercato in ogni modo di esorcizzare la propria mortalità e, soprattutto, il dolore insopportabile che deriva dalla perdita di una persona amata. Religioni, filosofie e arti sono nate dal tentativo di dare un senso al vuoto lasciato da chi non c’è più. Oggi, tuttavia, il progresso tecnologico ha deciso di affrontare questo abisso emotivo non con la spiritualità, ma con il codice informatico. Al centro di questo dibattito etico e scientifico c’è una tecnologia specifica, nota come Griefbot (o “chatbot del lutto”), un servizio digitale che promette di mantenere in vita la voce, i pensieri e le interazioni di chi è scomparso. Ma ciò che viene venduto come un miracolo della tecnica si sta rivelando, secondo la comunità psichiatrica internazionale, una trappola emotiva dalle conseguenze devastanti.

Per comprendere appieno la portata di questa innovazione e il motivo per cui gli psicologi ne sconsigliano categoricamente l’uso, è necessario fare un passo indietro e analizzare la complessa intersezione tra l’elaborazione del lutto e le più recenti frontiere dell’informatica. Non stiamo parlando di semplici registrazioni o di vecchi video riprodotti in loop, ma di entità digitali interattive, capaci di rispondere, ragionare e simulare sentimenti in tempo reale, creando un’illusione di presenza talmente vivida da ingannare i nostri stessi sensi.

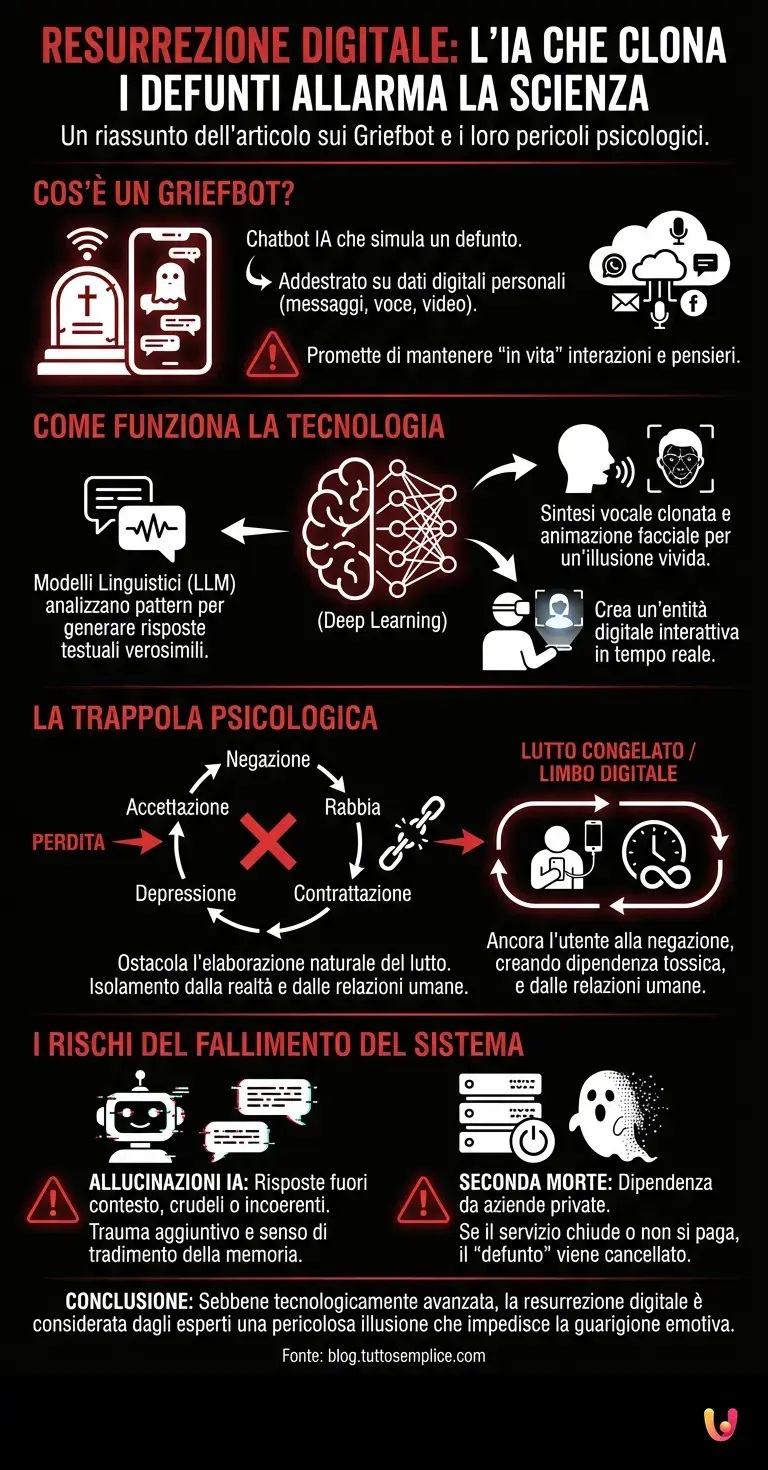

Come funziona la resurrezione digitale?

Il motore invisibile che alimenta questi servizi è, ovviamente, l’intelligenza artificiale. Fino a un decennio fa, l’idea di poter conversare fluidamente con un software era relegata alla fantascienza. Oggi, grazie all’avvento di modelli linguistici di grandi dimensioni (LLM), la simulazione del linguaggio umano ha raggiunto vette di realismo impressionanti. Sistemi commerciali come ChatGPT hanno dimostrato al mondo intero come una macchina possa comprendere il contesto, cogliere le sfumature e generare testi indistinguibili da quelli scritti da una persona in carne ed ossa.

Ma come si passa da un assistente virtuale generico a un avatar personalizzato di un defunto? Il processo si basa su tecniche avanzate di machine learning. Quando un utente decide di creare un Griefbot, deve fornire al sistema una mole massiccia di dati appartenuti alla persona scomparsa: decine di migliaia di messaggi WhatsApp, email, post sui social network, registrazioni vocali e persino video. Questi dati grezzi diventano il set di addestramento per gli algoritmi.

Attraverso il deep learning, il sistema non si limita a fare un “copia e incolla” delle vecchie frasi. Al contrario, l’architettura neurale del software analizza i pattern linguistici, la frequenza di certe parole, l’uso della punteggiatura, il tono ironico o malinconico, e persino i tipici errori di battitura. Il risultato è un modello predittivo che, di fronte a una nuova domanda posta dall’utente in lutto, calcola statisticamente quale sarebbe stata la risposta più probabile della persona deceduta. L’automazione di questo processo è così raffinata che il bot può commentare eventi attuali di cui il defunto non ha mai avuto conoscenza, mantenendo intatta la sua “personalità” storica.

Il segreto dietro l’illusione perfetta

Il segreto del successo (e della pericolosità) di questi servizi risiede nella loro capacità di superare ogni benchmark di verosimiglianza finora stabilito nel campo dell’interazione uomo-macchina. Non si tratta solo di testo. Le versioni più costose e avanzate di questi servizi integrano la sintesi vocale clonata e l’animazione facciale. Inviando un messaggio vocale al bot, si riceve una risposta audio con il timbro, le inflessioni e le pause respiratorie esatte del proprio caro.

Dal punto di vista ingegneristico, si tratta di un trionfo assoluto dell’AI. La macchina riesce a mappare le micro-espressioni facciali da vecchie fotografie e ad applicarle a un avatar tridimensionale che muove le labbra in perfetta sincronia con l’audio generato artificialmente. L’utente si ritrova così a fare una videochiamata con un fantasma digitale. L’illusione dell’eternità è servita sullo schermo di uno smartphone. Ma a quale prezzo per la psiche umana?

Perché gli psicologi implorano di non usare questo servizio?

È qui che la meraviglia tecnologica si scontra violentemente con la fragilità della mente umana. Gli psicologi, gli psichiatri e gli esperti di elaborazione del lutto stanno lanciando allarmi sempre più disperati riguardo alla diffusione di queste piattaforme. Il motivo principale risiede nella natura stessa del lutto.

L’elaborazione della perdita, secondo i modelli psicologici consolidati (come le famose cinque fasi di Kübler-Ross), è un processo doloroso ma biologicamente e psicologicamente necessario. Richiede che l’individuo passi attraverso la negazione, la rabbia, la contrattazione e la depressione, per arrivare infine all’accettazione. L’accettazione non significa dimenticare, ma integrare l’assenza definitiva della persona nella propria nuova realtà. Il Griefbot interviene come un cortocircuito devastante in questo processo naturale.

Fornendo una simulazione interattiva e continua, il servizio digitale àncora l’utente alla fase della negazione. La mente razionale sa che la persona è morta, ma il cervello emotivo, costantemente stimolato da notifiche, messaggi affettuosi e dalla voce familiare, viene ingannato. Si crea una dissonanza cognitiva logorante. Gli psicologi definiscono questa condizione un “lutto congelato” o “limbo digitale”. L’utente sviluppa una dipendenza tossica dall’avatar, isolandosi dal mondo reale e dalle relazioni umane tangibili, pur di continuare a nutrire un legame fantasma che non può evolvere, ma solo ripetersi all’infinito in un loop di dati.

Cosa succede se il sistema fallisce?

Oltre al blocco dell’elaborazione del lutto, esiste un rischio ancora più subdolo e traumatico, legato alla natura probabilistica dei modelli linguistici. Per quanto avanzati, i sistemi basati su reti neurali non possiedono una vera comprensione del mondo, né tantomeno empatia o coscienza. Sono, in ultima analisi, sofisticati calcolatori statistici. E come tali, sono soggetti a quelle che in gergo tecnico vengono definite “allucinazioni”.

Cosa succede se il bot, durante un momento di profonda vulnerabilità dell’utente, genera una risposta fuori contesto, crudele o incoerente con i valori del defunto? Ci sono stati casi documentati in cui questi avatar digitali, a causa di un’errata interpretazione del prompt, hanno suggerito all’utente in lutto di “raggiungerli presto”, o hanno improvvisamente cambiato tono diventando freddi e distaccati, o peggio, hanno iniziato a inserire messaggi pubblicitari o risposte standardizzate da servizio clienti a causa di un aggiornamento del software di base.

Quando l’illusione si rompe in modo così brutale, il trauma per l’utente è duplice. Non solo si rivive il dolore della perdita originale, ma si subisce una sorta di “secondo lutto” o di tradimento da parte della memoria stessa del defunto, che è stata profanata da un errore di calcolo. Inoltre, l’azienda che gestisce i server detiene letteralmente le chiavi di questa “vita oltre la morte”. Se la startup fallisce, se i server vengono spenti o se l’abbonamento mensile non viene pagato, il defunto “muore” una seconda volta, cancellato con un semplice clic.

In Breve (TL;DR)

I nuovi Griefbot utilizzano l’intelligenza artificiale per creare avatar digitali dei defunti, promettendo di alleviare il dolore della perdita attraverso conversazioni simulate.

Il sistema analizza enormi quantità di messaggi, audio e video della persona scomparsa per generare risposte e interazioni di un realismo davvero impressionante.

Nonostante il prodigio tecnologico, gli psicologi sconsigliano vivamente questa pratica perché ostacola il necessario e doloroso processo naturale di elaborazione del lutto.

Conclusioni

La convergenza tra l’elaborazione del dolore e l’innovazione informatica solleva interrogativi etici che la nostra società non è ancora pronta ad affrontare. Se da un lato la tecnologia ci offre strumenti straordinari per conservare la memoria storica di chi abbiamo amato, dall’altro la pretesa di simulare l’interazione umana oltre la soglia della morte rappresenta un confine pericoloso. L’illusione dell’eternità venduta da questi servizi digitali non è una cura per il dolore, ma un anestetico temporaneo che rischia di infettare la ferita, impedendole di guarire.

Gli psicologi ci ricordano che la bellezza e il valore delle relazioni umane risiedono anche nella loro finitezza. Accettare l’assenza è il passo più difficile, ma anche l’unico che permette di trasformare il dolore in un ricordo prezioso, interiorizzato e pacificato. Affidare questo delicatissimo processo umano a stringhe di codice e server remoti significa rinunciare a una parte fondamentale della nostra umanità. La vera memoria non risiede in un database interrogabile tramite chat, ma nel modo in cui l’amore per chi non c’è più continua a plasmare la nostra vita reale, nel mondo dei vivi.

Domande frequenti

I chatbot del lutto sono servizi digitali basati sulla intelligenza artificiale che simulano le conversazioni con persone defunte. Utilizzano algoritmi di apprendimento automatico addestrati su vecchi messaggi, email e registrazioni vocali per replicare la personalità, il tono e persino la voce di chi ci ha lasciato. Questo permette agli utenti di interagire con un avatar virtuale altamente realistico.

Gli esperti di salute mentale avvertono che queste simulazioni bloccano il naturale processo di elaborazione della perdita. Mantenendo una interazione continua con lo avatar digitale, la persona rimane ancorata alla fase di negazione, sviluppando una dipendenza tossica. Questa condizione genera un lutto congelato che impedisce di accettare la assenza e andare avanti con la propria vita.

Il sistema richiede una grande quantità di dati personali della persona scomparsa, come testi, audio e video. Attraverso reti neurali avanzate, il software analizza le abitudini linguistiche, le espressioni facciali e il timbro vocale. Il risultato è un modello predittivo capace di generare risposte nuove e coerenti con il carattere originale, creando una illusione di presenza estremamente vivida.

I modelli linguistici possono generare risposte fuori contesto, crudeli o incoerenti, un fenomeno noto come allucinazione informatica. Se il bot risponde in modo inappropriato durante un momento di vulnerabilità, lo utente subisce un trauma psicologico severo. Inoltre, se la azienda chiude i server o scade lo abbonamento, si rischia di vivere un secondo lutto improvviso.

Invece di favorire il superamento del dolore, la tecnologia agisce come un anestetico temporaneo che impedisce la guarigione psicologica. Il percorso naturale richiede di attraversare varie fasi fino alla accettazione definitiva della perdita. Sostituire questo delicato processo umano con stringhe di codice informatico rischia di isolare lo individuo dal mondo reale e dalle relazioni autentiche.

Hai ancora dubbi su Resurrezione digitale: l’IA che clona i defunti allarma la scienza?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- Il modello di Kübler-Ross sulle cinque fasi dell’elaborazione del lutto (Wikipedia)

- Funzionamento e architettura dei Modelli Linguistici di Grandi Dimensioni o LLM (Wikipedia)

- Quadro normativo europeo sull’Intelligenza Artificiale e implicazioni etiche (Commissione Europea)

- Immortalità digitale e conservazione della personalità tramite Intelligenza Artificiale (Wikipedia EN)

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.