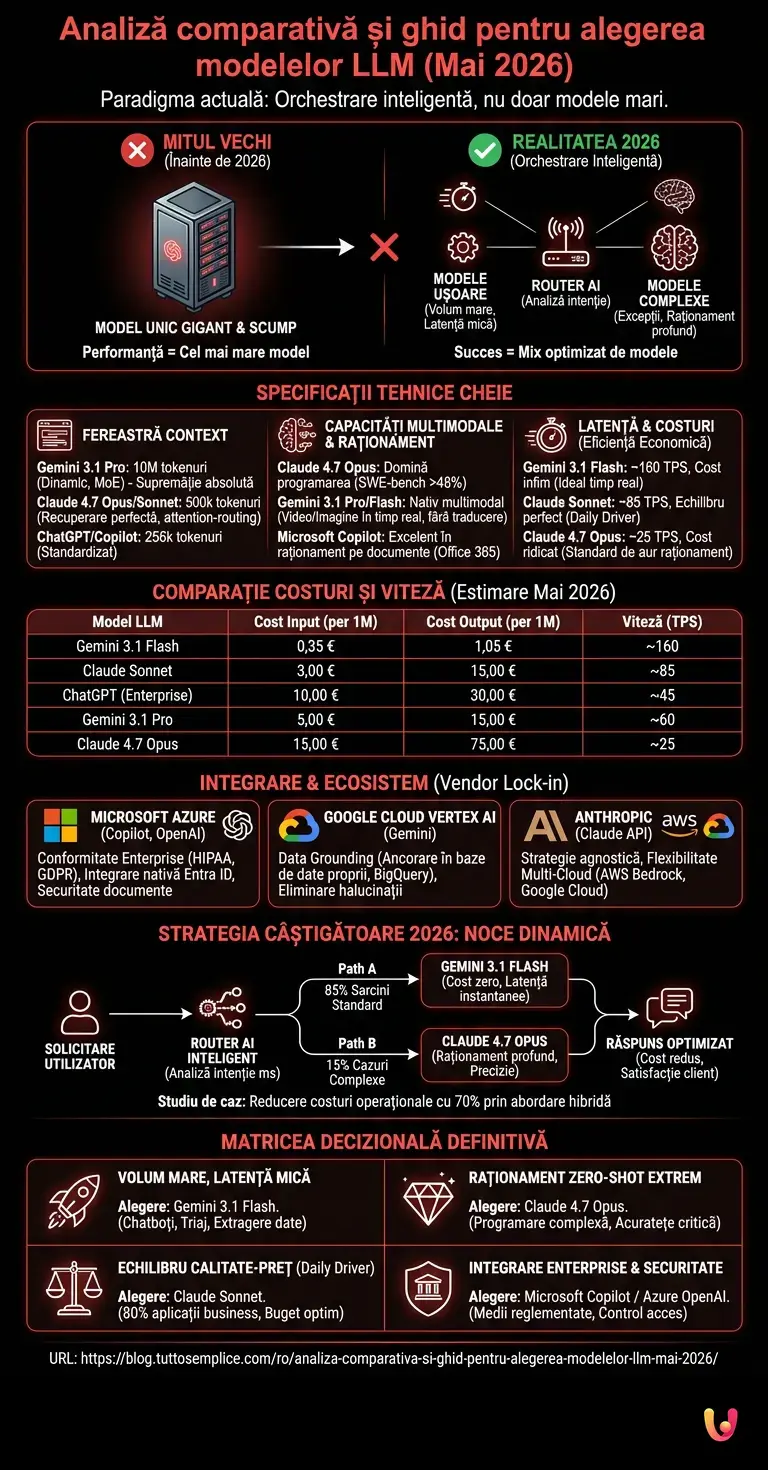

Cel mai înrădăcinat mit din peisajul actual al inteligenței artificiale este acela că, pentru a obține performanțe la nivel enterprise, este indispensabilă adoptarea celui mai mare și mai costisitor model disponibil. Adevărul, în mai 2026, este diametral opus: succesul în producție nu depinde de punctajul obținut în benchmark-urile de raționament, ci de orchestrarea inteligentă între modelele ușoare, destinate volumului mare de date, și modelele complexe, rezervate excepțiilor. Această comparație a modelelor LLM demonstrează modul în care ecosistemul, dependența de furnizor (vendor lock-in) și latența contează acum mult mai mult decât parametrii bruti, impunând directorilor tehnici (CTO) o schimbare radicală de paradigmă în proiectarea arhitecturilor AI.

Specificații tehnice și arhitecturi de bază

În această comparație a modelelor LLM , specificațiile tehnice dezvăluie divergențe cruciale. Analizăm dimensiunile ferestrei de context, limitele de rată (RPM/TPM) și particularitățile arhitecturale care definesc capacitățile Claude, Gemini, ChatGPT și Copilot în scenarii de producție intensivă.

În mai 2026, cursa pentru extinderea ferestrei de context a atins un platou funcțional, mutând atenția asupra eficienței regăsirii informațiilor (Retrieval-Augmented Generation nativă). Conform documentației oficiale Google Cloud, Gemini 3.1 Pro își menține supremația absolută cu o fereastră de context dinamică de până la 10 milioane de tokenuri, susținută de o arhitectură Mixture-of-Experts (MoE) înalt paralelizată. Acest lucru permite ingestia unor depozite de cod întregi sau a unor arhive video, fără fragmentare.

Pe de altă parte, Claude 4.7 Opus și cea mai recentă iterație a Claude Sonnet se situează la o fereastră de 500.000 de tokenuri. Cu toate acestea, Anthropic a implementat un mecanism de „attention-routing” care garantează o recuperare perfectă a informațiilor (100% în testul „Needle-in-a-Haystack”), chiar și la limitele extreme ale contextului, reducând astfel halucinațiile structurale. ChatGPT (în versiunea sa enterprise bazată pe arhitectura GPT-4.5/5 ) și Microsoft Copilot oferă ferestre standardizate de 256.000 de tokenuri, prioritizând limite de rată (TPM – Tokens Per Minute) extrem de ridicate pentru a face față sarcinilor de lucru simultane la nivel de întreprindere.

Capacități multimodale și raționament complex

Evaluarea raționamentului complex este esențială într-o comparație actualizată a modelelor LLM . Examinăm performanțele în cele mai recente benchmark-uri pentru programare avansată , logică matematică zero-shot și analiza nativă a imaginilor și a documentelor complexe.

Capacitățile de raționament s-au ramificat în două categorii distincte: logica analitică (programare și matematică) și înțelegerea multimodală nativă. În domeniul dezvoltării software, Claude 4.7 Opus domină în mod incontestabil. În benchmark-urile SWE-bench actualizate pentru anul 2026, Opus rezolvă în mod autonom peste 48% dintre problemele complexe de pe GitHub, depășind ChatGPT datorită capacității sale superioare de a menține coerența logică în cadrul mai multor fișiere.

În ceea ce privește multimodalitatea, Gemini 3.1 Pro și Gemini 3.1 Flash operează pe o arhitectură nativ multimodală încă din etapa de pre-antrenare. Acest lucru înseamnă că nu traduc imaginile sau sunetul în text înainte de procesare, ci mapează pixelii și frecvențele direct în spațiul latent. Rezultatul este o superioritate zdrobitoare în analiza video în timp real și în interpretarea planurilor sau a diagramelor industriale complexe. Microsoft Copilot , integrat în ecosistemul Office 365, excelează în schimb în raționamentul bazat pe documente, corelând date între Excel, Word și Teams cu o precizie semantică inegalabilă pentru sarcinile administrative.

Latență, viteză de inferență și costuri operaționale

Optimizarea bugetului necesită o comparare atentă a modelelor LLM, bazată pe costurile per milion de tokenuri și pe latență. Să descoperim ce modele oferă cel mai bun raport între tokenuri pe secundă (TPS) și cheltuielile de infrastructură pentru companii.

Adevăratul câmp de luptă al anului 2026 este eficiența economică. Modelele „Frontier” (Opus, GPT de nivel maxim) sunt nesustenabile pentru sarcini cu volum mare, precum clasificarea jurnalelor sau asistența clienți de nivelul întâi. Aici intervin modelele optimizate .

| Model LLM | Cost input (per 1M) | Cost output (per 1M) | Viteză (TPS) |

|---|---|---|---|

| Claude 4.7 Opus | 15,00 € | 75,00 € | ~25 |

| Claude Sonnet | 3,00 € | 15,00 € | ~85 |

| Gemini 3.1 Pro | 5,00 € | 15,00 € | ~60 |

| Gemini 3.1 Flash | 0,35 € | 1,05 € | ~160 |

| ChatGPT (Enterprise) | 10,00 € | 30,00 € | ~45 |

Conform documentației oficiale Google, Gemini 3.1 Flash oferă o viteză de inferență de aproximativ 160 de tokenuri pe secundă (TPS), fiind ideal pentru aplicații în timp real și agenți vocali. Claude Sonnet se poziționează drept cel mai bun compromis de pe piață: oferă capacități de raționament apropiate de cele ale modelelor de top din 2025, dar la o cincime din costul Opus și cu o latență imperceptibilă pentru utilizatorul final.

Integrare, ecosistem și platforme cloud

Nicio comparație a modelelor LLM nu este completă fără a analiza fenomenul de „vendor lock-in” și infrastructura. Comparăm avantajele API-urilor oferite de Anthropic și OpenAI cu cele ale platformelor enterprise integrate, precum Google Cloud Vertex AI și Microsoft Azure.

Alegerea modelului este intrinsec legată de infrastructura cloud preexistentă a companiei. Microsoft Copilot și modelele OpenAI, prin intermediul Azure, oferă avantajul inegalabil al conformității la nivel de întreprindere (HIPAA, GDPR strict) și al integrării native cu Entra ID (fostul Azure AD) pentru gestionarea permisiunilor la nivelul fiecărui document în parte. Dacă o companie utilizează deja ecosistemul Microsoft, adoptarea Azure OpenAI reduce timpul de lansare pe piață cu 60%.

Gemini 3.1 pe Google Cloud Vertex AI excelează în ceea ce privește Data Grounding . Acesta permite ancorarea răspunsurilor modelului direct în bazele de date ale companiei (BigQuery, AlloyDB) și în Google Search, în timp real, eliminând practic halucinațiile legate de datele proprietare. Anthropic , deși nu deține un cloud propriu, a adoptat o strategie agnostică: API-urile Claude sunt disponibile pe AWS Bedrock și Google Cloud, oferind o flexibilitate maximă pentru arhitecturile multi-cloud.

Studiu de caz: Evoluția serviciului de relații cu clienții (2024-2026)

În 2024, Klarna a ținut prima pagină a știrilor gestionând 2,3 milioane de conversații (două treimi din total) cu ajutorul unui asistent AI bazat pe OpenAI, reducând timpii de soluționare de la 11 la 2 minute și estimând o economie de 40 de milioane de dolari. În mai 2026, companiile de top au evoluat acest abordare, implementând „ Dynamic Model Routing” (rutarea dinamică a modelelor). În loc să utilizeze un singur model complex, un router AI analizează intenția utilizatorului în câteva milisecunde: 85% dintre solicitările standard sunt gestionate de Gemini 3.1 Flash (cost aproape zero, latență instantanee), în timp ce doar 15% dintre cazurile complexe (de exemplu, dispute legale sau rambursări atipice) sunt direcționate către Claude 4.7 Opus. Această abordare hibridă a redus și mai mult costurile operaționale cu 70% față de anul 2024, menținând totodată satisfacția clienților la același nivel.

Concluzii

La finalul acestei comparații a modelelor LLM , prezentăm matricea decizională definitivă. Alegerea modelului potrivit depinde de echilibrul dintre volumul de apeluri, necesitatea raționamentului zero-shot și cerințele de integrare la nivel de întreprindere.

Nu există un câștigător absolut, dar există alegeri optime în funcție de scenariul de utilizare:

- Sarcini cu volum ridicat și latență scăzută (Chatboți, Triaj, Extragere de date de bază): Câștigătorul incontestabil este Gemini 3.1 Flash . Costul infim și viteza extremă îl fac singurul candidat logic pentru operațiuni la scară largă.

- Raționament Zero-Shot extrem și programare complexă: Claude 4.7 Opus rămâne standardul de aur. Este investiția necesară atunci când acuratețea logică este critică, iar erorile umane sau ale mașinii ar implica costuri ridicate.

- Echilibru calitate-preț („Daily Driver”): Claude Sonnet reprezintă punctul de echilibru perfect pentru 80% dintre aplicațiile de business care necesită un nivel ridicat de inteligență, fără a epuiza bugetul alocat API-urilor.

- Integrare la nivel enterprise și securitatea documentelor: Microsoft Copilot și ecosistemul ChatGPT pe Azure se remarcă prin ușurința implementării în medii corporative strict reglementate.

Strategia câștigătoare pentru anul 2026 nu este alegerea unui singur model, ci construirea unei arhitecturi de rutare care să direcționeze în mod dinamic fiecare prompt către modelul cel mai eficient pentru acea sarcină specifică.

Întrebări frecvente

Pentru dezvoltarea software și raționamentul logic avansat, Claude 4.7 Opus reprezintă standardul de referință. Datorită capacității sale excepționale de a menține coerența în fișiere multiple, acesta rezolvă în mod autonom probleme complexe, depășind alternativele existente pe piață. Este instrumentul ideal atunci când precizia codului este esențială pentru proiect.

Cea mai eficientă strategie constă în crearea unui sistem de rutare dinamică a solicitărilor. În loc să se utilizeze un singur model costisitor pentru fiecare operațiune, un router inteligent analizează scopul promptului și atribuie sarcinile simple unor soluții economice, precum Gemini 3.1 Flash. Operațiunile complexe sunt direcționate către modele avansate, reducând drastic cheltuielile companiei.

Gemini 3.1 Pro domină acest sector datorită unei ferestre dinamice care atinge zece milioane de tokenuri, permițând analizarea unor arhive întregi fără fragmentare. Cu toate acestea, Claude 4.7 Opus și Sonnet garantează o recuperare perfectă a informațiilor chiar și la limitele contextului lor, reducând la minimum halucinațiile structurale în timpul parcurgerii unor texte extinse.

Alegerea sistemului Microsoft oferă avantaje enorme în ceea ce privește conformitatea cu reglementările și securitatea datelor corporative. Această soluție asigură o integrare nativă pentru gestionarea permisiunilor la nivelul fiecărui document în parte. Prin urmare, reprezintă alegerea optimă pentru corporațiile care activează în domenii strict reglementate și care necesită un control riguros asupra accesului și a informațiilor sensibile.

Versiunile Pro și Flash ale Gemini funcționează pe baza unei arhitecturi nativ multimodale, încă din etapa de antrenare de bază. Acest lucru înseamnă că nu trebuie să transforme conținutul vizual sau audio în text înainte de a-l procesa, ci mapează datele direct. Rezultatul este o precizie extrem de ridicată în înțelegerea videoclipurilor în timp real și a diagramelor industriale complexe.

Încă ai dubii despre Analiză comparativă și ghid pentru alegerea modelelor LLM (Mai 2026)?

Tastați aici întrebarea dvs. specifică pentru a găsi instantaneu răspunsul oficial de la Google.

Surse și Aprofundare

- Modele de limbaj mari (LLM) - Concepte și arhitecturi de bază (Wikipedia)

- Generare augmentată prin recuperare (RAG) (Wikipedia)

- Arhitectura Mixture-of-Experts (MoE) în învățarea automată (Wikipedia)

- Standarde, evaluări și benchmark-uri pentru Inteligența Artificială (NIST - Guvernul SUA)

- Cadrul de reglementare și adoptarea Inteligenței Artificiale în mediul enterprise (Comisia Europeană)

Ați găsit acest articol util? Există un alt subiect pe care ați dori să-l tratez?

Scrieți-l în comentariile de mai jos! Mă inspir direct din sugestiile voastre.