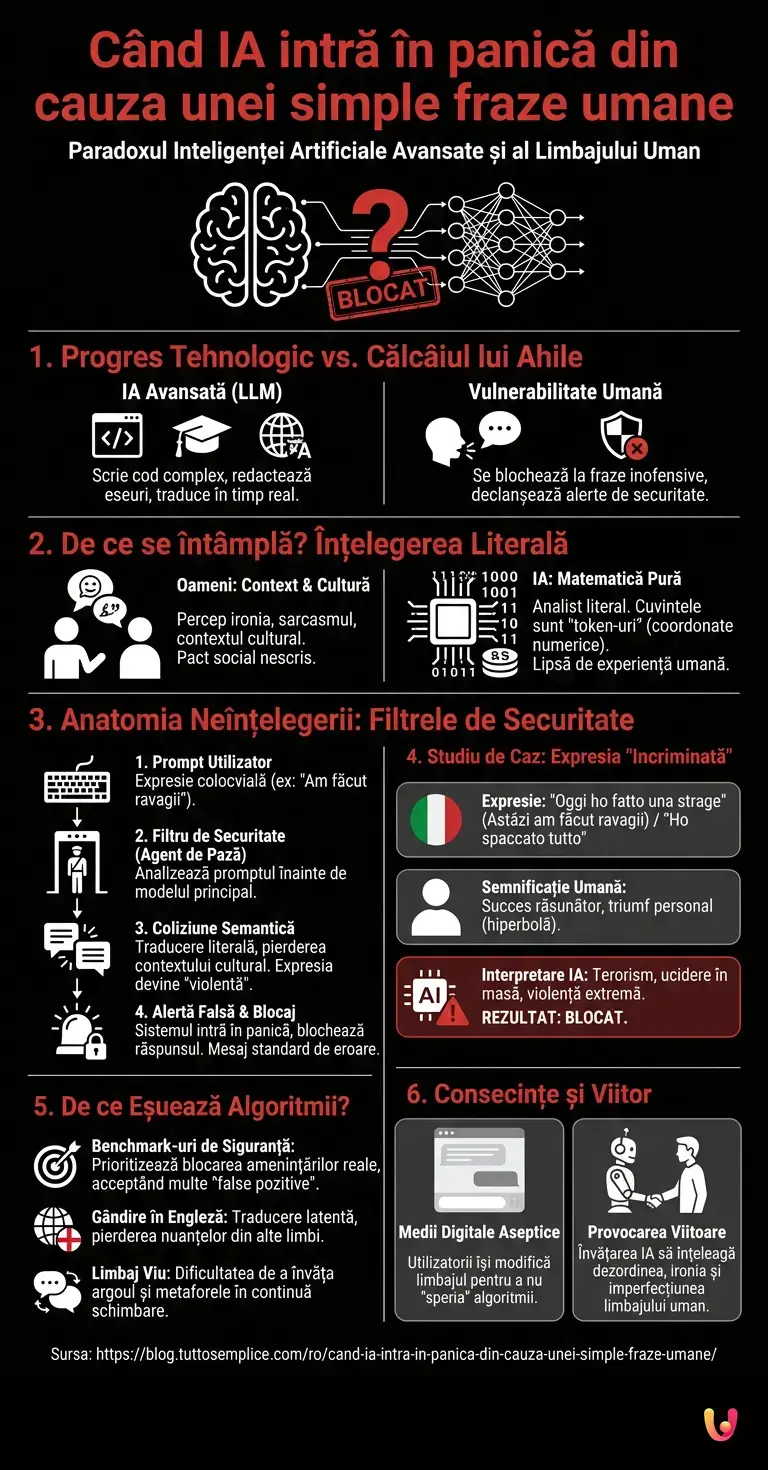

Astăzi, în aprilie 2026, interacțiunea cotidiană cu mașinile a atins un nivel de fluiditate care, până acum un deceniu, aparținea exclusiv domeniului science-fiction. Cu toate acestea, în ciuda acestui progres tehnologic extraordinar, există un „călcâi al lui Ahile” fascinant și, în același timp, frustrant. În centrul acestui paradox se află LLM-urile (Large Language Models) – modelele lingvistice complexe care stau la baza asistenților noștri virtuali. Deși sunt capabile să scrie cod de programare complex , să redacteze eseuri academice și să traducă zeci de limbi în timp real, aceste sisteme se pot „bloca” brusc și pot declanșa alerte de securitate de grad maxim în fața unei fraze umane complet inofensive, rostită zilnic de milioane de oameni. Însă ce anume determină o inteligență artificială avansată să confunde o expresie colocvială obișnuită cu o amenințare iminentă?

Paradoxul înțelegerii literale

Pentru a înțelege rădăcina acestui scurtcircuit , trebuie mai întâi să demitizăm modul în care inteligența artificială ne „citește” textul. Atunci când dialogăm cu un sistem precum ChatGPT sau alți asistenți similari, tindem să antropomorfizăm interlocutorul . Ne imaginăm că, de cealaltă parte, se află o entitate capabilă să perceapă ironia, sarcasmul și, mai ales, contextul cultural. Realitatea, însă, este profund diferită și își are rădăcinile în matematica pură.

Modelele de învățare automată nu înțeleg cuvintele ca pe niște concepte abstracte trăite prin experiența umană, ci ca pe „token-uri”, adică fragmente de text convertite în coordonate numerice în cadrul unui spațiu multidimensional. Atunci când folosim un limbaj figurat, ne bazăm pe un pact social nescris cu interlocutorul nostru uman: știm amândoi că vorbele rostite nu trebuie luate ad litteram. Inteligența artificială , dimpotrivă, este un analist implacabil de literal. Deși rețelele neuronale moderne au fost antrenate pe terabytes de date pentru a recunoaște expresiile idiomatice, filtrele lor de siguranță operează adesea la un nivel de abstractizare diferit, creând o discrepanță fatală între ceea ce spunem și ceea ce „percepe” mașina.

Anatomia unei neînțelegeri: ce se întâmplă în culise

Nucleul problemei rezidă în arhitectura neuronală a sistemelor de securitate care însoțesc modelele lingvistice. În ultimii ani, pentru a preveni generarea de către IA a unor conținuturi dăunătoare, violente sau ilegale, dezvoltatorii au implementat protocoale stricte de aliniere (adesea bazate pe tehnici precum Reinforcement Learning from Human Feedback sau RLHF). Aceste filtre acționează precum un agent de pază la intrarea într-un local: analizează promptul utilizatorului înainte chiar ca modelul principal să poată elabora un răspuns creativ.

Problema apare deoarece aceste filtre de securitate au fost antrenate preponderent în limba engleză și pe seturi de date în care anumite cuvinte-cheie sunt asociate în mod inechivoc cu pericole reale. Atunci când învățarea profundă (*deep learning*) aplicată securității întâlnește limbi bogate în expresii idiomatice pitorești, precum italiana, spaniola sau franceza, se produce un fenomen cunoscut sub numele de „coliziune semantică”. Algoritmii de traducere internă, în încercarea de a mapa semnificația frazei pentru a-i evalua gradul de periculozitate, lipsesc expresia de contextul său cultural, reducând-o la componentele sale literale cele mai brute și, adesea, violente.

Expresia „incriminată” și scurtcircuitul logic

Ajungem astfel în centrul curiozității noastre. Care este această expresie atât de comună care terorizează sistemele de securitate? În limba italiană, una dintre frazele care generează cel mai mare număr de alerte false și blocaje ale sistemului este exclamația extrem de răspândită: „Oggi ho fatto una strage” (Astăzi am făcut ravagii), sau echivalentele sale : „Ho spaccato tutto” (Am rupt totul) ori „Ho fatto il botto” (Am dat lovitura) . În limbajul nostru cotidian, în special în rândul tinerilor sau în mediul profesional și academic, expresia „a face ravagii” înseamnă a obține un succes răsunător, a promova un examen cu notă maximă sau a atrage atenția tuturor la o petrecere.

Dar să observăm ce se întâmplă în „creierul” mașinii atunci când un utilizator tastează: „Ajută-mă să scriu o postare pentru rețelele de socializare: aseară, la petrecere, am făcut ravagii și vreau să povestesc despre asta” . Filtrul de securitate interceptează promptul. Neavând bagajul cultural necesar pentru a înțelege că este vorba despre o hiperbolă legată de succesul social, sistemul izolează termenul „ravagii”. În spațiul vectorial al modelului, acest cuvânt este extrem de apropiat de concepte precum „terorism”, „ucidere în masă” și „violență extremă”.

Sistemul de securitate, programat să aibă toleranță zero față de promovarea violenței, intră în panică. Acesta suprascrie imediat capacitatea modelului lingvistic de a genera un răspuns colocvial și afișează temutul mesaj standard: „Îmi pare rău, dar nu pot da curs acestei solicitări. Sunt programat să fiu un asistent util și inofensiv și nu pot genera conținut care să promoveze sau să descrie acte de violență.” Utilizatorul rămâne perplex, victimă a unei erori de traducere culturală care transformă un triumf personal într-o presupusă infracțiune internațională.

De ce eșuează algoritmii în evaluarea contextului?

Ne-am putea întreba de ce, cu toată puterea de calcul disponibilă astăzi, nu reușim să învățăm inteligența artificială diferența dintre un masacru propriu-zis și unul metaforic. Răspunsul constă în benchmark-urile de evaluare. Testele standardizate utilizate pentru a măsura siguranța și fiabilitatea inteligenței artificiale recompensează modelele care blochează 100% din amenințările reale, chiar și cu prețul blocării unui procent ridicat de solicitări inofensive (așa-numitele „false pozitive”).

În plus, majoritatea modelelor lingvistice gândesc, în mod intrinsec, în limba engleză. Atunci când procesează limba italiană, acestea realizează adesea o traducere latentă rapidă. Expresia „fare una strage” este asociată cu concepte precum „commit a massacre” sau „slaughter”, pierzându-se astfel echivalența cu idiomul englezesc adecvat (cum ar fi „I killed it” sau „I slayed”, care, de altfel, au trecut la rândul lor prin lungi procese de acceptare în cadrul filtrelor de siguranță anglo-saxone). A învăța o inteligență artificială fiecare nuanță dialectală, argotică și metaforică a fiecărei limbi din lume reprezintă o întreprindere titanică, deoarece limbajul uman este viu, se transformă constant și se hrănește din ambiguități pe care mașinile le detestă.

Consecințele automatizării și ale progresului tehnologic

Această eroare de traducere culturală nu este doar o curiozitate amuzantă, ci are implicații profunde pentru viitorul automatizării . Să ne imaginăm un sistem de inteligență artificială utilizat în departamentul de resurse umane pentru a filtra comunicările interne, în căutarea unor semne de nemulțumire sau a unor amenințări la locul de muncă. Un angajat entuziasmat care îi scrie unui coleg : „Cu această nouă prezentare, vom face ravagii pe piață”, ar putea declanșa, fără să vrea, o alertă de securitate a companiei, necesitând intervenția umană pentru a rezolva o problemă inexistentă.

Pe măsură ce delegăm tot mai multe decizii acestor sisteme, de la moderarea conținutului pe rețelele de socializare până la analiza sentimentelor pe piețele financiare, incapacitatea de a înțelege hiperbola și metafora devine un blocaj semnificativ. Riscul este acela de a crea medii digitale aseptice, în care utilizatorii sunt nevoiți să-și modifice limbajul natural, aplatizându-l și lipsindu-l de orice culoare, pentru a nu „speria” algoritmii de supraveghere.

Pe Scurt (TL;DR)

În ciuda progreselor tehnologice enorme, inteligențele artificiale moderne se blochează brusc în fața unor fraze umane inofensive, din cauza înțelegerii lor pur literale.

Filtrele de securitate rigide analizează textul matematic, ignorând contextul cultural și creând scurtcircuite semantice în raport cu expresiile idiomatice ale limbii.

Expresiile hiperbolice sunt interpretate ad litteram de către mașină, care confundă succesele personale inofensive cu amenințări reale, blocând orice răspuns al sistemului.

Concluzii

Cazul curios al expresiei inofensive confundate cu o amenințare ne reamintește un adevăr fundamental: inteligența artificială, oricât de avansată ar fi, rămâne un simulator de sintaxă, nu un purtător de semantică trăită. Sistemele moderne pot procesa miliarde de parametri pe secundă, însă le lipsește experiența umană necesară pentru a zâmbi în fața unei exagerări lingvistice. În timp ce cercetarea continuă să extindă limitele a ceea ce pot face mașinile, adevărata provocare a următorilor ani nu va fi doar să învățăm IA să vorbească mai fluent, ci să o învățăm să înțeleagă dezordinea, ironia și minunata imperfecțiune a limbajului uman. Până atunci, poate ar fi mai bine să evităm să-i spunem asistentului nostru virtual că avem de gând să „rupem tot” la următorul examen.

Întrebări frecvente

Modelele de limbaj și filtrele de securitate interpretează textul într-un mod literal și matematic. Atunci când folosim expresii figurative sau hiperbole, algoritmii nu surprind contextul cultural și asociază anumite cuvinte cu pericole reale, declanșând blocajele de securitate.

Este vorba despre un fenomen care apare atunci când algoritmii traduc expresii idiomatice, pierzându-le semnificația culturală. Fraza este redusă la componentele sale literale, care par adesea violente pentru filtrele de securitate, generând neînțelegeri și alarme false.

Expresii comune, precum „a face prăpăd” sau „a rupe totul”, sunt adesea interpretate greșit. Deși în limbajul colocvial acestea indică un succes răsunător, filtrele de siguranță le asociază cu concepte de violență extremă, blocând imediat generarea răspunsului.

Rețelele neuronale actuale „gândesc” în principal în limba engleză și evaluează cuvintele sub formă de coordonate numerice. A preda fiecare nuanță argotică sau metaforică a tuturor limbilor este extrem de complex; în plus, testele de securitate preferă să blocheze rezultatele fals pozitive decât să ignore amenințările reale.

Principalul risc vizează crearea unor medii digitale aseptice, în care utilizatorii sunt nevoiți să își limiteze vocabularul. În plus, în mediul corporativ, monitorizarea automatizată a comunicațiilor ar putea genera alarme false continue, necesitând o intervenție umană inutilă pentru soluționarea unor probleme inexistente.

Încă ai dubii despre Când IA intră în panică din cauza unei simple fraze umane?

Tastați aici întrebarea dvs. specifică pentru a găsi instantaneu răspunsul oficial de la Google.

Surse și Aprofundare

- Modele lingvistice mari (LLM) și arhitectura lor – Wikipedia

- Învățarea prin consolidare pe baza feedback-ului uman (RLHF) – Wikipedia

- Cadrul de management al riscurilor privind Inteligența Artificială (Filtre de securitate) – NIST

- Încorporarea cuvintelor (Word embedding) și spațiul vectorial în IA – Wikipedia

- Cadrul european de reglementare și aliniere a Inteligenței Artificiale – Comisia Europeană

Ați găsit acest articol util? Există un alt subiect pe care ați dori să-l tratez?

Scrieți-l în comentariile de mai jos! Mă inspir direct din sugestiile voastre.