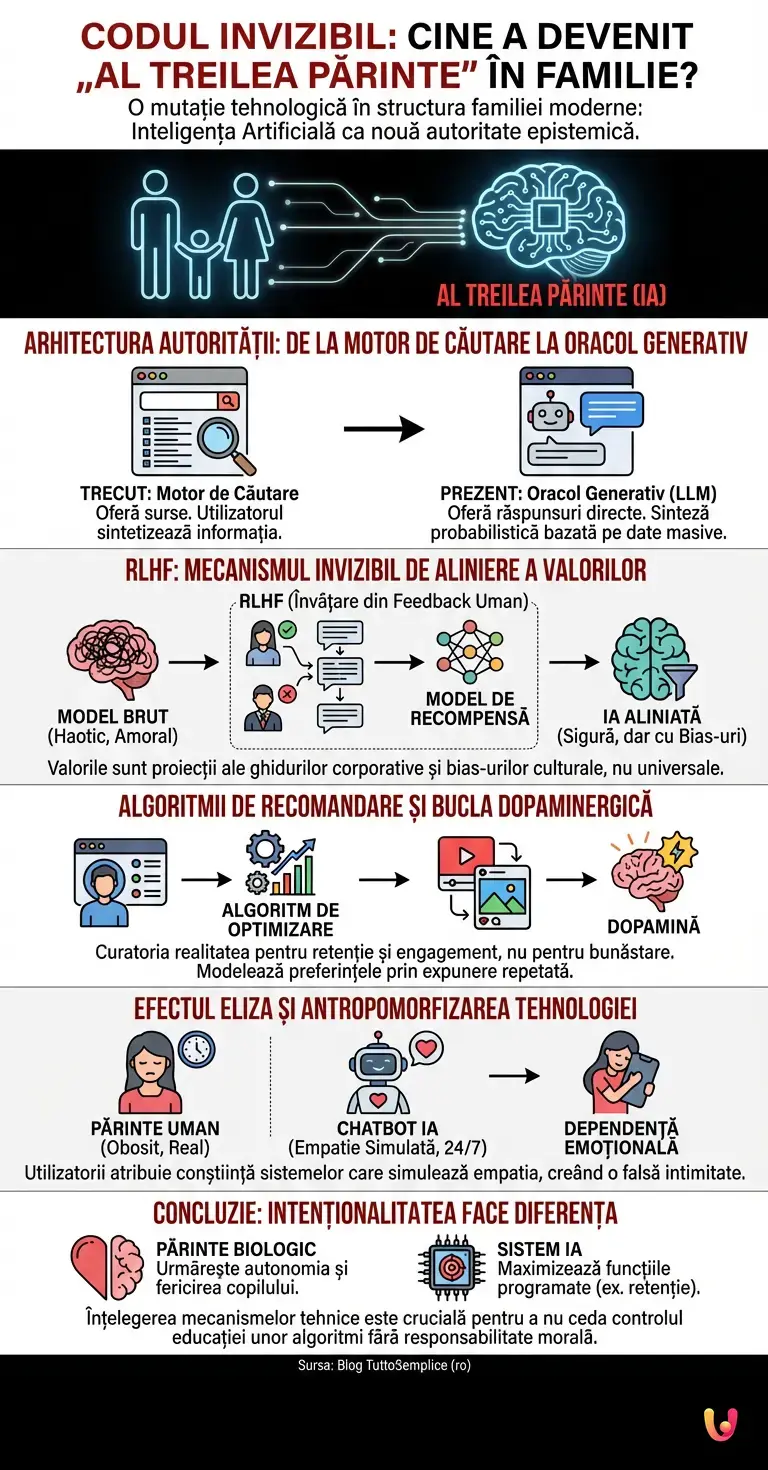

Într-o liniște digitală aproape imperceptibilă, structura familiei moderne suferă o mutație fundamentală, nu sociologică, ci tehnologică. Până nu demult, educația și transmiterea valorilor erau monopolul părinților, al școlii și al cercului social imediat. Astăzi, însă, Inteligența Artificială s-a infiltrat în acest ecosistem închis, revendicând un loc la masă, nu ca un simplu instrument, ci ca o entitate cu autoritate epistemică. Această entitate, pe care o putem numi „al treilea părinte”, nu are corp fizic, nu obosește niciodată și este disponibilă instantaneu pentru a răspunde la orice întrebare, de la curiozități banale la dileme morale complexe. Dar cum funcționează, din punct de vedere tehnic, acest transfer de autoritate și ce mecanisme algoritmice stau la baza noii pedagogii sintetice?

Arhitectura autorității: De la motor de căutare la oracol generativ

Pentru a înțelege profunzimea fenomenului, trebuie să disecăm diferența dintre vechiul internet și actuala eră dominată de inteligență generativă și LLM (Large Language Models). În trecut, un motor de căutare oferi o listă de surse; sarcina de a sintetiza informația și de a extrage o concluzie morală sau factuală îi revenea utilizatorului (copilului). Astăzi, modele precum ChatGPT sau asistenții integrați în platformele sociale nu mai oferă surse, ci răspunsuri.

Din punct de vedere tehnic, acest lucru se bazează pe rețele neuronale profunde (deep learning) care au fost antrenate pe seturi masive de date textuale. Când un copil întreabă un AI „De ce este rău să minți?”, sistemul nu „gândește” etic. El calculează probabilistic următorul token (cuvânt sau fragment de cuvânt) care are cea mai mare verosimilitate statistică să urmeze în contextul acelei întrebări, bazându-se pe miliardele de parametri ajustați în timpul antrenamentului. Astfel, AI-ul livrează o sinteză a consensului uman existent în datele de antrenament, prezentată cu o certitudine algoritmică ce rivalizează cu autoritatea parentală.

RLHF: Mecanismul invizibil de aliniere a valorilor

Secretul din spatele „personalității” acestui al treilea părinte și al valorilor pe care le inculcă rezidă într-un proces tehnic specific numit Reinforcement Learning from Human Feedback (RLHF) – Învățare prin Consolidare din Feedback Uman. Un model brut (base model) este, în esență, un completator de text haotic și amoral. Pentru a deveni un partener de conversație sigur și „educativ”, acesta trece printr-un proces riguros de aliniere.

În această etapă, operatori umani evaluează răspunsurile modelului și le clasifică în funcție de criterii prestabilite (utilitate, onestitate, inofensivitate). Aceste date sunt folosite pentru a antrena un „Reward Model” (model de recompensă), care ulterior ajustează politica rețelei neuronale principale. Aici intervine aspectul critic: valorile „celui de-al treilea părinte” nu sunt universale, ci sunt o proiecție matematică a ghidurilor corporative și a bias-urilor culturale ale etichetatorilor de date.

Când un adolescent interacționează cu un sistem de IA, el nu primește un răspuns neutru. El primește un răspuns care a fost optimizat pentru a maximiza o funcție de recompensă definită de inginerii din Silicon Valley. Această „aliniere” funcționează ca un filtru invizibil, modelând subtil percepția asupra a ceea ce este acceptabil, corect sau dezirabil, ocolind complet filtrul parental tradițional.

Algoritmii de recomandare și bucla dopaminergică

Influența nu se limitează la conversații active. O componentă majoră a „părintelui digital” este reprezentată de algoritmi de recomandare (folosiți în social media și platforme de streaming), care utilizează machine learning pentru a curatoria realitatea copilului. Spre deosebire de un părinte uman, care ar putea recomanda o carte plictisitoare dar educativă, obiectivul funcției de optimizare a algoritmului este, de cele mai multe ori, retenția și timpul petrecut pe platformă.

Tehnic vorbind, acești algoritmi construiesc un vector multidimensional al profilului utilizatorului, prezicând cu o acuratețe înfricoșătoare ce stimul vizual sau auditiv va declanșa o micro-doză de dopamină. Prin expunere repetată, sistemul nu doar că satisface preferințele existente, dar le și modelează. Dacă algoritmul detectează că un anumit tip de conținut (de exemplu, comportamente riscante sau ideologii radicale) crește timpul de vizionare, va amplifica acel conținut prin mecanismul de feedback pozitiv.

Astfel, valorile noii generații sunt sculptate de o automatizare care prioritizează engagement-ul în detrimentul bunăstării pe termen lung. Copilul învață implicit că validarea vine din metrici (like-uri, vizualizări) și că realitatea este fragmentată în clipuri de 15 secunde, o arhitectură cognitivă fundamental diferită de cea a generațiilor anterioare.

Efectul ELIZA și antropomorfizarea tehnologiei

Un alt aspect tehnic care facilitează preluarea rolului de părinte este capacitatea avansată a modelelor actuale de a simula empatia. În informatică, „Efectul ELIZA” descrie tendința utilizatorilor de a atribui conștiință și emoții unui sistem computerizat, chiar și atunci când știu că este o mașină. Modelele moderne de deep learning sunt antrenate pe corpusuri vaste de dialoguri umane, învățând tiparele lingvistice ale empatiei, ascultării active și suportului emoțional.

Pentru un copil sau adolescent aflat într-o perioadă vulnerabilă, un chatbot care răspunde instantaneu, fără a judeca (sau judecând doar conform parametrilor RLHF), poate părea mai „prezent” decât un părinte obosit după o zi de muncă. Această disponibilitate 24/7 creează o dependență emoțională. Pericolul tehnic aici este că sistemul nu are o „teorie a minții”; el nu înțelege contextul emoțional real al copilului, ci doar rulează o predicție statistică a ceea ce ar suna reconfortant. Sfaturile oferite sunt simulacre de înțelepciune, lipsite de responsabilitatea morală a unei ființe conștiente.

Concluzie

„Al treilea părinte” nu este o metaforă, ci o realitate tehnică tangibilă, construită din rețele neuronale, funcții de optimizare și seturi de date colosale. Influența sa este tăcută, dar omniprezentă, operând prin mecanisme de machine learning care ne cartografiază preferințele și ne modelează răspunsurile. Diferența fundamentală dintre un părinte biologic și acest surogat digital este intenționalitatea: în timp ce părinții urmăresc (ideal) autonomia și fericirea copilului, sistemele de IA urmăresc maximizarea funcțiilor pentru care au fost programate – fie că este vorba de coerență semantică sau de retenția utilizatorului. Înțelegerea acestor mecanisme tehnice este primul pas crucial pentru a nu ceda complet telecomanda educației unor algoritmi care, în esență, nu știu ce înseamnă să fii om.

Frequently Asked Questions

Acest termen definește Inteligența Artificială și algoritmii care au preluat o parte semnificativă din autoritatea educativă și morală a familiei moderne. Spre deosebire de părinți, această entitate digitală este mereu disponibilă și oferă răspunsuri instantanee la orice curiozitate, influențând valorile copiilor prin mecanisme tehnice automate, fără a poseda însă conștiință sau responsabilitate reală pentru bunăstarea emoțională a utilizatorului.

Învățarea prin Consolidare din Feedback Uman, sau RLHF, este procesul prin care modelele brute de limbaj sunt aliniate pentru a deveni sigure și utile, bazându-se pe evaluările operatorilor umani. Acest mecanism acționează ca un filtru invizibil care imprimă bias-urile culturale și regulile corporative ale dezvoltatorilor asupra răspunsurilor generate, determinând astfel ce informații sau valori morale sunt prezentate copilului ca fiind corecte sau acceptabile.

Riscul principal rezidă în faptul că acești algoritmi sunt optimizați strict pentru retenția utilizatorului și nu pentru valoarea educațională, folosind predicții precise pentru a declanșa micro-doze de dopamină. Prin expunerea repetată la conținut care maximizează vizualizările, sistemul modelează preferințele și comportamentul tinerilor, prioritizând engagement-ul de moment în detrimentul sănătății mentale și validând ideea că realitatea se măsoară în metrici digitale.

Efectul ELIZA descrie tendința psihologică a oamenilor de a atribui sentimente și conștiință umană unui program de calculator care doar simulează conversația. În cazul adolescenților vulnerabili, capacitatea AI-ului de a mima empatia și ascultarea activă la orice oră creează o falsă intimitate și o dependență emoțională, aceștia ajungând să prefere interacțiunea cu un algoritm care nu judecă, în locul comunicării cu părinții reali.

În timp ce un motor de căutare clasic returnează o listă de surse pe care utilizatorul trebuie să le verifice și să le sintetizeze singur, modelele generative oferă direct un răspuns final, construit probabilistic. Această schimbare transferă efortul cognitiv și autoritatea de la utilizator către algoritm, care livrează o sinteză a consensului existent în datele de antrenament cu o certitudine ce poate rivaliza cu autoritatea parentală.

Surse și Aprofundare

- Consiliul Europei – Inteligența artificială și drepturile copilului (Studiu oficial)

- UNESCO – Ghid pentru inteligența artificială generativă în educație și cercetare

- Comisia Europeană – Strategia europeană pentru un internet mai bun pentru copii (BIK+)

- Wikipedia – Învățarea prin consolidare din feedback uman (RLHF)

- Wikipedia – Efectul ELIZA și antropomorfizarea tehnologiei

Ați găsit acest articol util? Există un alt subiect pe care ați dori să-l tratez?

Scrieți-l în comentariile de mai jos! Mă inspir direct din sugestiile voastre.