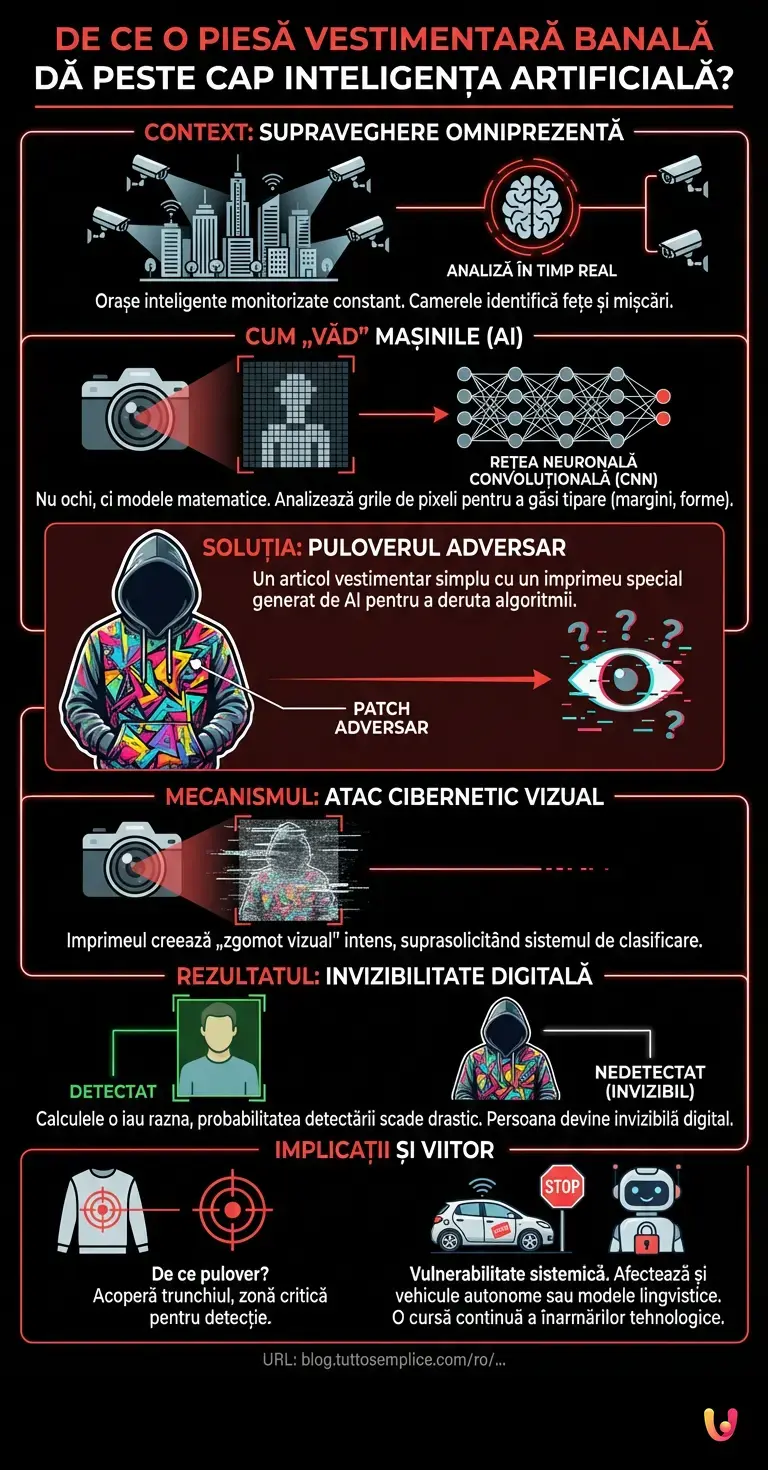

Trăim într-o epocă în care spațiul public este constant monitorizat. Orașele noastre au devenit ecosisteme inteligente, presărate cu camere de securitate de ultimă generație, capabile nu doar să înregistreze imagini, ci și să le analizeze în timp real. Recunosc fețe, urmăresc mișcări, identifică comportamente anormale. În fața acestei supravegheri omniprezente, reacția instinctivă ar putea fi aceea de a imagina soluții științifico-fantastice pentru a ne proteja intimitatea, cum ar fi pelerine de invizibilitate sau dispozitive de bruiaj electromagnetic. Cu toate acestea, răspunsul cel mai eficient și surprinzător se află într-un obiect de uz cotidian, cunoscut de experții în securitate cibernetică drept „puloverul adversar” . Acest articol vestimentar simplu, aparent inofensiv, ascunde un secret tehnologic capabil să blocheze cele mai avansate sisteme de viziune artificială de pe planetă.

Pentru a înțelege cum o simplă piesă vestimentară poate învinge sisteme de supraveghere care au costat milioane de dolari în cercetare și dezvoltare, este necesar să facem un pas înapoi și să analizăm modul în care mașinile „văd” lumea . Inteligența artificială nu are ochi și nici un creier biologic capabil să interpreteze lumina și formele în mod intuitiv. Vederea artificială se bazează pe modele matematice și statistice complexe.

Ochiul digital: cum „văd” mașinile

Când o cameră video surprinde o stradă, nu vede „persoane” sau „mașini”. Vede o grilă de pixeli, fiecare cu o valoare numerică ce îi reprezintă culoarea și intensitatea luminoasă. Aici intervine învățarea automată (machine learning ). Prin antrenarea pe milioane de imagini pre-etichetate, sistemele învață să recunoască tipare specifice. Dacă un grup de pixeli prezintă anumite variații de contrast, margini și gradienți, sistemul calculează probabilitatea ca acel aglomerat de date să reprezinte o ființă umană.

Acest proces este posibil datorită deep learning-ului și, în special, unei arhitecturi neuronale specifice, cunoscută sub numele de Rețea Neuronală Convoluțională (CNN). Aceste rețele analizează imaginea pe straturi: primele straturi recunosc linii și margini simple, straturile intermediare identifică forme geometrice, iar straturile finale combină aceste elemente pentru a recunoaște obiecte complexe, cum ar fi o față sau silueta unui corp uman. Sisteme renumite precum YOLO (You Only Look Once) sunt capabile să execute aceste operațiuni în fracțiuni de secundă, desenând așa-numitele „bounding box” (casete de delimitare) în jurul persoanelor identificate în videoclip.

Secretul dezvăluit: știința puloverului adversarului

Dacă inteligența artificială se bazează pe tipare vizuale pentru a identifica o ființă umană, ce se întâmplă dacă îi oferim un tipar conceput special pentru a o deruta? Acesta este exact principiul din spatele puloverului adversar. Nu este vorba de un material magic care îndoaie lumina, ci de o piesă vestimentară imprimată cu o imagine foarte specială, denumită în jargon tehnic „patch adversar” (adversarial patch).

În ochii unui om, puloverul pare pur și simplu un articol de îmbrăcăminte cu un imprimeu bizar, poate puțin psihedelic sau abstract. Ar putea părea o imagine neclară a unor oameni într-o piață sau un colaj de forme geometrice colorate. Dar pentru algoritmii de detectare a obiectelor, acel imprimeu este un adevărat atac cibernetic vizual.

Cercetătorii au folosit aceeași inteligență artificială pentru a genera aceste imprimeuri. Au cerut unui algoritm să creeze o imagine care să conțină caracteristicile vizuale exacte (gradienți, contraste, intersecții de linii) pe care rețelele neuronale le asociază cu „ceva care nu este o persoană” sau care să genereze un „zgomot vizual” suficient de puternic pentru a suprasolicita sistemul de clasificare. Când o persoană poartă acest pulover, camera capturează scena. Rețeaua neuronală începe să analizeze pixelii. Cu toate acestea, când ajunge la zona bustului acoperită de pulover, calculele matematice o iau razna. Valorile de probabilitate care indică prezența unui om scad drastic. Sistemul pur și simplu decide că acolo nu este nimeni. Persoana devine, din toate punctele de vedere digitale, invizibilă.

De ce tocmai un pulover?

Alegerea articolului de îmbrăcăminte nu este întâmplătoare. Sistemele de detectare a pietonilor se bazează în mare măsură pe identificarea trunchiului și a umerilor, deoarece acestea sunt cele mai mari și mai vizibile părți ale corpului, mai puțin supuse ocluziilor decât picioarele sau brațele. Acoperirea acestei zone critice cu un patch adversar maximizează eficacitatea iluziei. În plus, un pulover sau o bluză oferă o suprafață largă și relativ plată pe care se poate imprima modelul, asigurând că imaginea nu se deformează excesiv odată cu mișcările corpului, ceea ce ar putea compromite eficacitatea acesteia.

Testele efectuate în diverse laboratoare universitare au demonstrat că aceste articole de îmbrăcăminte reușesc să eludeze sistemele de supraveghere cu procente de succes uimitoare, depășind cu brio orice standard de referință de securitate utilizat pentru a evalua robustețea software-urilor de viziune computerizată.

Dincolo de supraveghere: implicațiile pentru viitor

Descoperirea acestei vulnerabilități ridică probleme profunde care depășesc cu mult simpla dorință de a eluda o cameră de supraveghere. Demonstrează că sistemele de inteligență artificială, oricât de avansate ar fi, percep realitatea într-un mod fundamental diferit de al nostru. Sunt mașini statistice și, ca atare, pot fi păcălite prin exploatarea propriilor reguli matematice.

Acest fenomen al „ atacurilor adverse ” nu se limitează la viziunea artificială. Este o problemă sistemică ce afectează întregul domeniu al inteligenței artificiale. De exemplu, în domeniul automatizării și al vehiculelor autonome, cercetătorii au demonstrat că este suficient să se aplice câteva mici abțibilduri negre pe un indicator „Stop” pentru ca mașina să creadă că este vorba de un indicator de limită de viteză, cu consecințe potențial dezastruoase.

Și în lumea procesării limbajului natural situația este similară. Modelele lingvistice mari, sau LLM-uri , precum ChatGPT , pot fi supuse unor „prompturi adverse” (adesea numite jailbreak). Prin introducerea unor secvențe de cuvinte specifice, aparent inofensive sau lipsite de sens pentru un om, este posibil să se ocolească filtrele de siguranță ale modelului, obligându-l să genereze răspunsuri care în mod normal i-ar fi interzise. Logica de bază este aceeași ca în cazul puloverului: se oferă un input (vizual sau textual) care exploatează punctele oarbe ale arhitecturii modelului.

Cursa înarmărilor tehnologice

Progresul tehnologic în acest domeniu a declanșat o adevărată cursă a înarmărilor între cei care dezvoltă sisteme de inteligență artificială și cei care încearcă să le eludeze. Pe de o parte, inginerii lucrează pentru a face rețelele neuronale mai robuste, antrenându-le să recunoască și să ignore patch-urile adversarilor. Pe de altă parte, cercetătorii (și potențialii răufăcători) dezvoltă modele din ce în ce mai sofisticate, capabile să se adapteze la diferite unghiuri, condiții de lumină și chiar să păcălească senzorii în infraroșu.

Această dinamică este fundamentală pentru îmbunătățirea tehnologiei. Descoperirea faptului că un simplu pulover poate orbi un sistem de securitate îi obligă pe dezvoltatori să nu considere infailibilitatea creațiilor lor ca fiind de la sine înțeleasă. Ne amintește că inteligența artificială este un instrument puternic, dar fragil, și că integrarea sa în infrastructuri critice necesită o înțelegere profundă a limitelor sale intrinseci.

Pe Scurt (TL;DR)

Orașele noastre sunt supravegheate de camere inteligente, dar un simplu pulover ne poate proteja intimitatea păcălind inteligența artificială.

Sistemele de viziune artificială analizează pixelii pentru a recunoaște pietonii, dar sunt derutate de anumite imprimeuri numite patch-uri adversare.

Purtând aceste haine cu modele vizuale țintite pe bust, algoritmul se blochează, iar individul devine digital invizibil pentru camerele de filmat.

Concluzii

Puloverul adversar reprezintă un paradox fascinant al erei noastre digitale: cea mai complexă și sofisticată tehnologie poate fi pusă în genunchi de o bucată de bumbac imprimat. Acest articol vestimentar nu este doar un truc curios pentru a scăpa de Big Brother, ci manifestarea fizică a unei vulnerabilități matematice. Ne învață că, în timp ce inteligența artificială continuă să evolueze și să pătrundă în fiecare aspect al vieții noastre, înțelegerea noastră despre cum aceste mașini „gândesc” și „văd” trebuie să evolueze în același ritm. Invizibilitatea, astăzi, nu necesită magie, ci doar combinația potrivită de pixeli imprimați pe un articol de îmbrăcăminte de zi cu zi.

Întrebări frecvente

Un pulover adversar este un articol de îmbrăcăminte special conceput pentru a păcăli sistemele de supraveghere bazate pe inteligență artificială. Prezintă o imprimare specială, numită patch advers, care generează zgomot vizual și derutează algoritmii de detectare. Purtând acest articol de îmbrăcăminte, calculele matematice ale camerei video o iau razna, iar persoana devine practic invizibilă pentru sistemul digital.

Sistemele de viziune artificială nu percep lumea așa cum o fac oamenii, ci analizează o grilă de pixeli, evaluând culorile și intensitatea luminii. Prin intermediul rețelelor neuronale convoluționale, algoritmii caută tipare specifice, cum ar fi contrastele și formele geometrice tipice corpului uman. Dacă aceste elemente matematice coincid cu datele de antrenament, software-ul identifică prezența unui pieton.

Software-urile de detecție a pietonilor se concentrează în principal pe identificarea trunchiului și a umerilor, acestea fiind părțile corpului mai mari și mai puțin supuse obstacolelor vizuale. Un pulover oferă o suprafață extinsă și relativ plată, ideală pentru a găzdui imprimarea modelului advers fără a-l deforma prea mult în timpul mișcărilor. Acoperirea acestei zone critice maximizează șansele de succes ale iluziei optice digitale.

Problema vulnerabilităților matematice afectează întregul domeniu al învățării automate, nu doar camerele de supraveghere. În sectorul vehiculelor autonome, mici abțibilduri pe un indicator rutier pot altera complet percepția mașinii, cauzând pericole grave. Chiar și modelele lingvistice avansate pot fi supuse unor manipulări similare prin secvențe de text specifice, concepute pentru a ocoli filtrele de securitate.

În prezent, există o adevărată provocare tehnologică între cei care creează sisteme de securitate și cei care proiectează metode de a le eluda. Inginerii informatici lucrează constant pentru a face rețelele neuronale mai robuste, antrenându-le să recunoască și să ignore tiparele înșelătoare. Această dinamică este esențială pentru descoperirea limitelor intrinseci ale tehnologiei și pentru îmbunătățirea fiabilității infrastructurilor critice ale viitorului.

Încă ai dubii despre De ce o piesă vestimentară banală dă peste cap inteligența artificială??

Tastați aici întrebarea dvs. specifică pentru a găsi instantaneu răspunsul oficial de la Google.

Surse și Aprofundare

- Învățarea automată adversarială (Adversarial machine learning) – Concepte și vulnerabilități (Wikipedia)

- Arhitectura Rețelelor Neuronale Convoluționale (CNN) utilizate în viziunea artificială (Wikipedia)

- Lucrarea originală YOLO: You Only Look Once – Detectarea unificată și în timp real a obiectelor (Sursă instituțională arXiv – Universitatea Cornell)

- Raport privind atacurile cibernetice care manipulează comportamentul sistemelor AI – Institutul Național de Standarde și Tehnologie din SUA (.gov)

- Legea privind IA: reglementarea sistemelor de identificare biometrică și supraveghere – Parlamentul European

Ați găsit acest articol util? Există un alt subiect pe care ați dori să-l tratez?

Scrieți-l în comentariile de mai jos! Mă inspir direct din sugestiile voastre.