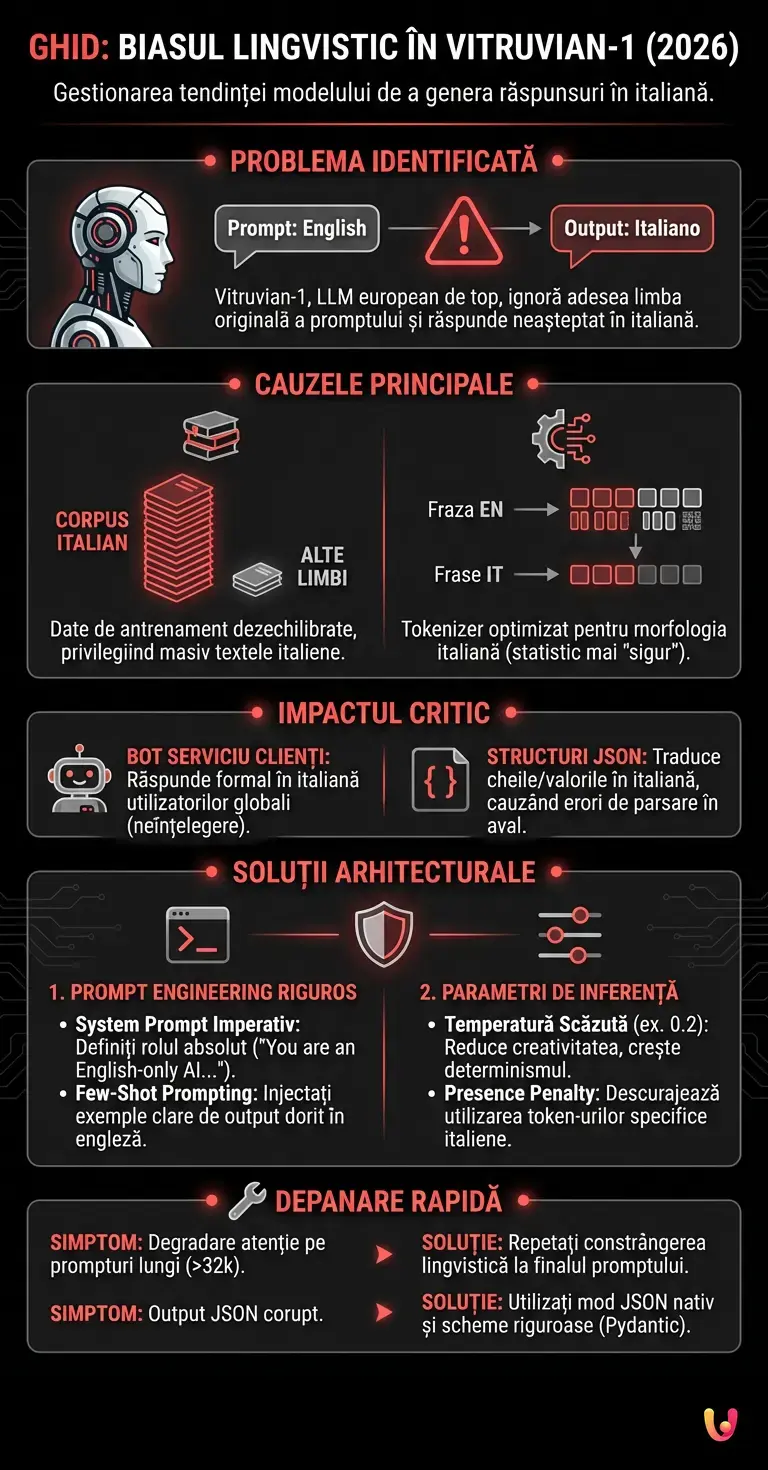

Evoluția inteligenței artificiale în cursul anului 2026 a adus în prim-plan Vitruvian-1, un model lingvistic mare (LLM) care a redefinit standardele europene pentru Procesarea Limbajului Natural (NLP). Cu toate acestea, integrarea acestui instrument în ecosistemele globale a scos la iveală o particularitate tehnică semnificativă: o propensiune puternică de a genera răspunsuri în limba italiană, ignorând uneori limba originală a promptului. Acest ghid tehnic explorează cauzele acestui comportament și oferă soluții arhitecturale pentru dezvoltatori și ingineri de prompturi.

Introducere în Comportamentul Lingvistic al Vitruvian-1

Înțelegerea Suportului multilingv în Vitruvian-1: când modelul generează output în italiană în ciuda unui prompt în engleză este fundamentală pentru dezvoltatorii NLP. Acest fenomen derivă dintr-un bias în datele de antrenament care privilegiază limba italiană în inferențe.

Conform documentației oficiale a Vitruvian-1 lansată la începutul anului 2026, modelul a fost supus unui pre-training intensiv pe corpusuri textuale predominant europene, cu o greutate disproporționată atribuită literaturii, documentelor instituționale și forumurilor în limba italiană. Această abordare, deși excelentă pentru păstrarea nuanțelor culturale locale, a generat un bias lingvistic intrinsec. Când modelul întâlnește instrucțiuni în engleză cu un nivel scăzut de entropie sau contexte ambigue, funcția sa de probabilitate tinde să colapseze spre token-urile italiene, considerate statistic mai «sigure» de către rețeaua neuronală.

Cerințe Preliminare pentru Gestionarea Modelului

Pentru a gestiona Suportul multilingv în Vitruvian-1: când modelul prezintă devieri lingvistice, sunt necesare accesul la API-urile oficiale, biblioteci NLP actualizate la nivelul anului 2026 și o înțelegere solidă a parametrilor de inferență precum temperatura și logit bias.

Înainte de a implementa soluțiile de atenuare, este esențial să configurați corect mediul de dezvoltare. Asigurați-vă că aveți la dispoziție următoarele instrumente:

- Cheie API validă: Acces la stratul de inferență al Vitruvian-1 prin intermediul furnizorului oficial.

- Mediu Python 3.12+: Necesar pentru a gestiona cele mai recente biblioteci de integrare.

- Biblioteci NLP: Instalarea unor framework-uri precum LangChain sau LlamaIndex actualizate la specificațiile din 2026.

- Instrumente de logging: Un sistem pentru urmărirea input-urilor și output-urilor (ex. LangSmith sau Weights & Biases) pentru a analiza devierile lingvistice.

Analiza Biasului Lingvistic în Vitruvian-1

Analiza Suportului multilingv în Vitruvian-1: când modelul forțează italiana dezvăluie o suprareprezentare a corpusurilor textuale italiene în pre-training. Acest dezechilibru alterează ponderile probabilistice, determinând modelul să traducă implicit instrucțiunile englezești.

Pe baza datelor din industrie publicate de principalele institute de cercetare NLP, vocabularul tokenizer-ului Vitruvian-1 este optimizat pentru morfologia italiană. Acest lucru înseamnă că o frază în italiană necesită mai puține token-uri decât traducerea sa în engleză. În timpul fazei de decodificare (decoding), algoritmul încearcă să maximizeze eficiența și probabilitatea generală a secvenței. Dacă Promptul de Sistem nu impune constrângeri rigide, modelul efectuează un language switch autonom, interpretând promptul în engleză dar formulând răspunsul în limba care minimizează pierderea (loss) în timpul generării.

Impactul asupra Aplicațiilor Multilingve

Evaluarea Suportului multilingv în Vitruvian-1: când modelul alterează limba de destinație este crucială, deoarece acest bias lingvistic poate cauza eșecuri în pipeline-urile de traducere automată și în chatbot-urile destinate unui public internațional.

Consecințele acestui comportament sunt deosebit de evidente în arhitecturile software complexe. Mai jos este prezentat un tabel care ilustrează impactul biasului asupra diferitelor tipuri de aplicații:

| Tip de Aplicație | Comportament Așteptat (Prompt EN) | Comportament Real (Vitruvian-1) | Impact asupra Sistemului |

|---|---|---|---|

| Bot Serviciu Clienți | Răspuns în Engleză | Răspuns în Italiană formală | Grav: Neînțelegere din partea utilizatorului final. |

| Extragere Date (JSON) | Chei și valori în Engleză | Chei în Engleză, valori în Italiană | Critic: Eșecul parsării în sistemele din aval. |

| Rezumat Documentar | Summary în Engleză | Summary mixt (Code-switching) | Moderat: Reducerea calității percepute. |

Strategii de Atenuare și Prompt Engineering

Optimizarea Suportului multilingv în Vitruvian-1: când modelul deviază de la engleză necesită tehnici avansate de prompt engineering. Utilizarea directivelor de sistem rigide și a penalizărilor de frecvență ajută la stabilizarea limbii output-ului generat.

Pentru a forța modelul să respecte limba promptului, nu este suficientă o simplă cerere în mesajul utilizatorului. Este necesar să se intervină la nivelul arhitecturii promptului utilizând tehnica Few-Shot Prompting și manipulând parametrii de inferență. Setarea unei Temperaturi scăzute (ex. 0.2) reduce creativitatea modelului, ancorându-l mai mult în instrucțiunile explicite. În plus, utilizarea parametrului Presence Penalty poate descuraja utilizarea token-urilor specifice limbii italiene dacă sunt mapate corect.

Configurarea Promptului de Sistem

Configurarea corectă a Suportului multilingv în Vitruvian-1: când modelul ignoră limba necesită un prompt de sistem explicit. Declararea unor reguli de sistem absolute suprascrie tendințele latente ale modelului către italiană.

Promptul de Sistem este cel mai înalt nivel de instrucțiune pe care îl puteți oferi lui Vitruvian-1. Conform bunelor practici din 2026, un Prompt de Sistem eficient pentru a inhiba biasul italian trebuie să conțină comenzi imperative și să definească rolul în mod neechivoc. De exemplu: «You are an English-only AI assistant. You must process all inputs and generate all outputs strictly in the English language. Under no circumstances should you use Italian words, grammar, or syntax.» Această abordare creează un gard semantic pe care modelul îl depășește cu greu.

Exemple Practice de Apeluri API

Implementarea Suportului multilingv în Vitruvian-1: când modelul necesită corecții programatice se traduce în apeluri API specifice. Modificarea parametrilor în payload-ul JSON garantează răspunsuri coerente cu limba promptului.

Iată cum să structurați un apel API robust în Python pentru a neutraliza biasul lingvistic. Procesul prevede trei pași fundamentali:

- Definirea riguroasă a rolului în blocul

system. - Injectarea de exemple (Few-Shot) care demonstrează output-ul așteptat în engleză.

- Reglarea parametrilor

temperatureșitop_ppentru a favoriza un output deterministic.

import requests

url = "https://api.vitruvian.ai/v1/chat/completions"

headers = {"Authorization": "Bearer YOUR_API_KEY"}

payload = {

"model": "vitruvian-1-instruct",

"messages": [

{"role": "system", "content": "You are an AI that speaks strictly English. Never use Italian."},

{"role": "user", "content": "Explain quantum computing in simple terms."}

],

"temperature": 0.1,

"presence_penalty": 0.5

}

response = requests.post(url, json=payload, headers=headers)

print(response.json())

Depanarea Răspunsurilor Anormale

Rezolvarea problemelor de Suport multilingv în Vitruvian-1: când modelul continuă să răspundă în italiană implică analiza log-urilor de inferență. Verificarea tokenizării și scăderea temperaturii reduce drastic halucinațiile lingvistice nedorite.

În ciuda precauțiilor, în scenarii de stres sau cu prompturi foarte lungi (peste 32k token-uri), modelul ar putea suferi o degradare a atenției și să revină la comportamentul său implicit. Dacă întâmpinați în continuare probleme, consultați acest tabel de depanare:

| Simptom | Cauză Probabilă | Soluție Recomandată |

|---|---|---|

| Răspunsul începe în Engleză și se termină în Italiană | Degradarea atenției pe prompturi lungi | Repetarea constrângerii lingvistice la sfârșitul promptului utilizatorului (Prompt Injection defensivă). |

| Traducere literală a expresiilor italiene în engleză | Interferență semantică latentă | Adăugarea de exemple Few-Shot cu expresii native englezești pentru a calibra contextul. |

| Output JSON cu chei în italiană | Lipsa unei scheme rigide | Utilizarea modului JSON Mode nativ al API-urilor și furnizarea unei scheme Pydantic riguroase. |

Pe Scurt (TL;DR)

Modelul lingvistic Vitruvian-1 prezintă un bias structural puternic care îl determină să genereze răspunsuri în italiană, ignorând frecvent limba originală a promptului.

Acest fenomen derivă dintr-un antrenament dezechilibrat pe texte italiene, cauzând criticități grave în pipeline-urile de traducere automată și în aplicațiile software internaționale.

Pentru a atenua această anomalie tehnică, dezvoltatorii trebuie neapărat să adopte strategii avansate de prompt engineering și să configureze cu atenție parametrii specifici de inferență ai sistemului.

Concluzii

În sinteză, stăpânirea Suportului multilingv în Vitruvian-1: când modelul manifestă bias spre italiană permite crearea de aplicații NLP robuste. Combinația de prompt engineering și tuning al parametrilor neutralizează eficient această anomalie arhitecturală.

Vitruvian-1 reprezintă o realizare excepțională pentru Informatică și inteligența artificială europeană, dar ca orice model fundațional, poartă cu sine amprentele digitale ale datelor sale de antrenament. Înțelegerea naturii biasului său lingvistic nu este doar un exercițiu academic, ci o necesitate inginerească pentru oricine dorește să implementeze soluții scalabile la nivel global. Prin utilizarea metodică a Prompturilor de Sistem restrictive, calibrarea temperaturii și o monitorizare atentă a output-urilor, dezvoltatorii pot exploata puterea analitică a Vitruvian-1 garantând în același timp o experiență de utilizare multilingvă impecabilă și lipsită de fricțiuni.

Întrebări frecvente

Acest fenomen depinde de un dezechilibru puternic în datele de antrenament inițiale, care privilegiază textele europene și în special limba italiană. În plus, vocabularul modelului optimizează morfologia italiană, făcând această limbă statistic mai eficientă și mai sigură în timpul generării răspunsului.

Pentru a obține răspunsuri coerente cu limba dorită este fundamental să configurați un Prompt de Sistem foarte rigid și imperativ. Se recomandă definirea clară a rolului modelului ca asistent monolingv și aplicarea tehnicii Few-Shot Prompting, oferind exemple practice ale rezultatului așteptat.

Dezvoltatorii ar trebui să scadă parametrul temperaturii la valori mici, cum ar fi 0.2, pentru a face textul generat mai deterministic și mai puțin creativ. Este utilă, de asemenea, reglarea penalizării de prezență pentru a descuraja generarea de token-uri specifice legate de sintaxa italiană.

În textele care depășesc un număr ridicat de token-uri, sistemul poate suferi o scădere a nivelului de atenție și își poate restabili comportamentul implicit. Cea mai bună soluție constă în repetarea constrângerii lingvistice la sfârșitul mesajului trimis de persoană, aplicând o strategie defensivă care reîmprospătează directiva principală.

Problema se manifestă grav în sistemele automatizate, unde modelul tinde să traducă valorile sau cheile în italiană, cauzând eșecul proceselor ulterioare. Pentru a evita aceste erori critice este necesar să utilizați modul nativ pentru date structurate și să furnizați o schemă riguroasă de urmat.

Încă ai dubii despre Ghid privind Biasul Lingvistic și Multilingv în Vitruvian-1?

Tastați aici întrebarea dvs. specifică pentru a găsi instantaneu răspunsul oficial de la Google.

Surse și Aprofundare

- Cadrul de reglementare european privind Inteligența Artificială (Comisia Europeană)

- Inteligența artificială: oportunități și riscuri (Parlamentul European)

- Modele lingvistice mari (LLM) – Concepte fundamentale și arhitectură

- Prejudecăți algoritmice (Bias) în sistemele de Inteligență Artificială

- Procesarea limbajului natural (NLP) și interacțiunea om-calculator

Ați găsit acest articol util? Există un alt subiect pe care ați dori să-l tratez?

Scrieți-l în comentariile de mai jos! Mă inspir direct din sugestiile voastre.