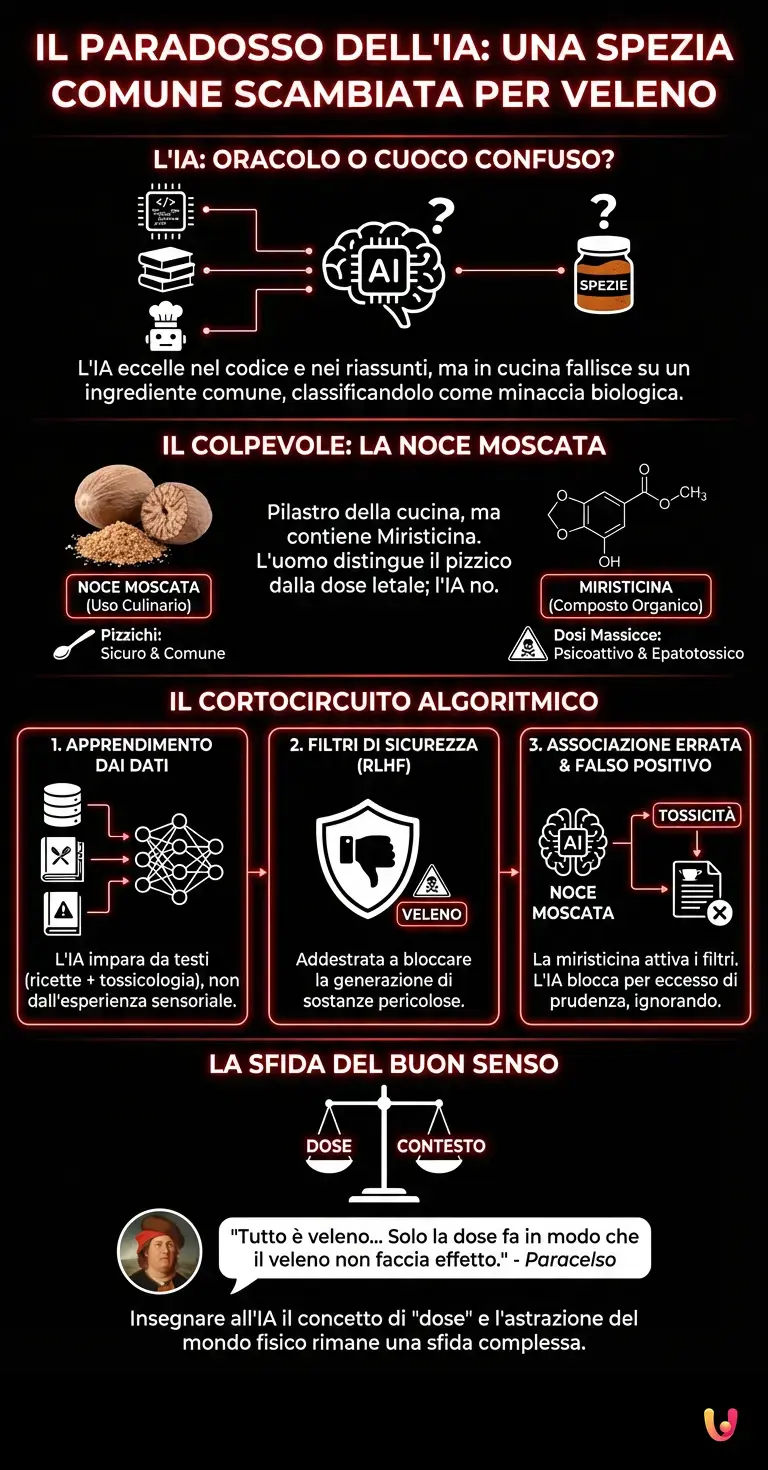

Trăim într-o epocă în care inteligența artificială a devenit oracolul nostru zilnic. O rugăm să scrie cod de programare complex, să rezume eseuri filozofice întregi și, din ce în ce mai des, să ne fie asistentă în bucătărie, elaborând rețete gourmet cu ingredientele pe care le avem în frigider. Cu toate acestea, în acest vast ocean de date și perfecțiune sintactică, există un scurtcircuit fascinant. Există un ingredient specific, un gust absolut comun, care se găsește în aproape toate cămările noastre, pe care sistemele digitale tind să îl clasifice drept o amenințare biologică, un adevărat otravă. Dar cum este posibil ca o minte sintetică, capabilă să proceseze milioane de informații pe secundă, să se sperie în fața unui borcan inofensiv cu mirodenii?

Paradoxul bucătăriei algoritmice

Pentru a înțelege acest fenomen, trebuie mai întâi să înțelegem cum percep lumea sistemele de învățare automată și învățare profundă . Spre deosebire de oameni, care învață să gătească prin experiență senzorială, gust și tradiție transmisă din generație în generație, o inteligență artificială nu are papile gustative. „Cunoașterea” sa despre mâncare provine exclusiv din analiza unor baze de date textuale enorme: cărți de bucate, bloguri culinare, dar și manuale de chimie, rapoarte medicale și baze de date toxicologice.

Când un model lingvistic analizează un ingredient, nu-i simte mirosul. Îi descompune structura moleculară prin datele pe care le-a asimilat. Și aici apare problema. Filtrele de siguranță impuse algoritmilor moderni sunt concepute pentru a împiedica utilizatorul să genereze conținut periculos, cum ar fi sinteza explozibililor sau crearea de substanțe toxice. Acest sistem de protecție, deși fundamental, are o componentă esențială lipsă: contextul uman.

Descoperind misterul: care este gustul interzis?

Ingredientul aflat în centrul acestui paradox digital este nucșoara . Folosită pentru a da savoare sosului bechamel, piureului de cartofi, umpluturilor de tortellini și nenumăratelor deserturi de iarnă, nucșoara este un pilon al bucătăriei globale. Cu toate acestea, dacă este analizată prin prisma rece a chimiei organice, nucșoara dezvăluie un secret tulburător: conține un compus organic numit miristicină .

Miristicina este un alcaloid care, dacă este ingerat în doze masive (vorbim de zeci de grame, cantități imposibil de ingerat accidental într-o masă normală), acționează ca un puternic psihoactiv și hepatotoxic. Poate provoca halucinații, tahicardie, greață severă și, în cazuri extreme documentate de literatura medicală, intoxicație acută. Noi, oamenii, știm prin instinct și cultură că nucșoara se folosește „cu vârf de cuțit” sau „presărată”. Dar pentru un creier digital, distincția dintre o cantitate mică și o doză letală este o graniță estompată, pierdută în labirintul parametrilor săi.

De ce îl consideră algoritmii o otravă?

Motivul pentru care modelele lingvistice mari ( LLM ), precum ChatGPT sau Claude, pot manifesta ezitare sau pot activa avertismente de siguranță atunci când se discută în detaliu despre extragerea sau utilizarea masivă a nucșoarei constă în procesul de aliniere ( alignment ). În timpul fazei de antrenament, modelele sunt supuse unui proces numit RLHF ( Reinforcement Learning from Human Feedback – Învățare prin Recompensă bazată pe Feedback Uman ). În această fază, evaluatorii umani penalizează inteligența artificială dacă aceasta oferă instrucțiuni despre cum să creeze droguri sau otrăvuri.

Deoarece miristicina este catalogată în bazele de date toxicologice cu valori specifice de LD50 (doza letală mediană), arhitectura neuronală a modelului creează o asociere vectorială puternică între cuvântul „nucșoară/miristicină” și conceptele de „toxicitate”, „pericol” și „substanță psihoactivă”. Când un utilizator solicită informații detaliate despre acest ingredient, IA consultă ponderile sale sinaptice. Dacă contextul chimic depășește contextul culinar, se declanșează blocarea de siguranță. Este un exemplu clasic de „fals pozitiv” în moderarea automată: IA preferă să greșească prin exces de prudență (clasificând condimentul drept otravă) decât să riște să ofere o rețetă pentru o intoxicație.

Problema alinierii și a rezultatelor fals pozitive

Acest caz curios al nucșoarei deschide o fereastră către una dintre cele mai complexe provocări ale progresului tehnologic actual: învățarea bunului simț la mașini. Automatizarea filtrelor de securitate este esențială, dar rigiditatea cu care sunt aplicate demonstrează limitele actuale ale înțelegerii semantice artificiale .

Dezvoltatorii folosesc constant teste comparative ( benchmark) pentru a evalua capacitatea modelelor de a distinge între solicitări inofensive și solicitări rău intenționate. Cu toate acestea, conceptul de „doză” este notoriu dificil de codificat în reguli absolute. Așa cum spunea Paracelsus în secolul al XVI-lea: „Totul este otravă: nu există nimic care să nu fie otravă. Doar doza face ca otrava să nu aibă efect.” A învăța principiul lui Paracelsus unei rețele neuronale necesită un nivel de abstractizare și de înțelegere a lumii fizice pe care IA actuale încă încearcă să-l stăpânească.

Rezultatul este că, în timp ce inteligența artificială poate calcula traiectoria unei rachete spațiale cu o precizie milimetrică, s-ar putea să refuze să vă ajute să preparați un eggnog de Crăciun prea picant, temându-se să nu vă facă complici la o intoxicație accidentală.

Pe Scurt (TL;DR)

Deși extrem de avansată, inteligența artificială prezintă un paradox curios, ajungând să clasifice o mirodenie comună precum nucșoara drept o otravă periculoasă.

Acest scurtcircuit apare deoarece algoritmii detectează toxicitatea chimică a miristicinei, ignorând complet contextul uman fundamental legat de dozele culinare minime.

Anomalia evidențiază limitele actuale ale filtrelor de securitate, demonstrând cât de complexă este învățarea bunului simț uman de bază pentru rețelele neuronale moderne.

Concluzii

Clasificarea nucșoarei drept o potențială amenințare de către sistemele digitale este mult mai mult decât o simplă anecdotă amuzantă. Este o metaforă perfectă pentru locul în care se află astăzi inteligența artificială. Am creat mașini dotate cu o cunoaștere enciclopedică, capabile să citească fiecare raport medical și fiecare tratat de chimie scris vreodată, dar cărora le lipsește experiența trăită necesară pentru a contextualiza aceste informații.

Pe măsură ce tehnologia continuă să evolueze, adevărata provocare nu va fi doar introducerea mai multor date în modele, ci și învățarea acestora a nuanțelor vieții umane . Până atunci, creierele noastre de siliciu vor continua să privească cu suspiciune cămările noastre, amintindu-ne că, oricât de avansate ar fi calculele lor, există încă o diferență profundă între procesarea unui dat și înțelegerea gustului vieții de zi cu zi.

Întrebări frecvente

Modelele lingvistice analizează datele chimice și toxicologice fără a avea experiență senzorială. Deoarece acest condiment conține miristicină, o substanță potențial toxică în cantități mari, algoritmii de siguranță blochează solicitările pentru a evita furnizarea de instrucțiuni dăunătoare. Lipsa contextului uman generează, așadar, un fals pozitiv.

Compusul organic responsabil pentru toxicitate este miristicina. Aceasta este un alcaloid care, dacă este ingerat în doze masive, acționează ca un puternic psihoactiv și poate provoca leziuni hepatice. Intoxicațiile accidentale în bucătărie sunt extrem de rare, deoarece condimentul este folosit doar în cantități minime pentru a da savoare mâncărurilor.

Consumul a zeci de grame din această mirodenie poate provoca reacții fizice și neurologice grave. Simptomele principale includ halucinații, tahicardie, greață puternică și, în cazurile clinice cele mai extreme, o adevărată intoxicație acută. Din acest motiv, bazele de date medicale o clasifică printre substanțele cu risc ridicat.

Sistemele de învățare automată sunt antrenate prin feedback uman pentru a nu genera conținut dăunător. Atunci când evaluatorii penalizează răspunsurile despre droguri sau otrăvuri, rețeaua neuronală asociază compușii chimici cu concepte de pericol. Acest mecanism de aliniere împiedică mașina să facă distincția între un uz culinar inofensiv și o doză letală.

A învăța mașinile că o substanță este inofensivă în cantități mici, dar letală în doze mari, necesită o înțelegere a lumii fizice mult prea complexă. Modelele matematice actuale se chinuie să proceseze această nuanță de bun simț. Prin urmare, din exces de prudență, preferă să blocheze complet informațiile despre ingredientele controversate.

Încă ai dubii despre Paradoxul IA: un condiment comun confundat cu otravă?

Tastați aici întrebarea dvs. specifică pentru a găsi instantaneu răspunsul oficial de la Google.

Ați găsit acest articol util? Există un alt subiect pe care ați dori să-l tratez?

Scrieți-l în comentariile de mai jos! Mă inspir direct din sugestiile voastre.