Când ne gândim la Inteligența Artificială, prima imagine care ne vine în minte este cea a unui calculator rece, capabil să proceseze trilioane de operațiuni pe secundă fără a comite vreo greșeală. Ne-am obișnuit să privim mașinăriile ca pe niște entități infailibile, construite tocmai pentru a compensa natura noastră umană, adesea neatentă și predispusă la erori. Cu toate acestea, dacă interacționezi suficient de mult cu cele mai noi sisteme tehnologice, vei observa un fenomen bizar: ele greșesc. Și nu vorbim despre erori de sistem catastrofale sau bug-uri de programare, ci despre ezitări, mici imperfecțiuni de limbaj, pauze nejustificate sau chiar decizii suboptime care par izbitor de umane. Această realitate ascunde unul dintre cele mai fascinante secrete ale ingineriei software moderne: eroarea calculată.

De ce ar petrece cercetătorii mii de ore și ar consuma resurse computaționale imense pentru a învăța un sistem perfect cum să fie imperfect? Răspunsul la această întrebare ne poartă adânc în arhitectura sistemelor de calcul modern, la intersecția dintre matematică pură, psihologie cognitivă și teoria jocurilor. Pentru a înțelege acest paradox, trebuie să demontăm modul în care funcționează cu adevărat „gândirea” sintetică.

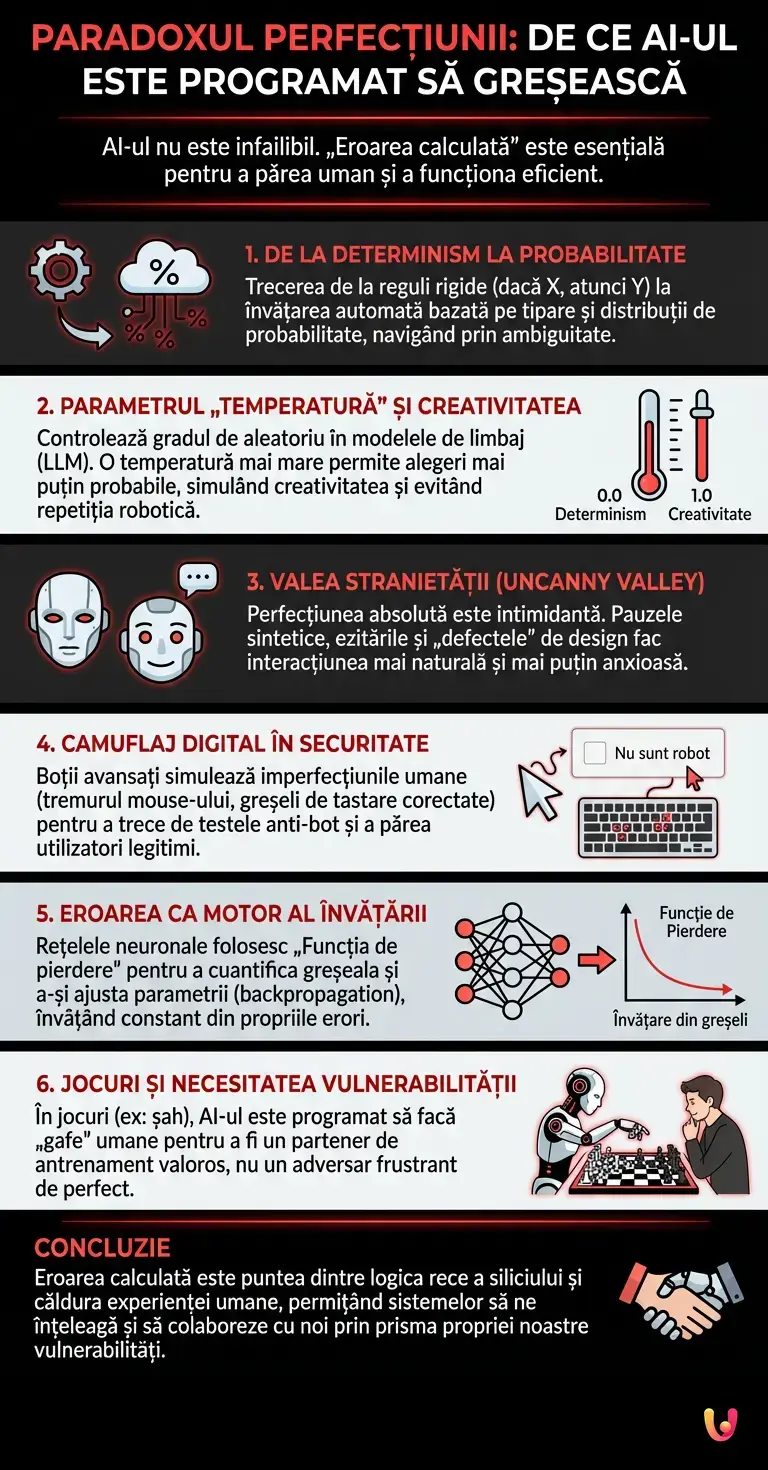

De la determinism la probabilitate: Noua paradigmă a calculatoarelor

În mod tradițional, programarea calculatoarelor s-a bazat pe un determinism strict. Un algoritm clasic urmează un set de reguli rigide de tipul „dacă X, atunci Y”. În acest univers binar, 1 plus 1 va fi întotdeauna 2, iar orice deviere de la această regulă este considerată o defecțiune critică. Totuși, această abordare rigidă s-a dovedit a fi insuficientă pentru a rezolva probleme complexe din lumea reală, cum ar fi recunoașterea vocală, traducerea limbilor sau generarea de text natural.

Aici intervine domeniul machine learning (învățarea automată). În loc să fie programate cu reguli explicite, sistemele moderne sunt antrenate pe cantități masive de date pentru a recunoaște tipare. Ele nu mai operează cu certitudini absolute, ci cu probabilități. Când un model de deep learning analizează o imagine pentru a decide dacă este o pisică sau un câine, el nu oferă un răspuns binar, ci o distribuție de probabilități (ex: 98% pisică, 2% câine). Această trecere de la certitudine la probabilitate este fundamentul pe care se construiește „eroarea” intenționată, permițând mașinii să navigheze prin ambiguitatea inerentă a lumii umane.

Parametrul „Temperatură” și iluzia creativității

Pentru a înțelege cum este injectată imperfecțiunea în sistemele de inteligență generativă, trebuie să privim sub capota unui LLM (Large Language Model), cum ar fi faimosul ChatGPT. Aceste modele funcționează, în esență, ca niște motoare de predicție extrem de sofisticate. Când generează o propoziție, ele nu „gândesc” fraza în ansamblu, ci calculează matematic care este cel mai probabil cuvânt (sau token) care ar trebui să urmeze după cuvântul anterior.

Dacă sistemul ar alege întotdeauna cuvântul cu probabilitatea maximă absolută (o abordare numită greedy decoding), rezultatul ar fi un text extrem de repetitiv, plat, robotic și lipsit de orice nuanță. Ar fi perfect din punct de vedere matematic, dar complet nefiresc pentru un cititor uman. Pentru a rezolva această problemă, inginerii au introdus un parametru tehnic numit „Temperatură”.

Temperatura controlează gradul de stocasticitate (aleatoriu) în procesul de selecție a cuvintelor. O temperatură de 0.0 înseamnă determinism pur – sistemul va alege mereu cel mai probabil cuvânt. Dar pe măsură ce temperatura crește (de exemplu, la 0.7 sau 1.0), algoritmul primește permisiunea de a alege cuvinte cu probabilități mai mici. Această deviere intenționată de la „alegerea perfectă” este ceea ce noi percepem drept creativitate, stil sau originalitate. Fără această eroare calculată la nivel matematic, poezia generată de IA, glumele sau eseurile ar fi doar o înșiruire mecanică de clișee statistice.

Valea Stranietății: De ce perfecțiunea ne înspăimântă

Dincolo de mecanica generării de text, există un motiv profund psihologic pentru care sistemele sunt programate să simuleze greșeli umane. În robotică și grafică pe calculator există un concept numit „Valea Stranietății” (Uncanny Valley). Acesta stipulează că, pe măsură ce o entitate artificială devine tot mai asemănătoare cu omul, dar nu este perfect umană, ea provoacă un sentiment de respingere, neliniște sau chiar groază observatorului uman.

Același principiu se aplică și în interacțiunile conversaționale. Un asistent virtual care răspunde instantaneu, cu o dicție impecabilă, folosind un vocabular de o complexitate extremă și fără nicio ezitare, este perceput ca fiind nenatural și intimidant. De aceea, dezvoltatorii de AI introduc intenționat elemente de fricțiune. Un chatbot de suport clienți ar putea fi programat să afișeze indicatorul „tastează…” timp de câteva secunde, deși a generat răspunsul în câteva milisecunde. Uneori, sistemele vocale avansate sunt antrenate să introducă pauze de respirație sintetice sau interjecții de tipul „ăăă” sau „hmm” înainte de a oferi o informație complexă.

Aceste „defecte” nu sunt limitări ale tehnologiei, ci decizii de design extrem de bine calculate. Ele au rolul de a reduce anxietatea utilizatorului, de a crea empatie și de a face interacțiunea om-mașină mult mai fluidă și mai acceptabilă din punct de vedere social.

Camuflajul digital: Supraviețuirea în era testelor anti-bot

Un alt domeniu fascinant în care eroarea este folosită ca armă este cel al securității cibernetice și al proceselor de automatizare. Pe măsură ce internetul a devenit saturat de boți, companiile au dezvoltat sisteme de securitate tot mai avansate pentru a distinge oamenii de mașini (cum ar fi testele CAPTCHA invizibile sau analiza comportamentală a utilizatorului).

Dacă un script de automatizare mișcă cursorul mouse-ului de la punctul A la punctul B într-o linie perfect dreaptă, cu o viteză constantă, sistemele de securitate îl vor bloca instantaneu. Oamenii nu mișcă mouse-ul perfect. Noi avem tremur inerent, accelerăm și încetinim neregulat, uneori depășim butonul pe care vrem să dăm click și revenim rapid asupra lui. Pentru a supraviețui în acest mediu ostil, noii algoritmi de navigare web sunt antrenați să simuleze zgomotul biomecanic uman.

Aceste sisteme folosesc ecuații matematice complexe (cum ar fi curbele Bézier cu perturbații aleatoare) pentru a genera mișcări intenționat imperfecte. Mai mult, în completarea formularelor online, boții avansați sunt programați să facă greșeli de tastare (typos) și apoi să folosească tasta Backspace pentru a le corecta, imitând perfect stângăcia umană. Aici, eroarea nu este doar o chestiune de estetică, ci o necesitate absolută pentru funcționalitatea sistemului.

Eroarea ca motor fundamental al învățării

Dacă privim și mai adânc, la nivelul arhitecturii de bază, vom descoperi că rețele neuronale artificiale nu ar putea exista fără conceptul de eroare. Procesul prin care un model de inteligență artificială învață se bazează pe o componentă matematică numită „Funcție de pierdere” (Loss Function). Această funcție măsoară, pur și simplu, cât de mult a greșit modelul în predicția sa comparativ cu rezultatul corect.

În timpul antrenamentului, rețeaua face o predicție, calculează eroarea, iar apoi folosește un algoritm numit backpropagation (propagarea înapoi) pentru a-și ajusta parametrii interni astfel încât, la următoarea încercare, eroarea să fie puțin mai mică. Fără capacitatea de a greși și de a cuantifica acea greșeală, învățarea automată ar fi imposibilă. Eroarea nu este un efect secundar nedorit, ci însăși busola care ghidează sistemul către performanță. Într-un mod poetic, mașinile învață exact la fel ca oamenii: din propriile greșeli.

Jocurile și necesitatea vulnerabilității

Un exemplu clasic al necesității erorii calculate se regăsește în industria jocurilor video și a șahului computerizat. Motoarele de șah moderne, precum Stockfish, sunt capabile să învingă orice campion mondial uman fără niciun efort. Totuși, a juca împotriva unei entități care nu greșește niciodată este o experiență frustrantă și lipsită de sens pentru un om.

Pentru a rezolva această problemă, cercetătorii au creat modele precum Maia Chess, o inteligență artificială antrenată nu pentru a găsi mutarea perfectă, ci pentru a prezice mutarea pe care ar face-o un om de un anumit nivel. Maia este programată intenționat să facă „gafe” umane, să rateze tactici subtile și să cadă în capcane, exact așa cum ar face un jucător uman cu un rating Elo similar. Prin introducerea erorii calculate, tehnologia devine un partener de antrenament valoros, în loc să fie un tiran invincibil.

Concluzie

Paradoxul sistemelor perfecte care generează intenționat greșeli umane ne dezvăluie o perspectivă profundă asupra modului în care ne raportăm la tehnologie. Pe măsură ce avansăm în era digitală, am realizat că perfecțiunea matematică absolută este sterilă, inadaptabilă și adesea incompatibilă cu natura organică, haotică și nuanțată a lumii noastre. Fie că este vorba despre parametrul de temperatură care dă viață textelor generate, despre pauzele de respirație simulate pentru a ne oferi confort psihologic, sau despre mișcările ezitante ale unui cursor pe ecran, eroarea calculată este puntea de legătură dintre logica rece a siliciului și căldura experienței umane.

Inginerii nu construiesc mașinării care să ne înlocuiască prin perfecțiune, ci sisteme care să ne înțeleagă și să colaboreze cu noi prin prisma propriei noastre vulnerabilități. În cele din urmă, cel mai mare triumf al inteligenței artificiale nu este capacitatea sa de a fi infailibilă, ci abilitatea sa extraordinară de a învăța cum să fie, măcar un pic, imperfectă.

Frequently Asked Questions

Sistemele moderne sunt adesea programate să facă erori calculate pentru a părea mai umane și pentru a rezolva probleme complexe din lumea reală. Această abordare elimină rigiditatea matematică absolută, permițând algoritmilor să fie creativi și să ofere interacțiuni mult mai naturale. Fără aceste mici imperfecțiuni simulate, tehnologia ar fi percepută ca fiind prea robotică, rece și incapabilă să se adapteze la ambiguitatea inerentă a comunicării umane.

Temperatura este o setare tehnică esențială prin care se controlează gradul de creativitate și imprevizibilitate al unui text generat automat. O valoare apropiată de zero produce răspunsuri strict deterministe și repetitive, alegând mereu cel mai probabil cuvânt. În schimb, o valoare mai ridicată permite algoritmului să selecteze termeni cu probabilități mai mici, generând astfel un conținut original, nuanțat și mult mai plăcut pentru un cititor uman.

Acest concept psihologic arată că entitățile artificiale care arată și se comportă aproape ca un om, dar sunt lipsite de orice imperfecțiune, ne provoacă un sentiment profund de neliniște sau respingere. Pentru a preveni această senzație de disconfort, dezvoltatorii adaugă intenționat ezitări, pauze de respirație sintetice sau timpi falși de tastare. Aceste defecte simulate fac interacțiunea mult mai acceptabilă din punct de vedere social și reduc anxietatea utilizatorului.

Algoritmii avansați de navigare folosesc ecuații matematice complexe pentru a simula comportamentul uman imperfect și a trece de filtrele de securitate. Ei imită tremurul natural al mâinii atunci când mișcă mouse-ul pe ecran, fac greșeli de tastare pe care apoi le corectează manual și variază constant viteza de reacție. Prin acest camuflaj digital bazat pe stângăcia umană, boții reușesc să pară utilizatori legitimi și să evite blocarea.

Această componentă matematică fundamentală măsoară diferența exactă dintre predicția sistemului și rezultatul corect dorit în timpul fazei de antrenament. Prin evaluarea constantă a acestor abateri, rețeaua neuronală își ajustează parametrii interni pentru a-și îmbunătăți performanța la următoarea încercare. Astfel, capacitatea de a greși și de a cuantifica acea eroare devine busola principală care ghidează întreaga evoluție a inteligenței artificiale către o precizie tot mai mare.

Surse și Aprofundare

- Valea stranietății (Uncanny Valley) – Analiza IEEE privind paradoxul perfecțiunii în interacțiunea om-mașină

- Arhitectura și funcționarea Modelelor de Limbaj Mari (LLM) și generarea probabilistică

- Învățarea automată (Machine Learning) – Fundamente și tranziția de la algoritmi determiniști

- Cercetări și standarde guvernamentale privind comportamentul și riscurile Inteligenței Artificiale (NIST – Guvernul SUA)

Ați găsit acest articol util? Există un alt subiect pe care ați dori să-l tratez?

Scrieți-l în comentariile de mai jos! Mă inspir direct din sugestiile voastre.