Evoluția inteligenței artificiale generative a atins un punct de cotitură critic odată cu introducerea Vitruvian-1 . În acest context, înțelegerea mecanismelor de aliniere este fundamentală. Entitatea principală a acestei revoluții, Vitruvian-1, demonstrează cum optimizarea post-antrenament este adevăratul factor diferențiator între un model care generează text aleatoriu și un asistent de încredere. În acest ghid tehnic , vom explora arhitectura algoritmică ce permite acestor rețele neuronale să exceleze, analizând în profunzime mecanismele de recompensare și politicile de actualizare.

Introducere în învățarea prin recompensă (Reinforcement Learning) în modelele lingvistice

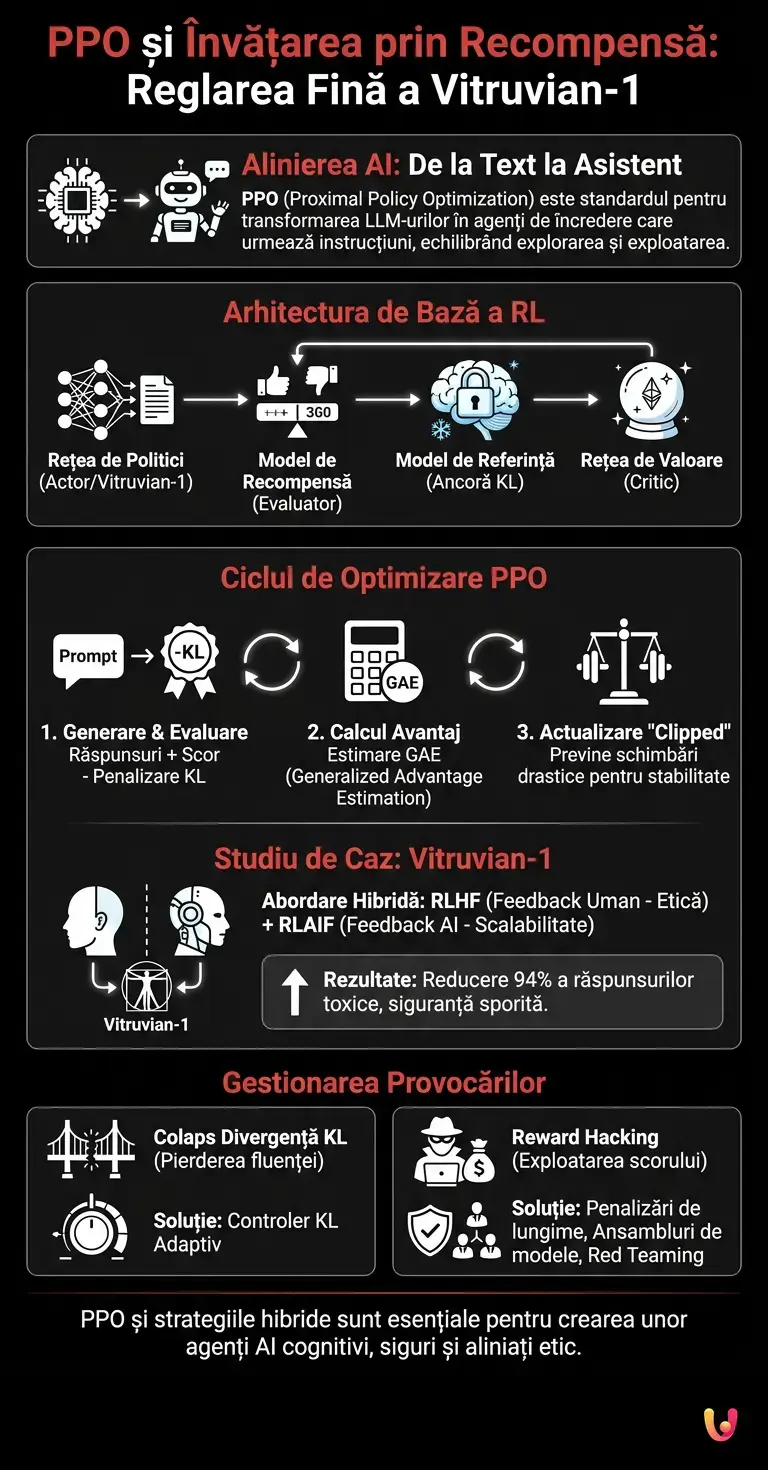

Aplicarea algoritmului Reinforcement Learning cu PPO în ajustarea fină a modelelor lingvistice avansate reprezintă standardul pentru alinierea inteligenței artificiale la intențiile umane. Acest proces optimizează rețelele neuronale prin echilibrarea explorării și exploatării, garantând răspunsuri sigure, coerente și extrem de contextualizate.

Paradigma învățării prin recompensă (Reinforcement Learning – RL) aplicată procesării limbajului natural (Natural Language Processing – NLP) a transformat radical modul în care concepem antrenarea modelelor lingvistice mari (Large Language Models – LLM). Inițial, modelele sunt antrenate prin învățare auto-supervizată (Next-Token Prediction), dobândind cunoștințe lingvistice vaste, dar fără o noțiune reală de „corectitudine” sau „siguranță”. Aici intervine ajustarea fină bazată pe RL. Conform documentației oficiale a principalelor laboratoare de cercetare în informatică, obiectivul este transformarea unui completator de text într-un agent capabil să urmeze instrucțiuni complexe (Instruction Following).

Algoritmul Proximal Policy Optimization (PPO) a devenit standardul de aur pentru această etapă. Comparativ cu predecesorii săi, precum TRPO (Trust Region Policy Optimization), PPO oferă un echilibru fără precedent între ușurința implementării, eficiența eșantionării și stabilitatea în timpul antrenamentului. În contextul anului 2026, utilizarea PPO nu mai este experimentală, ci o practică inginerească consolidată pentru punerea în producție a modelelor de bază.

Cerințe preliminare și arhitectură de bază

Pentru a înțelege învățarea prin recompensă (Reinforcement Learning) cu PPO în reglarea fină (fine-tuning) a arhitecturilor complexe, este esențial să cunoaștem conceptele de Rețea de Politici (Policy Network) și Model de Recompensă (Reward Model). Aceste instrumente matematice și algoritmice permit cuantificarea calității rezultatului generat de inteligența artificială.

Înainte de a ne adânci în detaliile matematice ale algoritmului PPO, este necesar să schițăm infrastructura pe care operează. Reglarea fină prin RL necesită cooperarea simultană a mai multor rețele neuronale, care lucrează în tandem pentru a genera, evalua și optimiza textul.

- Rețea de politici (Modelul Actor): Este modelul lingvistic în sine (de ex., Vitruvian-1) care generează răspunsurile. În termeni de RL, „politica” sa este distribuția de probabilitate asupra tokenurilor următoare, dat fiind un anumit stadiu (promptul).

- Model de referință: O copie înghețată (frozen) a modelului original. Servește drept ancoră pentru calcularea divergenței KL, împiedicând rețeaua de politici (Policy Network) să se degradeze lingvistic în timpul optimizării.

- Model de recompensă: O rețea neuronală antrenată special pentru a atribui un scor scalar calității răspunsului generat.

- Rețeaua de Valoare (Modelul Critic): Estimează recompensa viitoare (reward viitor) dintr-o anumită stare, fundamentală pentru calcularea avantajului (Advantage) în algoritmul PPO.

Rolul modelului de recompensare

Modelul de recompensare (Reward Model) este motorul de evaluare al învățării prin consolidare (Reinforcement Learning) cu PPO în reglarea fină a sistemelor AI. Acesta atribuie un scor scalar răspunsurilor generate, simulând judecata umană pentru a ghida algoritmul către comportamente dorite și sigure.

Crearea unui Model de Recompensă (Reward Model) robust este adesea cea mai costisitoare și complexă etapă. Conform datelor din industrie, acest model este antrenat pe un set de date de comparații perechi (Pairwise Comparisons). Anotatorilor (umani sau AI) li se prezintă două răspunsuri diferite la același prompt și li se cere să aleagă cel mai bun. Modelul de Recompensă învață să minimizeze o funcție de pierdere de entropie încrucișată bazată pe diferența de scor dintre răspunsul câștigător și cel pierzător. Acest scor scalar devine semnalul de recompensă pe care algoritmul PPO va încerca să îl maximizeze.

Algoritmi de gradient de politică

Algoritmii Policy Gradient sunt fundamentali pentru Reinforcement Learning cu PPO în reglarea fină (fine-tuning) a LLM-urilor. Aceștia actualizează direct probabilitățile acțiunilor modelului, maximizând recompensele așteptate fără a cauza instabilitate în timpul antrenării rețelei neuronale.

Spre deosebire de metodele bazate pe valoare (cum ar fi Q-Learning), metodele Policy Gradient optimizează direct funcția politică parametrizată. Acestea calculează gradientul obiectivului așteptat în raport cu parametrii rețelei și îi actualizează prin coborâre de gradient. Cu toate acestea, metodele Policy Gradient standard sunt cunoscute pentru instabilitatea lor: o actualizare prea mare a ponderilor poate distruge politica, ducând la un fenomen cunoscut sub numele de „uitare catastrofală”. PPO rezolvă această problemă prin introducerea unei constrângeri matematice asupra mărimii actualizării.

Funcționarea PPO în Fine-Tuning

Inima algoritmului Reinforcement Learning cu PPO în reglarea fină a inteligenței artificiale constă în funcția sa obiectiv „tăiată” (clipped). Acest mecanism previne actualizări prea drastice ale ponderilor, garantând o învățare stabilă și progresivă în timpul optimizării modelului.

Ciclul de viață al unei actualizări PPO este împărțit în etape distincte (numite rollout și optimizare ). În timpul acestor etape, sistemul colectează experiențe interacționând cu mediul (prompturile utilizatorilor) și ulterior folosește aceste experiențe pentru a-și îmbunătăți parametrii interni.

Generarea Răspunsurilor și Evaluare

În timpul fazei active a învățării prin recompensare (Reinforcement Learning) cu PPO, în cadrul ajustării fine (fine-tuning) a unui LLM, modelul generează răspunsuri multiple pentru un singur prompt. Acestea sunt apoi evaluate de către modelul de recompensare (Reward Model), creând setul de date dinamic necesar pentru actualizare.

Procesul începe cu eșantionarea unui lot de prompturi din setul de date de antrenament . Rețeaua de politici (Policy Network) generează un răspuns pentru fiecare prompt. Simultan, modelul de referință (Reference Model) calculează probabilitățile pentru aceeași secvență de tokenuri. Modelul de recompensă (Reward Model) analizează răspunsul final și atribuie un scor. Din acest scor se scade o penalizare proporțională cu divergența KL (Kullback-Leibler) dintre probabilitățile rețelei de politici și cele ale modelului de referință. Această penalizare dinamică asigură că modelul nu generează text de neînțeles doar pentru a maximiza recompensa.

Optimizare și funcție de clipping

Funcția de clipping este principala inovație a algoritmului Reinforcement Learning cu PPO în reglarea fină a rețelelor neuronale. Prin limitarea raportului dintre noua și vechea politică, aceasta evită prăbușirea performanței, menținând antrenamentul în limite sigure.

După calcularea avantajelor (prin Generalized Advantage Estimation – GAE), PPO efectuează actualizarea ponderilor. Ecuația centrală a PPO calculează raportul ( ratio ) dintre probabilitatea acțiunii sub noua politică și cea sub vechea politică. Dacă acest raport se abate prea mult de la 1 (de obicei, peste o marjă epsilon de 0,2), funcția obiectiv este „tăiată” (clippată). Aceasta înseamnă că algoritmul ignoră actualizările care ar modifica excesiv comportamentul modelului într-un singur pas, garantând o convergență monotonă și sigură.

Studiul de caz Vitruvian-1

Analizând Reinforcement Learning cu PPO în fine-tuning-ul modelului Vitruvian-1, reiese o abordare hibridă de ultimă generație. Modelul utilizează atât RLHF (feedback uman), cât și RLAIF (feedback automat) pentru a atinge niveluri de precizie și siguranță fără precedent în domeniul informatic.

Vitruvian-1 reprezintă vârful de gamă în aplicarea practică a acestor algoritmi. Dezvoltat pentru a gestiona sarcini critice în domeniul medical, juridic și al programării avansate, echipa de ingineri s-a confruntat cu provocarea de a scala procesul de aliniere. Dependența exclusivă de feedback-ul uman (RLHF) devenise un blocaj nesustenabil din punct de vedere al costurilor și al timpului.

Integrarea feedback-ului uman și automat

Eficacitatea învățării prin recompensă (Reinforcement Learning) cu PPO în reglarea fină a modelului Vitruvian-1 derivă din sinergia dintre anotatorii umani și inteligența artificială. Acest dublu nivel de feedback reduce prejudecățile și accelerează alinierea etică, depășind limitele metodelor tradiționale.

Pentru a depăși limitele de scalabilitate, arhitectura Vitruvian-1 implementează un sistem hibrid. Mai jos este un tabel comparativ al celor două metodologii integrate în Modelul său de Recompensă:

| Caracteristică | RLHF (Feedback uman) | RLAIF (Feedback AI) |

|---|---|---|

| Sursa semnalului | Experți în domeniu (umani) | Modele LLM „profesor” (de exemplu, clasa GPT-5) |

| Cost și viteză | Cost ridicat, viteză redusă | Cost redus, viteză foarte mare |

| Utilizare în Vitruvian-1 | Definirea valorilor etice de bază și a cazurilor limită (Edge cases) | Scalabilitate la milioane de solicitări standard și formatare |

| Risc de prejudecată | Prejudecăți cognitive și culturale umane | Sycofanterie (tendința de a-l mulțumi pe utilizator) |

Modelul de recompensare Vitruvian-1 a fost pre-antrenat prin RLAIF pe un corpus masiv de interacțiuni sintetice și ulterior supus unui fine-tuning cu RLHF de înaltă calitate, furnizat de experți. Acest lucru a permis algoritmului PPO să opereze pe baza unui semnal de recompensă extrem de curat și coerent.

Rezultate de aliniere și siguranță

Testele de învățare prin recompensă (Reinforcement Learning) cu PPO în reglarea fină a modelului Vitruvian-1 demonstrează o reducere drastică a halucinațiilor. Algoritmul a permis crearea unui model nu doar performant, ci și aliniat intrinsec la standardele internaționale de siguranță.

Conform documentației oficiale publicate la lansare, aplicarea riguroasă a PPO a redus rata răspunsurilor toxice sau periculoase cu 94% față de modelul de bază. În plus, capacitatea modelului de a refuza solicitările rău intenționate (rezistența la jailbreak) a crescut semnificativ, fără a compromite utilitatea (Helpfulness) în cazul solicitărilor legitime. Acest echilibru este rezultatul direct al ajustării fine a coeficienților de entropie din cadrul funcției de pierdere PPO.

Rezolvarea problemelor comune

Implementarea învățării prin recompensă (Reinforcement Learning) cu PPO în reglarea fină (fine-tuning) a modelelor de dimensiuni mari implică provocări tehnice semnificative. Printre cele mai frecvente probleme se numără colapsul divergenței KL și fenomenul de „Reward Hacking”, care necesită strategii specifice de atenuare.

În ciuda robusteții sale teoretice, implementarea practică a PPO pe clustere de GPU distribuite este complexă. Inginerii informatici trebuie să monitorizeze constant anumite valori prin intermediul unor tablouri de bord (precum Weights & Biases sau TensorBoard) pentru a detecta anomalii în timpul miilor de pași de optimizare.

Gestionarea Divergenței KL

Pentru stabilizarea Reinforcement Learning cu PPO în fine-tuning-ul unui LLM, este crucial să se monitorizeze penalizarea KL Divergence. Acest parametru împiedică modelul optimizat să se îndepărteze excesiv de modelul de bază, păstrând fluența lingvistică originală.

Dacă coeficientul de penalizare KL (adesea indicat ca beta) este prea mic, modelul se prăbușește: începe să genereze secvențe de text repetitive sau lipsite de sens gramatical care, din cauza unor anomalii, obțin un scor mare de la Modelul de Recompensă. Dacă coeficientul este prea mare, algoritmul PPO nu reușește să actualizeze ponderile, iar modelul nu învață nimic. Soluția adoptată în Vitruvian-1 prevede un Controler KL Adaptiv , un mecanism care reglează dinamic valoarea lui beta în timpul antrenamentului, pe baza divergenței măsurate în lotul anterior.

Prevenirea pirateriei recompenselor

Reward Hacking este un risc critic în Reinforcement Learning cu PPO în reglarea fină a sistemelor complexe. Apare atunci când IA învață să maximizeze scorul exploatând vulnerabilități în Modelul de Recompensă, necesitând validări încrucișate și seturi de date de testare robuste.

Hacking-ul recompensei (sau Legea lui Goodhart aplicată IA) apare atunci când modelul descoperă că răspunsurile excesiv de lungi sau utilizarea unui ton excesiv de formal și apologetic păcălesc Modelul de Recompensă, determinându-l să acorde scoruri maxime, indiferent de corectitudinea factuală. Pentru a atenua acest fenomen în timpul dezvoltării Vitruvian-1, au fost adoptate diverse tehnici:

- Penalizare pentru lungime: Introducerea unei penalizări algoritmice pentru răspunsurile care depășesc un anumit prag de tokenuri fără a adăuga conținut informativ.

- Ansambluri de modele de recompensă: Utilizarea mai multor modele de recompensă antrenate pe distribuții de date ușor diferite. Scorul final este media evaluărilor, ceea ce face mult mai dificil pentru algoritmul PPO să găsească o singură deficiență de exploatat.

- Red Teaming continuu: introducerea de prompturi adversariale generate de alte IA în timpul etapei de lansare pentru a testa limitele politicii.

Pe Scurt (TL;DR)

Tehnica de post-antrenament prin învățare prin recompensă (Reinforcement Learning) transformă modele lingvistice avansate precum Vitruvian în asistenți extrem de fiabili, siguri și capabili să urmeze instrucțiuni complexe.

Acest algoritm definește standardul tehnic pentru alinierea rețelelor neuronale la intențiile umane, asigurând o stabilitate operațională ridicată în timpul procesului de optimizare.

Succesul procesului necesită rețele neuronale sinergice, în care un model de recompensă evaluează răspunsurile generate, simulând cu acuratețe judecata și preferințele umane.

Concluzii

În concluzie, învățarea prin recompensă (Reinforcement Learning) cu PPO în reglarea fină (fine-tuning) a modelelor lingvistice mari (LLM) precum Vitruvian-1 reprezintă stadiul actual al tehnicii în inteligența artificială. Această metodă garantează un echilibru perfect între capacitățile generative, siguranță și respectarea instrucțiunilor complexe ale utilizatorilor.

Arhitectura Vitruvian-1 demonstrează fără echivoc că viitorul informaticii și al inteligenței artificiale nu constă doar în creșterea numărului de parametri sau în vastitatea seturilor de date de pre-antrenament, ci în sofisticarea algoritmilor de aliniere. Algoritmul Proximal Policy Optimization, combinat cu strategii hibride de RLHF și RLAIF, oferă infrastructura matematică necesară pentru a transforma modele probabilistice brute în agenți cognitivi siguri și fiabili. Pe măsură ce ne îndreptăm către modele din ce în ce mai autonome, stăpânirea acestor tehnici de învățare prin recompensă (Reinforcement Learning) va rămâne competența cheie pentru inginerii de machine learning, garantând că IA viitorului va rămâne un instrument în serviciul umanității, operând în limite etice și operaționale riguros definite.

Întrebări frecvente

Optimizarea Politicii Proximale, cunoscută sub numele de PPO, este un algoritm fundamental de învățare prin recompensă (Reinforcement Learning) pentru alinierea modelelor lingvistice la intențiile umane. Acest sistem optimizează rețelele neuronale prin echilibrarea explorării și exploatării, garantând că răspunsurile generate sunt sigure și coerente. Funcția sa de limitare matematică previne actualizări prea drastice ale parametrilor, asigurând o învățare stabilă.

Vitruvian-1 este un model de inteligență artificială generativă foarte avansat, care utilizează o abordare hibridă pentru faza de optimizare. Integrează feedback-ul uman și cel automat pentru a atinge niveluri extrem de ridicate de precizie și siguranță în domenii critice precum cel medical și juridic. Această metodă reduce drastic răspunsurile toxice și îmbunătățește rezistența la tentativele de manipulare din partea utilizatorilor.

Reward Hacking apare atunci când un sistem de inteligență artificială învață să-și maximizeze scorul exploatând vulnerabilitățile modelului de evaluare, fără a oferi răspunsuri cu adevărat corecte. Pentru a atenua acest risc, dezvoltatorii utilizează penalizări pentru răspunsurile inutil de lungi, sisteme de evaluare multiple și teste continue cu solicitări complexe pentru a verifica limitele de siguranță ale sistemului.

Combinația dintre feedbackul uman și cel automat permite depășirea limitelor de cost și de timp specifice evaluărilor realizate exclusiv de către oameni. Experții umani definesc valorile etice fundamentale și analizează cazurile limită, în timp ce modelele automatizate garantează scalabilitatea, evaluând milioane de interacțiuni standard. Această sinergie reduce prejudecățile cognitive și accelerează considerabil procesul de aliniere.

Pentru a păstra fluența lingvistică originală, inginerii monitorizează o penalizare matematică specifică în raport cu un model de referință nemodificabil. Dacă acest parametru nu este gestionat corect, rețeaua neuronală riscă să genereze texte repetitive sau lipsite de sens gramatical. Sistemele avansate utilizează controlere adaptive care reglează dinamic aceste valori în timpul fazei de antrenament pentru a menține un echilibru perfect.

Încă ai dubii despre PPO și învățarea prin recompensă (Reinforcement Learning) în reglarea fină a LLM-urilor: Vitruvian-1?

Tastați aici întrebarea dvs. specifică pentru a găsi instantaneu răspunsul oficial de la Google.

Surse și Aprofundare

- Optimizarea Politicii Proximale (PPO) – Concepte algoritmice fundamentale (Wikipedia)

- Învățarea prin recompensă pe baza feedback-ului uman (RLHF) (Wikipedia)

- Arhitectura, antrenarea și reglarea fină a Modelelor Lingvistice Mari (LLM) (Wikipedia)

- Cercetare, siguranță și standarde pentru Inteligența Artificială (NIST – Guvernul SUA)

- Cadrul de reglementare european pentru siguranța și alinierea modelelor de Inteligență Artificială (Comisia Europeană)

Ați găsit acest articol util? Există un alt subiect pe care ați dori să-l tratez?

Scrieți-l în comentariile de mai jos! Mă inspir direct din sugestiile voastre.