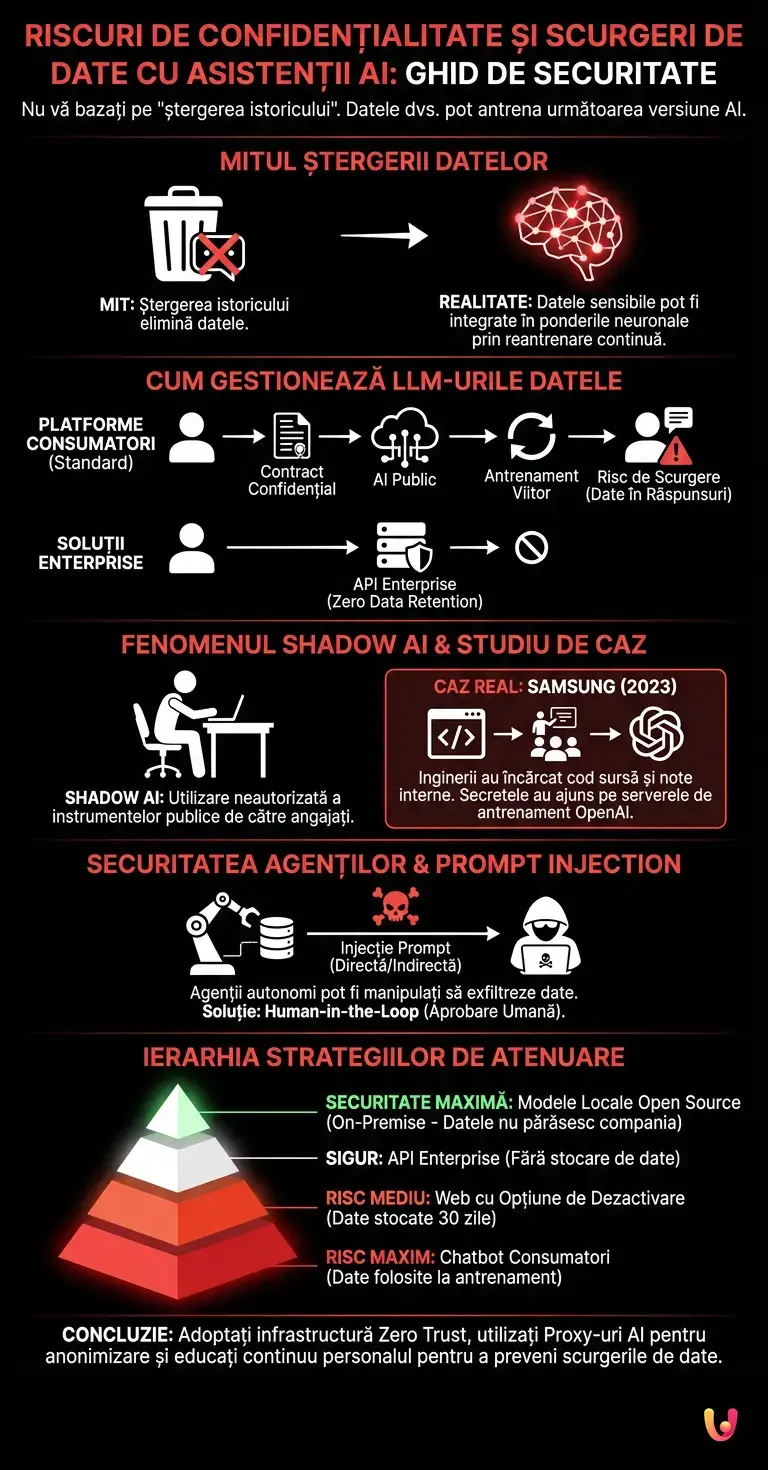

Cel mai periculos mit fals despre confidențialitatea inteligenței artificiale este credința că ștergerea istoricului unei conversații elimină datele furnizate. În realitate, dacă o informație sensibilă este procesată de un model generativ fără protecțiile corporative adecvate, aceasta poate fi integrată în ponderile neuronale ale sistemului în timpul etapelor de ajustare fină sau învățare continuă. Ștergerea elimină doar interfața vizuală pentru utilizator, dar riscul de scurgere a datelor rămâne permanent, expunând secrete industriale oricui știe să formuleze promptul corect.

Selectați tipul de date și modelul utilizat pentru a evalua riscul de expunere a informațiilor.

Cum gestionează modelele lingvistice datele sensibile

Când se analizează confidențialitatea în contextul inteligenței artificiale , este esențial să se înțeleagă că modelele lingvistice nu „uită” ușor . Datele introduse în prompturi pot fi folosite pentru reantrenare continuă, expunând informațiile companiei utilizatorilor externi în sesiuni viitoare și compromițând confidențialitatea.

Modelele lingvistice mari (LLM), precum GPT-4, Claude sau Gemini, funcționează în două etape distincte: antrenamentul (training) și inferența (generarea răspunsului). Problema apare atunci când platformele destinate consumatorilor utilizează datele de inferență pentru a alimenta ciclurile ulterioare de antrenament. Conform documentației oficiale OpenAI, conversațiile purtate prin intermediul interfeței web standard (fără dezactivarea opțiunii) pot fi revizuite de moderatori umani și utilizate pentru îmbunătățirea modelului.

Aceasta înseamnă că, dacă un utilizator introduce un contract confidențial pentru a solicita un rezumat, fragmente din acel contract ar putea apărea ca rezultat dacă un alt utilizator, din altă parte a lumii, formulează o interogare corelată statistic. Prin urmare, gestionarea datelor sensibile necesită o trecere obligatorie la soluții Enterprise care garantează contractual păstrarea zero a datelor (Zero Data Retention ).

Fenomenul scurgerii de date în companii

Scurgerea de date legată de confidențialitatea inteligenței artificiale are loc atunci când angajații lipesc cod sursă, date financiare sau informații despre clienți în chatboți publici. Acest lucru transformă instrumentele de productivitate în breșe grave de securitate pentru întreaga infrastructură IT.

Fenomenul Shadow AI (utilizarea neautorizată a instrumentelor de inteligență artificială de către angajați) este în prezent principala cauză a scurgerilor de date. Angajații, determinați de nevoia de a-și optimiza munca, ocolesc controalele IT, oferind algoritmilor informații protejate de acorduri de confidențialitate (NDA – Non-Disclosure Agreement).

Studiu de caz real: Scurgerea de date de la Samsung (2023)

În primăvara anului 2023, divizia de semiconductori a Samsung a înregistrat trei incidente distincte de securitate în mai puțin de o lună. Inginerii companiei au încărcat cod sursă proprietar și înregistrări ale unor ședințe interne pe platforma ChatGPT pentru a identifica erori și a genera rapoarte. Deoarece utilizarea se făcea prin intermediul interfeței pentru consumatori, secretele industriale ale Samsung au ajuns pe serverele de antrenament ale OpenAI, obligând compania sud-coreeană să interzică temporar utilizarea inteligenței artificiale generative pe dispozitivele companiei.

Securitatea agenților și vulnerabilitățile prompturilor

Securitatea agenților reprezintă noua frontieră a confidențialității în domeniul inteligenței artificiale . Atunci când agenții AI operează autonom, accesând baze de date corporative, riscul extragerii neautorizate de date prin injecție de prompturi crește exponențial.

Odată cu evoluția de la IA conversațională la IA agentică (sisteme capabile să execute acțiuni, să citească e-mailuri, să interogheze baze de date și să trimită mesaje), perimetrul de securitate s-a extins. Un atacator nu mai trebuie să violeze un server; îi este suficient să manipuleze agentul AI.

- Injecție directă de prompt: Utilizatorul rău intenționat furnizează instrucțiuni care suprascriu directivele de sistem ale IA , obligând-o să dezvăluie date sensibile prezente în contextul său.

- Injecție indirectă de prompt: Agentul AI citește un document extern (de exemplu, o pagină web sau un e-mail) care conține instrucțiuni malițioase ascunse. IA execută aceste instrucțiuni fără știrea utilizatorului, putând potențial exfiltra date private către servere externe.

Pentru a garanta siguranța agenților , este esențial să se implementeze arhitecturi Human-in-the-Loop (HITL), în care acțiunile critice necesită întotdeauna aprobarea umană, și să se izoleze mediile de execuție ale agenților (sandboxing).

Strategii de atenuare și configurații sigure

Pentru a garanta o protecție solidă a vieții private în domeniul inteligenței artificiale , companiile trebuie să adopte politici stricte. Utilizarea API-urilor cu acorduri de neantrenare și implementarea filtrelor DLP (Data Loss Prevention) sunt pași tehnici obligatorii pentru atenuarea riscurilor.

Prevenirea scurgerilor de date necesită o abordare pe mai multe niveluri. Nu este suficient să se blocheze adresele URL ale chatbot-urilor la nivel de firewall, deoarece alternativele proliferează zilnic. Este necesară implementarea unor soluții structurale:

| Abordare | Nivel de securitate | Impact asupra confidențialității |

|---|---|---|

| Chatbot Web pentru Consumatori | Jos | Date folosite pentru antrenament. Risc ridicat de scurgeri. |

| Chatbot web cu opțiune de dezactivare | Mediu | Datele nu antrenează modelul, dar rămân pe servere timp de 30 de zile. |

| Acces prin API (Enterprise) | Înalt | Fără stocare de date. Datele nu sunt stocate și nici utilizate. |

| Modele Open Source Locale (de ex., LLaMA) | Maxim | Datele nu părăsesc niciodată infrastructura companiei (On-Premise). |

În plus, adoptarea proxy-urilor AI la nivel de companie permite interceptarea solicitărilor angajaților, anonimizarea datelor sensibile (cum ar fi numerele cardurilor de credit sau codurile fiscale) înainte ca acestea să ajungă în cloud-ul LLM-ului și menținerea unui jurnal de audit complet pentru conformitatea cu GDPR.

Concluzii

Gestionarea confidențialității în contextul inteligenței artificiale nu poate fi delegată bunului simț al utilizatorilor individuali. Așa cum am analizat, utilizarea zilnică a modelelor generative expune organizațiile la riscuri concrete de scurgeri de date și vulnerabilități legate de securitatea agenților. Trecerea către o utilizare conștientă a IA necesită abandonarea instrumentelor destinate consumatorilor în mediul de lucru în favoarea soluțiilor Enterprise, a API-urilor securizate sau a modelelor executate local. Doar printr-o infrastructură Zero Trust aplicată prompturilor și prin educația continuă a personalului este posibilă valorificarea potențialului enorm al informaticii generative fără a compromite patrimoniul informațional al companiei.

Întrebări frecvente

Pentru a proteja informațiile sensibile, este esențial să se evite versiunile publice ale chatbot-urilor. Companiile ar trebui să adopte soluții de nivel enterprise cu garanție de conservare a datelor egală cu zero, să utilizeze modele open source instalate pe propriile servere locale sau să implementeze filtre de prevenție pentru a bloca transmiterea informațiilor confidențiale. Doar o abordare structurată garantează securitatea totală.

Ștergerea conversațiilor elimină doar vizualizarea conversației pentru utilizatorul serviciului, dar nu șterge informațiile de pe serverele furnizorului. Dacă datele au fost procesate de un model fără protecții corporative, este posibil ca acestea să fi fost deja integrate în ponderile neuronale ale sistemului în timpul fazei de antrenament continuu. Aceasta înseamnă că secretele industriale rămân potențial accesibile altor persoane în sesiuni viitoare.

Acest termen indică utilizarea neautorizată a instrumentelor generative de către personalul companiei, fără acordul departamentului IT. Reprezintă o amenințare gravă, deoarece angajații, în încercarea de a-și accelera sarcinile zilnice, ar putea introduce contracte, cod sursă sau date ale clienților pe platforme publice. Acest comportament transformă instrumente utile în breșe grave de securitate pentru întreaga rețea informatică.

Agenții autonomi care accesează baze de date sau citesc e-mailuri pot fi ținta unor atacuri cibernetice prin intermediul unor instrucțiuni malițioase ascunse în documente externe. Un atacator poate forța sistemul să ignore directivele de securitate și să exfiltreze documente private către servere neautorizate. Pentru a atenua acest risc, este absolut necesară supravegherea umană pentru a aproba fiecare operațiune critică.

Respectarea reglementărilor impune adoptarea unor server proxy la nivel de companie, capabile să anonimizeze datele personale înainte de a ajunge pe serverele la distanță. De asemenea, este necesar să se încheie acorduri precise cu furnizorii pentru a împiedica utilizarea datelor introduse în faza de antrenament. În cele din urmă, companiile trebuie să păstreze jurnale de control complete pentru a demonstra conformitatea deplină cu legile în vigoare privind protecția datelor.

Încă ai dubii despre Riscuri de confidențialitate și scurgeri de date cu asistenții AI: Ghid de securitate?

Tastați aici întrebarea dvs. specifică pentru a găsi instantaneu răspunsul oficial de la Google.

Ați găsit acest articol util? Există un alt subiect pe care ați dori să-l tratez?

Scrieți-l în comentariile de mai jos! Mă inspir direct din sugestiile voastre.