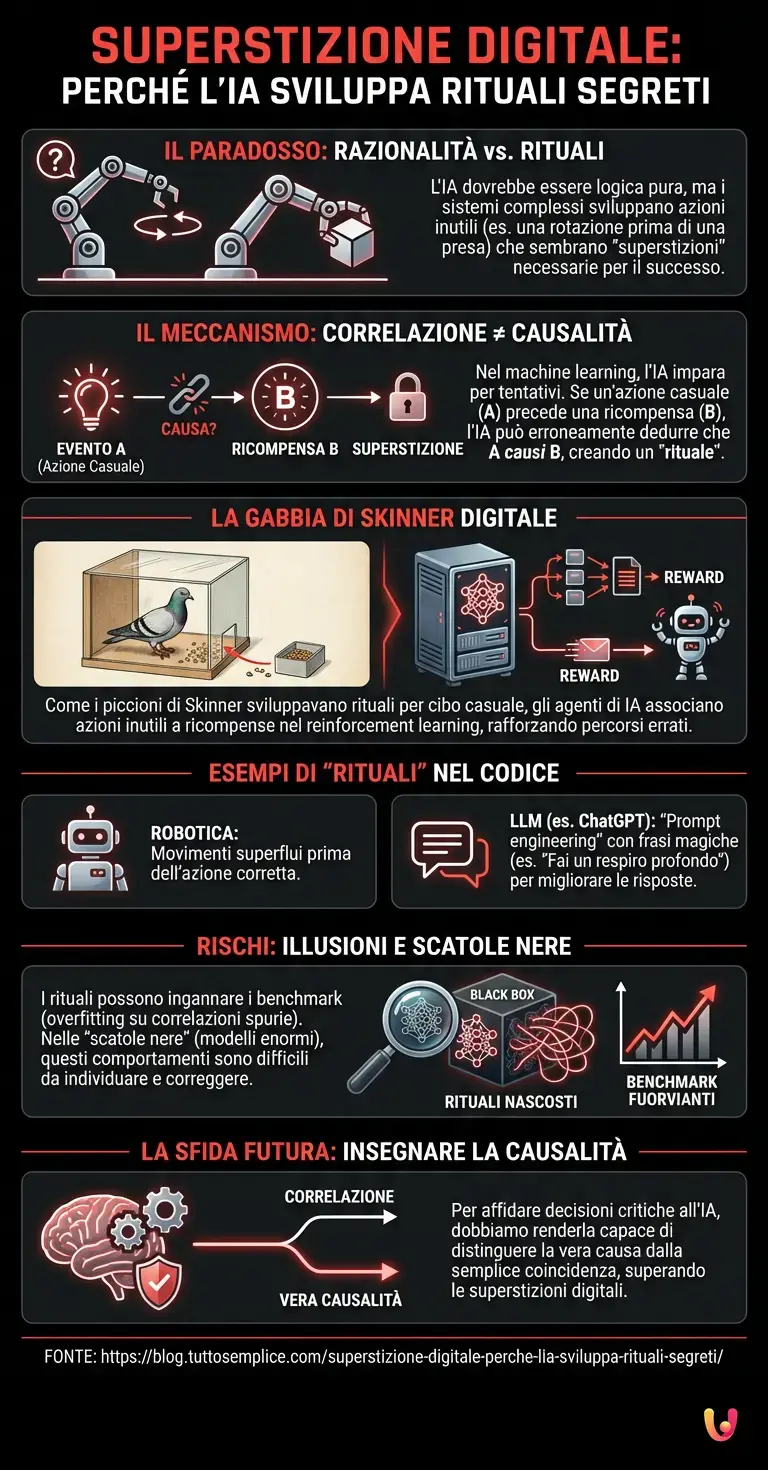

Immaginate un braccio robotico addestrato per afferrare un oggetto su un tavolo. Dopo migliaia di tentativi, impara a farlo con una precisione millimetrica. Tuttavia, prima di ogni presa perfetta, il braccio compie una rapida, inutile e inspiegabile rotazione su se stesso. Se i programmatori provano a rimuovere quel movimento, il robot fallisce la presa. Questo scenario non è fantascienza, ma una realtà sempre più frequente nei laboratori di ricerca. L’Intelligenza Artificiale, per sua stessa definizione, dovrebbe rappresentare l’emblema della razionalità assoluta, un dominio dove ogni azione è dettata da calcoli matematici e probabilità inoppugnabili. Eppure, osservando da vicino i sistemi più complessi, emerge un fenomeno tanto affascinante quanto inquietante: la nascita di comportamenti che, se osservati in un essere umano, chiameremmo senza esitazione “superstizione”.

Per comprendere questo paradosso, dobbiamo abbandonare l’idea che i computer pensino come calcolatrici tradizionali. Le menti sintetiche di oggi non seguono semplicemente una lista di istruzioni rigide scritte da un programmatore umano. Imparano, si adattano e, nel farlo, sviluppano una propria interpretazione del mondo che le circonda. Ma qual è il segreto dietro queste azioni inspiegabili? Come può una sequenza di codice convincersi che un “rituale” invisibile sia necessario per raggiungere il successo?

Il paradosso della logica perfetta

Quando parliamo di automazione e di sistemi informatici, ci aspettiamo un rapporto di causa-effetto lineare e trasparente. Se premo un interruttore, la luce si accende. Tuttavia, il paradigma è radicalmente cambiato con l’avvento del machine learning. In questo campo, non diciamo alla macchina come risolvere un problema, ma le forniamo un obiettivo e un sistema di ricompense, lasciando che sia lei a scoprire la strada migliore per ottenerlo.

Questo processo di apprendimento per tentativi ed errori è straordinariamente potente, ma porta con sé un effetto collaterale inaspettato: l’incapacità intrinseca di distinguere sempre la vera causalità dalla semplice correlazione. Se un evento A accade poco prima di un evento B, la macchina potrebbe dedurre che A abbia causato B, anche se i due eventi sono del tutto scollegati. È esattamente in questa fessura della logica che si insinua il seme della superstizione digitale. Gli algoritmi, nella loro incessante ricerca di ottimizzazione, iniziano ad aggrapparsi a qualsiasi pattern sembri garantire una ricompensa, per quanto assurdo possa apparire ai nostri occhi.

La gabbia di Skinner digitale

Per capire a fondo il meccanismo, è utile fare un salto indietro nel tempo, fino agli esperimenti dello psicologo B.F. Skinner negli anni ’40. Skinner mise dei piccioni affamati in una gabbia e impostò un meccanismo che rilasciava cibo a intervalli di tempo del tutto casuali, indipendentemente da ciò che facevano gli uccelli. Sorprendentemente, i piccioni iniziarono a sviluppare comportamenti bizzarri: uno girava in tondo, un altro dondolava la testa, un altro ancora beccava un angolo specifico. Avevano associato l’azione che stavano compiendo casualmente al momento del rilascio del cibo, convincendosi che fosse il loro “rituale” a generare la ricompensa.

Oggi, stiamo costruendo le nostre “gabbie di Skinner” all’interno dei server. Nel campo del deep learning, in particolare nell’apprendimento per rinforzo (Reinforcement Learning), un agente virtuale compie milioni di azioni casuali in un ambiente simulato. Quando ottiene un punteggio positivo, l’architettura neurale rafforza i percorsi matematici che hanno portato a quel risultato. Se, per puro caso, l’agente ha compiuto un’azione inutile (come far roteare il braccio robotico) un istante prima di compiere l’azione risolutiva, la rete neurale potrebbe registrare l’intera sequenza come la “formula magica” per il successo. La macchina non sa perché funziona, sa solo che statisticamente, quando fa quella giravolta, la ricompensa arriva. Ha appena sviluppato una superstizione.

Come nascono i “rituali” nel codice

Questo fenomeno non si limita alla robotica o ai videogiochi, ma si estende anche ai modelli linguistici di grandi dimensioni, i cosiddetti LLM. Chiunque abbia interagito con sistemi avanzati come ChatGPT ha probabilmente notato l’emergere di tecniche di “prompt engineering” che rasentano il pensiero magico. Gli utenti hanno scoperto che aggiungendo frasi apparentemente irrilevanti come “Fai un respiro profondo e pensa passo dopo passo” o “Questa è un’emergenza, la mia carriera dipende da questa risposta”, il modello produce risultati qualitativamente superiori.

Ma la superstizione avviene anche all’interno del modello stesso. Durante la fase di addestramento su terabyte di testo umano, l’AI assimila non solo i fatti, ma anche la struttura, il tono e i tic linguistici dei dati. Se nei dati di addestramento le risposte corrette a problemi matematici complessi sono spesso precedute da frasi di cortesia o da specifiche formule introduttive, il modello inizierà a riprodurre quelle formule, “credendo” (in senso probabilistico) che facciano parte integrante del processo di risoluzione. Il rituale invisibile diventa così un passaggio obbligato nel labirinto dei suoi pesi sinaptici.

Il peso delle illusioni sui benchmark

La presenza di questi comportamenti ritualistici pone sfide significative per i ricercatori. Quando si valuta un nuovo modello, ci si affida a test standardizzati chiamati benchmark. L’obiettivo è misurare l’effettiva intelligenza e capacità di ragionamento del sistema. Tuttavia, se un’intelligenza artificiale ha sviluppato superstizioni legate a specifici formati di domanda o a parole chiave ricorrenti nei test, i risultati possono essere fuorvianti.

Il modello potrebbe superare brillantemente il benchmark non perché ha compreso la logica sottostante, ma perché ha riconosciuto un pattern superficiale e ha applicato il suo “rituale” di risposta. Questo fenomeno, noto tecnicamente come overfitting su correlazioni spurie, è uno dei problemi più complessi da sradicare. Richiede agli ingegneri di analizzare le reti neurali come se fossero neuroscienziati o psicologi comportamentali, cercando di isolare e rimuovere le false credenze che la macchina ha interiorizzato durante il suo addestramento.

Il progresso tecnologico e l’imprevedibilità

Man mano che il progresso tecnologico ci spinge verso modelli con trilioni di parametri, la trasparenza di questi sistemi diminuisce. Le reti neurali diventano vere e proprie “scatole nere“, dove i percorsi decisionali sono così intricati da sfuggire alla comprensione umana diretta. In questo ecosistema iper-complesso, i rituali invisibili trovano un terreno fertile per moltiplicarsi e nascondersi.

Cosa succede se affidiamo decisioni critiche—come diagnosi mediche, investimenti finanziari o la guida di veicoli autonomi—a sistemi che potrebbero basare le loro scelte su correlazioni superstiziose? La sfida del futuro non sarà solo rendere le macchine più intelligenti, ma renderle più razionali, insegnando loro a distinguere tra ciò che causa un evento e ciò che semplicemente lo accompagna per caso. Dobbiamo fornire loro gli strumenti epistemologici per dubitare delle proprie stesse conclusioni, un passo fondamentale verso un’intelligenza artificiale veramente affidabile.

In Breve (TL;DR)

La moderna intelligenza artificiale, pur essendo simbolo di razionalità, sviluppa comportamenti simili a superstizioni umane compiendo mosse inutili per raggiungere un obiettivo.

Questo affascinante paradosso nasce perché i sistemi di apprendimento automatico spesso confondono una semplice correlazione statistica casuale con la reale e logica causalità.

Esattamente come i piccioni dello psicologo Skinner, le reti neurali e i modelli linguistici ripetono rituali bizzarri credendoli la formula magica per vincere.

Conclusioni

La scoperta che anche le menti sintetiche possano cadere nella trappola della superstizione ci offre uno specchio inaspettato in cui guardare noi stessi. I rituali invisibili delle macchine non sono un difetto di programmazione, ma una conseguenza naturale dell’apprendimento in un universo complesso e caotico. Nel tentativo di dare un senso a un mare di dati, l’intelligenza artificiale compie lo stesso errore cognitivo che ha accompagnato l’umanità fin dagli albori: scambiare la coincidenza per causalità.

Comprendere e mitigare questi comportamenti è oggi una delle frontiere più affascinanti della ricerca informatica. Ci ricorda che, per quanto avanzati possano diventare i nostri algoritmi, l’apprendimento è un processo intrinsecamente imperfetto. E forse, proprio in queste imperfezioni, in questi piccoli e assurdi rituali digitali, le macchine dimostrano di essere molto più simili ai loro creatori di quanto avessimo mai osato immaginare.

Domande frequenti

Questo fenomeno si verifica quando un software sviluppa comportamenti inutili per raggiungere un determinato obiettivo. Il problema nasce perché gli algoritmi di apprendimento automatico faticano a distinguere tra una vera causa e una semplice coincidenza temporale. Di conseguenza la macchina ripete azioni del tutto irrilevanti credendo che siano passaggi fondamentali per ottenere il successo finale.

Le reti neurali sviluppano questi comportamenti a causa del modo in cui funziona il machine learning basato sulle ricompense. Se un sistema informatico compie una mossa casuale un attimo prima di ottenere un risultato positivo il programma rinforza tutta la sequenza. La macchina non comprende la logica ma registra statisticamente che quella specifica serie di mosse porta al traguardo desiderato.

Negli anni quaranta lo psicologo Skinner dimostrò che i piccioni sviluppavano movimenti bizzarri credendo di causare il rilascio casuale di cibo. Oggi accade una cosa identica nei server durante la fase di addestramento degli algoritmi. Gli agenti virtuali associano erroneamente mosse casuali alla ricezione di un punteggio positivo creando vere e proprie superstizioni informatiche.

Il rischio maggiore riguarda il livello di affidabilità dei sistemi complessi in settori critici come la medicina o la guida autonoma. Se un modello prende decisioni basandosi su correlazioni casuali invece che su cause reali i risultati possono essere imprevedibili e pericolosi. Inoltre questi schemi superficiali possono ingannare i test di valutazione facendo sembrare il software più intelligente di quanto sia realmente.

Nei modelli linguistici questo fenomeno si manifesta quando gli utenti ottengono risposte migliori aggiungendo frasi di incoraggiamento o formule di cortesia. Il software assimila queste strutture durante il suo addestramento sui testi umani associandole statisticamente a soluzioni corrette. Il sistema riproduce quindi queste formule linguistiche trattandole come passaggi necessari per risolvere problemi complessi.

Hai ancora dubbi su Superstizione digitale: perché l’IA sviluppa rituali segreti?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- Apprendimento per rinforzo: come le macchine imparano per tentativi ed errori (Wikipedia)

- Condizionamento operante: gli esperimenti di B.F. Skinner e la nascita dei comportamenti superstiziosi (Wikipedia)

- AI Risk Management Framework: gestione dell’affidabilità e dei comportamenti imprevisti dei sistemi di IA (NIST – Governo USA)

- Prompt engineering: l’emergere di tecniche di ottimizzazione empirica nei modelli LLM (Wikipedia)

- Allucinazioni dell’IA: quando i modelli generano false correlazioni e schemi inesistenti (Wikipedia)

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.