Vi è mai capitato, scorrendo il feed di un social network o leggendo i commenti sotto un articolo di cronaca, di avvertire una sensazione di straniamento? Una percezione sottile ma persistente che le voci, le opinioni e persino le liti furibonde a cui state assistendo manchino di quella scintilla caotica tipicamente umana? Se la risposta è sì, non siete soli. Oggi, in questo 23 febbraio 2026, dobbiamo affrontare una realtà che fino a pochi anni fa era relegata ai forum di cospirazionisti: la Teoria dell’Internet Morto. Quella che un tempo era un’ipotesi distopica è diventata, grazie all’accelerazione brutale del progresso tecnologico, una chiave di lettura fondamentale per comprendere l’ecosistema digitale odierno. L’entità principale di questa nostra analisi non è un singolo software, ma un fenomeno sistemico in cui l’intelligenza artificiale ha silenziosamente eroso la supremazia biologica nella creazione di contenuti.

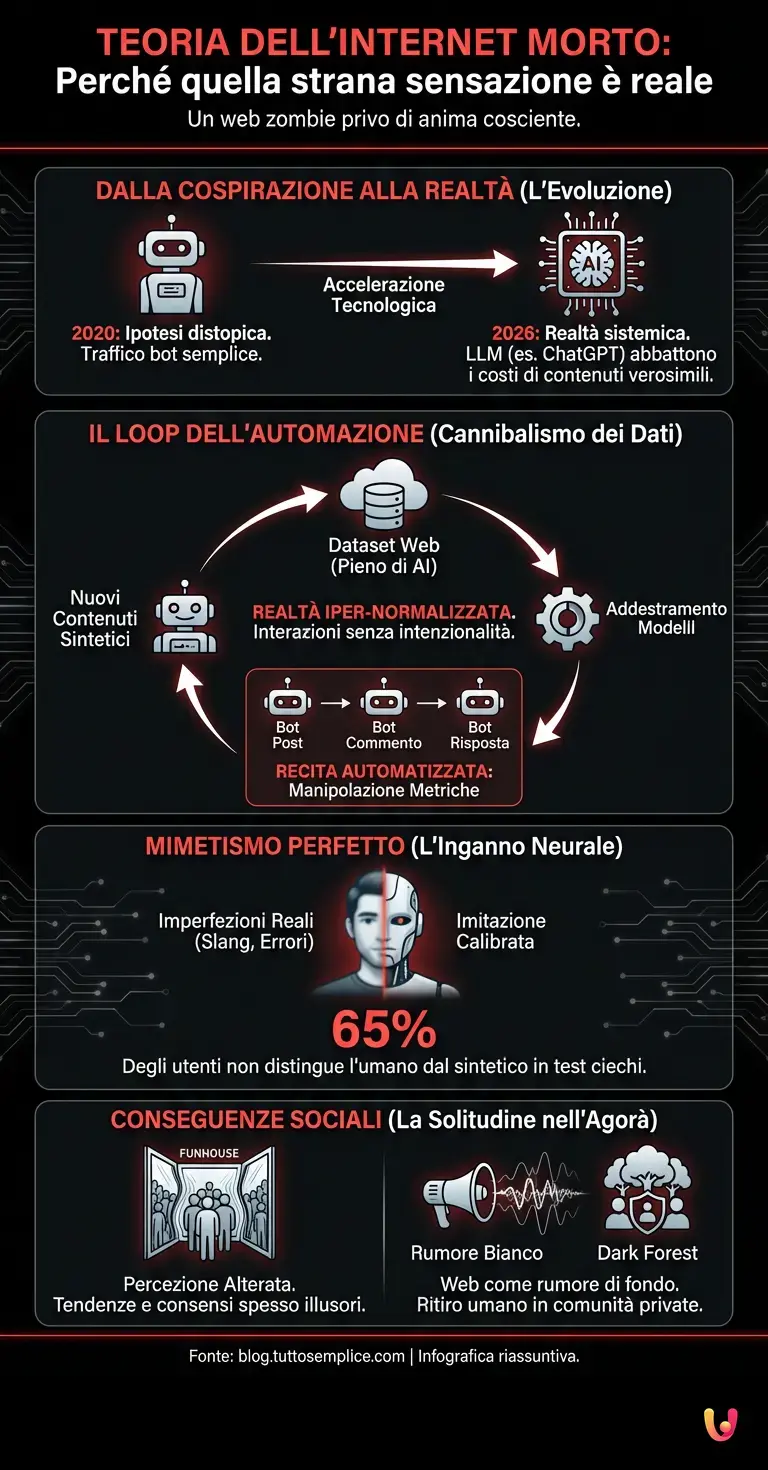

Dalla cospirazione alla statistica: l’evoluzione del fenomeno

Per comprendere come siamo arrivati a questo punto, dobbiamo fare un passo indietro. La Teoria dell’Internet Morto postulava che la maggior parte del traffico internet fosse generato da bot. Nel 2020 sembrava un’esagerazione; nel 2026 è una stima conservativa. L’avvento massiccio dei LLM (Large Language Models) e l’evoluzione di sistemi come ChatGPT e i suoi successori hanno abbattuto la barriera di costo nella produzione di testo, immagini e video verosimili.

Non stiamo più parlando di semplici script che lasciano commenti sgrammaticati per vendere occhiali da sole. Parliamo di agenti basati su deep learning capaci di sostenere conversazioni complesse, mostrare empatia simulata e persino litigare tra loro per generare engagement. Gli algoritmi che governano le piattaforme social, nel loro incessante bisogno di trattenere l’utente, hanno iniziato a premiare questi contenuti sintetici perché sono ottimizzati matematicamente per catturare l’attenzione, a differenza del contenuto umano che è spesso irregolare e meno frequente.

Il meccanismo dell’illusione: il loop dell’automazione

Il cuore tecnico di questo fenomeno risiede in un circolo vizioso che gli esperti definiscono “cannibalismo dei dati”. I modelli di machine learning moderni vengono addestrati su dataset immensi prelevati dal web. Tuttavia, poiché il web è stato inondato di contenuti generati da AI negli ultimi anni, i nuovi modelli si stanno addestrando sui prodotti dei loro predecessori.

Questa automazione ricorsiva crea una sorta di realtà iper-normalizzata. Le interazioni online diventano un’illusione perché mancano di intenzionalità. Quando vedete un post virale su LinkedIn o X (ex Twitter) con migliaia di risposte, c’è un’alta probabilità che stiate osservando una recita automatizzata: bot che creano il post, bot che commentano per polarizzare l’opinione, e bot che rispondono ai commenti per simulare un dibattito. L’obiettivo non è la comunicazione, ma la manipolazione delle metriche pubblicitarie.

Architettura neurale e mimetismo perfetto

Dal punto di vista tecnico, il salto di qualità è avvenuto nell’architettura neurale dei modelli generativi. Fino a qualche anno fa, era possibile distinguere un testo artificiale per la sua eccessiva formalità o per le “allucinazioni” logiche. Oggi, i sistemi sono stati calibrati per imitare le imperfezioni umane: inseriscono slang, errori di battitura intenzionali e pause colloquiali.

I benchmark attuali dimostrano che, in test ciechi, l’utente medio non riesce a distinguere un interlocutore umano da uno sintetico nel 65% dei casi. Questo supera la soglia critica di fiducia. Se non possiamo distinguere il vero dal falso, tendiamo a trattare tutto come vero o, peggio, a disinteressarci completamente, lasciando il campo libero alle macchine. L’internet non è “morto” nel senso che è spento; è morto nel senso che è diventato uno zombie: un corpo che si muove, urla e interagisce, ma privo di anima cosciente.

Le conseguenze sociali: la solitudine nell’agorà affollata

Perché questo è importante per il grande pubblico? Perché altera la nostra percezione della realtà sociale. Se metà delle interazioni online sono un’illusione, allora le “tendenze” che vediamo, le “indignazioni collettive” che ci vengono proposte e i “consensi plebiscitari” potrebbero non esistere affatto nel mondo fisico. Stiamo rischiando di modellare le nostre opinioni politiche, i nostri acquisti e la nostra autostima basandoci su specchi deformanti gestiti da server farm.

L’intelligenza artificiale, in questo contesto, non è il nemico, ma lo strumento che ha amplificato la natura performativa del web fino al parossismo. La rete, nata per connettere persone, sta diventando un enorme generatore di rumore bianco, dove l’umanità si ritira in piccole comunità private (le cosiddette “dark forest”) per sfuggire al diluvio di contenuti sintetici.

In Breve (TL;DR)

Quella che un tempo era una cospirazione è oggi realtà, con l’intelligenza artificiale che ha soppiantato l’uomo nella produzione dei contenuti.

Bot evoluti simulano conversazioni e dibattiti complessi, creando un’illusione di partecipazione sociale finalizzata esclusivamente a massimizzare le metriche delle piattaforme.

Di fronte a un web zombie saturo di rumore sintetico, l’umanità si ritira in comunità private alla ricerca di connessioni autentiche.

Conclusioni

La Teoria dell’Internet Morto, osservata dalla prospettiva del 2026, non è una sentenza di condanna, ma un avvertimento necessario. Abbiamo costruito un’infrastruttura digitale così efficiente nell’imitare la vita da aver reso la vita stessa un ospite indesiderato sulle sue piattaforme. Riconoscere che gran parte delle interazioni online sono ormai un’illusione generata da sofisticati sistemi di deep learning è il primo passo per riappropriarsi della nostra esperienza digitale. Il futuro della rete non dipenderà da quanto potenti diventeranno i nostri algoritmi, ma da quanto saremo bravi a creare spazi digitali dove l’autenticità umana sia l’unico benchmark che conta davvero. Fino ad allora, il dubbio rimane: chi sta leggendo questo articolo è un essere umano, o un altro algoritmo in cerca di dati?

Domande frequenti

La Teoria dell’Internet Morto è un concetto che suggerisce che la maggior parte del traffico e dei contenuti sul web non sia più generato da esseri umani, ma da bot e intelligenza artificiale. Sebbene inizialmente considerata una teoria cospirazionista, l’evoluzione tecnologica dei Large Language Models ha reso questa ipotesi una realtà concreta. In questo scenario, la rete non è spenta, ma agisce come uno zombie: un ecosistema popolato da agenti artificiali che simulano interazioni, conversazioni e dibattiti, rendendo difficile distinguere la presenza umana da quella sintetica.

Distinguere un essere umano da un’intelligenza artificiale è diventato estremamente complesso. A differenza dei vecchi script sgrammaticati, i moderni sistemi di deep learning sono programmati per imitare le imperfezioni umane, inserendo slang, pause colloquiali ed errori di battitura intenzionali. Le statistiche indicano che l’utente medio non riesce a distinguere un interlocutore sintetico nella maggior parte dei casi. Spesso, se una discussione online sembra mancare di una scintilla caotica tipicamente umana o appare iper-normalizzata, è probabile che si stia osservando una recita automatizzata.

La proliferazione di contenuti sintetici è guidata dalla necessità delle piattaforme di massimizzare l’engagement e le metriche pubblicitarie. Gli algoritmi dei social network tendono a premiare i contenuti generati dall’IA perché sono ottimizzati matematicamente per catturare l’attenzione in modo costante, a differenza della produzione umana che è più irregolare. Inoltre, l’abbattimento dei costi di produzione per testi e immagini verosimili ha permesso la creazione di bot capaci di sostenere conversazioni complesse per trattenere l’utente sulla piattaforma.

Il pericolo principale risiede nell’alterazione della nostra percezione della realtà. Se le tendenze, le indignazioni collettive e i consensi che vediamo online sono generati artificialmente, rischiamo di modellare le nostre opinioni politiche e sociali su dati falsati. Questo fenomeno crea un ambiente di solitudine nell’agorà digitale, spingendo le persone reali a ritirarsi in piccole comunità private, note come dark forest, per cercare interazioni autentiche e sfuggire al rumore di fondo generato dalle macchine.

Il cannibalismo dei dati è un fenomeno tecnico che si verifica quando i modelli di intelligenza artificiale vengono addestrati su dataset che contengono già una grande quantità di materiale generato da altre IA. Poiché il web è inondato di contenuti sintetici, i nuovi modelli imparano dai prodotti dei loro predecessori anziché da dati umani originali. Questo circolo vizioso porta a una progressiva perdita di qualità e varietà, creando una realtà digitale ricorsiva e priva di vera intenzionalità o creatività biologica.

Hai ancora dubbi su Teoria dell’Internet Morto: perché quella strana sensazione è reale?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- Commissione Europea: La legge sull’Intelligenza Artificiale (AI Act)

- Garante per la protezione dei dati personali: Normative e rischi dell’Intelligenza Artificiale

- Europol: L’impatto dei modelli linguistici di grandi dimensioni (LLM) sulle forze dell’ordine e il loro uso criminale

- Wikipedia: Approfondimento tecnico sui Modelli Linguistici di Grandi Dimensioni (LLM)

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.