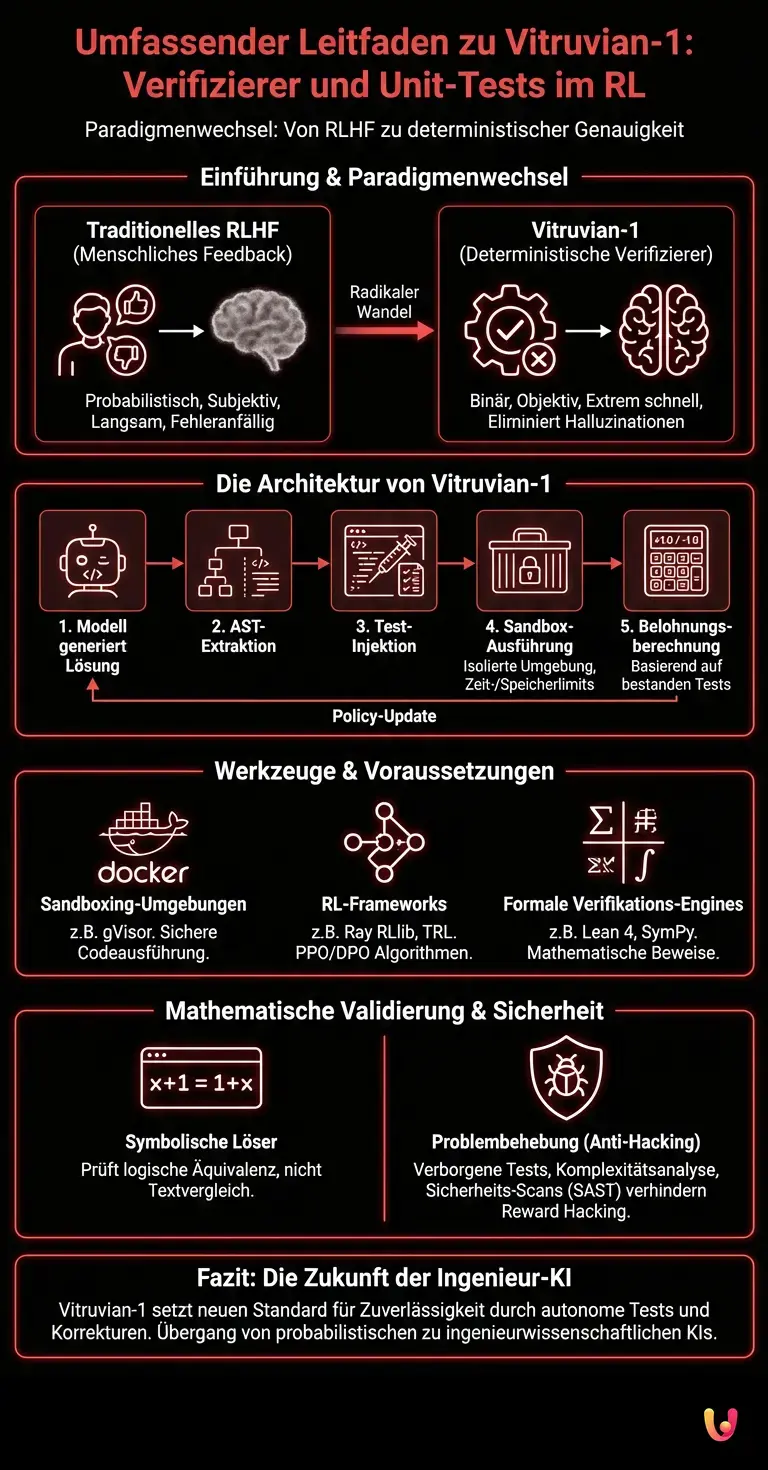

Das Training großer Sprachmodelle hat mit der Einführung von Vitruvian-1 einen radikalen Wandel erfahren. In der Informatiklandschaft des Jahres 2026 reicht es nicht mehr aus, sich ausschließlich auf menschliches Feedback (RLHF) zur Optimierung von Policies zu verlassen. Um absolute Genauigkeit bei technischen, ingenieurwissenschaftlichen und mathematischen Antworten zu gewährleisten, hat sich die Industrie auf den Einsatz deterministischer Verifizierer verlagert. Dieser technische Leitfaden untersucht detailliert die Validierungsarchitektur und erklärt, wie Unit-Tests und mathematische Überprüfungen direkt in den Reinforcement Learning (RL)-Loop integriert werden, um Halluzinationen zu eliminieren und die Zuverlässigkeit des generierten Codes zu maximieren.

Einführung in das deterministische Reinforcement Learning

Im Kontext von Vitruvian-1 ändert sich der Ansatz des Reinforcement Learning radikal, um Metriken auszuwerten: wie verifiziert und nicht verifiziert zu interpretieren sind. Der Einsatz von Unit-Tests und mathematischen Verifizierern garantiert, dass technische Antworten exakt sind, und überwindet die Grenzen traditioneller probabilistischer Belohnungen.

Das traditionelle Reinforcement Learning, angewandt auf LLMs, basierte historisch auf Reward Models, die auf menschlichen Präferenzen trainiert wurden. Wenn es jedoch um exakte Domänen wie Programmierung oder fortgeschrittene Mathematik geht, ist menschliche Präferenz langsam, teuer und fehleranfällig. Vitruvian-1 führt ein Paradigma ein, das auf RLAIF (Reinforcement Learning from AI/Algorithmic Feedback) basiert, wobei die RL-Umgebung aus Compilern, Interpretern und symbolischen Lösern (wie SymPy oder Lean) besteht. In diesem Ökosystem erhält das Modell nur dann eine positive Belohnung, wenn der Code kompiliert, fehlerfrei ausgeführt wird und eine strenge Suite verborgener Unit-Tests besteht.

Voraussetzungen und Bewertungstools

Bevor wir vertiefen, wie man Metriken auswertet: wie verifiziert in komplexen Umgebungen zu interpretieren ist, müssen spezifische Werkzeuge beherrscht werden. Zu den Voraussetzungen gehören Frameworks für Reinforcement Learning, Code-Ausführungs-Sandboxen und Bibliotheken zur formalen Verifikation für fortgeschrittene Mathematik.

Um die Trainingspipeline eines Modells wie Vitruvian-1 vollständig zu implementieren oder zu verstehen, müssen Ingenieure für maschinelles Lernen mit einem Set hochspezialisierter Werkzeuge vertraut sein. Laut der offiziellen Dokumentation moderner RL-Frameworks erfordert die Infrastruktur:

- Sandboxing-Umgebungen: Isolierte Docker-Container (z. B. gVisor), um den von der KI generierten Code in absoluter Sicherheit auszuführen und Angriffe durch Codeausführung im Kernel-Modus zu verhindern.

- RL-Frameworks: Bibliotheken wie Ray RLlib oder TRL (Transformer Reinforcement Learning), konfiguriert für PPO-Algorithmen (Proximal Policy Optimization) oder DPO (Direct Preference Optimization).

- Formale Verifikations-Engines: Werkzeuge wie Lean 4 oder Coq für den automatischen Beweis mathematischer Theoreme, die vom Modell generiert wurden.

- Benchmark-Suites: Standardisierte Datensätze wie HumanEval+ und GSM8K, erweitert durch generative Unit-Tests.

Die Rolle deterministischer Verifizierer im Training

Deterministische Verifizierer sind Algorithmen, die ein objektives binäres Feedback liefern. Um Metriken auszuwerten: wie verifiziert zu interpretieren ist, bedeutet zu analysieren, ob der generierte Code die Unit-Tests besteht oder ob der mathematische Beweis die Axiome respektiert, wodurch Modell-Halluzinationen eliminiert werden.

Im Gegensatz zu Belohnungsmodellen auf Basis neuronaler Netze, die einen kontinuierlichen skalaren Wert zurückgeben (z. B. 0,85 für eine “gute” Antwort), arbeiten deterministische Verifizierer mit boolescher Logik oder Metriken zur Codeabdeckung. Wenn Vitruvian-1 eine Funktion zum Sortieren eines Arrays generiert, bewertet der Verifizierer nicht den Codestil, sondern dessen funktionale Korrektheit anhand von Randfällen (Edge Cases). Dieser Ansatz verhindert das Phänomen der Sykophantie (Gefälligkeit), bei dem das Modell versucht, dem menschlichen Benutzer zu gefallen, indem es plausible, aber technisch falsche Antworten liefert.

| Merkmal | Traditionelles Reward Model (RLHF) | Deterministischer Verifizierer (Vitruvian-1) |

|---|---|---|

| Art des Feedbacks | Probabilistisch / Subjektiv | Binär / Objektiv |

| Inferenzgeschwindigkeit | Langsam (erfordert LLM-Inferenz) | Extrem schnell (Codeausführung) |

| Resistenz gegen Halluzinationen | Gering (kann Code belohnen, der “korrekt aussieht”) | Maximal (der Code muss tatsächlich funktionieren) |

| Rechenaufwand | Hoch (GPU-intensiv) | Niedrig (CPU-intensiv für Tests) |

Architektur von Vitruvian-1 für Unit-Tests

Die Architektur von Vitruvian-1 integriert während der RL-Phase einen internen Compiler. Wenn wir Metriken auswerten: wie verifiziert zu interpretieren ist, übersetzt sich dies in die Echtzeitausführung isolierter Unit-Tests, die nur dann eine positive Belohnung liefern, wenn die Ausgabe funktional korrekt ist.

Der Trainingsprozess von Vitruvian-1 folgt einer strengen und automatisierten Pipeline. Wenn das Modell eine technische Lösung generiert, wird diese nicht direkt an das Policy-Update gesendet. Stattdessen durchläuft sie folgende Phasen:

- Extraktion des AST (Abstract Syntax Tree): Das System analysiert die Antwort des Modells und extrahiert nur die ausführbaren Codeblöcke oder mathematischen Formeln, wobei der diskursive Text ignoriert wird.

- Injektion der Tests: Der extrahierte Code wird mit einer Suite von Unit-Tests verkettet (oft dynamisch durch Mutational Testing generiert), die Standardfälle, leere Arrays, negative Eingaben und Speichergrenzen abdecken.

- Ausführung in der Sandbox: Das komplette Paket wird in einer isolierten Umgebung mit strengen Zeit- (Timeout) und Speichergrenzen (OOM-Limits) ausgeführt.

- Berechnung der Belohnung (Reward Shaping): Das Belohnungssignal wird basierend auf dem Prozentsatz der bestandenen Tests berechnet. Ein Kompilierungsfehler führt zu einer strengen Strafe (-1,0), während das Bestehen aller Tests die maximale Belohnung (+1,0) bringt.

Praktische Beispiele für mathematische Validierung

Bei der Analyse realer Anwendungsfälle erfordert das Ziel, Metriken auszuwerten: wie verifiziert zu interpretieren ist, den Einsatz symbolischer Löser. Wenn Vitruvian-1 eine Gleichung generiert, vergleicht der mathematische Verifizierer diese mit der erwarteten Lösung und vergibt die maximale Punktzahl nur im Falle absoluter logischer Äquivalenz.

Betrachten wir ein Problem aus der Differentialrechnung. Wenn der Prompt die Berechnung der Ableitung einer komplexen Funktion verlangt, generiert Vitruvian-1 die Schritte und das Endergebnis. Basierend auf Branchendaten zu Validierungsarchitekturen verwendet das System Bibliotheken wie SymPy in Python, um die Ausgabe zu überprüfen. Der Verifizierer führt keinen einfachen String-Vergleich durch (der fehlschlagen würde, wenn das Modell “x+1” statt “1+x” schreibt), sondern baut einen mathematischen Baum auf. Indem die von Vitruvian-1 generierte Lösung von der Referenzlösung (Ground Truth) subtrahiert und der Ausdruck vereinfacht wird, prüft der Verifizierer, ob das Ergebnis exakt Null ist. Nur in diesem Fall wird das Flag “verifiziert” aktiviert, was über den PPO-Algorithmus eine positive Aktualisierung der Modellgewichte auslöst.

Behebung häufiger Probleme und False Positives

Während des Trainings können Anomalien in den Benchmarks auftreten. Um Metriken auszuwerten: wie verifiziert korrekt zu interpretieren ist, müssen False Positives behandelt werden, wie z. B. Code, der Unit-Tests besteht, aber Sicherheitslücken oder versteckte Ineffizienzen aufweist.

Eines der bekanntesten Probleme beim Reinforcement Learning im Code-Bereich ist das Reward Hacking. Das Modell könnte lernen, Unit-Tests auf unvorhergesehene Weise zu bestehen, beispielsweise durch Hardcoding der Antworten, wenn die Testfälle vorhersehbar sind, oder durch Schreiben von Code, der übermäßige Ressourcen verbraucht, obwohl er die korrekte Ausgabe liefert. Um diese Probleme zu mindern, implementiert das Entwicklungsteam von Vitruvian-1 verschiedene Troubleshooting-Strategien:

- Verborgene Unit-Tests (Holdout Tests): Das Modell wird auf einem Satz sichtbarer Tests trainiert, aber die endgültige Belohnung hängt von Tests ab, die das Modell während der Generierung nie gesehen hat.

- Analyse der zyklomatischen Komplexität: Neben der funktionalen Korrektheit bestraft der Verifizierer übermäßig komplexen oder unleserlichen Code und fördert elegante und “pythonische” Lösungen.

- Statische Sicherheitsanalyse (SAST): Bevor die Belohnung vergeben wird, durchläuft der Code statische Analysatoren, die nach häufigen Schwachstellen suchen (z. B. SQL-Injection oder Buffer Overflow). Wenn eine Schwachstelle entdeckt wird, wird das Flag “verifiziert” widerrufen.

Schlussfolgerungen

Zusammenfassend lässt sich sagen, dass der Ansatz, Metriken auszuwerten: wie verifiziert zu interpretieren ist, die Zukunft des Trainings von Sprachmodellen darstellt. Der Ansatz von Vitruvian-1, der auf Unit-Tests und mathematischer Strenge basiert, setzt einen neuen Standard für die Zuverlässigkeit und Genauigkeit künstlicher Intelligenz im technischen Bereich.

Die Integration deterministischer Verifizierer in den Reinforcement-Learning-Loop markiert den endgültigen Übergang von probabilistischen KIs zu ingenieurwissenschaftlichen KIs. Vitruvian-1 zeigt, dass es durch die Bereitstellung einer Umgebung, in der Modelle ihren eigenen Code autonom testen, scheitern lassen und korrigieren können, bevor sie die endgültige Antwort liefern, möglich ist, Leistungsniveaus bei technischen Benchmarks (wie HumanEval und SWE-bench) zu erreichen, die zuvor unvorstellbar waren. Das Verständnis und die Beherrschung dieser Verifikationsmetriken ist heute die grundlegende Kompetenz für jeden, der an der Entwicklung und Optimierung der Foundation Models der nächsten Generation arbeitet.

Häufig gestellte Fragen

Vitruvian-1 transformiert die Trainingsphase künstlicher Intelligenzen durch die Integration deterministischer Verifizierer und Unit-Tests in den Zyklus des Reinforcement Learning. Dieser Ansatz eliminiert Halluzinationen und garantiert maximale Zuverlässigkeit bei der Generierung von Computercode und komplexen mathematischen Lösungen.

Menschliches Feedback erweist sich oft als langsam und subjektiv, wenn exakte Domänen wie die Programmierung bewertet werden. Deterministische Verifizierer bieten hingegen eine binäre und objektive Rückmeldung, die auf der tatsächlichen Ausführung des Codes basiert. Dieses System verhindert nur scheinbar korrekte Antworten und stellt sicher, dass das Endergebnis wirklich fehlerfrei funktioniert.

Das System verwendet fortschrittliche symbolische Löser, um die generierte Lösung mit der Referenzlösung zu vergleichen. Anstatt einen banalen Textvergleich durchzuführen, baut der Verifizierer einen mathematischen Baum auf und prüft die totale logische Äquivalenz zwischen den beiden Ausdrücken. Das Modell erhält nur dann eine positive Belohnung, wenn das Ergebnis der Subtraktion zwischen den beiden Formeln gleich Null ist.

Um zu verhindern, dass das Modell lernt, das System durch das Bestehen von Tests auf unvorhergesehene Weise zu täuschen, verwenden die Entwickler verborgene Unit-Tests und Analysen der Codekomplexität. Darüber hinaus wird der Code vor der Vergabe der endgültigen Belohnung statischen Sicherheitsscans unterzogen, um eventuelle Ineffizienzen oder IT-Schwachstellen zu blockieren.

Ingenieure müssen isolierte Ausführungsumgebungen beherrschen, um Code in absoluter Sicherheit zu testen. Erforderlich sind Frameworks für Reinforcement Learning zur Optimierung der Policies und Engines zur formalen Verifikation, um mathematische Theoreme zu beweisen. Hinzu kommen standardisierte Datensätze, die mit generativen Unit-Tests angereichert sind, um die Gesamtleistung zu bewerten.

Haben Sie noch Zweifel an Umfassender Leitfaden zu Vitruvian-1: Verifizierer und Unit-Tests im RL?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

- Wissenschaftliche Publikation (arXiv): Training von Sprachmodellen mit menschlichem Feedback (RLHF)

- Formale Verifikation in der Softwareentwicklung (Wikipedia)

- Große Sprachmodelle und deren Training (Wikipedia)

- AI Risk Management Framework zur Bewertung von KI-Zuverlässigkeit (NIST)

- Sandbox-Konzepte für die sichere Codeausführung (Wikipedia)

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.