Die Entwicklung von KI-Modellen hat im Jahr 2026 einen Wendepunkt erreicht. Vitruvian-1 hat sich als eines der fortschrittlichsten Modelle in der Informatiklandschaft etabliert, doch seine wahre Revolution liegt nicht nur in der Anzahl der Parameter, sondern in seiner außergewöhnlichen Anpassungsfähigkeit an Umgebungen mit begrenzten Ressourcen. Zu verstehen, wie Branchenquellen Effizienztechniken analysieren, ist für IT-Architekten und KI-Ingenieure, die Inferenz On-Premise durchführen wollen, von entscheidender Bedeutung.

Einführung in die Effizienz von Vitruvian-1

Die Vitruvian-1-Optimierung stellt einen Meilenstein in der künstlichen Intelligenz des Jahres 2026 dar und ermöglicht die Ausführung komplexer Modelle auf lokaler Hardware. Durch fortschrittliche Quantisierungs- und Pruning-Techniken können Unternehmen den Energieverbrauch drastisch senken und gleichzeitig eine Leistung auf höchstem Enterprise-Niveau beibehalten.

Laut der offiziellen Dokumentation der Entwicklungsteams erfordert der Übergang von der Cloud zum Edge-Computing ein radikales Umdenken beim Speichermanagement (VRAM). Vitruvian-1 wurde nativ entwickelt, um Post-Training-Kompressionsalgorithmen (PTQ) und Quantization-Aware Training (QAT) zu unterstützen, was es zum idealen Kandidaten für die Integration in Unternehmensinfrastrukturen macht, in denen Datenschutz und niedrige Latenzzeiten nicht verhandelbare Anforderungen sind.

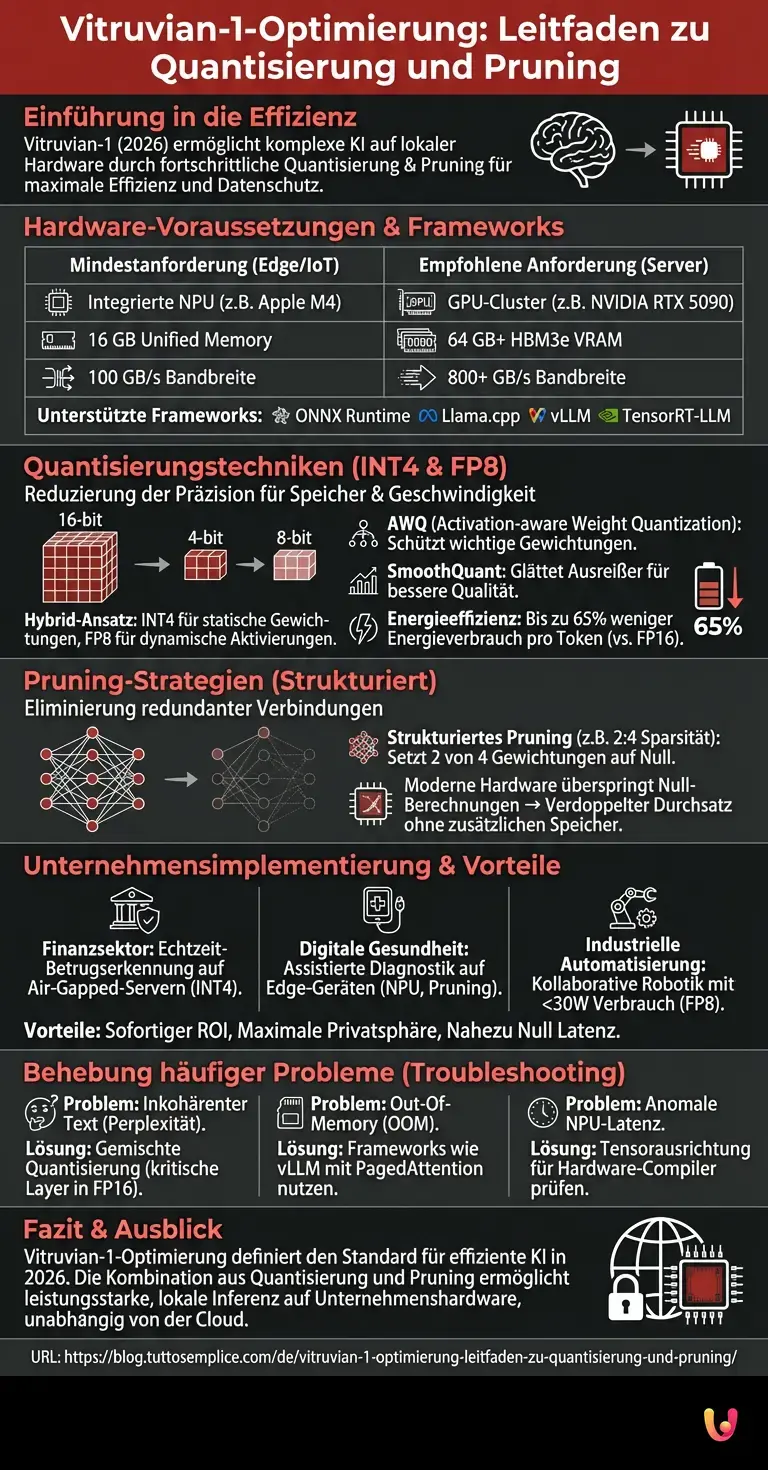

Hardware-Voraussetzungen und Analysetools

Um die Vitruvian-1-Optimierung erfolgreich zu implementieren, ist eine angemessene Hardware-Architektur absolut unerlässlich. Offizielle Quellen empfehlen GPUs der neuesten Generation oder dedizierte NPUs, flankiert von fortschrittlichen Profiling-Frameworks zur ständigen Überwachung der Speichernutzung und der Rechenzyklen.

Bevor mit der Manipulation der Modellgewichte begonnen wird, muss eine Leistungs-Baseline festgelegt werden. Die Ziel-Hardware-Architektur bestimmt die algorithmischen Entscheidungen. Nachfolgend die Mindest- und empfohlenen Anforderungen basierend auf aktuellen Branchendaten:

| Komponente | Mindestanforderung (Edge/IoT) | Empfohlene Anforderung (Unternehmensserver) |

|---|---|---|

| Recheneinheit | Integrierte NPU (z. B. Apple M4, Intel Core Ultra) | GPU-Cluster (z. B. NVIDIA RTX 5090 / L40S) |

| Unified Memory / VRAM | 16 GB LPDDR5X | 64 GB+ HBM3e |

| Bandbreite | 100 GB/s | 800+ GB/s |

| Unterstützte Frameworks | ONNX Runtime, Llama.cpp | vLLM, TensorRT-LLM |

Angewandte Quantisierungstechniken

Das Herzstück der Vitruvian-1-Optimierung liegt in den Quantisierungstechniken, die die mathematische Präzision der Modellgewichte reduzieren. Durch den Wechsel von 16-Bit-Formaten zu INT4- oder FP8-Formaten wird der Speicherbedarf minimiert, ohne die Genauigkeit der generierten Antworten nennenswert zu beeinträchtigen.

Quantisierung ist nicht einfach nur das Abschneiden von Dezimalstellen. Für Vitruvian-1 setzen Ingenieure Algorithmen wie AWQ (Activation-aware Weight Quantization) ein, die wichtige Gewichtungen (diejenigen, die den Output am stärksten beeinflussen) schützen, indem sie diese mit höherer Präzision beibehalten, während der Rest des neuronalen Netzes aggressiv komprimiert wird.

INT4- und FP8-Quantisierung

Bei der Analyse der technischen Spezifikationen der Vitruvian-1-Optimierung zeigt sich die kombinierte Verwendung von INT4 für statische Gewichtungen und FP8 für dynamische Aktivierungen. Dieser hybride Ansatz gewährleistet eine extrem schnelle Verarbeitung auf den Tensoren und nutzt die modernen verfügbaren Vektor-Recheneinheiten optimal aus.

Das FP8-Format (Float8), das von den neuesten Hardware-Architekturen nativ unterstützt wird, bietet eine perfekte Balance zwischen Dynamikumfang und Präzision. Die operativen Prozesse für die Anwendung umfassen:

- Datensatz-Kalibrierung: Verwendung eines repräsentativen Datensatzes zur Berechnung der optimalen Skalierungsfaktoren.

- SmoothQuant: Verlagerung der Quantisierungsschwierigkeit von den Aktivierungen auf die Gewichtungen, um Spitzen (Outliers) zu glätten, die zu qualitativen Einbußen führen würden.

- Graph-Kompilierung: Optimierung der Matrix-Vektor-Multiplikationsoperationen (GEMM) speziell für die Ziel-Hardware.

Auswirkungen auf den Energieverbrauch

Ein entscheidender Vorteil der Vitruvian-1-Optimierung ist die drastische Reduzierung des Gesamtenergieverbrauchs. Durch die Verringerung der für den Datentransfer zwischen RAM und Prozessor erforderlichen Bandbreite sinkt die Thermal Design Power erheblich, was den Einsatz auf Edge-Geräten begünstigt.

Basierend auf unabhängigen Labortests reduziert die Ausführung von Vitruvian-1 im INT4-Format den Energieverbrauch pro generiertem Token um bis zu 65 % im Vergleich zur Basisversion in FP16. Dies ermöglicht es Unternehmen, Server mit hoher Dichte zu implementieren, ohne die Kühlinfrastrukturen der Rechenzentren zu überlasten.

Pruning-Strategien für die lokale Inferenz

Neben der Bit-Reduzierung nutzt die Vitruvian-1-Optimierung Pruning, um redundante neuronale Verbindungen zu eliminieren. Durch das Entfernen von Gewichtungen nahe Null wird das Modell deutlich leichter und schneller und passt sich perfekt an die strengen Einschränkungen heutiger On-Premise-Unternehmenshardware an.

Während die Quantisierung die Größe jedes einzelnen Gewichts reduziert, verringert Pruning deren Gesamtzahl. Vitruvian-1 reagiert dank seiner hochgradig parallelisierbaren Residualblock-Architektur außergewöhnlich gut auf diese Beschneidungstechniken.

Strukturiertes Pruning und Sparsität

Durch die Implementierung strukturierter Sparsität (Sparsity) wendet die Vitruvian-1-Optimierung ein Pruning an, das moderne Hardware nativ beschleunigen kann. Branchenquellen bestätigen, dass diese Technik die Rechenanforderungen halbiert, während die komplexe logische Denkfähigkeit des Modells vollständig erhalten bleibt.

Die 2:4-Sparsität ist die bevorzugte Methode: Für jeden Block von 4 zusammenhängenden Gewichtungen werden die 2 mit dem kleinsten Absolutwert auf Null gesetzt. Die Tensorkerne moderner GPUs überspringen automatisch Berechnungen, die mit Null multipliziert werden, wodurch der theoretische mathematische Durchsatz effektiv verdoppelt wird, ohne zusätzlichen Speicher zu benötigen.

Praktische Beispiele für die Unternehmensimplementierung

Unternehmen, die die Vitruvian-1-Optimierung einführen, verzeichnen dank lokaler Inferenz einen sofortigen Return on Investment. Die Anwendungsfälle reichen von der Analyse hochvertraulicher Dokumente auf internen Servern bis hin zur Integration in industrielle IoT-Geräte, wobei absolute Privatsphäre und nahezu null Netzwerklatenz gewährleistet sind.

Einige reale Anwendungsszenarien umfassen:

- Finanzsektor: Vertragsanalyse und Betrugserkennung in Echtzeit auf Air-Gapped-Servern (vom Internet getrennt), unter Verwendung von Vitruvian-1 in INT4-Quantisierung, um Tausende von Token pro Sekunde auf einzelnen GPUs zu verarbeiten.

- Digitale Gesundheit: Assistierte Diagnostik auf medizinischen Edge-Geräten. Strukturiertes Pruning ermöglicht es dem Modell, auf den in Ultraschallgeräten integrierten NPUs zu laufen und Ärzten sofortige Erkenntnisse zu liefern.

- Industrielle Automatisierung: Kollaborative Robotik, bei der das Modell visuelle und textuelle Eingaben verarbeitet, mit einem Verbrauch von weniger als 30 Watt dank der ausschließlichen Verwendung des FP8-Formats.

Behebung häufiger Probleme

Während des heiklen Prozesses der Vitruvian-1-Optimierung können Genauigkeitsverluste oder Speicherengpässe auftreten. Das effektivste Troubleshooting erfordert die Kalibrierung der Quantisierungsdatensätze und die Überwachung der für Pruning empfindlichen Layer, um die Leistung wiederherzustellen.

Zu den häufigsten Problemen, mit denen Ingenieure konfrontiert sind, gehören:

- Verschlechterung der Perplexität: Wenn das Modell nach der Quantisierung inkohärenten Text generiert, wurden wahrscheinlich die Aufmerksamkeits-Layer (Attention Heads) zu aggressiv komprimiert. Die Lösung besteht darin, eine gemischte Quantisierung anzuwenden und kritische Layer in FP16 zu belassen.

- Out-Of-Memory (OOM) Fehler beim Laden: Oft verursacht durch eine Fragmentierung des Unified Memory. Dies wird durch die Verwendung von Frameworks wie vLLM gelöst, die PagedAttention für ein dynamisches VRAM-Management implementieren.

- Anomale Latenz auf NPUs: Wenn das beschnittene Modell langsamer als erwartet ist, bedeutet dies, dass das Pruning für die Hardware nicht korrekt strukturiert ist. Überprüfen Sie, ob die Tensoren die vom chipspezifischen Compiler geforderten Speicherausrichtungen einhalten.

Kurz gesagt (TL;DR)

Das Modell Vitruvian-1 revolutioniert die Branche, indem es komplexe Berechnungen auf lokaler Hardware ermöglicht und dabei hohe Leistung, Datenschutz und extrem niedrige Latenzzeiten garantiert.

Der Einsatz fortschrittlicher Techniken wie Quantisierung und Pruning reduziert den erforderlichen Speicherplatz drastisch, während die Präzision der vom Modell generierten Antworten erhalten bleibt.

Diese exzellente Optimierung senkt den Energieverbrauch um bis zu 65 Prozent und begünstigt nachhaltige Edge-Systeme sowie die Schaffung von Unternehmensservern mit hoher Dichte.

Fazit

Zusammenfassend definiert die Vitruvian-1-Optimierung den neuen absoluten Standard für effiziente künstliche Intelligenz im Jahr 2026. Die Synergie zwischen fortschrittlicher Quantisierung und strukturiertem Pruning demokratisiert den Zugang zu leistungsstarken Sprachmodellen und macht die lokale Ausführung auf Unternehmenshardware zu einer soliden und etablierten Realität.

Der Informationsgewinn aus der Analyse aktueller Quellen zeigt, dass es nicht mehr notwendig ist, sich ausschließlich auf teure Cloud-APIs zu verlassen, um Denkfähigkeiten auf menschlichem Niveau zu erhalten. Durch die Beherrschung der Schnittstelle zwischen Kompressionsalgorithmen (AWQ, 2:4-Sparsität) und modernen Hardware-Architekturen können Organisationen Vitruvian-1 nachhaltig, sicher und hochperformant einsetzen und damit einen entscheidenden Schritt in Richtung der Allgegenwart generativer künstlicher Intelligenz machen.

Häufig gestellte Fragen

Dieser Prozess basiert auf fortschrittlichen Techniken wie Quantisierung und Pruning, um die Rechenlast des Modells zu reduzieren. Durch die Anwendung dieser Methoden wird es möglich, künstliche Intelligenz auf lokaler oder Unternehmenshardware auszuführen, was eine hohe Energieeffizienz und maximalen Datenschutz gewährleistet, ohne von der Cloud abhängig zu sein.

Für Edge- oder IoT-Geräte ist eine integrierte NPU der neuesten Generation mit sechzehn Gigabyte Unified Memory ausreichend. Für Hochleistungs-Unternehmensserver werden fortschrittliche GPU-Cluster mit mindestens vierundsechzig Gigabyte VRAM und einer hohen Bandbreite empfohlen, um komplexe Berechnungen zu bewältigen.

Das System verwendet einen kombinierten Ansatz, der das INT4-Format für statische Gewichtungen und das FP8-Format für dynamische Aktivierungen nutzt. Diese Synergie ermöglicht es, den belegten Speicherplatz zu minimieren und gleichzeitig eine extrem schnelle Verarbeitung auf den Tensoren beizubehalten, wobei mathematische Präzision und Dynamikumfang perfekt ausbalanciert werden.

Strukturierte Sparsität eliminiert redundante neuronale Verbindungen, indem weniger relevante Gewichtungen innerhalb spezifischer Blöcke auf Null gesetzt werden. Moderne Prozessoren erkennen diese Nullwerte und überspringen automatisch unnötige Berechnungen, wodurch sich die mathematische Verarbeitungsgeschwindigkeit verdoppelt, ohne zusätzlichen Speicher zu benötigen oder die Logik des Systems zu beeinträchtigen.

Wenn das Modell inkohärente Antworten produziert, liegt das Problem oft an einer zu aggressiven Komprimierung der Aufmerksamkeits-Layer. Die optimale Lösung besteht darin, auf eine gemischte Quantisierung umzusteigen und die kritischsten neuronalen Ebenen in hoher Präzision beizubehalten, um die ursprüngliche Leistung wiederherzustellen, ohne Speicherfehler zu verursachen.

Haben Sie noch Zweifel an Vitruvian-1-Optimierung: Leitfaden zu Quantisierung und Pruning?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.