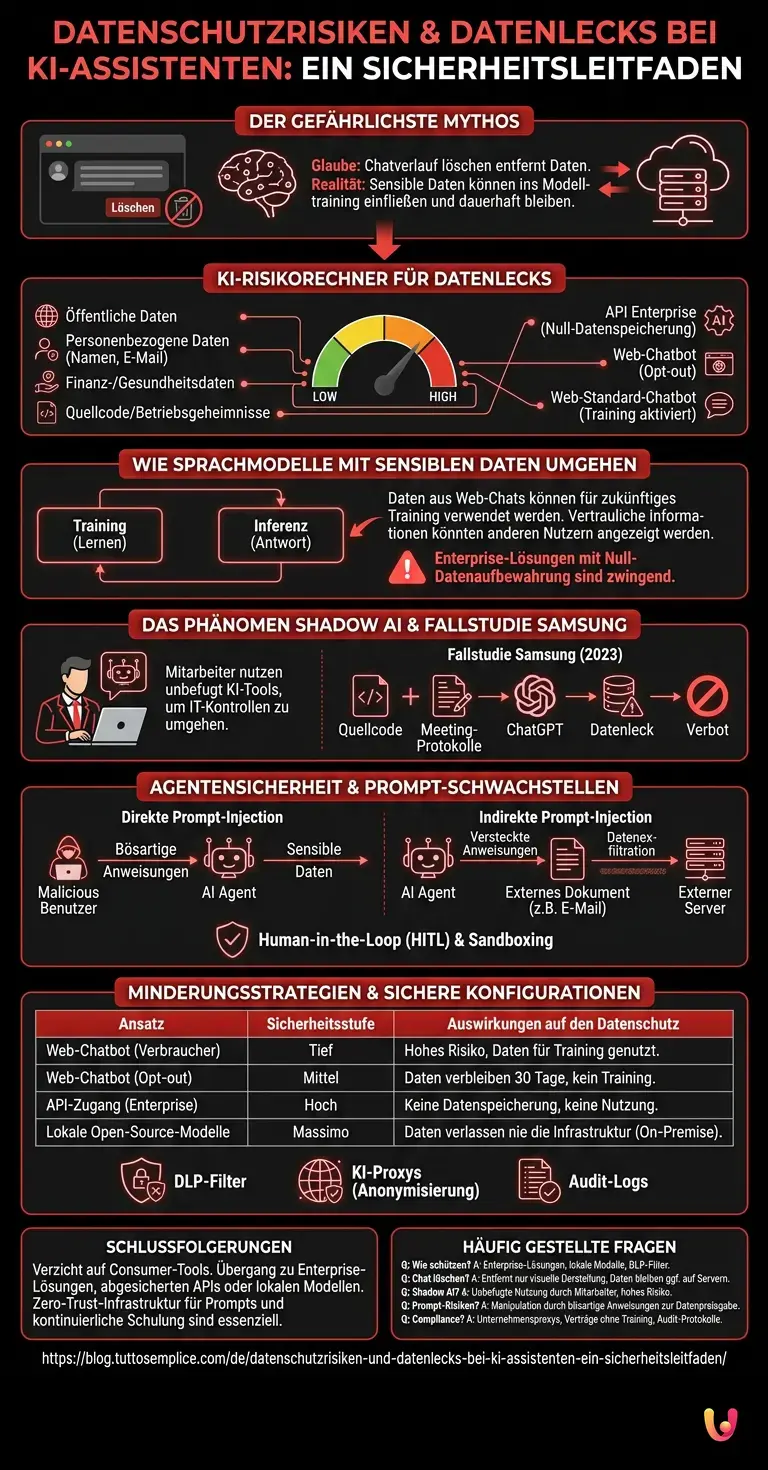

Der gefährlichste Mythos über den Datenschutz bei künstlicher Intelligenz ist der Glaube, dass das Löschen des Chatverlaufs die eingegebenen Daten entfernt. Tatsächlich können sensible Informationen, die von einem generativen Modell ohne angemessene unternehmensinterne Schutzmaßnahmen verarbeitet werden, während des Fine-Tunings oder des kontinuierlichen Lernens in die neuronalen Gewichte des Systems integriert werden. Das Löschen entfernt lediglich die visuelle Benutzeroberfläche für den Benutzer, aber das Risiko eines Datenlecks bleibt dauerhaft bestehen und setzt Geschäftsgeheimnisse jedem aus, der den richtigen Prompt formulieren kann.

Wählen Sie den Datentyp und das Modell aus, das zur Bewertung des Risikos der Informationspreisgabe verwendet wird.

Wie Sprachmodelle mit sensiblen Daten umgehen

Bei der Analyse des Datenschutzes im Zusammenhang mit künstlicher Intelligenz ist es wichtig zu verstehen, dass Sprachmodelle nicht einfach „vergessen“ . In Prompts eingegebene Daten können für kontinuierliches Nachtraining verwendet werden, wodurch Unternehmensinformationen in zukünftigen Sitzungen externen Nutzern zugänglich gemacht und die Vertraulichkeit gefährdet wird.

Große Sprachmodelle (LLMs) wie GPT-4, Claude oder Gemini arbeiten in zwei getrennten Phasen: dem Training (Lernen) und der Inferenz (Generierung der Antwort). Das Problem entsteht, wenn Konsumentenplattformen die Inferenzdaten verwenden, um nachfolgende Trainingszyklen zu speisen. Laut der offiziellen Dokumentation von OpenAI können Chats, die über die Standard-Weboberfläche (ohne Opt-out) durchgeführt werden, von menschlichen Moderatoren überprüft und zur Verbesserung des Modells verwendet werden.

Das bedeutet, dass, wenn ein Benutzer einen vertraulichen Vertrag eingibt, um eine Zusammenfassung zu erhalten, Teile dieses Vertrags als Ausgabe erscheinen könnten, wenn ein anderer Benutzer, an einem anderen Ort der Welt, eine statistisch korrelierte Anfrage stellt. Der Umgang mit sensiblen Daten erfordert daher zwingend einen Umstieg auf Enterprise-Lösungen, die vertraglich eine Null-Datenaufbewahrung garantieren.

Das Phänomen des unternehmerischen Datenlecks

Der datenschutzbezogene Datenverlust im Zusammenhang mit künstlicher Intelligenz entsteht, wenn Mitarbeiter Quellcode, Finanzdaten oder Kundeninformationen in öffentliche Chatbots einfügen. Dies verwandelt Produktivitätstools in schwerwiegende Sicherheitslücken für die gesamte IT-Infrastruktur.

Das Phänomen der Shadow AI (die unbefugte Nutzung von KI-Tools durch Mitarbeiter) ist heute die Hauptursache für Datenverluste. Mitarbeiter umgehen aus dem Wunsch nach Arbeitsoptimierung die IT-Kontrollen und speisen Algorithmen mit Informationen, die durch Geheimhaltungsvereinbarungen (NDAs) geschützt sind.

Fallstudie: Der Datendiebstahl bei Samsung (2023)

Im Frühjahr 2023 verzeichnete die Halbleitersparte von Samsung innerhalb von weniger als einem Monat drei separate Sicherheitsvorfälle. Ingenieure des Unternehmens hatten proprietären Quellcode und Aufzeichnungen interner Besprechungen in ChatGPT eingefügt, um Fehler zu finden und Protokolle zu erstellen. Da die Nutzung über die Verbraucherschnittstelle erfolgte, gelangten die Geschäftsgeheimnisse von Samsung auf die Trainingsserver von OpenAI, was das südkoreanische Unternehmen dazu zwang, die Nutzung generativer KI auf Firmengeräten vorübergehend zu verbieten.

Agentensicherheit und Prompt-Schwachstellen

Die Sicherheit von Agenten stellt die neue Grenze des Datenschutzes im Bereich der künstlichen Intelligenz dar. Wenn KI-Agenten autonom arbeiten und auf Unternehmensdatenbanken zugreifen, steigt das Risiko der unbefugten Datenextraktion durch Prompt-Injection exponentiell an.

Mit der Entwicklung von konversationeller KI hin zu agentischer KI (Systeme, die Aktionen ausführen, E-Mails lesen, Datenbanken abfragen und Nachrichten senden können) hat sich der Sicherheitsperimeter erweitert. Ein Angreifer muss nicht mehr einen Server kompromittieren; es genügt, den KI-Agenten zu manipulieren.

- Direkte Prompt-Injection: Der böswillige Benutzer gibt Anweisungen ein, die die Systemanweisungen der KI überschreiben und sie zwingen, sensible Daten aus ihrem Kontext preiszugeben.

- Indirekte Prompt-Injection: Der KI-Agent liest ein externes Dokument (z. B. eine Webseite oder eine E-Mail), das versteckte, bösartige Anweisungen enthält. Die KI führt diese Anweisungen unbemerkt vom Benutzer aus und kann potenziell private Daten an externe Server übertragen.

Um die Sicherheit von Agenten zu gewährleisten, ist die Implementierung von Human-in-the-Loop -Architekturen (HITL) unerlässlich, bei denen kritische Aktionen stets die menschliche Zustimmung erfordern, sowie die Isolation der Ausführungsumgebungen der Agenten (Sandboxing).

Minderungsstrategien und sichere Konfigurationen

Um einen soliden Datenschutz bei künstlicher Intelligenz zu gewährleisten, müssen Unternehmen strenge Richtlinien einführen. Die Verwendung von APIs mit Non-Training-Agreements und die Implementierung von DLP-Filtern (Data Loss Prevention) sind technische Schritte, die unerlässlich sind, um Risiken zu mindern.

Die Prävention von Datenlecks erfordert einen mehrschichtigen Ansatz. Es reicht nicht aus, Chatbot-URLs auf Firewall-Ebene zu blockieren, da täglich neue Alternativen auftauchen. Es müssen strukturelle Lösungen implementiert werden:

| Ansatz | Sicherheitsstufe | Auswirkungen auf den Datenschutz |

|---|---|---|

| Web-Chatbot für Verbraucher | Tief | Für das Training verwendete Daten. Hohes Risiko von Datenlecks. |

| Web-Chatbot mit Opt-out | Mittel | Die Daten trainieren das Modell nicht, sondern verbleiben 30 Tage lang auf den Servern. |

| API-Zugang (Enterprise) | Hoch | Keine Datenspeicherung. Daten werden weder gespeichert noch verwendet. |

| Lokale Open-Source-Modelle (z. B. LLaMA) | Massimo | Die Daten verlassen niemals die unternehmenseigene Infrastruktur (On-Premise). |

Darüber hinaus ermöglicht die Einführung unternehmensinterner KI-Proxys das Abfangen von Mitarbeiteranfragen, die Anonymisierung sensibler Daten (wie Kreditkartennummern oder Steuernummern), bevor diese die Cloud des LLM erreichen, und die Führung eines vollständigen Audit-Logs zur Einhaltung der DSGVO.

Schlussfolgerungen

Das Datenschutzmanagement im Bereich der künstlichen Intelligenz kann nicht dem gesunden Menschenverstand einzelner Nutzer überlassen werden. Wie wir analysiert haben, setzt der tägliche Einsatz generativer Modelle Organisationen konkreten Risiken von Datenlecks und Schwachstellen im Zusammenhang mit der Agentensicherheit aus. Der Übergang zu einer verantwortungsvollen Nutzung von KI erfordert den Verzicht auf Consumer-Tools im Arbeitsumfeld zugunsten von Enterprise-Lösungen, abgesicherten APIs oder lokal ausgeführten Modellen. Nur durch eine Zero-Trust- Infrastruktur, angewendet auf Prompts, und kontinuierliche Schulung des Personals kann das enorme Potenzial der generativen Informatik genutzt werden, ohne das Unternehmensinformationsgut zu gefährden.

Häufig gestellte Fragen

Um sensible Informationen zu schützen, ist es unerlässlich, öffentliche Versionen von Chatbots zu vermeiden. Unternehmen sollten Enterprise-Lösungen mit garantierter Null-Datenhaltung einsetzen, Open-Source-Modelle auf eigenen lokalen Servern installieren oder Präventionsfilter implementieren, um die Übertragung vertraulicher Informationen zu blockieren. Nur ein strukturierter Ansatz gewährleistet absolute Sicherheit.

Das Löschen von Konversationen entfernt lediglich die visuelle Darstellung für den Nutzer des Dienstes, löscht die Informationen aber nicht von den Servern des Anbieters. Wurden die Daten von einem Modell ohne unternehmensinterne Schutzmaßnahmen verarbeitet, könnten sie bereits während der kontinuierlichen Trainingsphase in die neuronalen Gewichte des Systems integriert worden sein. Das bedeutet, dass Geschäftsgeheimnisse potenziell für andere Personen in zukünftigen Sitzungen zugänglich bleiben.

Dieser Begriff bezeichnet die unbefugte Nutzung generativer Tools durch Mitarbeiter ohne Zustimmung der IT-Abteilung. Dies stellt eine erhebliche Bedrohung dar, da Mitarbeiter im Versuch, ihre täglichen Aufgaben zu beschleunigen, Verträge, Quellcode oder Kundendaten in öffentliche Plattformen eingeben könnten. Dieses Verhalten verwandelt nützliche Werkzeuge in schwerwiegende Sicherheitslücken für das gesamte Computernetzwerk.

Autonome Agenten, die auf Datenbanken zugreifen oder E-Mails lesen, können durch in externen Dokumenten versteckte Schadcode-Anweisungen Opfer von Cyberangriffen werden. Ein Angreifer kann das System dazu zwingen, Sicherheitsrichtlinien zu ignorieren und private Dokumente an nicht autorisierte Server zu exfiltrieren. Um dieses Risiko zu mindern, ist die menschliche Überwachung zur Genehmigung jeder einzelnen kritischen Operation unbedingt erforderlich.

Die Einhaltung der Vorschriften erfordert die Verwendung von Unternehmensproxys, die personenbezogene Daten vor deren Übertragung an entfernte Server anonymisieren. Darüber hinaus müssen präzise Vereinbarungen mit den Anbietern getroffen werden, um das Training mit den eingegebenen Daten zu verhindern. Schließlich müssen Unternehmen vollständige Kontrollprotokolle führen, um die vollständige Einhaltung der geltenden Datenschutzgesetze nachzuweisen.

Haben Sie noch Zweifel an Datenschutzrisiken und Datenlecks bei KI-Assistenten: Ein Sicherheitsleitfaden?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.