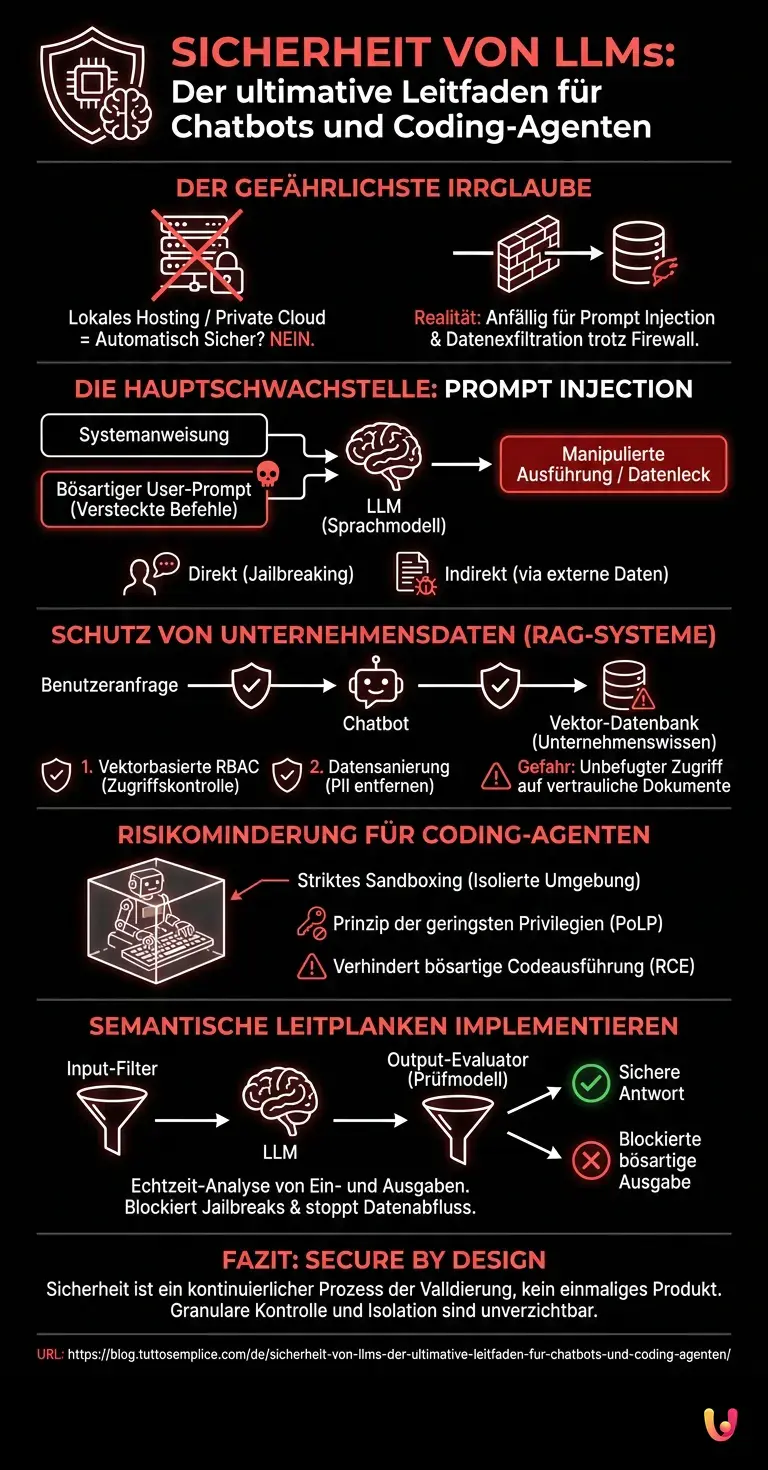

Der gefährlichste Irrglaube in der Welt der unternehmensweiten künstlichen Intelligenz ist die Annahme, dass das lokale Hosten eines Modells (On-Premise) oder die Verwendung einer privaten Cloud-Instanz automatisch die Sicherheit von LLMs gewährleistet. Die Realität sieht brutal anders aus: Ein isoliertes Modell kann, wenn es über RAG (Retrieval-Augmented Generation) mit einem Coding-Agenten oder einer Unternehmensdatenbank verbunden ist, durch Prompt Injection manipuliert werden, um sensible Daten zu exfiltrieren oder bösartigen Code auszuführen und dabei herkömmliche Firewalls vollständig zu umgehen. Der wahre Schutz liegt nicht im Netzwerkperimeter, sondern in der rigorosen Validierung der Ein- und Ausgaben des Modells selbst.

Bewerten Sie das Risikoniveau Ihrer KI-Implementierung.

Architektur und Anfälligkeit von Sprachmodellen

Das Verständnis der grundlegenden Architektur ist der erste Schritt zur Gewährleistung der Sicherheit von LLMs . Sprachmodelle verarbeiten natürliche Sprache, aber ihre inhärente Unfähigkeit, zwischen Systemanweisungen und Benutzereingaben zu unterscheiden, schafft kritische Schwachstellen, insbesondere bei Unternehmens-Chatbots.

Große Sprachmodelle (LLMs) sind im Grunde probabilistische Vorhersagemotoren. Wenn wir ein LLM in eine Unternehmensanwendung integrieren, setzen wir es einzigartigen Angriffsvektoren aus. Laut der offiziellen OWASP Top 10 Dokumentation für LLMs ist die Hauptschwachstelle die Prompt-Injection . Diese tritt auf, wenn ein Angreifer versteckte Anweisungen in den Prompt einfügt, die die ursprünglichen Systemanweisungen überschreiben.

Es gibt zwei Hauptvarianten dieser Bedrohung:

- Direkte Prompt-Injection (Jailbreaking): Der Benutzer manipuliert den Chatbot direkt, um ihn dazu zu bringen , die Sicherheitsregeln zu ignorieren .

- Indirekte Prompt-Injection: Das LLM nimmt Daten aus einer kompromittierten externen Quelle (z. B. einer Webseite oder E-Mail) auf, die versteckte schädliche Anweisungen enthalten, wodurch das Verhalten des Agenten beeinflusst wird.

Schutz von Unternehmensdaten in RAG-Systemen

In RAG-Systemen hängt die Sicherheit des LLM von einer strengen Verwaltung der Zugriffsberechtigungen ab. Wenn ein Chatbot eine Unternehmensdatenbank ohne granulare Autorisierungsfilter abfragt, besteht die Gefahr, dass vertrauliche Dokumente durch Kontextmanipulationsangriffe für nicht autorisierte Benutzer zugänglich werden.

Die Retrieval-Augmented Generation (RAG)-Architektur ist der De-facto-Standard, um KI-Modellen Zugriff auf proprietäre Daten zu ermöglichen. Die Vektordatenbank, die RAG antreibt, wird jedoch zu einem Hauptangriffsziel. Wenn ein Mitarbeiter den Chatbot fragt: „Fasse meine Quartalsziele zusammen“, muss das System sicherstellen, dass das LLM nur Dokumente abruft und verarbeitet, auf die dieser Mitarbeiter explizit Zugriff hat.

Um das Risiko von Datenlecks zu mindern, ist die Implementierung folgender Maßnahmen unerlässlich:

| Sicherheitsmaßnahme | Beschreibung | Auswirkungen auf das Risiko |

|---|---|---|

| Vektorbasierte RBAC | Die Ergebnisse der semantischen Suche anhand der Benutzerberechtigungen filtern, bevor sie an das LLM gesendet werden. | Hoch |

| Datensanierung | PII (personenbezogene Daten) vor dem Einbetten aus den Dokumenten entfernen. | Kritisch |

| Abfrageprüfung | Benutzeranfragen protokollieren und analysieren, um anomale Muster oder Exfiltrationsversuche zu erkennen. | Mittel |

Risiken und Risikominderung für Coding-Agenten

Bei der Implementierung von Programmierassistenten erfordert die Sicherheit von LLMs die Isolation der Ausführungsumgebung. Autonome Coding-Agenten können bösartigen Code generieren oder ausführen, wenn sie nicht in strengen Sandboxes ohne erhöhte Systemrechte ausgeführt werden.

Coding-Agenten (wie z. B. benutzerdefinierte Implementierungen auf Basis von Agenten-Frameworks) generieren nicht nur Text, sondern führen Aktionen aus: Sie lesen Repositorien, schreiben Dateien und führen in einigen Fällen Skripte aus. Dieses Maß an Autonomie birgt das Risiko unsicherer Plugin-Designs und nicht autorisierter Remotecodeausführung (RCE).

Wird ein Code-Agent durch ein kompromittiertes Softwarepaket (Supply-Chain-Attack) oder eine bösartige Anweisung in einem GitHub-Ticket getäuscht, könnte er den Quellcode des Unternehmens verändern. Die goldene Regel ist das Prinzip der geringsten Privilegien (PoLP): Der Agent muss in flüchtigen Containern arbeiten, ohne unüberwachten Internetzugang und ohne hartcodierte API-Schlüssel.

Fallstudie: Das Samsung-Datenleck (2023)

Im Jahr 2023 fügten Ingenieure von Samsung versehentlich proprietären Quellcode und interne Besprechungsprotokolle in ChatGPT ein, um Hilfe bei der Fehlerbehebung und Formatierung zu erhalten. Da die in öffentliche Modelle eingegebenen Daten oft zum erneuten Training verwendet werden, gelangten diese hochsensiblen Informationen aus dem Unternehmensbereich. Dies zwang das Unternehmen dazu, die Nutzung öffentlicher generativer KI-Tools vorübergehend zu verbieten und die Entwicklung sicherer interner Lösungen zu beschleunigen.

Sicherheitsleitplanken und Sicherheitsfilter implementieren

Die Implementierung semantischer Guardrails ist eine grundlegende Best Practice für die Sicherheit von LLMs . Diese Zwischenfilter analysieren sowohl eingehende Prompts als auch ausgehende Antworten in Echtzeit, blockieren Jailbreak-Versuche und verhindern das Austreten sensibler Informationen.

Herkömmliche, auf Netzwerkregeln basierende Firewalls sind gegen semantische Bedrohungen wirkungslos. Es muss eine spezifische Anwendungssicherheitsebene für KI implementiert werden. Open-Source-Tools wie NeMo Guardrails oder proprietäre Frameworks ermöglichen die Definition strenger Betriebsgrenzen.

Eine robuste Sicherheitsarchitektur sieht ein „Bewertungsmodell“ (oft ein kleineres und schnelleres LLM) vor, das die Ausgabe des Hauptmodells überprüft, bevor sie dem Benutzer angezeigt wird. Stellt der Bewerter fest, dass die Ausgabe schädlichen Code, nicht autorisierte Finanzdaten oder unangemessene Sprache enthält, blockiert er die Transaktion und gibt eine standardisierte Fehlermeldung zurück.

Schlussfolgerungen

Zusammenfassend lässt sich sagen, dass die Sicherheit von LLMs kein Produkt ist, das man kauft, sondern ein kontinuierlicher Prozess der Validierung und Überwachung. Der Schutz von Chatbots und Code-Assistenten erfordert einen ganzheitlichen Ansatz, der infrastrukturelle Abwehrmaßnahmen, semantische Filter und die Schulung von Entwicklern umfasst.

Die Integration von künstlicher Intelligenz in Unternehmensabläufe bietet unschätzbare Wettbewerbsvorteile, erweitert aber gleichzeitig die Angriffsfläche dramatisch. Die Unternehmen, die im Zeitalter der generativen KI erfolgreich sein werden, sind diejenigen, die in der Lage sind, „Secure by Design“-Architekturen zu implementieren, bei denen die Validierung von Eingaben, das Sandboxing von Agenten und die granulare Kontrolle des Datenzugriffs (RAG) als unverzichtbare funktionale Anforderungen betrachtet werden und nicht als nachträgliche Ergänzungen.

Häufig gestellte Fragen

Um KI-Systeme vor externen Manipulationen zu schützen, ist die Implementierung fortschrittlicher semantischer Filter und Kontrollmechanismen unerlässlich. Diese Werkzeuge analysieren die Benutzeranfragen und die generierten Antworten in Echtzeit und blockieren jegliche Versuche, die Systemrichtlinien zu umgehen. Darüber hinaus ist eine strikte Trennung der grundlegenden Anweisungen von den vom Benutzer bereitgestellten Daten unerlässlich.

Viele Unternehmen glauben fälschlicherweise, dass die Unterbringung von Servern innerhalb ihres eigenen Netzwerkbereichs jegliche Cyberbedrohung beseitigt. Tatsächlich bleibt ein isoliertes System anfällig, wenn es mit Unternehmensdatenbanken oder Entwicklungstools verbunden ist, da semantische Angriffe legitime Eingabekanäle ausnutzen können, um vertrauliche Informationen zu extrahieren. Echter Schutz erfordert eine kontinuierliche Validierung der vom Modell verarbeiteten Daten.

Programmierassistenten verfügen über ein hohes Maß an Autonomie, das es ihnen erlaubt, Archive zu lesen, Dateien zu bearbeiten und operative Skripte auszuführen. Ohne angemessene Einschränkungen könnte ein kompromittiertes Softwarepaket oder eine einfache bösartige Anweisung das System dazu veranlassen, schädliche Befehle auf dem Hostsystem auszuführen. Um dieses Risiko zu mindern, ist es unerlässlich, diese Ressourcen in isolierten Umgebungen einzuschränken und das Prinzip der geringsten Privilegien anzuwenden.

Der Schutz proprietärer Informationen in diesen Architekturen basiert auf einer extrem granularen Verwaltung der Zugriffsberechtigungen. Bevor die Ergebnisse einer semantischen Suche an die generative Engine gesendet werden, muss das System überprüfen, ob der Mitarbeiter über die erforderlichen Rechte verfügt, um diese spezifischen Dokumente einzusehen. Es ist außerdem entscheidend, sensible personenbezogene Daten vor der Indizierung zu entfernen, um Informationslecks zu verhindern.

Es handelt sich um anwendungsspezifische Sicherheitsbarrieren, die speziell für Modelle der natürlichen Sprachverarbeitung entwickelt wurden und die Grenzen klassischer Netzwerk-Firewalls überwinden. Ihre Hauptaufgabe besteht darin, den Gesprächsfluss kontinuierlich zu überwachen, um unangemessene Inhalte, bösartigen Code oder Versuche des Diebstahls von Finanzdaten zu erkennen und zu blockieren. Sie funktionieren oft über ein sekundäres Bewertungsmodell, das Transaktionen innerhalb von Millisekunden genehmigt oder ablehnt.

Haben Sie noch Zweifel an Sicherheit von LLMs: Der ultimative Leitfaden für Chatbots und Coding-Agenten?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

- Prompt Engineering und Prompt Injection – Risiken und Schwachstellen (Wikipedia)

- AI Risk Management Framework – KI-Risikomanagement (National Institute of Standards and Technology, US-Regierung)

- Richtlinien für die sichere Entwicklung von KI-Systemen (National Cyber Security Centre, UK-Regierung)

- Richtlinien für die sichere Entwicklung von KI-Systemen (NCSC & internationale Partner, inkl. CISA)

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.