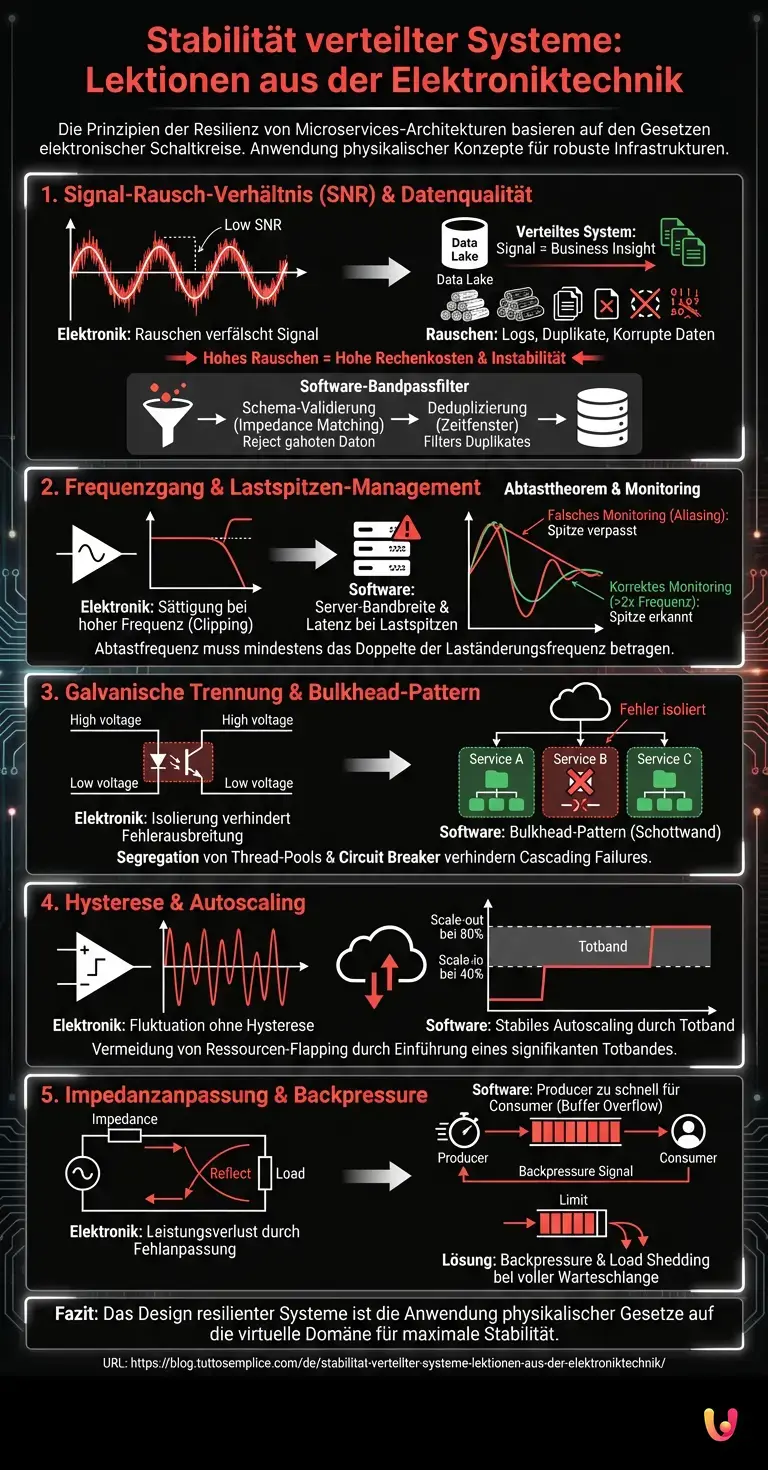

In der heutigen Cloud-Computing-Landschaft wird die Stabilität verteilter Systeme oft als reines Softwareproblem behandelt, das durch Container-Orchestrierung oder Retry-Policies gelöst werden kann. Es gibt jedoch eine fundamentale Wahrheit, die oft übersehen wird: Die Prinzipien, die die Resilienz einer Microservices-Architektur bestimmen, sind dieselben, die die Stabilität analoger und digitaler elektronischer Schaltkreise regeln. In diesem technischen Leitfaden verlassen wir kurz die Abstraktion der Software, um zu den Grundprinzipien der Technik zurückzukehren und zu zeigen, wie Konzepte wie das Signal-Rausch-Verhältnis (SNR), der Frequenzgang und die galvanische Trennung die wahren Schlüssel zum Aufbau resilienter Infrastrukturen sind.

1. Das Signal-Rausch-Verhältnis (SNR) und die Datenqualität

In der Elektronik misst das Signal-Rausch-Verhältnis (SNR) die Leistung eines Nutzsignals im Vergleich zum Hintergrundrauschen, das es verfälscht. Ein niedriges SNR in einem Audioverstärker führt zu einem unerträglichen Rauschen. In verteilten Systemen, insbesondere in datenorientierten Architekturen (Data Lakes, Event Streaming), ist das Konzept identisch.

Definition von Rauschen in verteilten Systemen

In einem Data Lake ist das “Signal” die verwertbare Information (Business Insight), während das “Rauschen” besteht aus:

- Ausführlichen und unstrukturierten Logs.

- Duplizierten Ereignissen, die durch schlecht konfigurierte Retry-Policies (At-Least-Once-Delivery) erzeugt werden.

- Korrupten oder unvollständigen Daten aufgrund von Race Conditions.

Wenn das Volumen dieser Stördaten (Noise Floor) zunimmt, steigen die Rechenkosten zur Extraktion des Werts (Signal) exponentiell an, was die Stabilität verteilter Systeme aufgrund übermäßiger I/O- und CPU-Last, die für das Filtern des Nutzlosen verschwendet wird, beeinträchtigt.

Praktische Anwendung: Software-Bandpassfilter

Um das SNR zu verbessern, müssen wir das Software-Äquivalent eines elektronischen Filters anwenden:

- Validierung am Schema (Impedance Matching): Ablehnung von Daten am Eingang (Ingestion Layer), wenn sie nicht strikten Schemata entsprechen (z. B. Avro oder Protobuf), ähnlich wie ein Schaltkreis Frequenzen außerhalb des Bandes abweist.

- Deduplizierung an der Quelle: Verwendung von Zeitfenstern (Tumbling/Sliding Windows) in Stream-Prozessoren wie Apache Flink, um das Rauschen von Duplikaten zu eliminieren, bevor sie den Cold Storage erreichen.

2. Frequenzgang und Management von Lastspitzen

Jeder elektronische Schaltkreis hat einen Frequenzgang: Er reagiert gut bis zu einer bestimmten Änderungsgeschwindigkeit des Signals, jenseits derer er den Ausgang dämpft oder instabil wird. Ein Webserver ist nicht anders.

Analyse der Server-Bandbreite

Stellen wir uns einen Microservice als einen Verstärker mit begrenzter Bandbreite vor. Wenn die Anfragen (Input Signal) mit einer Frequenz eintreffen, die höher ist als die Verarbeitungskapazität des Systems (Cutoff Frequency), tritt ein Sättigungsphänomen auf. In der Elektronik führt dies zum Clipping des Signals; in der Software führt es zu erhöhter Latenz und Timeouts bei Anfragen.

Das Abtasttheorem und das Monitoring

Um die Stabilität zu wahren, muss das Monitoring-System das Nyquist-Shannon-Abtasttheorem einhalten. Wenn der Verkehr auf Ihren Servern Spitzen (Transienten) aufweist, die 500ms dauern, Ihr Monitoring-System die CPU aber nur alle 60 Sekunden abtastet, arbeiten Sie im Aliasing: Sie werden nie die wirkliche Spitze sehen, die den Absturz verursacht hat. Um die Stabilität verteilter Systeme zu gewährleisten, muss die Abtastfrequenz kritischer Metriken mindestens das Doppelte der maximal erwarteten Laständerungsfrequenz betragen.

3. Galvanische Trennung und das Bulkhead-Pattern

In der Elektroniktechnik ist die galvanische Trennung (durch Optokoppler oder Transformatoren) entscheidend, um zwei Teile eines Schaltkreises zu trennen und zu verhindern, dass sich ein katastrophaler Fehler (z. B. ein Kurzschluss bei Hochspannung) auf die Steuerlogik bei Niederspannung ausbreitet. Ohne diese Isolierung zerstört ein einzelner Fehler das gesamte Gerät.

Vom Schaltkreis zur Software: Das Bulkhead-Pattern

In der Cloud übersetzt sich dieses Prinzip in das Bulkhead-Pattern (Schottwand). Oft teilt sich eine monolithische oder schlecht verteilte Anwendung Thread-Pools oder Datenbankverbindungen zwischen verschiedenen Funktionen. Wenn ein langsamer externer Dienst alle Threads blockiert, die einer sekundären Funktion (z. B. E-Mail-Versand) gewidmet sind, kann das gesamte System blockieren (Cascading Failure).

Implementierung der Isolierung

Um eine “galvanische Software-Trennung” zu erreichen:

- Segregation der Thread-Pools: Zuweisung getrennter Ressourcen-Pools für jeden Downstream-Service. Wenn der Zahlungsdienst in ein Timeout läuft, erschöpft er nur seinen eigenen Pool und lässt den Rest der Anwendung (z. B. den Produktkatalog) intakt.

- Circuit Breaker: Dieses Pattern ist wörtlich nach dem Leitungsschutzschalter benannt. Wenn ein Dienst wiederholt ausfällt, “öffnet sich der Stromkreis”, verhindert weitere Aufrufe und ermöglicht dem System die Erholung (Cool-down Period), genau wie eine Sicherung vor thermischen Überlastungen schützt.

4. Hysterese und Autoscaling

Ein häufiges Problem in Regelsystemen ist das schnelle Schwingen um einen Schwellenwert. In der Elektronik wird ein Komparator ohne Hysterese wild fluktuieren, wenn das Eingangssignal verrauscht ist und nahe der Referenzschwelle liegt. In verteilten Systemen ist dies der Feind Nummer eins des Autoscalings.

Vermeidung von Ressourcen-Flapping

Wenn Sie einen Autoscaler so konfigurieren, dass er Instanzen hinzufügt, wenn die CPU 70% überschreitet, und sie entfernt, wenn sie unter 65% fällt, riskieren Sie das Phänomen des “Flapping”: Das System erstellt und zerstört kontinuierlich Container, verschwendet Ressourcen und führt Startlatenzen ein. Die Lösung besteht darin, eine signifikante Hysterese einzuführen (z. B. Scale-out bei 80%, Scale-in bei 40%), wodurch ein Totband geschaffen wird, das das Regelsystem stabilisiert, genau wie ein Schmitt-Trigger ein verrauschtes digitales Signal stabilisiert.

5. Impedanzanpassung und Backpressure

Die maximale Leistungsübertragung in einem Schaltkreis erfolgt, wenn die Impedanz der Quelle der des Verbrauchers entspricht. Bei einer Fehlanpassung (Mismatch) wird Energie reflektiert, was zu stehenden Wellen und Ineffizienz führt. In verteilten Systemen tritt diese Fehlanpassung auf, wenn ein Producer Daten schneller generiert, als der Consumer sie verarbeiten kann.

Umgang mit Mismatch durch Backpressure

Wenn dies nicht gehandhabt wird, führt diese Fehlanpassung zur Erschöpfung des Speichers (Buffer Overflow). Die technische Lösung ist Backpressure (Gegendruck). Der Consumer muss dem Producer signalisieren, langsamer zu werden, oder das System muss einen korrekt dimensionierten Puffer (Warteschlange) einführen, um transiente Spitzen zu absorbieren. Doch wie ein Kondensator eine maximale Kapazität hat, haben auch Warteschlangen (Kafka, RabbitMQ) physikalische Grenzen. Die Stabilität verteilter Systeme erfordert, dass das System bei voller Warteschlange Nachrichten kontrolliert verwirft (Load Shedding), anstatt wegen OutOfMemory abzustürzen.

Kurz gesagt (TL;DR)

Die Prinzipien der Elektroniktechnik bieten ein unverzichtbares Modell, um die Resilienz und Stabilität verteilter Softwarearchitekturen zu gewährleisten.

Die Verbesserung des Signal-Rausch-Verhältnisses durch Filtern unnötiger Daten reduziert die Rechenkosten drastisch und bewahrt die Systemleistung.

Ressourcenisolierung und häufiges Monitoring verhindern, dass sich lokale Ausfälle ausbreiten und die gesamte Cloud-Infrastruktur beeinträchtigen.

Fazit

Das Design resilienter Cloud-Systeme ist keine neue Disziplin, sondern die Anwendung physikalischer und technischer Gesetze auf eine virtuelle Domäne. Das Verständnis des Signal-Rausch-Verhältnisses hilft, Data Lakes zu bereinigen; die Anwendung der Frequenzanalyse verbessert das Monitoring; die Implementierung der galvanischen Trennung durch Bulkheads bewahrt die Infrastruktur vor Kettenreaktionen bei Ausfällen. Für einen modernen Softwarearchitekten ist der Blick auf elektronische Schaltkreise keine Nostalgieübung, sondern die rigoroseste Methode, um die Stabilität verteilter Systeme im großen Maßstab zu gewährleisten.

Häufig gestellte Fragen

Der ingenieurtechnische Ansatz wendet physikalische Konzepte wie das Signal-Rausch-Verhältnis und die galvanische Trennung auf Softwarearchitekturen an. Die Behandlung von Microservices wie Schaltkreise ermöglicht ein besseres Resilienz-Management, indem Filter für die Datenqualität und Patterns wie der Circuit Breaker verwendet werden, um Kettenausfälle zu verhindern und eine robustere und vorhersehbarere Infrastruktur zu gewährleisten.

Dieses Theorem besagt, dass die Abtastfrequenz von Metriken mindestens doppelt so hoch sein muss wie die maximale Frequenz der Laständerungen. Wenn das Monitoring die CPU im Vergleich zur Dauer transienter Spitzen zu langsam abtastet, tritt Aliasing auf, was die wahren Ursachen von Abstürzen unsichtbar macht und die Systemstabilität gefährdet.

Um das ständige Schwanken zwischen Erstellung und Zerstörung von Instanzen zu vermeiden, ist es notwendig, das Konzept der Hysterese in Regelsysteme einzuführen. Durch das Festlegen eines signifikanten Totbandes zwischen der Scale-out- und der Scale-in-Schwelle stabilisiert sich das System und verhält sich wie ein elektronischer Schmitt-Trigger, was Ressourcenverschwendung und Latenz reduziert.

Die galvanische Software-Trennung zielt darauf ab, kritische Teile einer Anwendung zu separieren, um zu verhindern, dass ein lokaler Fehler systemisch wird. Dies wird durch das Bulkhead-Pattern realisiert, das Thread-Pools für verschiedene Dienste segregiert, sowie durch den Einsatz von Circuit Breakern, die verhindern, dass die Blockierung einer sekundären Funktion die Ressourcen des gesamten verteilten Systems erschöpft.

Wenn ein Produzent Daten schneller generiert, als der Konsument sie verarbeiten kann, entsteht eine Fehlanpassung ähnlich der Impedanz in Schaltkreisen. Backpressure löst das Problem, indem dem Produzenten signalisiert wird, langsamer zu werden, oder durch das Management kontrollierter Warteschlangen; wenn der Puffer voll ist, wird Load Shedding angewendet, um den Überschuss zu verwerfen und Fehler durch erschöpften Speicher zu vermeiden.

Haben Sie noch Zweifel an Stabilität verteilter Systeme: Lektionen aus der Elektroniktechnik?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.