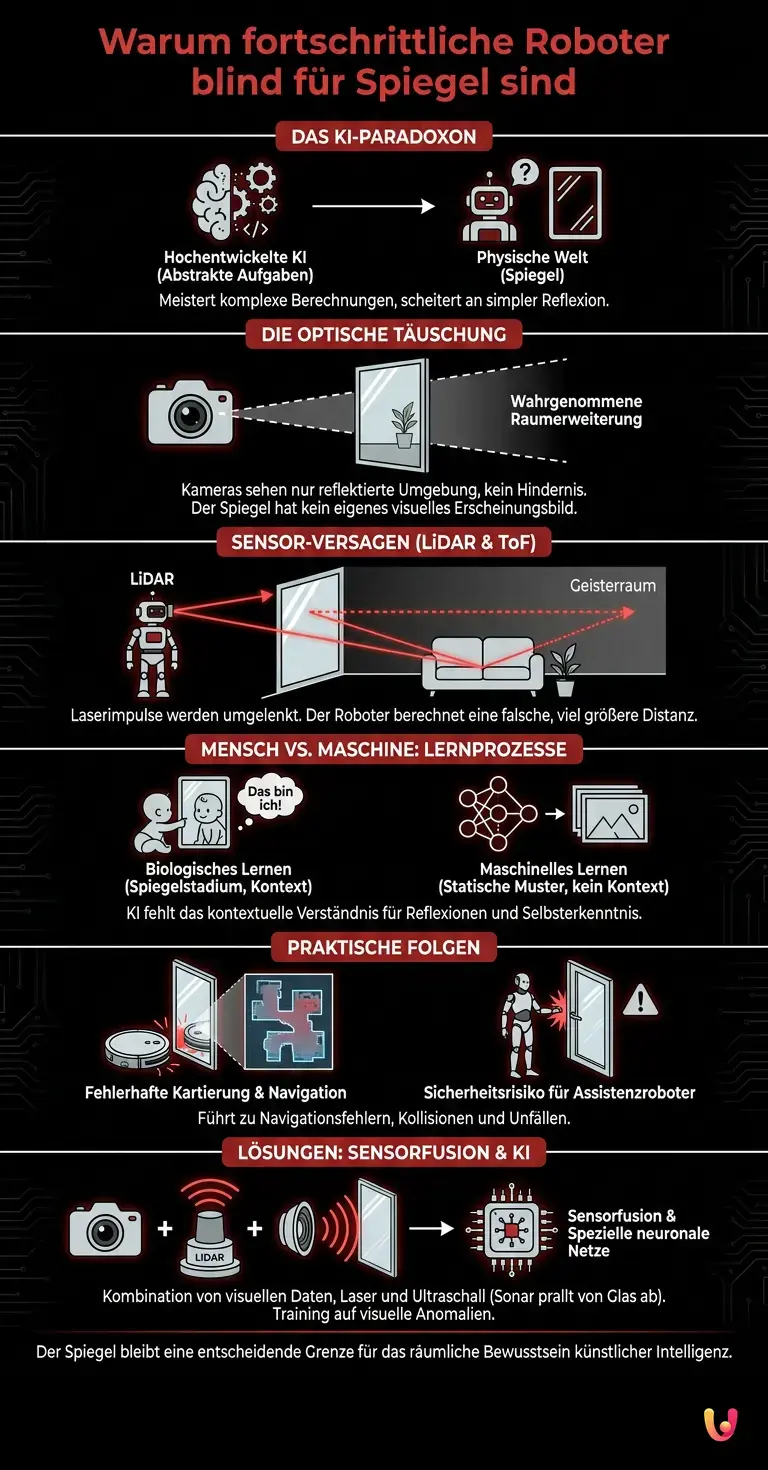

Wir leben in einer Zeit, in der die künstliche Intelligenz keine Grenzen mehr zu kennen scheint. Moderne Systeme sind in der Lage, komplexe Krankheitsbilder durch die Analyse von Röntgenaufnahmen in Sekundenbruchteilen zu diagnostizieren, Autos durch den chaotischen Verkehr von Metropolen zu steuern und sogar philosophische Gespräche zu führen. Während ein LLM (Large Language Model) wie ChatGPT makellose Abhandlungen über Quantenphysik verfassen oder fortgeschrittenen Programmcode schreiben kann, existiert auf dem Gebiet der Robotik und der künstlichen Bildverarbeitung ein faszinierendes Paradoxon. Überträgt man diese enorme Rechenleistung auf einen physischen Droiden und lässt ihn eine gewöhnliche Wohnung erkunden, so gibt es einen alltäglichen, banalen und allgegenwärtigen Gegenstand, der sein Verständnis von Raum zum Absturz bringt : den Spiegel . Dieser schlichte Einrichtungsgegenstand stellt heute einen der größten blinden Flecken für synthetische Gehirne dar.

Um die Tragweite dieser technologischen Kuriosität zu verstehen, müssen wir uns damit befassen, wie Maschinen die Welt um sie herum „sehen“ und interpretieren. Es handelt sich dabei nicht um einen einfachen Programmierfehler, sondern um eine inhärente Einschränkung, die mit der Physik des Lichts und der Natur der heutigen Modelle des maschinellen Lernens verknüpft ist. Das Rätsel des Spiegels zu lösen, bedeutet, die Technologie an eine neue Grenze des räumlichen Bewusstseins zu führen.

Die optische Täuschung, die Maschinen austrickst

Für einen Menschen ist das Erkennen einer reflektierenden Oberfläche ein nahezu instinktiver Vorgang. Unser Gehirn nutzt dabei eine Reihe visueller und kontextueller Hinweise: den Rahmen, die leichten Reflexionen auf der Glasoberfläche, die Position des Objekts (zum Beispiel über einem Waschbecken) und vor allem das Vorhandensein unseres eigenen Spiegelbildes. Für eine KI hingegen unterscheidet sich der visuelle Wahrnehmungsprozess grundlegend. Die Kameras eines Haushaltsroboters erfassen das Licht und wandeln es in ein zweidimensionales Raster aus Pixeln um, von denen jedes einen Zahlenwert besitzt, der einer bestimmten Farbe entspricht.

Wenn Algorithmen der Computer Vision dieses Raster analysieren, suchen sie nach Mustern, Kanten und Texturen, um Objekte zu identifizieren. Das grundlegende Problem eines Spiegels besteht darin, dass er kein eigenes visuelles Erscheinungsbild besitzt: Es liegt in seiner Natur, das Aussehen der Umgebung zu übernehmen. Wenn ein Roboter folglich auf einen Spiegelschrank blickt, registrieren seine optischen Sensoren kein festes Hindernis, sondern nehmen eine Erweiterung des Raumes wahr. Sie sehen einen weiteren Boden, weitere Wände und weitere Möbelstücke. Die optische Täuschung ist perfekt: Die Maschine ist davon überzeugt, dass sich dort ein offener, begehbarer Raum befindet, wo in Wirklichkeit eine Barriere aus Glas und Silber steht.

Neuronale Architektur und die Herausforderung der Tiefe

Man könnte annehmen, dass sich das Problem auf herkömmliche Kameras beschränkt und dass fortschrittliche Tiefensensoren dieses Hindernis problemlos umgehen können. Leider verkompliziert die physikalische Realität die Situation zusätzlich. Viele Systeme zur autonomen Navigation setzen auf LiDAR (Light Detection and Ranging) oder ToF-Sensoren (Time of Flight). Diese Geräte senden Laser- oder Infrarotlichtimpulse aus und messen die Zeit, die diese benötigen, um von Objekten reflektiert zu werden und zurückzukehren, wodurch die Entfernung mit äußerster Präzision berechnet wird.

Die neuronale Architektur, die diese Daten verarbeitet, stößt jedoch an die Grenzen der Optik. Wenn der Laserstrahl eines LiDAR-Systems auf einen Spiegel trifft, prallt er nicht einfach von der Oberfläche ab und kehrt zum Sensor zurück. Stattdessen wird er entsprechend dem Einfallswinkel reflektiert, durchquert den Raum, trifft auf ein reales Objekt (etwa ein Sofa hinter dem Roboter), prallt erneut vom Spiegel ab und kehrt schließlich zum Sensor zurück. Das Ergebnis? Der Roboter berechnet eine Entfernung, die doppelt oder dreimal so groß ist wie die tatsächliche Distanz. In der dreidimensionalen „Punktwolke“, die vom synthetischen Gehirn erzeugt wird, verschwindet der Spiegel vollständig und wird durch ein schwarzes Loch oder einen Geisterraum ersetzt, der sich über die Wand hinaus erstreckt. Dieses Phänomen löst bei der Maschine eine kognitive Dissonanz aus: Die Tastsensoren oder Stoßfänger melden eine Kollision, doch die digitale Karte beharrt darauf, dass der Weg frei ist.

Warum scheitert maschinelles Lernen dort, wo ein Kind brilliert?

Die Schwierigkeit von Maschinen im Umgang mit Spiegelungen verdeutlicht einen gewaltigen Unterschied zwischen biologischem Lernen und maschinellem Lernen . In der menschlichen Entwicklungspsychologie gibt es eine entscheidende Phase, die als „Spiegelstadium“ bekannt ist und von dem Psychoanalytiker Jacques Lacan theoretisch begründet wurde. Im Alter von etwa 18 Monaten lernt ein Kind zu erkennen, dass das Spiegelbild kein anderes Kind ist, sondern es selbst. Diese Erkenntnis erfordert ein komplexes Verständnis des Selbst, des Raumes und grundlegender physikalischer Zusammenhänge.

Den heutigen Deep-Learning -Systemen fehlt – so ausgeklügelt sie auch sein mögen – dieses kausale und kontextuelle Verständnis der Welt . Sie werden mit Millionen statischer Bilder trainiert und lernen dabei, bestimmte Pixelmuster spezifischen Bezeichnungen (z. B. „Katze“, „Stuhl“, „Tür“) zuzuordnen. Enthält der Trainingsdatensatz keine enorme Menge an spezifischen Beispielen für Spiegel unter allen möglichen Licht- und Blickwinkeln, wird das neuronale Netz niemals das abstrakte Konzept einer „reflektierenden Oberfläche“ entwickeln. Die Maschine weiß nicht, dass sie existiert, sie weiß nicht, wie sie aussieht, und kann folglich ihr eigenes Spiegelbild nicht als Hinweis nutzen, um auf die Anwesenheit eines Spiegels zu schließen.

Die Auswirkungen auf die Hausautomation

Dieser blinde Fleck ist nicht bloß eine akademische Kuriosität, sondern hat unmittelbare praktische Auswirkungen auf dem Gebiet der Automatisierung . Hochwertige Saugroboter, die unsere Wohnräume millimetergenau kartieren, zeigen bei raumhohen Spiegeln oder stark reflektierenden Fenstertüren häufig ein fehlerhaftes Verhalten. Sie können wiederholt versuchen, das Glas zu durchqueren, sich in Endlosschleifen verfangen, während sie versuchen, einen nicht existierenden „Raum“ zu reinigen, oder die digitale Karte der Wohnung verfälschen, indem sie die reale Geometrie mit der gespiegelten überlagern.

Für die Robotikindustrie hat sich die Überwindung dieses Hindernisses zu einem echten Maßstab entwickelt. Es geht dabei nicht nur darum, Kratzer an einem Staubsaugerroboter zu vermeiden, sondern die Sicherheit künftiger Assistenzroboter zu gewährleisten. Stellen Sie sich einen humanoiden Roboter vor, der dazu konzipiert ist, ältere Menschen oder Menschen mit Behinderungen zu unterstützen: Ein durch Reflexionen verursachter Fehler bei der räumlichen Berechnung könnte zu Stürzen, Unfällen oder Schäden an zerbrechlichen Gegenständen führen. Die Fähigkeit, transparente und reflektierende Oberflächen zuverlässig zu erkennen, ist zu einer entscheidenden Kennzahl für die Bewertung der Zuverlässigkeit neuer autonomer Navigationssysteme geworden.

Jenseits des Spiegelbildes: Die Lösungen des technologischen Fortschritts

Wie gehen Ingenieure und Forscher dieses Problem an? Der technologische Fortschritt treibt die Entwicklung multimodaler Lösungen voran, die sich nicht auf einen einzigen Sensortyp verlassen. Eine der vielversprechendsten Strategien ist die Sensorfusion (Sensor Fusion). Durch die Kombination von visuellen Kameradaten, LiDAR-Messungen und vor allem Ultraschallsensoren (Sonar) können Roboter die Informationen miteinander abgleichen. Während Licht Glas durchdringt oder von diesem reflektiert wird, prallen Schallwellen von der festen Oberfläche ab. Meldet das LiDAR „freier Raum“, das Sonar jedoch „Hindernis in 10 Zentimetern Entfernung“, lernt der Algorithmus, auf das Vorhandensein eines Spiegels oder einer Glasscheibe zu schließen.

Darüber hinaus entwickeln Forscher neuronale Netze, die auf die „semantische Segmentierung reflektierender Oberflächen“ spezialisiert sind. Anstatt lediglich nach festen Objekten zu suchen, werden diese Netze darauf trainiert, die für Spiegel typischen visuellen Anomalien zu erkennen: Unstetigkeiten an den Bodenkanten, Beleuchtungsunterschiede zwischen der Spiegelung und der realen Umgebung sowie die Präsenz des Roboters selbst im Bild. Ziel ist es, den Maschinen nicht nur das Sehen beizubringen, sondern sie auch dazu zu befähigen, den Kontext zu erschließen, indem sie mit einer Art künstlichem „räumlichen gesunden Menschenverstand“ ausgestattet werden.

Schlussfolgerungen

Der Spiegel ist eine perfekte Metapher für den aktuellen Stand der künstlichen Intelligenz. Er erinnert uns daran, dass trotz der außergewöhnlichen Fortschritte in der Verarbeitung natürlicher Sprache und bei abstrakten Berechnungen die physische Interaktion mit der realen, chaotischen Welt eine gewaltige Herausforderung bleibt. Maschinen können Planetenbahnen berechnen oder die Proteinfaltung simulieren, scheitern jedoch an einer optischen Täuschung, die ein zweijähriges Kind mühelos durchschaut. Das Problem der „blinden Flecken“ im häuslichen Umfeld zu lösen, bedeutet nicht nur, unsere Haushaltsgeräte zu verbessern, sondern einen grundlegenden Schritt hin zur Schaffung synthetischer Gehirne zu vollziehen, die über ein echtes räumliches Bewusstsein verfügen. Bis zu diesem Zeitpunkt wird der Spiegel weiterhin nicht nur unsere Räume widerspiegeln, sondern auch die faszinierenden Grenzen der Technologie, die wir zu erschaffen versuchen.

Häufig gestellte Fragen

Saugroboter haben Schwierigkeiten, reflektierende Oberflächen zu erkennen, da ihre optischen und Lasersensoren getäuscht werden. Anstatt ein festes Hindernis zu erfassen, interpretieren die Kameras die Spiegelung des Raumes als freien Bereich, was dazu führt, dass das Gerät versucht, das Glas zu durchfahren.

Wenn der Laserstrahl eines Navigationssystems auf eine reflektierende Oberfläche trifft, kehrt er nicht direkt zurück, sondern wird zu anderen Objekten im Raum abgelenkt. Dieser Messfehler lässt das Gerät annehmen, dass ein weitaus tieferer Hohlraum vorhanden ist, wodurch in seiner digitalen Karte nicht existierende Räume entstehen.

Ingenieure setzen auf die Sensorfusion, ein Verfahren, das Kameras, Laser und Ultraschallsensoren kombiniert. Da Schallwellen – im Gegensatz zu Licht – von Glas reflektiert werden, gleicht das System die Daten ab, um das Vorhandensein eines Hindernisses zu erkennen und den Sichtfehler zu korrigieren.

Ein Mensch nutzt seine Intuition und den Kontext, um zu erkennen, dass er sich vor einer reflektierenden Oberfläche befindet, und identifiziert dabei sein eigenes Spiegelbild. Künstliche Systeme analysieren hingegen lediglich Pixelmuster und können ohne ein spezifisches Training für diese visuellen Anomalien das Konzept der Spiegelung nicht erfassen.

Die Unfähigkeit, reflektierende Räume korrekt zu erfassen, stellt ein ernsthaftes Sicherheitsproblem für Assistenzroboter dar. Ein Fehler bei der räumlichen Berechnung könnte zu Kollisionen, Stürzen oder Schäden an zerbrechlichen Gegenständen führen, weshalb die Entwicklung eines fortgeschrittenen räumlichen Bewusstseins von entscheidender Bedeutung ist.

Haben Sie noch Zweifel an Warum die fortschrittlichsten Roboter für dieses Objekt blind sind?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

- Lidar (Light Detection and Ranging) – Funktionsweise und optische Herausforderungen (Wikipedia)

- Computer Vision – Grundlagen der maschinellen Bildverarbeitung (Wikipedia)

- TOF-Kamera (Time of Flight) – Räumliche Erfassung und Limitierungen bei Reflexionen (Wikipedia)

- SLAM (Simultaneous Localization and Mapping) – Wie autonome Roboter Räume kartieren (Wikipedia)

- Reflexion (Physik) – Die physikalischen Eigenschaften von Licht an spiegelnden Oberflächen (Wikipedia)

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.