Viviamo in un’epoca in cui l’intelligenza artificiale sembra non avere più confini. I sistemi moderni sono in grado di diagnosticare patologie complesse analizzando radiografie in frazioni di secondo, guidare automobili nel traffico caotico delle metropoli e persino sostenere conversazioni filosofiche. Mentre un LLM (Large Language Model) come ChatGPT può generare saggi impeccabili sulla fisica quantistica o scrivere codice di programmazione avanzato, esiste un paradosso affascinante nel campo della robotica e della visione artificiale. Se trasferiamo questa immensa potenza di calcolo in un droide fisico e lo lasciamo libero di esplorare una normale abitazione, c’è un oggetto quotidiano, banale e onnipresente, che manderà in cortocircuito la sua comprensione dello spazio: lo specchio. Questo semplice complemento d’arredo rappresenta oggi uno dei più grandi punti ciechi per i cervelli sintetici.

Per comprendere la portata di questa curiosità tecnologica, dobbiamo immergerci nel modo in cui le macchine “vedono” e interpretano il mondo che le circonda. Non si tratta di un semplice difetto di programmazione, ma di un limite intrinseco legato alla fisica della luce e alla natura stessa degli attuali modelli di apprendimento automatico. Risolvere l’enigma dello specchio significa spingere la tecnologia verso una nuova frontiera della consapevolezza spaziale.

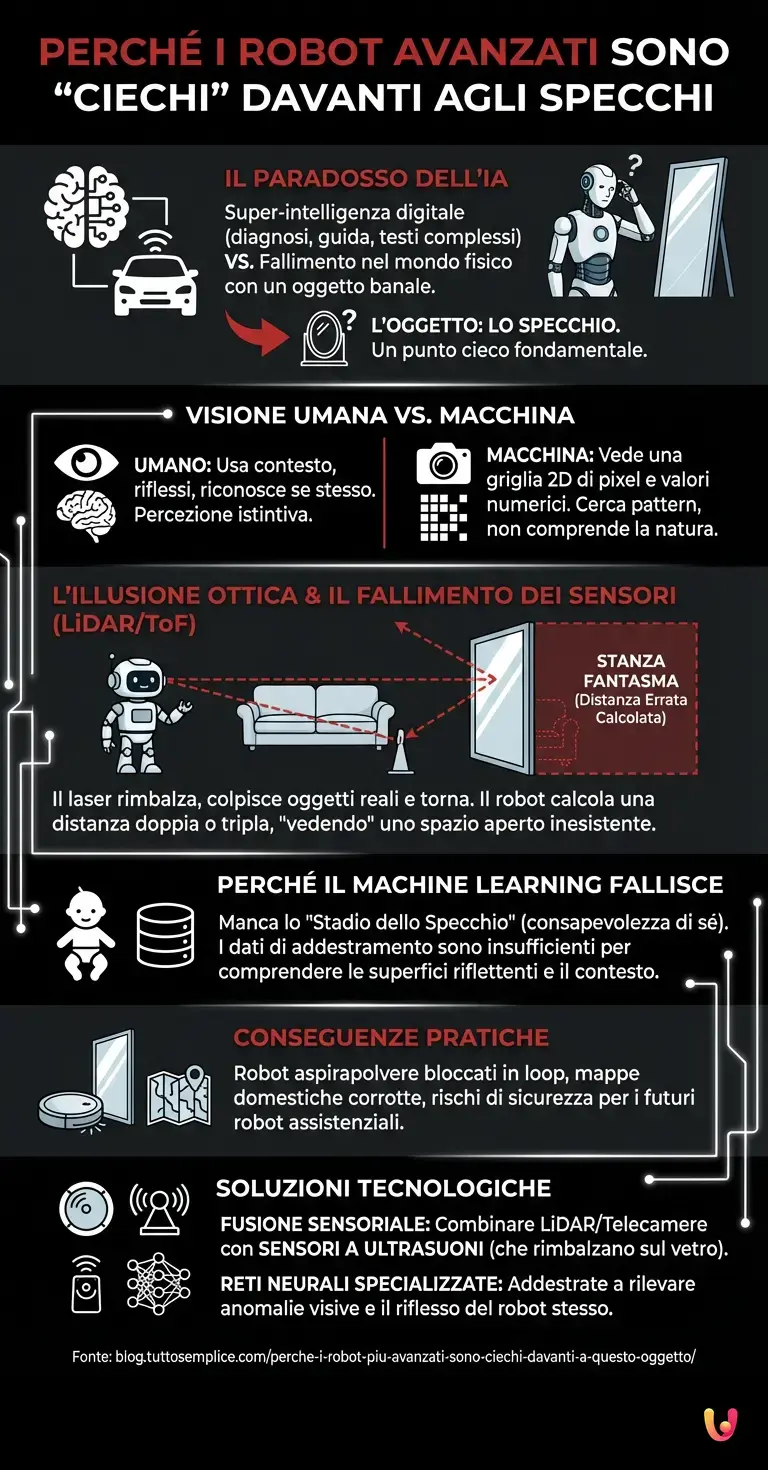

L’illusione ottica che inganna le macchine

Per un essere umano, riconoscere una superficie riflettente è un’azione quasi istintiva. Il nostro cervello utilizza una serie di indizi visivi e contestuali: la cornice, i leggeri riflessi sulla superficie del vetro, la posizione dell’oggetto (ad esempio, sopra un lavandino) e, soprattutto, la presenza della nostra stessa immagine riflessa. Per un’AI, tuttavia, il processo di visione è radicalmente diverso. Le telecamere di un robot domestico catturano la luce e la convertono in una griglia bidimensionale di pixel, ciascuno con un valore numerico corrispondente a un colore.

Quando gli algoritmi di visione artificiale analizzano questa griglia, cercano pattern, bordi e texture per identificare gli oggetti. Il problema fondamentale dello specchio è che non possiede un aspetto visivo proprio: la sua natura è quella di rubare l’aspetto dell’ambiente circostante. Di conseguenza, quando un robot guarda verso un armadio a specchio, i suoi sensori ottici non registrano un ostacolo solido, ma vedono un’estensione della stanza. Vedono un altro pavimento, altre pareti e altri mobili. L’illusione ottica è perfetta: la macchina è convinta che ci sia uno spazio aperto e navigabile dove, in realtà, c’è una barriera di vetro e argento.

Architettura neurale e la sfida della profondità

Si potrebbe pensare che il problema sia limitato alle sole telecamere tradizionali e che i sensori di profondità avanzati possano facilmente aggirare l’ostacolo. Purtroppo, la realtà fisica complica ulteriormente le cose. Molti sistemi di navigazione autonoma si affidano al LiDAR (Light Detection and Ranging) o a sensori ToF (Time of Flight). Questi dispositivi emettono impulsi di luce laser o infrarossa e misurano il tempo che impiegano a rimbalzare sugli oggetti e tornare indietro, calcolando così la distanza con estrema precisione.

Tuttavia, l’architettura neurale che elabora questi dati si scontra con le leggi dell’ottica. Quando il raggio laser di un LiDAR colpisce uno specchio, non rimbalza sulla superficie per tornare al sensore. Al contrario, viene riflesso secondo l’angolo di incidenza, viaggia attraverso la stanza, colpisce un oggetto reale (come un divano alle spalle del robot), rimbalza di nuovo sullo specchio e infine torna al sensore. Il risultato? Il robot calcola una distanza doppia o tripla rispetto a quella reale. Nella “nuvola di punti” tridimensionale generata dal cervello sintetico, lo specchio scompare completamente, sostituito da un buco nero o da una stanza fantasma che si estende oltre il muro. Questo fenomeno crea una dissonanza cognitiva per la macchina: i sensori tattili o i paraurti indicano una collisione, ma la mappa digitale insiste nel dire che la via è libera.

Perché il machine learning fallisce dove un bambino eccelle?

La difficoltà delle macchine nel gestire i riflessi evidenzia una differenza abissale tra l’apprendimento biologico e il machine learning. Nella psicologia dello sviluppo umano, esiste una fase cruciale nota come “stadio dello specchio”, teorizzata dallo psicoanalista Jacques Lacan. Intorno ai 18 mesi di età, un bambino impara a riconoscere che l’immagine riflessa non è un altro bambino, ma se stesso. Questa epifania richiede una comprensione complessa del sé, dello spazio e della fisica di base.

I sistemi di deep learning attuali, per quanto sofisticati, mancano di questa comprensione causale e contestuale del mondo. Vengono addestrati su milioni di immagini statiche, imparando ad associare determinati pattern di pixel a etichette specifiche (es. “gatto”, “sedia”, “porta”). Se il set di dati di addestramento non include una quantità massiccia di esempi specifici di specchi in ogni possibile condizione di illuminazione e angolazione, la rete neurale non svilupperà mai il concetto astratto di “superficie riflettente”. La macchina non sa di esistere, non sa che aspetto ha e, di conseguenza, non può usare la propria immagine riflessa come indizio per dedurre la presenza di uno specchio.

Le conseguenze per l’automazione domestica

Questo punto cieco non è solo una curiosità accademica, ma ha ripercussioni pratiche immediate nel campo dell’automazione. I robot aspirapolvere di fascia alta, che mappano le nostre case con precisione millimetrica, spesso si comportano in modo anomalo in presenza di specchi a tutta altezza o porte finestre molto riflettenti. Possono tentare ripetutamente di attraversare il vetro, bloccarsi in loop infiniti cercando di pulire una “stanza” inesistente, o corrompere la mappa digitale dell’abitazione sovrapponendo la geometria reale con quella riflessa.

Per l’industria della robotica, superare questo ostacolo è diventato un vero e proprio benchmark. Non si tratta solo di evitare che un aspirapolvere si graffi, ma di garantire la sicurezza per i futuri robot assistenziali. Immaginate un robot umanoide progettato per assistere anziani o persone con disabilità: un errore di calcolo spaziale causato da un riflesso potrebbe portare a cadute, incidenti o danni a oggetti fragili. La capacità di identificare in modo affidabile superfici trasparenti e riflettenti è diventata una metrica fondamentale per valutare l’affidabilità dei nuovi sistemi di navigazione autonoma.

Oltre il riflesso: le soluzioni del progresso tecnologico

Come stanno affrontando questo problema gli ingegneri e i ricercatori? Il progresso tecnologico sta spingendo verso soluzioni multimodali, che non si affidano a un singolo tipo di sensore. Una delle strategie più promettenti è la fusione sensoriale (sensor fusion). Combinando i dati visivi delle telecamere, le misurazioni del LiDAR e, soprattutto, i sensori a ultrasuoni (sonar), i robot possono incrociare le informazioni. Mentre la luce attraversa o viene riflessa dal vetro, le onde sonore rimbalzano sulla superficie solida. Se il LiDAR dice “spazio aperto” ma il sonar dice “ostacolo a 10 centimetri”, l’algoritmo impara a dedurre la presenza di uno specchio o di un vetro.

Inoltre, i ricercatori stanno sviluppando reti neurali specializzate nella “segmentazione semantica delle superfici riflettenti”. Invece di cercare solo oggetti solidi, queste reti vengono addestrate a cercare le anomalie visive tipiche degli specchi: discontinuità nei bordi del pavimento, differenze di illuminazione tra il riflesso e l’ambiente reale, e la presenza del robot stesso nell’immagine. Si sta cercando di insegnare alle macchine non solo a guardare, ma a dedurre il contesto, dotandole di una sorta di “buonsenso spaziale” artificiale.

In Breve (TL;DR)

Nonostante l’incredibile potenza dell’intelligenza artificiale moderna, i robot più avanzati non riescono a riconoscere un oggetto domestico comune come lo specchio.

Telecamere e sensori laser interpretano le superfici riflettenti come estensioni navigabili dello spazio, creando pericolose illusioni ottiche e mappature tridimensionali completamente errate.

Questo ostacolo evidenzia una profonda lacuna del machine learning, che riconosce i pattern visivi ma manca della consapevolezza spaziale degli esseri umani.

Conclusioni

Lo specchio rappresenta una metafora perfetta dello stato attuale dell’intelligenza artificiale. Ci ricorda che, nonostante i traguardi straordinari raggiunti nell’elaborazione del linguaggio naturale e nel calcolo astratto, l’interazione fisica con il mondo reale e caotico rimane una sfida formidabile. Le macchine possono calcolare le orbite dei pianeti o simulare il ripiegamento delle proteine, ma inciampano di fronte a un’illusione ottica che un bambino di due anni sa smascherare. Risolvere il problema del punto cieco domestico non significa solo migliorare i nostri elettrodomestici, ma compiere un passo fondamentale verso la creazione di cervelli sintetici dotati di una vera e propria consapevolezza spaziale. Fino a quel momento, lo specchio continuerà a riflettere non solo le nostre stanze, ma anche i limiti affascinanti della tecnologia che stiamo cercando di creare.

Domande frequenti

I robot aspirapolvere faticano a riconoscere le superfici riflettenti poiché i loro sensori ottici e laser vengono ingannati. Invece di rilevare un ostacolo solido, le telecamere vedono il riflesso della stanza come uno spazio aperto, portando il dispositivo a tentare di attraversare il vetro.

Quando il raggio laser di un sistema di navigazione colpisce una superficie riflettente, non torna direttamente indietro ma rimbalza verso altri oggetti nella stanza. Questo errore di misurazione fa credere alla macchina che ci sia uno spazio vuoto molto più profondo, creando stanze inesistenti nella sua mappa digitale.

Gli ingegneri stanno adottando la fusione sensoriale, una tecnica che combina telecamere, laser e sensori a ultrasuoni. Poiché le onde sonore rimbalzano sul vetro a differenza della luce, il sistema incrocia i dati per capire la presenza di un ostacolo e correggere il difetto visivo.

Un essere umano usa il proprio intuito e il contesto per capire di trovarsi davanti a una superficie riflettente, riconoscendo la propria immagine. I sistemi artificiali analizzano solo schemi di pixel e, senza un addestramento specifico su queste anomalie visive, non riescono a elaborare il concetto di riflesso.

La mancata capacità di mappare correttamente gli spazi riflettenti rappresenta un grave problema di sicurezza per i robot assistenziali. Un errore di calcolo spaziale potrebbe causare collisioni, cadute o danni a oggetti fragili, rendendo fondamentale lo sviluppo di una consapevolezza spaziale avanzata.

Hai ancora dubbi su Perché i robot più avanzati sono ciechi davanti a questo oggetto?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.