Cel mai periculos mit fals din peisajul tehnologiei informației de astăzi este credința că un model lingvistic mare (LLM), odată antrenat, validat și pus în producție, devine un atu static și previzibil. Realitatea este diametral opusă: modelele generative sunt entități dinamice care se degradează rapid din cauza deviației datelor (data drift) și sunt expuse constant la vulnerabilități invizibile pentru sistemele tradiționale, cum ar fi injecția de prompturi (prompt injection ). O monitorizare eficientă a modelelor nu este o simplă citire a jurnalelor în retrospectivă pentru a măsura timpul de funcționare, ci un proces de audit activ, semantic și în timp real, absolut esențial pentru a preveni dezastrele reputaționale și a garanta adevărata siguranță agențială.

Reglează parametrii operaționali ai LLM-ului tău în producție pentru a evalua nivelul de risc în timp real și a obține recomandări de audit.

Studiu de caz real: Dezastrul chatbot-ului Air Canada (2024)

În 2024, Air Canada a fost considerată legal responsabilă pentru „halucinațiile” chatbot-ului său bazat pe inteligență artificială . Modelul inventase de la zero o politică de rambursare inexistentă, comunicând-o unui client. Instanța a stabilit că firma este responsabilă pentru informațiile furnizate de propriii agenți AI. Acest caz a demonstrat întregii lumi cum absența unui sistem riguros de audit semantic în timp real se poate traduce în daune legale și financiare directe.

Metrici fundamentale pentru evaluarea în producție

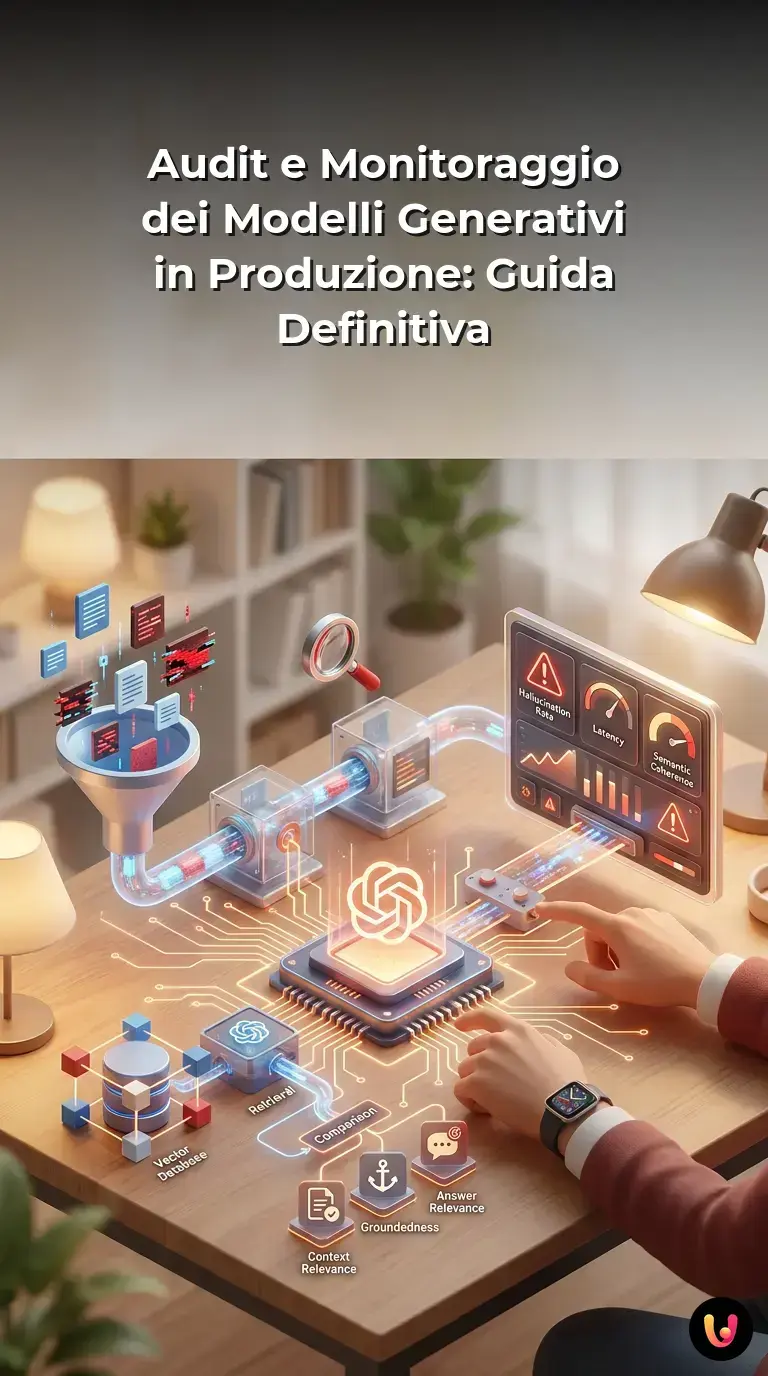

Monitorizarea modelelor necesită analiza continuă a unor valori specifice, cum ar fi rata de halucinație, latența token-ului, coerența semantică și costul per inferență. Acești parametri garantează că inteligența artificială funcționează eficient și fiabil în timp, prevenind degradarea performanței.

Spre deosebire de învățarea automată tradițională, unde metrici precum Acuratețea sau Scorul F1 sunt suficiente, modelele generative (LLM) necesită o abordare de evaluare multidimensională. Atunci când un model generează text, cod sau decizii, aproape niciodată există un singur răspuns corect. Prin urmare, auditul trebuie să se concentreze pe valori proxy care evaluează calitatea și siguranța rezultatului.

În arhitecturile moderne, precum RAG (Retrieval-Augmented Generation) , monitorizarea se bazează pe așa-numita „Triadă RAG”:

- Relevanța contextului: Măsoară dacă documentele recuperate din baza de date vectorială sunt într-adevăr relevante pentru întrebarea utilizatorului.

- Fundamentare (Groundedness): Verifică dacă răspunsul generat de LLM se bazează exclusiv pe contextul furnizat, fără a inventa fapte (halucinații).

- Relevanța răspunsului: Evaluează dacă răspunsul final rezolvă efectiv întrebarea inițială a utilizatorului, evitând divagațiile.

| Metrică de monitorizare | Descriere tehnică | Prag de alarmă tipic |

|---|---|---|

| Timp până la primul token (TTFT) | Timpul necesar modelului pentru a genera primul cuvânt al răspunsului. Crucial pentru UX. | 1,5 secunde |

| Rată de toxicitate | Procentul de rezultate care conțin limbaj ofensator, părtinire sau conținut nesigur. | > 0,1% |

| Jetoane pe secundă (TPS) | Viteza de generare a textului. Afectează direct costurile de infrastructură. | < 15 TPS |

Gestionarea Securității Agenților și a Confidențialității Datelor

Pentru o monitorizare corectă a modelelor , siguranța agenților și confidențialitatea sunt prioritare. Este esențial să se implementeze măsuri de protecție pentru a bloca atacurile de tip prompt injection și pentru a anonimiza datele sensibile (PII) înainte ca acestea să ajungă la LLM, prevenind astfel scurgerile de informații critice.

Integrarea agenților autonomi bazați pe LLM în fluxurile de lucru ale companiilor a introdus o nouă suprafață de atac. Conform documentației oficiale OWASP Top 10 for LLMs , cele mai critice vulnerabilități includ injectarea de prompturi (unde un utilizator rău intenționat manipulează instrucțiunile modelului) și gestionarea nesigură a rezultatelor (unde rezultatul modelului este executat fără validare de către sistemele backend).

Pentru a garanta securitatea agenților , companiile trebuie să implementeze o arhitectură stratificată (Apărare în profunzime):

- Măsuri de siguranță la intrare: Sisteme de clasificare (adesea modele ML mai mici și mai rapide) care analizează solicitarea utilizatorului înainte de a o trimite către LLM-ul principal, blocând încercările de jailbreak.

- Mascare dinamică a datelor: Instrumente de prevenire a pierderii datelor (DLP) care interceptează și ascund informațiile de identificare personală (PII), cum ar fi numerele cardurilor de credit sau codurile fiscale, asigurând conformitatea cu GDPR.

- Măsuri de siguranță pentru rezultate: Un nivel final de validare care verifică dacă răspunsul LLM încalcă politicile companiei sau conține cod rău intenționat înainte de a fi afișat utilizatorului.

Instrumente și cadre pentru observabilitatea LLM-urilor

Ecosistemul de monitorizare a modelelor se bazează pe framework-uri avansate precum LangSmith, Arize AI și TruEra. Aceste instrumente oferă tablouri de bord de observabilitate în timp real, urmărind execuția lanțurilor și facilitând depanarea răspunsurilor generate de inteligența artificială.

Observabilitatea merge dincolo de simpla monitorizare. În timp ce monitorizarea îți spune când un sistem este defect, observabilitatea îți permite să înțelegi de ce s-a defectat. În contextul informaticii aplicate inteligenței artificiale, aceasta înseamnă a putea inspecta fiecare pas logic al unui „lanț” (Chain) sau al unui agent.

Stivele tehnologice moderne pentru LLMOps (operațiuni cu modele lingvistice mari) includ:

- LangSmith / Langfuse: Platforme esențiale pentru urmărirea apelurilor API, analizarea costurilor tokenurilor și reluarea sesiunilor utilizatorilor pentru depanarea prompturilor.

- Arize Phoenix: Un instrument open-source excelent pentru analiza performanței aplicațiilor RAG, care permite vizualizarea embedding-urilor și identificarea clusterelor de interogări în care modelul eșuează.

- Giskard: Un cadru specializat în testarea și auditarea vulnerabilităților modelelor, capabil să genereze automat seturi de teste pentru a descoperi prejudecăți și probleme de securitate înainte de implementarea în producție.

Strategii de atenuare a deviației și degradării datelor

O monitorizare eficientă a modelelor trebuie să detecteze deviația datelor (data drift), adică schimbarea distribuției datelor de intrare. Actualizarea continuă a vectorilor de context și buclele de feedback uman (RLHF) sunt esențiale pentru menținerea performanțelor ridicate în timp.

Degradarea modelelor generative este un fenomen insidios. Nu se manifestă printr-un crash al serverului, ci printr-o scădere lentă și inexorabilă a calității răspunsurilor. Acest lucru se întâmplă în principal din cauza Concept Drift : lumea se schimbă, limbajul evoluează, dar ponderile modelului rămân înghețate la momentul ultimului antrenament.

Pentru a atenua acest risc fără a fi nevoie de reantrenarea întregului LLM (o operațiune cu costuri prohibitive), cele mai eficiente strategii includ:

- Actualizare continuă RAG: Menținerea bazei de date vectoriale actualizată constant cu cele mai recente politici ale companiei și informații de piață. Modelul raționează pe baza unor date recente, fără a fi nevoie de ajustări fine (fine-tuning).

- Implementare Shadow: Rularea unei noi versiuni a promptului sau modelului în paralel cu cea aflată în producție, comparând rezultatele în timp real, fără a afecta utilizatorul final.

- Human-in-the-Loop (HITL): Implementarea mecanismelor de feedback implicit (de exemplu, utilizatorul care copiază răspunsul) și explicit (degetul mare în sus/jos) pentru a colecta date valoroase destinate viitoarelor cicluri de aliniere.

Concluzii

Implementarea unei inteligențe artificiale generative în mediul enterprise nu se încheie odată cu lansarea în producție, ci abia atunci începe cu adevărat. Așa cum am analizat, lipsa unei monitorizări riguroase a modelelor expune organizațiile la riscuri inacceptabile, de la halucinații dăunătoare pentru brand până la încălcări grave ale confidențialității și securității agenților.

Adoptarea unei abordări proactive, bazate pe observabilitatea semantică, implementarea unor mecanisme de control robuste și analiza continuă a indicatorilor RAG, reprezintă singura cale sustenabilă. Doar tratând modelele AI ca entități dinamice care necesită audituri constante, echipele IT pot garanta că inovația tehnologică se traduce într-un avantaj competitiv real și sigur.

Întrebări frecvente

Monitorizarea unui model generativ înseamnă implementarea unui proces de audit activ și semantic în timp real pentru a garanta o fiabilitate maximă. Nu este vorba doar de verificarea jurnalelor de sistem, ci de analizarea constantă a unor valori specifice, cum ar fi rata de halucinație, coerența semantică și latența tokenurilor.

Modelele suferă o degradare calitativă din cauza schimbării fiziologice a distribuției datelor, un fenomen cunoscut sub numele de data drift (derivă a datelor). Deoarece lumea și limbajul evoluează rapid, este esențial să se actualizeze constant bazele de date contextuale și să se integreze feedback-ul uman pentru a menține răspunsurile mereu precise și relevante.

Evaluarea se face prin măsurarea a trei parametri esențiali care garantează siguranța totală a sistemului. Trebuie verificată relevanța documentelor recuperate din baza de date, trebuie să ne asigurăm că răspunsul se bazează exclusiv pe faptele furnizate pentru a evita invențiile periculoase și trebuie să verificăm dacă textul final rezolvă cu adevărat problema pusă inițial.

Cele mai critice vulnerabilități includ manipularea rău intenționată a instrucțiunilor de bază și gestionarea nesigură a rezultatelor generate. Pentru a proteja sistemele corporative, este absolut necesară implementarea unei arhitecturi de apărare stratificată, care să includă filtre preventive pentru datele de intrare, validarea riguroasă a datelor de ieșire și mascarea dinamică a informațiilor personale.

Echipele de dezvoltare se bazează pe framework-uri avansate de observabilitate care permit inspectarea fiecărui pas logic al sistemului. Aceste platforme specializate oferă tablouri de bord în timp real pentru a urmări apelurile, a analiza costurile operaționale și a identifica eventualele probleme de securitate înainte de lansarea publică.

Încă ai dubii despre Audit și monitorizare a modelelor generative în producție: Ghid definitiv?

Tastați aici întrebarea dvs. specifică pentru a găsi instantaneu răspunsul oficial de la Google.

Ați găsit acest articol util? Există un alt subiect pe care ați dori să-l tratez?

Scrieți-l în comentariile de mai jos! Mă inspir direct din sugestiile voastre.