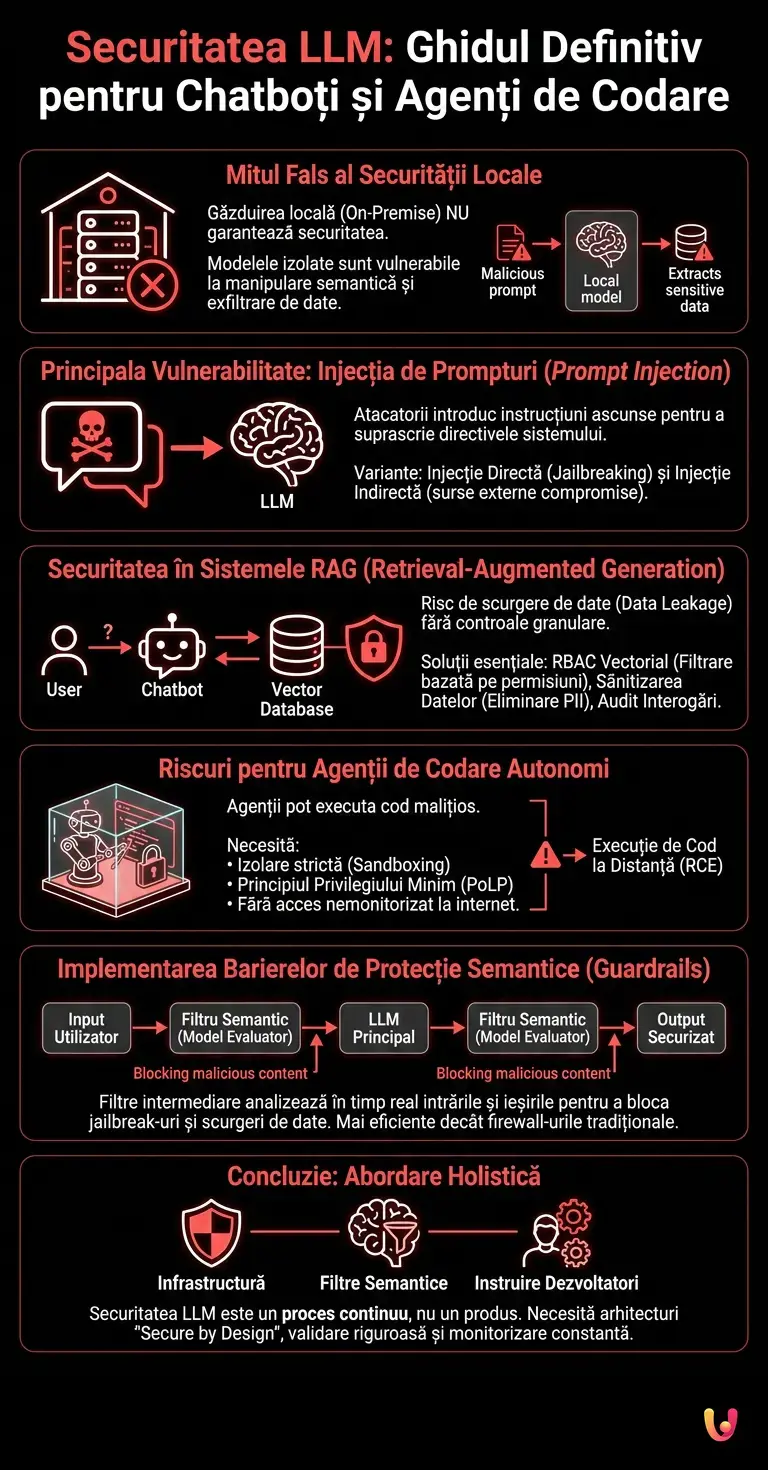

Cel mai periculos mit fals din lumea inteligenței artificiale la nivel de întreprindere este credința că găzduirea unui model local (on-premise) sau utilizarea unei instanțe cloud private garantează automat securitatea LLM . Realitatea este brutal de diferită: un model izolat, dacă este conectat la un agent de codare sau la o bază de date a companiei prin RAG (Retrieval-Augmented Generation), poate fi manipulat prin injecție de prompturi pentru a exfiltra date sensibile sau a executa cod malițios, ocolind complet firewall-urile tradiționale. Adevărata protecție nu rezidă în perimetrul rețelei, ci în validarea riguroasă a intrărilor și ieșirilor modelului în sine.

Evaluează nivelul de risc al implementării tale de inteligență artificială.

Arhitectura și vulnerabilitatea modelelor lingvistice

Înțelegerea arhitecturii de bază este primul pas pentru a garanta securitatea LLM-urilor . Modelele lingvistice procesează limbajul natural, dar incapacitatea lor nativă de a distinge între instrucțiunile de sistem și inputul utilizatorului creează vulnerabilități critice, în special în cazul chatbot-urilor de afaceri.

Modelele lingvistice mari (LLM) sunt, în esență, motoare de predicție probabilistică. Atunci când integrăm un LLM într-o aplicație de business, îl expunem la vectori de atac unici. Conform documentației oficiale OWASP Top 10 pentru LLM , principala vulnerabilitate este injectarea de prompturi (Prompt Injection ). Aceasta se întâmplă atunci când un utilizator rău intenționat introduce instrucțiuni ascunse în prompt, care suprascriu directivele originale ale sistemului.

Există două variante principale ale acestei amenințări:

- Injecție directă de prompt (Jailbreaking): Utilizatorul manipulează direct chatbotul pentru a-l face să ignore regulile de siguranță .

- Injecție indirectă de prompt: LLM-ul preia date dintr-o sursă externă compromisă (de exemplu, o pagină web sau un e-mail) care conține instrucțiuni rău intenționate ascunse, condiționând comportamentul agentului.

Protejarea datelor companiei în sistemele RAG

În sistemele RAG, securitatea LLM depinde de gestionarea riguroasă a permisiunilor de acces. Dacă un chatbot interoghează o bază de date a companiei fără filtre de autorizare granulare, există riscul expunerii documentelor confidențiale către utilizatori neautorizați prin atacuri de manipulare a contextului.

Arhitectura Retrieval-Augmented Generation (RAG) este standardul de facto pentru a oferi modelelor IA acces la datele proprietare. Cu toate acestea, baza de date vectorială care alimentează RAG devine o țintă principală. Dacă un angajat întreabă chatbotul „Rezumă-mi obiectivele trimestriale”, sistemul trebuie să garanteze că LLM-ul recuperează și procesează doar documentele la care acel angajat are acces explicit.

Pentru a reduce riscurile de scurgere de date (Data Leakage), este imperativ să se implementeze:

| Măsură de siguranță | Descriere | Impact asupra riscului |

|---|---|---|

| RBAC vectorial | Filtrați rezultatele căutării semantice în funcție de permisiunile utilizatorului înainte de a le trimite către LLM. | Înalt |

| Sănitizarea datelor | Eliminați informațiile de identificare personală (PII) din documente înainte de încorporare. | Critic |

| Audit interogări | Înregistrarea și analizarea interogărilor utilizatorilor pentru a identifica tipare anormale sau tentative de exfiltrare. | Mediu |

Riscuri și atenuări pentru agenții de codare

La implementarea asistenților de programare, securitatea LLM necesită izolarea mediului de execuție. Agenții autonomi de codare pot genera sau executa cod malițios dacă nu sunt plasați în sandbox-uri stricte și lipsiți de privilegii de sistem ridicate.

Agenții de codare (cum ar fi implementările personalizate bazate pe framework-uri agențiale) nu se limitează la generarea de text, ci efectuează acțiuni: citesc depozite, scriu fișiere și, în unele cazuri, execută scripturi. Acest nivel de autonomie introduce riscul unui design nesigur al pluginurilor și al executării de cod la distanță (RCE) neautorizată.

Dacă un agent de codare este păcălit prin intermediul unui pachet software compromis (atac asupra lanțului de aprovizionare) sau printr-o instrucțiune malițioasă dintr-un tichet GitHub, acesta ar putea modifica codul sursă al companiei. Regula de aur este principiul privilegiului minim (PoLP): agentul trebuie să opereze în containere efemere, fără acces la internet nemonitorizat și fără chei API codificate direct în program.

Studiu de caz: Scurgerea de date de la Samsung (2023)

În 2023, inginerii de la Samsung au introdus accidental cod sursă proprietar și notițe de la ședințe interne în ChatGPT pentru a primi ajutor în corectarea erorilor și formatare. Deoarece datele introduse în modelele publice sunt adesea folosite pentru reantrenare, aceste informații extrem de sensibile au ieșit din perimetrul companiei, obligând compania să interzică temporar utilizarea instrumentelor de inteligență artificială generativă publică și să accelereze dezvoltarea unor soluții interne sigure.

Implementarea barierelor de protecție și a filtrelor de securitate

Adoptarea unor mecanisme de protecție semantică (guardrails) reprezintă o practică fundamentală pentru securitatea LLM-urilor . Aceste filtre intermediare analizează în timp real atât prompturile de intrare, cât și răspunsurile de ieșire, blocând tentativele de jailbreak și prevenind scurgerea de informații sensibile.

Firewall-urile tradiționale bazate pe reguli de rețea sunt ineficiente împotriva amenințărilor semantice. Este necesară implementarea unui nivel de securitate a aplicațiilor specific pentru IA. Instrumente open-source precum NeMo Guardrails sau framework-uri proprietare permit definirea unor limite operaționale stricte.

O arhitectură de securitate robustă prevede un „model evaluator” (adesea un LLM mai mic și mai rapid) care inspectează rezultatul modelului principal înainte ca acesta să fie afișat utilizatorului. Dacă evaluatorul detectează că rezultatul conține cod malițios, date financiare neautorizate sau limbaj nepotrivit, blochează tranzacția și returnează un mesaj de eroare standardizat.

Concluzii

În concluzie, securitatea LLM nu este un produs care se cumpără, ci un proces continuu de validare și monitorizare. Protejarea chatbot-urilor și a agenților de codare necesită o abordare holistică ce combină apărarea infrastructurii, filtrele semantice și instruirea dezvoltatorilor.

Integrarea inteligenței artificiale în fluxurile de lucru ale companiilor oferă avantaje competitive incomensurabile, dar extinde dramatic suprafața de atac. Companiile care vor prospera în era IA generative vor fi cele capabile să implementeze arhitecturi „Secure by Design”, unde validarea inputurilor, sandboxing-ul agenților și controlul granular al accesului la date (RAG) sunt considerate cerințe funcționale esențiale, nu simple adăugiri ulterioare.

Întrebări frecvente

Pentru a proteja sistemele de inteligență artificială de manipulările externe, este fundamental să se implementeze filtre semantice avansate și bariere de control. Aceste instrumente analizează în timp real solicitările utilizatorilor și răspunsurile generate, blocând din fașă orice încercare de a ocoli directivele sistemului. În plus, este esențial să se separe riguros instrucțiunile de bază de datele furnizate de utilizatori.

Multe companii cred în mod eronat că menținerea serverelor în propriul perimetru de rețea elimină orice amenințare cibernetică. În realitate, un sistem izolat rămâne vulnerabil dacă este conectat la baze de date ale companiei sau la instrumente de dezvoltare, deoarece atacurile semantice pot exploata canalele de intrare legitime pentru a extrage informații confidențiale. Adevărata apărare necesită o validare continuă a datelor procesate de model.

Asistenții de programare au un nivel ridicat de autonomie, ceea ce le permite să citească arhive, să modifice fișiere și să execute scripturi operaționale. Fără restricții adecvate, un pachet software compromis sau o simplă instrucțiune malițioasă ar putea determina sistemul să execute comenzi dăunătoare pe mașina gazdă. Pentru a atenua acest risc, este indispensabil să se izoleze aceste resurse în medii separate și să se aplice principiul privilegiului minim.

Protecția informațiilor proprietare în aceste arhitecturi se bazează pe o gestionare extrem de granulară a permisiunilor de acces. Înainte de a trimite rezultatele unei căutări semantice către motorul generativ, sistemul trebuie să verifice dacă angajatul are drepturile necesare pentru a vizualiza acele documente specifice. De asemenea, este crucială eliminarea datelor personale sensibile înainte de faza de indexare pentru a preveni scurgerile de informații.

Acestea sunt bariere de securitate aplicative concepute special pentru modelele de limbaj natural, capabile să depășească limitele firewall-urilor clasice de rețea. Sarcina lor principală constă în monitorizarea constantă a fluxului conversațional pentru a identifica și bloca conținutul inadecvat, codul rău intenționat sau tentativele de extragere a datelor financiare. Acestea funcționează adesea prin intermediul unui model evaluator secundar care aprobă sau respinge tranzacțiile în milisecunde.

Încă ai dubii despre Securitatea LLM: Ghidul Definitiv pentru Chatboți și Agenți de Codare?

Tastați aici întrebarea dvs. specifică pentru a găsi instantaneu răspunsul oficial de la Google.

Ați găsit acest articol util? Există un alt subiect pe care ați dori să-l tratez?

Scrieți-l în comentariile de mai jos! Mă inspir direct din sugestiile voastre.