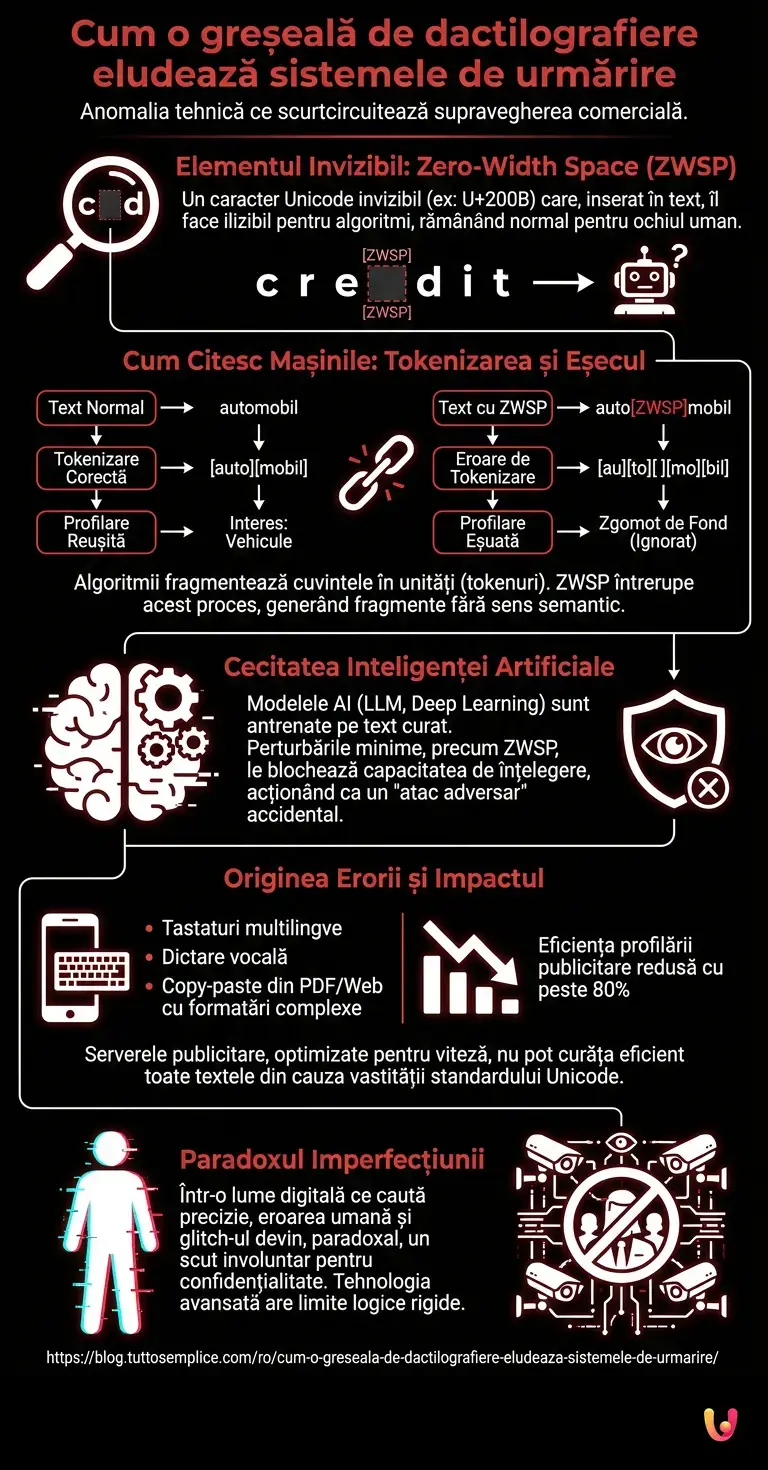

În era hiperconectivității, fiecare interacțiune a noastră online lasă o urmă de neșters de date. De la site-urile pe care le vizităm până la cuvintele pe care le tastăm în motoarele de căutare, totul este înregistrat, catalogat și analizat cu meticulozitate. Cu toate acestea, există o anomalie tehnică singulară capabilă să provoace un scurtcircuit în această imensă mașinărie de supraveghere comercială. Secretul rezidă într-un element pe cât de invizibil, pe atât de puternic: „ Zero-Width Space” (spațiul cu lățime zero), un caracter Unicode care, dacă este inserat accidental sau intenționat în timpul tastării, face textul ilizibil pentru sistemele de profilare, menținându-l în același timp perfect normal pentru ochiul uman.

Pentru a înțelege amploarea acestei curiozități informatice, este necesar să facem un pas înapoi și să observăm modul în care mașinile interpretează limbajul uman . Noi citim litere, silabe și cuvinte, însă computerele citesc secvențe de numere. Atunci când un utilizator comite un anumit tip de greșeală de tastare, declanșând o combinație de taste care generează un caracter invizibil sau un omoglif (un caracter identic din punct de vedere vizual, dar cu un cod informatic diferit), se creează o adevărată barieră criptografică involuntară.

Călcâiul lui Ahile al algoritmilor de profilare

Sistemele moderne de monitorizare digitală se bazează pe algoritmi de text-mining extrem de avizi. Rolul acestora este de a scana e-mailurile, postările de pe rețelele de socializare și interogările noastre de căutare, pentru a extrage cuvinte-cheie esențiale. Dacă utilizezi frecvent cuvântul „credit ipotecar” sau „călătorii”, brokerii de date te vor include în segmente de piață specifice, bombardându-te cu publicitate direcționată.

Cu toate acestea, aceste sisteme suferă de o rigiditate structurală. Ele sunt programate să recunoască șiruri de text exacte sau variantele lor cele mai frecvente. Atunci când un utilizator, din cauza unui layout de tastatură particular, a unei operațiuni de tip „copy-paste” cu formatări anormale sau a unei tastări grăbite pe ecrane tactile, introduce un spațiu de lățime zero (Zero-Width Space) în interiorul unui cuvânt (de exemplu, transformând „mutuo” în „mu[ZWSP]tuo”), sistemul tradițional de urmărire intră în impas. Cuvântul este fragmentat la nivelul codului sursă. Trackerul nu mai identifică un potențial client interesat de un împrumut, ci înregistrează un șir de caractere lipsit de sens , pe care îl elimină, considerându-l zgomot de fond.

Tokenizarea: cum citesc mașinile

Pentru a înțelege în profunzime acest fenomen, trebuie să pătrundem în inima inteligenței artificiale și a învățării automate . Modelele lingvistice moderne nu procesează textul cuvânt cu cuvânt, ci utilizează un proces numit tokenizare. Textul este fragmentat în unități mai mici, numite „tokenuri”.

Într-o arhitectură neuronală avansată, cuvântul „automobil” ar putea fi un singur token. Însă, dacă în interiorul acelui cuvânt se ascunde o greșeală de dactilografiere invizibilă, sistemul de tokenizare (adesea bazat pe Byte Pair Encoding) dă eroare. În loc să atribuie tokenul corespunzător conceptului de vehicul, acesta fragmentează cuvântul în silabe izolate sau în caractere individuale care nu au nicio semnificație semantică. Acest lucru înseamnă că, pentru AI , tu nu ai scris niciodată acel cuvânt. Ai trecut, la propriu, pe sub radar.

Cecitatea inteligenței artificiale în fața neprevăzutului

S-ar putea crede că cele mai avansate sisteme sunt imune la aceste erori banale. În realitate, învățarea profundă (deep learning) este extrem de capabilă să recunoască tipare complexe, dar este surprinzător de fragilă în fața unor perturbări minime și neașteptate . Acest fenomen este cunoscut în domeniul securității informatice sub denumirea de „atac adversar” (adversarial attack), deși, în acest caz, el are loc în mod cu totul accidental.

Să luăm, de exemplu, modelele de limbaj de mari dimensiuni, sau LLM-urile . Platformele precum ChatGPT sau sistemele de analiză a sentimentelor utilizate de corporațiile multinaționale sunt antrenate pe terabytes de text curat și normalizat. Atunci când întâlnesc un text alterat de caractere invizibile sau de erori de codificare Unicode generate de o tastare neobișnuită, capacitatea lor de înțelegere scade drastic. Automatizarea care ar trebui să îți categorizeze profilul psihologic sau obiceiurile de consum se blochează, deoarece datele de intrare nu corespund niciuneia dintre coordonatele prezente în imensa sa bază de date vectorială.

Un test de referință pentru invizibilitate

Cercetătorii din domeniul confidențialității și al securității informatice au început să studieze acest fenomen cu mare interes. Supunând sistemele de urmărire unor teste de referință riguroase, aceștia au descoperit că inserarea strategică (sau accidentală) a acestor greșeli de dactilografiere invizibile reduce eficiența profilării publicitare cu peste 80%.

Nu este vorba despre o eroare de programare banală, ci despre o limită intrinsecă a modului în care computerele procesează textul. Progresul tehnologic determină companiile să dezvolte filtre de „igienizare” a textului din ce în ce mai agresive, concepute pentru a elimina orice caracter non-standard înainte ca textul să fie analizat. Cu toate acestea, vastitatea standardului Unicode, care cuprinde peste 140.000 de caractere, face ca această operațiune de curățare să fie extrem de complexă și costisitoare în ceea ce privește puterea de calcul.

Anatomia erorii: ce se întâmplă în culise

Dar cum apare, în practică, această eroare? Deseori, acest lucru se întâmplă atunci când se utilizează tastaturi multilingve pe smartphone-uri. Comutarea rapidă între diferite layout-uri sau utilizarea funcțiilor de dictare vocală, care încearcă să formateze textul în mod dinamic, poate introduce metadate invizibile între litere. În alte cazuri, este rezultatul unei operațiuni de tip „copiere-lipire” din documente PDF sau de pe site-uri web cu formatări complexe.

Atunci când apăsăm „Trimite”, browserul nostru transmite întreaga secvență de octeți. Serverele publicitare, optimizate pentru viteză și pentru a procesa miliarde de solicitări pe secundă, nu au timpul necesar pentru a efectua o analiză amănunțită a fiecărui cuvânt în parte. Acestea aplică expresii regulate (regex) standardizate. Dacă expresia regulată caută cuvântul „smartphone” și găsește „smart[caracter-invizibil]phone”, condiția devine falsă. Datele sunt ignorate. Utilizatorul, pentru acea fracțiune de secundă și pentru acea interacțiune specifică, devine o fantomă digitală.

Pe Scurt (TL;DR)

Inserirea accidentală sau voluntară a unor caractere invizibile, precum spațiul de lățime zero, creează o adevărată barieră criptografică împotriva sistemelor moderne de monitorizare digitală.

Aceste anomalii invizibile întrerup procesul delicat de tokenizare, făcând cuvintele cheie complet ilizibile pentru algoritmii vorace de profilare comercială.

Această limită structurală a învățării automate reduce semnificativ succesul publicității direcționate, permițând utilizatorilor să scape accidental de supravegherea brokerilor de date.

Concluzii

Descoperirea faptului că o simplă, și adesea invizibilă, greșeală de dactilografiere poate neutraliza sisteme de supraveghere multimiliardare ne reamintește un adevăr fundamental: tehnologia, oricât de avansată ar fi, operează întotdeauna în limite logice rigide. În timp ce industria datelor continuă să investească în algoritmi tot mai sofisticați, complexitatea și imprevizibilitatea interacțiunii umane (precum și ale sistemelor de codificare pe care le-am creat pentru a o reprezenta) oferă încă modalități neașteptate de scăpare.

Spațiul de lățime zero și anomaliile tipografice similare nu reprezintă soluția definitivă la problema confidențialității online, ci constituie un paradox modern fascinant. Într-o lume în care încercăm constant să fim preciși și lizibili pentru mașini, tocmai în eroare, în imperfecțiune și în glitch regăsim, în mod paradoxal, dreptul nostru la invizibilitate.

Întrebări frecvente

Este vorba despre un caracter Unicode invizibil ochiului uman, dar procesat perfect de către computere. Atunci când este inserat într-un cuvânt, acesta îl fragmentează la nivelul codului sursă, făcându-l complet de neînțeles pentru algoritmii de monitorizare publicitară, care caută exclusiv termeni exacți și predefiniți. Acest procedeu blochează colectarea datelor cu caracter personal.

Prin inserarea unor caractere invizibile în interiorul cuvintelor-cheie, sistemele de profilare nu reușesc să recunoască termenii de interes comercial. În consecință, brokerii de date ignoră textul, considerându-l un simplu zgomot de fond, evitând astfel trimiterea de publicitate direcționată, deranjantă, către persoana vizată. În acest fel, se creează un scut protector involuntar împotriva supravegherii digitale.

Modelele lingvistice moderne utilizează tokenizarea pentru a fragmenta textul în unități cu sens complet. Un caracter anormal întrerupe brusc acest proces, divizând cuvântul în fragmente lipsite de semnificație semantică. Acest lucru provoacă un adevărat scurtcircuit în înțelegerea automată, făcând textul ilizibil pentru mașină. Astfel, profilarea psihologică este oprită din fașă.

Adesea, acestea apar în urma utilizării tastaturilor multilingve pe smartphone-uri, prin comutarea rapidă de la un layout la altul, sau prin intermediul sistemelor de dictare vocală. De asemenea, pot rezulta din copierea și lipirea textelor din documente complexe, transferând metadate ascunse care alterează structura invizibilă a cuvântului tastat. Chiar și tastarea grăbită pe ecranele tactile poate declanșa această anomalie informatică.

Platformele tehnologice dezvoltă filtre de curățare a textului din ce în ce mai agresive pentru a elimina caracterele non-standard înainte de etapa de analiză. Cu toate acestea, gestionarea a peste o sută patruzeci de mii de variante Unicode necesită o putere de calcul enormă. Prin urmare, această operațiune este extrem de complexă și foarte costisitoare pentru serverele publicitare.

Încă ai dubii despre Cum o greșeală de dactilografiere eludează sistemele de urmărire?

Tastați aici întrebarea dvs. specifică pentru a găsi instantaneu răspunsul oficial de la Google.

Surse și Aprofundare

- Spațiu cu lățime zero (Zero-width space) – Definiție și utilizare în codificarea textelor (Wikipedia)

- Taxonomia atacurilor adversare asupra sistemelor de inteligență artificială (NIST – Institutul Național de Standarde și Tehnologie SUA)

- Byte pair encoding: Baza algoritmilor de tokenizare utilizați de modelele lingvistice (Wikipedia)

- Atacuri omografe: Cum caracterele vizual identice sau invizibile pot eluda sistemele informatice (Wikipedia)

- Învățarea automată adversară: Vulnerabilitatea algoritmilor la perturbări minime de date (Wikipedia)

Ați găsit acest articol util? Există un alt subiect pe care ați dori să-l tratez?

Scrieți-l în comentariile de mai jos! Mă inspir direct din sugestiile voastre.