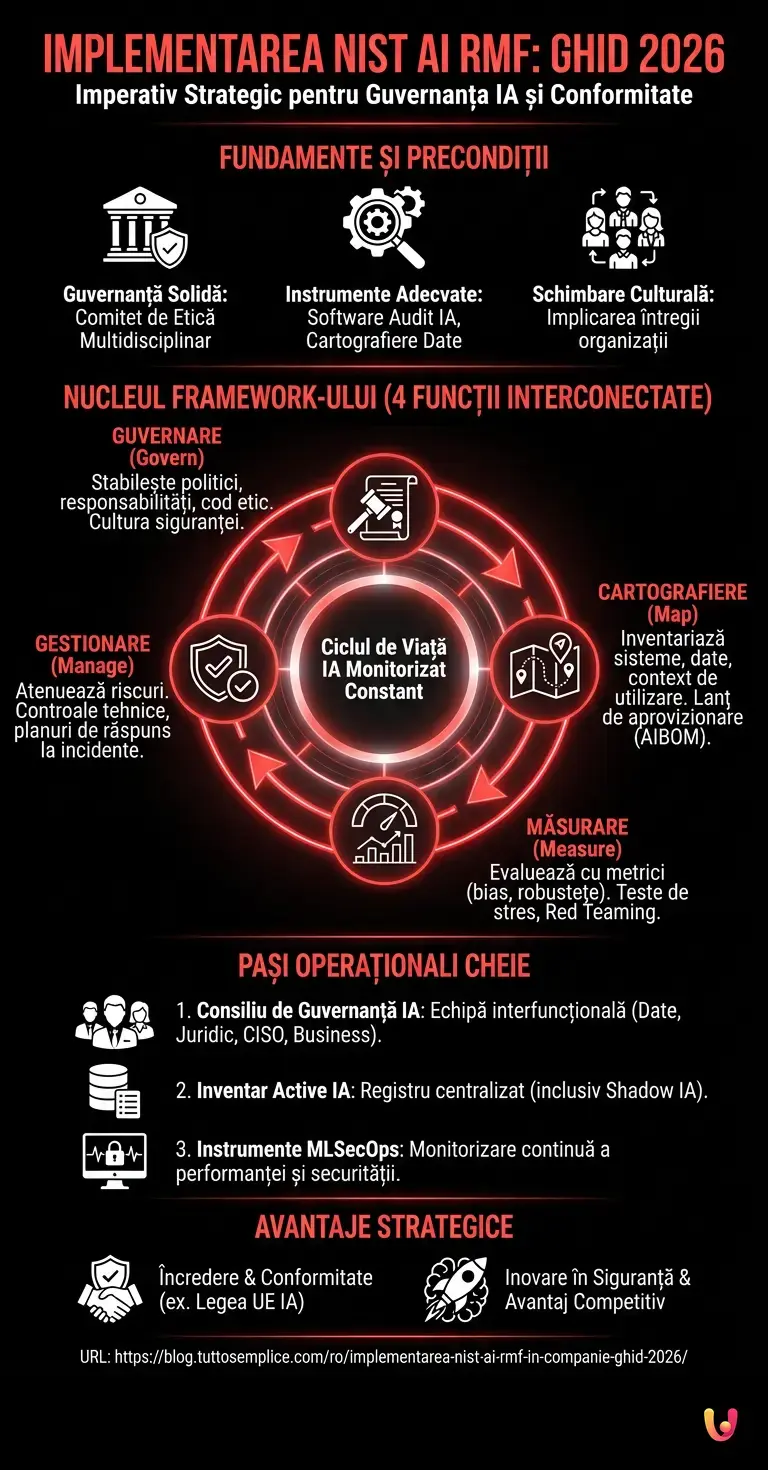

Integrarea NIST AI RMF (Cadrul de gestionare a riscurilor pentru inteligența artificială) reprezintă astăzi pilonul fundamental pentru orice organizație care dorește să dezvolte, să achiziționeze sau să integreze sisteme de inteligență artificială. În contextul tehnologic al anului 2026, caracterizat de plena operativitate a Legii UE privind inteligența artificială și de proliferarea modelelor generative complexe , gestionarea riscurilor nu mai este o opțiune, ci un imperativ strategic. Acest ghid tehnic oferă o cale structurată pentru adoptarea cadrului, transformând conformitatea normativă într-un avantaj competitiv tangibil printr-o guvernanță solidă a inteligenței artificiale .

Introducere în Managementul Riscului IA

Adoptarea NIST AI RMF va reprezenta standardul global în 2026 pentru guvernarea inteligenței artificiale în mod sigur. Acest cadru permite companiilor să identifice, să evalueze și să gestioneze riscurile legate de IA, garantând conformitatea cu reglementările și fiabilitatea sistemelor tehnologice.

Conform documentației oficiale a Institutului Național de Standarde și Tehnologie (NIST), cadrul este conceput pentru a fi agnostic față de sector și scalabil. Nu este vorba de o simplă listă de verificare a securității, ci de o schimbare culturală care implică întreaga structură a companiei, de la consiliul de administrație până la dezvoltatorii de învățare automată. În 2026, alinierea dintre RMF-ul NIST tradițional și specificitățile inteligenței artificiale necesită o înțelegere profundă a unor concepte precum interpretabilitatea modelelor, confidențialitatea datelor de antrenament și atenuarea prejudecăților algoritmice.

Cerințe preliminare și instrumente pentru conformitate

Înainte de implementarea NIST AI RMF , este esențial să se stabilească o guvernanță corporativă solidă pentru IA. Condițiile prealabile includ formarea unui comitet de etică multidisciplinar, adoptarea unui software pentru auditarea algoritmică și cartografierea infrastructurii de date existente.

Pentru a iniția cu succes procesul, organizațiile trebuie să dispună de un ecosistem de instrumente și competențe adecvate. Abordarea „De la zero la erou” necesită pregătirea terenului la nivel de companie prin următorii pași operaționali:

- Constituirea Consiliului de Guvernanță a IA: o echipă interfuncțională formată din oameni de știință specializați în date, consilieri juridici, CISO și reprezentanți ai departamentelor de afaceri.

- Inventarul activelor IA: Crearea unui registru centralizat (Registrul IA) al tuturor modelelor utilizate, inclusiv serviciile terților (IA Shadow).

- Adoptarea instrumentelor MLSecOps: Integrarea platformelor pentru monitorizarea continuă a performanței și securității modelelor în producție.

| Categorie Instrument | Funcție în framework | Exemplu de aplicație 2026 |

|---|---|---|

| Platforme AI TRiSM | Monitorizare și Încredere | Detectarea în timp real a deviației și a erorilor mērķrēsultate. |

| Software GRC (Guvernanță, Risc, Conformitate) | Gestionarea politicilor | Aliniere automată între politicile interne și cerințele Legii UE privind inteligența artificială. |

| Scanner de vulnerabilități LLM | Securitate Tehnică | Prevenirea atacurilor de tip prompt injection și a scurgerilor de date. |

Nucleul framework-ului: Cele patru funcții

Arhitectura NIST AI RMF se bazează pe patru funcții interconectate: Guvernare, Cartografiere, Măsurare și Gestionare. Această structură circulară și continuă asigură că ciclul de viață al inteligenței artificiale este monitorizat constant, reducând prejudecățile și vulnerabilitățile operaționale .

Aceste funcții nu sunt secvențiale, ci operează în mod sinergic. Implementarea lor necesită metodologii riguroase și documentație trasabilă, esențială pentru a trece eventualele audituri de conformitate.

Guvernare: Crearea unei culturi a siguranței

Funcția de Guvernare din cadrul NIST AI RMF stabilește politicile organizaționale și responsabilitățile legale. Este inima guvernanței IA , deoarece aliniază strategiile de inteligență artificială cu valorile etice, toleranța la risc și reglementările în vigoare.

În această etapă, conducerea companiei trebuie să definească clar cine este responsabil pentru fiecare sistem de inteligență artificială. Acțiunile cheie includ elaborarea unui cod de etică pentru IA, definirea nivelurilor de risc acceptabile (Declarație privind apetitul pentru risc) și crearea unor canale de comunicare transparente pentru semnalarea anomaliilor algoritmice fără teama de represalii.

Hartă: Identificarea riscurilor modelelor

Prin intermediul fazei Map din cadrul NIST AI RMF , organizațiile cataloghează fiecare sistem IA aflat în uz. Acest pas necesită documentarea datelor de antrenament, a limitelor modelului și a potențialelor impacturi negative asupra utilizatorilor finali sau asupra afacerii.

Cartografierea este adesea faza cea mai complexă. Conform datelor din domeniu, peste 60% dintre companii ignoră extinderea reală a suprafeței lor de atac AI. Este necesar să se documenteze:

- Contextul de utilizare prevăzut (Intended Use) și utilizările improprii previzibile.

- Proveniența și calitatea seturilor de date de antrenament și validare.

- Lanțul de aprovizionare al software-ului (Lista de materiale AI – AIBOM).

Măsură: Evaluarea impactului inteligenței artificiale

Faza „Măsurare” din cadrul NIST AI RMF utilizează metrici cantitative și calitative pentru a testa fiabilitatea modelelor. Aceasta include teste de stres, analize ale prejudecăților (bias) și evaluări ale robusteții, asigurând că IA funcționează în parametrii de siguranță prestabiliți.

Măsurătorile trebuie să fie obiective și repetabile. Echipele tehnice trebuie să implementeze valori de referință pentru echitate, acuratețe, interpretabilitate și reziliență la atacuri adversariale (Adversarial Machine Learning). Utilizarea echipelor roșii (red teaming) specifice pentru IA a devenit un standard de facto în 2026 pentru validarea robusteței modelelor generative înainte de lansarea în producție.

Gestionare: Atenuarea vulnerabilităților

Prin funcția de gestionare (Manage), NIST AI RMF oferă îndrumări pentru a răspunde riscurilor identificate. Companiile implementează controale tehnice, planuri de rezervă și monitorizare continuă pentru a dezactiva sau corecta sistemele IA în caz de anomalii.

Gestionarea activă a riscurilor necesită crearea unor manuale de răspuns la incidente pentru IA. Dacă un model începe să producă rezultate discriminatorii sau halucinații dăunătoare , sistemele de întrerupere automată trebuie să intervină pentru a degrada serviciul în mod sigur (degradare controlată) sau pentru a transfera controlul către un operator uman (Human-in-the-Loop).

Exemple practice de adopție în mediul de afaceri

Aplicarea NIST AI RMF în scenarii reale demonstrează versatilitatea sa. Fie că este vorba de un chatbot bazat pe LLM pentru serviciul clienți sau de algoritmi de scoring financiar , cadrul standardizează procesele de validare și lansare.

Să luăm în considerare o instituție bancară care implementează un nou sistem de aprobare a creditelor ipotecare bazat pe Machine Learning. Folosind framework-ul:

- Guvernare: Comitetul stabilește că modelul nu trebuie să utilizeze variabile demografice sensibile.

- Hartă: Se documentează faptul că modelul va fi utilizat numai pentru împrumuturi sub 100.000 de euro și se mapează datele istorice utilizate.

- Măsură: Se efectuează teste statistice pentru a verifica absența oricărei tendințe de discriminare împotriva anumitor minorități (Analiza impactului disparat).

- Gestionare: Se setează o alertă automată dacă rata de respingere pentru un anumit grup demografic depășește un prag de avertizare, activând revizuirea umană.

Rezolvarea problemelor comune

În timpul integrării NIST AI RMF , companiile se confruntă adesea cu obstacole precum lipsa de transparență a furnizorilor sau calitatea slabă a datelor. Rezolvarea acestor probleme necesită audituri efectuate de terți și actualizarea continuă a politicilor NIST RMF .

| Problemă întâlnită (Depanare) | Soluție strategică |

|---|---|

| Opacitatea modelelor terță parte (Cutie Neagră) | Solicitarea contractuală a fișelor de model (Model Cards) și a fișelor de informații despre modelul de inteligență artificială (AIBOM) de la furnizori înainte de achiziție. |

| Rezistența culturală a echipelor de dezvoltare | Integrarea controalelor de risc direct în conductele CI/CD (Shift-Left Security) pentru a nu încetini lansarea. |

| Dificultăți în cuantificarea riscului reputațional | Utilizați cadre de simulare a scenariilor și implicați părți interesate externe (de exemplu, asociații de consumatori) în faza de Măsurare. |

Pe Scurt (TL;DR)

Adoptarea NIST AI RMF în 2026 este indispensabilă pentru a gestiona riscurile inteligenței artificiale, asigurând conformitatea deplină cu Legea UE privind inteligența artificială.

Pentru a demara acest proces este necesară o guvernanță corporativă solidă, susținută de un comitet de etică multidisciplinar și de instrumente avansate pentru auditul algoritmic.

Inima framework-ului cuprinde patru funcții sinergice esențiale pentru a guverna, cartografia, măsura și gestiona în mod constant întregul ciclu de viață al modelelor.

Concluzii

Implementarea cu succes a NIST AI RMF în 2026 nu este doar o obligație de conformitate, ci și un avantaj competitiv. Companiile care stăpânesc guvernanța inteligenței artificiale construiesc încredere, inovează în siguranță și se pregătesc pentru evoluțiile normative viitoare.

Gestionarea riscurilor în domeniul inteligenței artificiale este un proces continuu, nu o destinație finală. Prin adoptarea funcțiilor de Guvernare, Cartografiere, Măsurare și Gestionare, organizațiile IT pot maximiza valoarea tehnologiilor emergente, protejându-și în același timp utilizatorii, datele și reputația pe piața globală. Investiția de astăzi în cadre structurate, precum cel al NIST, reprezintă cea mai bună asigurare împotriva incertitudinilor tehnologice de mâine.

Întrebări frecvente

Cadrul NIST AI RMF reprezintă un standard global pentru gestionarea riscurilor legate de inteligența artificială. Acest sistem permite organizațiilor să cartografieze, să măsoare și să guverneze modelele, garantând conformitatea cu reglementările europene și îmbunătățind securitatea tehnologică generală.

Arhitectura se bazează pe patru funcții continue și sinergice numite Guvernare, Cartografiere, Măsurare și Gestionare. Aceste etape permit stabilirea unor politici etice, catalogarea sistemelor utilizate, evaluarea impactului prin intermediul unor metrici obiective și atenuarea promptă a vulnerabilităților operaționale.

Pentru a iniția procesul, este fundamental să se stabilească o guvernanță corporativă solidă prin crearea unui comitet de etică multidisciplinar. Ulterior, devine necesară cartografierea infrastructurii de date existente și adoptarea unor instrumente specifice pentru monitorizarea continuă a performanței și a securității modelelor.

Pentru a depăși lipsa de transparență a furnizorilor externi, cadrul sugerează solicitarea contractuală a documentației specifice înainte de achiziție. Instrumente precum fișele tehnice ale modelelor (Model Cards) și listele de componente software sunt esențiale pentru a înțelege limitele și datele de antrenament ale modelelor opace.

Adoptarea acestui cadru standardizează procesele de validare și gestionare a riscurilor, facilitând enorm respectarea cerințelor legale europene. Utilizând software dedicat de guvernanță, companiile pot traduce politicile interne în acțiuni conforme cu directivele internaționale.

Încă ai dubii despre Implementarea NIST AI RMF în companie: Ghid 2026?

Tastați aici întrebarea dvs. specifică pentru a găsi instantaneu răspunsul oficial de la Google.

Surse și Aprofundare

- Pagina oficială a Cadrului de gestionare a riscurilor pentru IA (NIST AI RMF)

- Ghidul operațional (Playbook) pentru implementarea NIST AI RMF

- Politica Comisiei Europene privind cadrul de reglementare pentru inteligența artificială

- Regulamentul (UE) 2024/1689 privind inteligența artificială (Textul oficial EUR-Lex)

Ați găsit acest articol util? Există un alt subiect pe care ați dori să-l tratez?

Scrieți-l în comentariile de mai jos! Mă inspir direct din sugestiile voastre.