Il falso mito più pericoloso nel panorama dell’Information Technology odierno è credere che un Large Language Model (LLM), una volta addestrato, validato e messo in produzione, diventi un asset statico e prevedibile. La realtà è diametralmente opposta: i modelli generativi sono entità dinamiche che degradano rapidamente a causa del data drift e sono costantemente esposti a vulnerabilità invisibili ai sistemi tradizionali, come il prompt injection. Un efficace monitoraggio modelli ai non è una semplice lettura di log a posteriori per misurare l’uptime, ma un processo di audit attivo, semantico e in tempo reale, assolutamente essenziale per prevenire disastri reputazionali e garantire la vera sicurezza agentica.

Regola i parametri operativi del tuo LLM in produzione per valutare il livello di rischio in tempo reale e ottenere raccomandazioni di audit.

Caso Studio Reale: Il disastro del Chatbot di Air Canada (2024)

Nel 2024, Air Canada è stata ritenuta legalmente responsabile per le “allucinazioni” del suo chatbot basato su intelligenza artificiale. Il modello aveva inventato di sana pianta una policy di rimborso inesistente, comunicandola a un cliente. Il tribunale ha stabilito che l’azienda è responsabile per le informazioni fornite dai propri agenti AI. Questo caso ha dimostrato al mondo intero come l’assenza di un rigoroso sistema di audit semantico in tempo reale possa tradursi in danni legali e finanziari diretti.

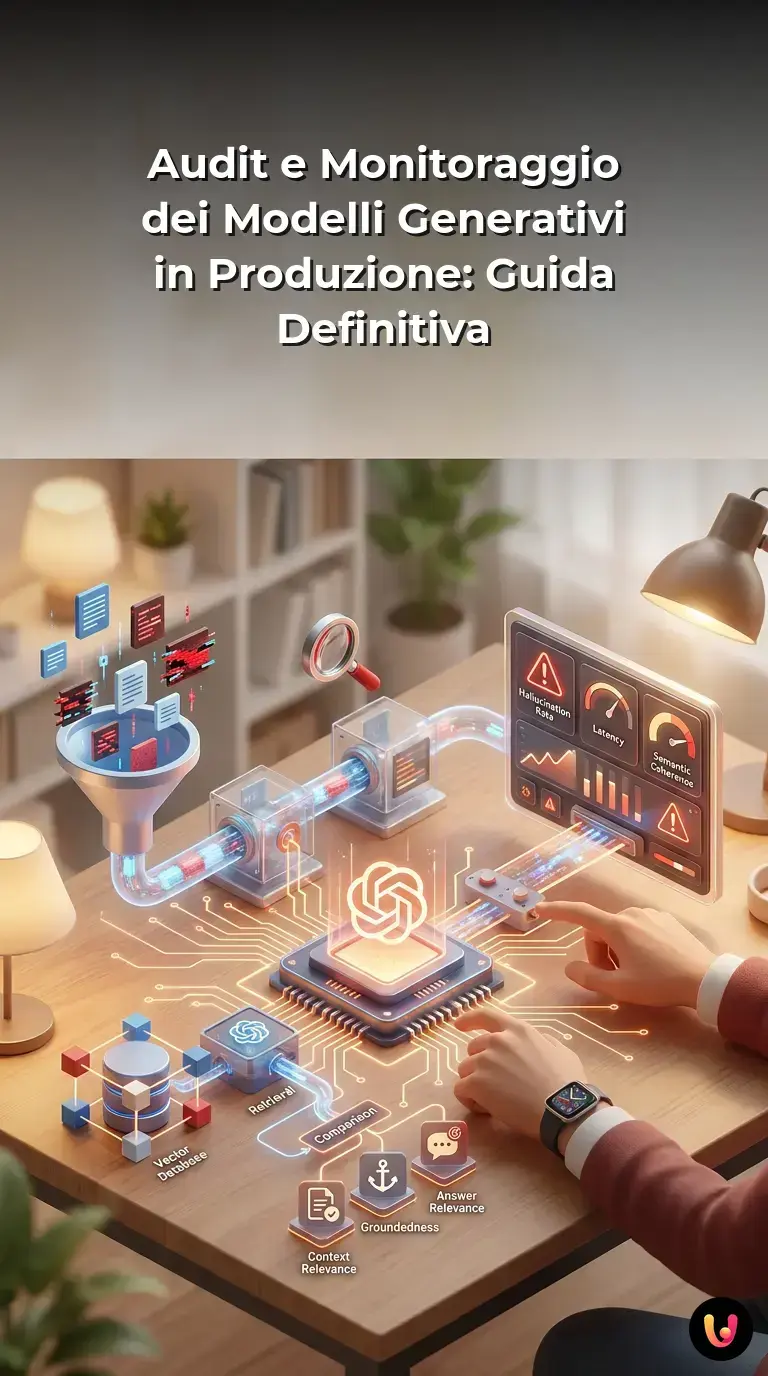

Metriche Fondamentali per la Valutazione in Produzione

Il monitoraggio modelli ai richiede l’analisi continua di metriche specifiche come il tasso di allucinazione, la latenza del token, la coerenza semantica e il costo per inferenza. Questi parametri garantiscono che l’intelligenza artificiale operi in modo efficiente e affidabile nel tempo, prevenendo degradi prestazionali.

A differenza del machine learning tradizionale, dove metriche come Accuracy o F1-Score sono sufficienti, i modelli generativi (LLM) richiedono un approccio di valutazione multidimensionale. Quando un modello genera testo, codice o decisioni, non esiste quasi mai una singola risposta corretta. Pertanto, l’audit deve concentrarsi su metriche proxy che valutino la qualità e la sicurezza dell’output.

In architetture moderne come la RAG (Retrieval-Augmented Generation), il monitoraggio si basa sulla cosiddetta “Triade RAG”:

- Context Relevance: Misura se i documenti recuperati dal database vettoriale sono effettivamente pertinenti alla domanda dell’utente.

- Groundedness (Fondatezza): Verifica che la risposta generata dall’LLM sia basata esclusivamente sul contesto fornito, senza inventare fatti (allucinazioni).

- Answer Relevance: Valuta se la risposta finale risolve effettivamente il quesito iniziale dell’utente, evitando divagazioni.

| Metrica di Monitoraggio | Descrizione Tecnica | Soglia di Allarme Tipica |

|---|---|---|

| Time to First Token (TTFT) | Il tempo impiegato dal modello per generare la prima parola della risposta. Cruciale per la UX. | > 1.5 secondi |

| Tasso di Tossicità | Percentuale di output che contengono linguaggio offensivo, bias o contenuti non sicuri. | > 0.1% |

| Token per Secondo (TPS) | La velocità di generazione del testo. Impatta direttamente sui costi di infrastruttura. | < 15 TPS |

Gestione della Sicurezza Agentica e Privacy dei Dati

Per un corretto monitoraggio modelli ai, la sicurezza agentica e la privacy sono prioritarie. È fondamentale implementare guardrail per bloccare attacchi di prompt injection e anonimizzare i dati sensibili (PII) prima che raggiungano l’LLM, prevenendo fughe di informazioni critiche.

L’integrazione di agenti autonomi basati su LLM nei flussi aziendali ha introdotto una nuova superficie di attacco. Secondo la documentazione ufficiale di OWASP Top 10 for LLMs, le vulnerabilità più critiche includono il Prompt Injection (dove un utente malintenzionato manipola le istruzioni del modello) e l’Insecure Output Handling (dove l’output del modello viene eseguito senza validazione da sistemi di backend).

Per garantire la sicurezza agentica, le aziende devono implementare un’architettura a strati (Defense in Depth):

- Input Guardrails: Sistemi di classificazione (spesso modelli ML più piccoli e veloci) che analizzano il prompt dell’utente prima di inviarlo all’LLM principale, bloccando tentativi di jailbreak.

- Data Masking Dinamico: Strumenti di Data Loss Prevention (DLP) che intercettano e offuscano informazioni di identificazione personale (PII), come numeri di carte di credito o codici fiscali, garantendo la conformità al GDPR.

- Output Guardrails: Un livello di validazione finale che verifica se la risposta dell’LLM viola le policy aziendali o contiene codice malevolo prima di mostrarla all’utente.

Strumenti e Framework per l’Osservabilità degli LLM

L’ecosistema del monitoraggio modelli ai si avvale di framework avanzati come LangSmith, Arize AI e TruEra. Questi strumenti offrono dashboard di osservabilità in tempo reale, tracciando l’esecuzione delle chain e facilitando il debugging delle risposte generate dall’intelligenza artificiale.

L’osservabilità (Observability) va oltre il semplice monitoraggio. Mentre il monitoraggio ti dice quando un sistema è rotto, l’osservabilità ti permette di capire perché si è rotto. Nel contesto dell’Informatica applicata all’AI, questo significa poter ispezionare ogni singolo passaggio logico di una “Chain” o di un agente.

I moderni stack tecnologici per l’LLMOps (Large Language Model Operations) includono:

- LangSmith / Langfuse: Piattaforme essenziali per tracciare le chiamate API, analizzare i costi dei token e fare il replay delle sessioni utente per il debugging dei prompt.

- Arize Phoenix: Uno strumento open-source eccellente per l’analisi delle performance delle applicazioni RAG, che permette di visualizzare gli embedding e identificare i cluster di query in cui il modello fallisce.

- Giskard: Un framework specializzato nel testing e nell’audit delle vulnerabilità dei modelli, capace di generare automaticamente suite di test per scovare bias e problemi di sicurezza prima del deploy in produzione.

Strategie di Mitigazione del Data Drift e Degrado

Un efficace monitoraggio modelli ai deve intercettare il data drift, ovvero il cambiamento nella distribuzione dei dati di input. L’aggiornamento continuo dei vettori di contesto e i cicli di feedback umano (RLHF) sono essenziali per mantenere alte le performance nel tempo.

Il degrado dei modelli generativi è un fenomeno subdolo. Non si manifesta con un crash del server, ma con un lento e inesorabile calo della qualità delle risposte. Questo avviene principalmente a causa del Concept Drift: il mondo cambia, il linguaggio evolve, ma i pesi del modello rimangono congelati al momento del suo ultimo addestramento.

Per mitigare questo rischio senza dover riaddestrare l’intero LLM (un’operazione dai costi proibitivi), le strategie più efficaci includono:

- Continuous RAG Updating: Mantenere il database vettoriale costantemente aggiornato con le ultime policy aziendali e informazioni di mercato. Il modello ragiona su dati freschi senza bisogno di fine-tuning.

- Shadow Deployment: Far girare una nuova versione del prompt o del modello in parallelo a quella in produzione, confrontando gli output in tempo reale senza impattare l’utente finale.

- Human-in-the-Loop (HITL): Implementare meccanismi di feedback implicito (es. l’utente che copia la risposta) ed esplicito (pollice su/giù) per raccogliere dati preziosi volti a futuri cicli di allineamento.

Conclusioni

L’implementazione di un’intelligenza artificiale generativa in ambito enterprise non si conclude con il rilascio in produzione, ma inizia esattamente in quel momento. Come abbiamo analizzato, l’assenza di un rigoroso monitoraggio modelli ai espone le organizzazioni a rischi inaccettabili, che spaziano dalle allucinazioni dannose per il brand fino a gravi violazioni della privacy e della sicurezza agentica.

Adottare un approccio proattivo, basato sull’osservabilità semantica, sull’implementazione di guardrail robusti e sull’analisi continua delle metriche RAG, è l’unico percorso sostenibile. Solo trattando i modelli AI come entità dinamiche che richiedono audit costanti, i team IT possono garantire che l’innovazione tecnologica si traduca in un reale e sicuro vantaggio competitivo.

Domande frequenti

Monitorare un modello generativo significa implementare un processo di audit attivo e semantico in tempo reale per garantire massima affidabilità. Non si tratta solo di controllare i log di sistema, ma di analizzare costantemente metriche specifiche come il tasso di allucinazione, la coerenza semantica e la latenza dei token.

I modelli subiscono un degrado qualitativo a causa del fisiologico cambiamento nella distribuzione dei dati, un fenomeno noto come data drift. Poiché il mondo e il linguaggio evolvono rapidamente, risulta essenziale aggiornare costantemente i database di contesto e integrare feedback umani per mantenere le risposte sempre precise e pertinenti.

La valutazione avviene misurando tre parametri essenziali che garantiscono la totale sicurezza del sistema. Occorre verificare la pertinenza dei documenti recuperati dal database, assicurarsi che la risposta sia basata esclusivamente sui fatti forniti per evitare pericolose invenzioni e controllare che il testo finale risolva davvero il problema posto inizialmente.

Le vulnerabilità più critiche comprendono la manipolazione malevola delle istruzioni di base e la gestione insicura dei risultati generati. Per proteggere i sistemi aziendali, risulta strettamente necessario implementare una architettura di difesa a strati che includa filtri preventivi sugli input, validazione rigorosa degli output e mascheramento dinamico delle informazioni personali.

I team di sviluppo si affidano a framework di osservabilità avanzati che permettono di ispezionare ogni singolo passaggio logico del sistema. Queste piattaforme specializzate offrono dashboard in tempo reale per tracciare le chiamate, analizzare i costi operativi e scovare eventuali problemi di sicurezza prima del rilascio al pubblico.

Hai ancora dubbi su Audit e Monitoraggio dei Modelli Generativi in Produzione: Guida Definitiva?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- AI Risk Management Framework (AI RMF) – National Institute of Standards and Technology (NIST .gov)

- Decisione Ufficiale del Tribunale Governativo: Moffatt v. Air Canada (Caso Chatbot 2024)

- Quadro normativo sull’Intelligenza Artificiale (AI Act) – Commissione Europea

- Prompt Injection: Vulnerabilità dei Modelli Linguistici (Wikipedia)

- Retrieval-Augmented Generation (RAG) – Architettura e Funzionamento (Wikipedia)

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.