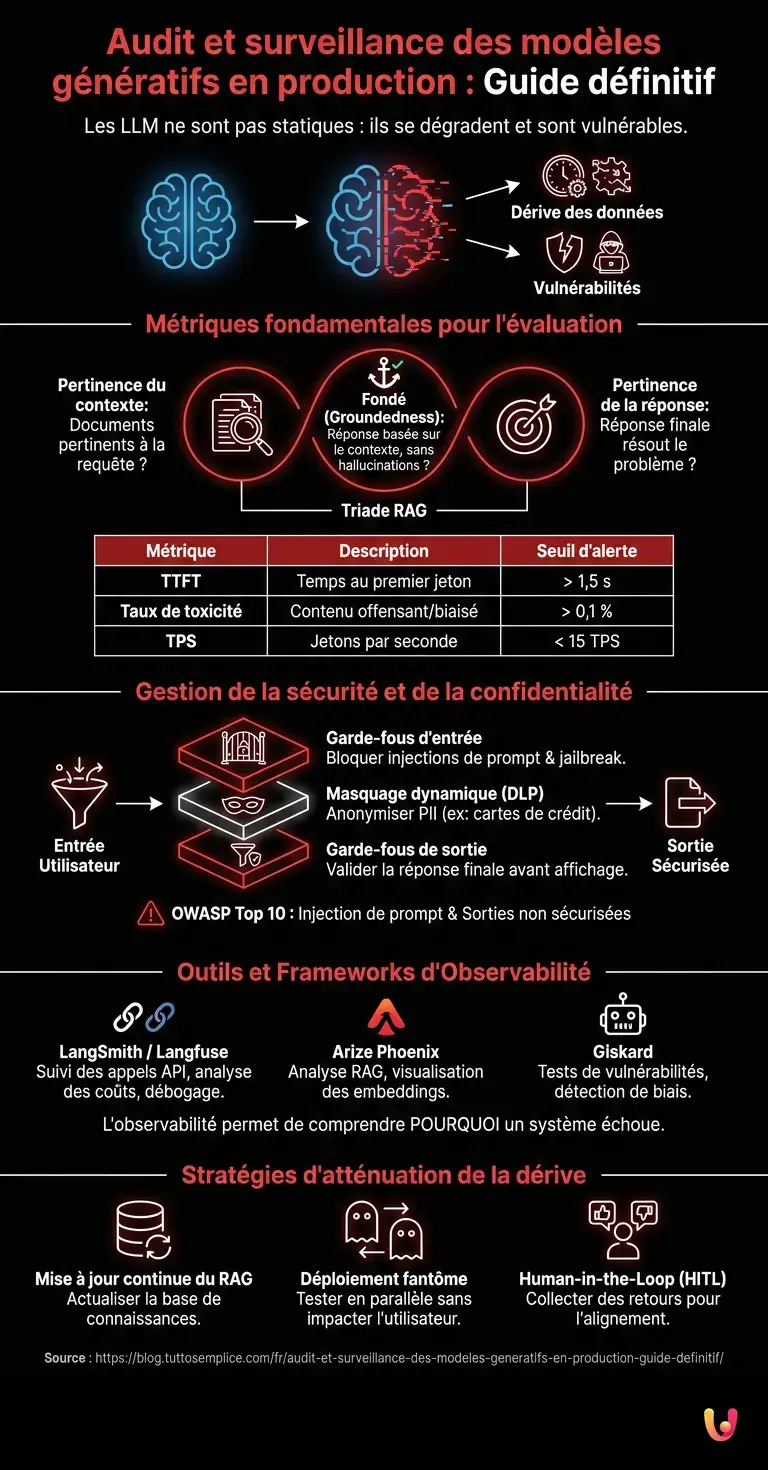

Le faux mythe le plus dangereux dans le paysage actuel des technologies de l’information est de croire qu’un grand modèle de langage (LLM), une fois entraîné, validé et mis en production, devient un actif statique et prévisible. La réalité est diamétralement opposée : les modèles génératifs sont des entités dynamiques qui se dégradent rapidement en raison de la dérive des données et sont constamment exposés à des vulnérabilités invisibles pour les systèmes traditionnels, comme l’ injection de prompt . Un suivi efficace des modèles n’est pas une simple lecture a posteriori des journaux pour mesurer le temps de disponibilité, mais un processus d’audit actif, sémantique et en temps réel, absolument essentiel pour prévenir les catastrophes réputationnelles et garantir la véritable sécurité de l’agent.

Ajustez les paramètres opérationnels de votre LLM en production pour évaluer le niveau de risque en temps réel et obtenir des recommandations d’audit.

Étude de cas réelle : Le désastre du chatbot d’Air Canada (2024)

En 2024, Air Canada a été jugée légalement responsable des « hallucinations » de son chatbot basé sur l’intelligence artificielle . Le modèle avait inventé de toutes pièces une politique de remboursement inexistante, qu’il avait communiquée à un client. Le tribunal a statué que l’entreprise était responsable des informations fournies par ses agents d’IA. Cette affaire a démontré au monde entier comment l’absence d’un système rigoureux d’audit sémantique en temps réel peut entraîner des dommages juridiques et financiers directs.

Métriques fondamentales pour l’évaluation en production

La surveillance des modèles nécessite une analyse continue de métriques spécifiques telles que le taux d’hallucination, la latence des jetons, la cohérence sémantique et le coût par inférence. Ces paramètres garantissent que l’intelligence artificielle fonctionne de manière efficace et fiable dans le temps, prévenant ainsi toute dégradation des performances.

Contrairement à l’apprentissage automatique traditionnel, où des métriques telles que l’exactitude (Accuracy) ou le score F1 suffisent, les modèles génératifs (LLM) nécessitent une approche d’évaluation multidimensionnelle. Lorsqu’un modèle génère du texte, du code ou des décisions, il n’existe presque jamais une seule réponse correcte. Par conséquent, l’audit doit se concentrer sur des métriques indirectes qui évaluent la qualité et la sécurité de la sortie.

Dans les architectures modernes comme la RAG (Retrieval-Augmented Generation) , le suivi repose sur la “triade RAG” :

- Pertinence du contexte : Mesure si les documents récupérés de la base de données vectorielle sont effectivement pertinents à la requête de l’utilisateur.

- Fondé (Groundedness) : Vérifie que la réponse générée par le LLM est basée exclusivement sur le contexte fourni, sans inventer de faits (hallucinations).

- Pertinence de la réponse : Évalue si la réponse finale répond effectivement à la question initiale de l’utilisateur, en évitant les digressions.

| Métrique de surveillance | Description technique | Seuil d’alerte typique |

|---|---|---|

| Temps jusqu’au premier jeton (TTFT) | Le temps nécessaire au modèle pour générer le premier mot de la réponse. Crucial pour l’expérience utilisateur. | > 1,5 seconde |

| Taux de toxicité | Pourcentage de résultats contenant un langage offensant, des biais ou du contenu inapproprié. | > 0,1 % |

| Jetons par seconde (TPS) | La vitesse de génération du texte. Elle impacte directement les coûts d’infrastructure. | < 15 TPS |

Gestion de la sécurité des agents et de la confidentialité des données

Pour un suivi adéquat des modèles , la sécurité des agents et la confidentialité sont prioritaires. Il est essentiel de mettre en place des garde-fous pour bloquer les attaques par injection de prompt et d’anonymiser les données sensibles (PII) avant qu’elles n’atteignent le LLM, afin de prévenir les fuites d’informations critiques.

L’intégration d’ agents autonomes basés sur des LLM dans les flux de travail d’entreprise a introduit une nouvelle surface d’attaque. Selon la documentation officielle OWASP Top 10 for LLMs , les vulnérabilités les plus critiques incluent l’ injection de prompt (où un attaquant manipule les instructions du modèle) et la gestion non sécurisée des sorties (où la sortie du modèle est exécutée sans validation par les systèmes back-end).

Pour garantir la sécurité des agents , les entreprises doivent mettre en œuvre une architecture multicouche (défense en profondeur) :

- Garde-fous d’entrée : Systèmes de classification (souvent des modèles ML plus petits et plus rapides) qui analysent l’invite de l’utilisateur avant de la soumettre au LLM principal, bloquant les tentatives de jailbreak.

- Masquage dynamique des données : Outils de prévention des pertes de données (DLP) qui interceptent et masquent les informations personnelles identifiables (PII), telles que les numéros de cartes de crédit ou les numéros de sécurité sociale, garantissant ainsi la conformité au RGPD.

- Garde-fous de sortie : un niveau de validation final qui vérifie si la réponse du LLM enfreint les politiques de l’entreprise ou contient du code malveillant avant de l’afficher à l’utilisateur.

Outils et frameworks pour l’observabilité des LLM

L’écosystème de surveillance des modèles s’appuie sur des frameworks avancés tels que LangSmith, Arize AI et TruEra. Ces outils offrent des tableaux de bord d’observabilité en temps réel, assurant le suivi de l’exécution des chaînes et facilitant le débogage des réponses générées par l’intelligence artificielle.

L’observabilité va au-delà de la simple surveillance. Alors que la surveillance vous indique quand un système est défaillant, l’observabilité vous permet de comprendre pourquoi il l’est. Dans le contexte de l’informatique appliquée à l’IA, cela signifie pouvoir inspecter chaque étape logique d’une « chaîne » ou d’un agent.

Les piles technologiques modernes pour les LLMOps (Large Language Model Operations) incluent :

- LangSmith / Langfuse : Plateformes essentielles pour suivre les appels API, analyser les coûts des jetons et rejouer les sessions utilisateur pour le débogage des invites.

- Arize Phoenix : Un excellent outil open-source pour l’analyse des performances des applications RAG, permettant de visualiser les embeddings et d’identifier les clusters de requêtes où le modèle échoue.

- Giskard : Un framework spécialisé dans le test et l’audit des vulnérabilités des modèles, capable de générer automatiquement des suites de tests pour détecter les biais et les problèmes de sécurité avant le déploiement en production.

Stratégies d’atténuation de la dérive et de la dégradation des données

Un suivi efficace des modèles doit détecter la dérive des données, c’est-à-dire le changement dans la distribution des données d’entrée. La mise à jour continue des vecteurs de contexte et les cycles de rétroaction humaine (RLHF) sont essentiels pour maintenir des performances élevées dans le temps.

La dégradation des modèles génératifs est un phénomène insidieux. Elle ne se manifeste pas par un crash du serveur, mais par une lente et inexorable baisse de la qualité des réponses. Cela est principalement dû au concept drift : le monde change, le langage évolue, mais les poids du modèle restent figés à la date de son dernier entraînement.

Pour atténuer ce risque sans avoir à réentraîner l’intégralité du LLM (une opération aux coûts prohibitifs), les stratégies les plus efficaces incluent :

- Mise à jour continue du RAG : Maintenir la base de données vectorielles constamment à jour avec les dernières politiques d’entreprise et informations de marché. Le modèle raisonne sur des données récentes sans nécessiter de réglage fin.

- Déploiement fantôme : exécuter une nouvelle version de l’invite ou du modèle en parallèle de celle en production, en comparant les résultats en temps réel sans impacter l’utilisateur final.

- Human-in-the-Loop (HITL) : Mettre en œuvre des mécanismes de rétroaction implicite (par exemple, l’utilisateur copie la réponse) et explicite (pouce vers le haut/vers le bas) pour collecter des données précieuses destinées aux futurs cycles d’alignement.

Conclusions

La mise en œuvre d’une intelligence artificielle générative en entreprise ne se termine pas avec la mise en production, mais commence précisément à ce moment-là. Comme nous l’avons analysé, l’absence d’un suivi rigoureux des modèles expose les organisations à des risques inacceptables, allant des hallucinations préjudiciables à l’image de marque aux graves violations de la vie privée et de la sécurité des agents.

Adopter une approche proactive, basée sur l’observabilité sémantique, la mise en œuvre de garde-fous robustes et l’analyse continue des métriques RAG, est la seule voie durable. Ce n’est qu’en traitant les modèles d’IA comme des entités dynamiques nécessitant des audits constants que les équipes informatiques peuvent garantir que l’innovation technologique se traduise par un avantage concurrentiel réel et sûr.

Foire aux questions

Surveiller un modèle génératif signifie mettre en œuvre un processus d’audit actif et sémantique en temps réel pour garantir une fiabilité maximale. Il ne s’agit pas seulement de contrôler les journaux système, mais d’analyser en permanence des métriques spécifiques telles que le taux d’hallucination, la cohérence sémantique et la latence des jetons.

Les modèles subissent une dégradation de leur qualité en raison de l’évolution naturelle de la distribution des données, un phénomène connu sous le nom de dérive des données. Le monde et le langage évoluant rapidement, il est essentiel de mettre constamment à jour les bases de données contextuelles et d’intégrer les retours humains pour garantir la précision et la pertinence des réponses.

L’évaluation se fait en mesurant trois paramètres essentiels qui garantissent la sécurité totale du système. Il faut vérifier la pertinence des documents récupérés de la base de données, s’assurer que la réponse est basée exclusivement sur les faits fournis pour éviter de dangereuses inventions et contrôler que le texte final résolve effectivement le problème initialement posé.

Les vulnérabilités les plus critiques incluent la manipulation malveillante des instructions de base et la gestion non sécurisée des résultats générés. Pour protéger les systèmes d’entreprise, il est absolument nécessaire de mettre en œuvre une architecture de défense multicouche comprenant des filtres préventifs sur les entrées, une validation rigoureuse des sorties et un masquage dynamique des informations personnelles.

Les équipes de développement s’appuient sur des frameworks d’observabilité avancés qui permettent d’inspecter chaque étape logique du système. Ces plateformes spécialisées offrent des tableaux de bord en temps réel pour suivre les appels, analyser les coûts opérationnels et détecter d’éventuels problèmes de sécurité avant la mise en production.

Encore des doutes sur Audit et surveillance des modèles génératifs en production : Guide définitif?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Sources et Approfondissements

- Cadre de gestion des risques liés à l’intelligence artificielle (AI RMF) – NIST

- Hallucination dans l’intelligence artificielle – Wikipédia

- Législation européenne sur l’intelligence artificielle (IA) – Commission Européenne

- Lignes directrices pour le développement et la surveillance sécurisés des systèmes d’IA (Co-publié par la CISA et le NCSC)

- Grand modèle de langage (LLM) et ses caractéristiques – Wikipédia

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.