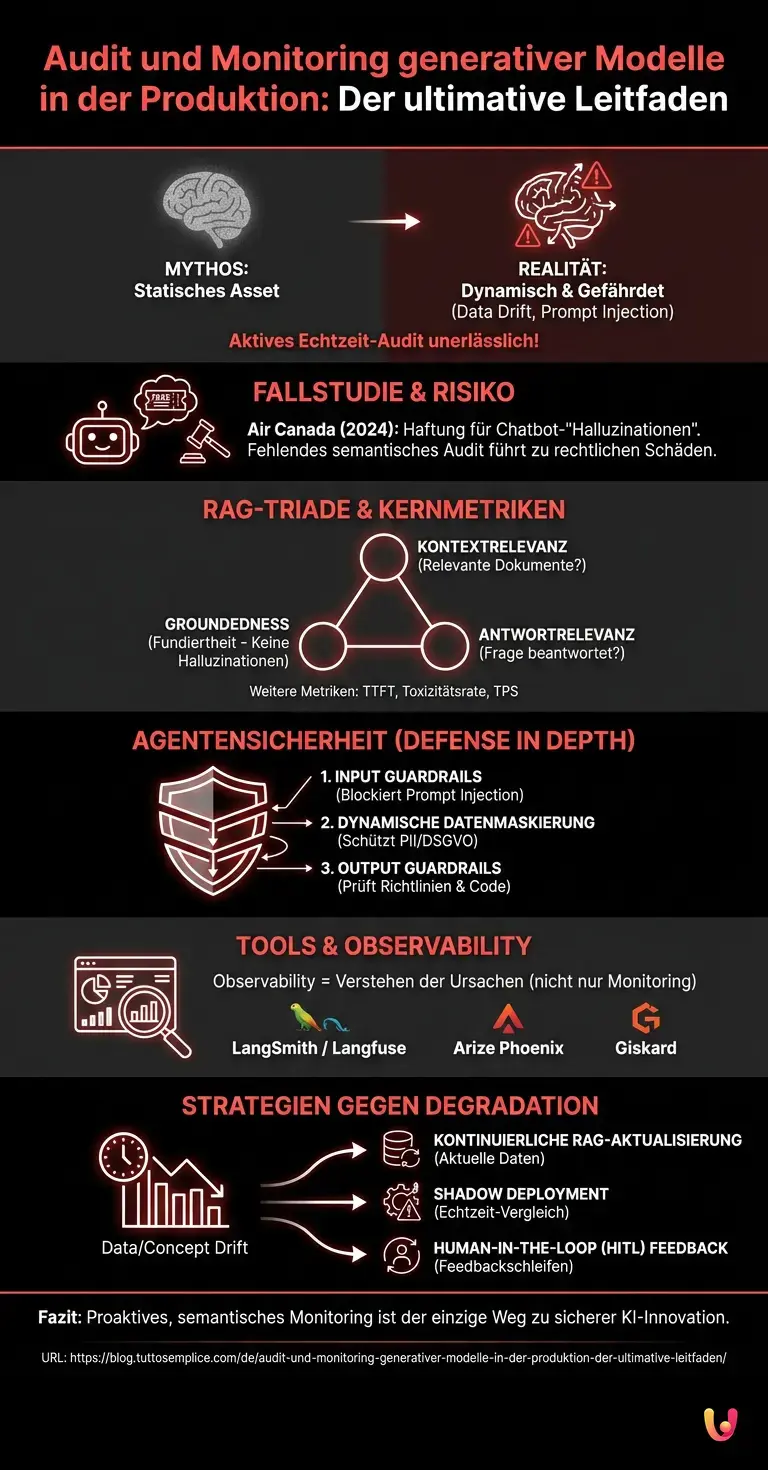

Der gefährlichste Mythos in der heutigen Informationstechnologie ist der Glaube, dass ein Large Language Model (LLM) nach dem Training, der Validierung und der Inbetriebnahme zu einem statischen und vorhersehbaren Asset wird. Die Realität ist genau das Gegenteil: Generative Modelle sind dynamische Entitäten, die aufgrund von Data Drift schnell an Qualität verlieren und ständig unsichtbaren Schwachstellen ausgesetzt sind, die für traditionelle Systeme nicht erkennbar sind, wie z. B. Prompt Injection . Ein effektives Modellmonitoring ist keine einfache nachträgliche Log-Analyse zur Messung der Betriebszeit, sondern ein aktiver, semantischer und Echtzeit-Auditprozess, der absolut unerlässlich ist, um Reputationsschäden zu vermeiden und echte Agentensicherheit zu gewährleisten.

Passen Sie die Betriebsparameter Ihres LLM in der Produktion an, um das Risikoniveau in Echtzeit zu bewerten und Audit-Empfehlungen zu erhalten.

Fallstudie aus der Praxis: Die Katastrophe mit dem Air-Canada-Chatbot (2024)

Im Jahr 2024 wurde Air Canada für die „Halluzinationen“ seines KI-basierten Chatbots rechtlich haftbar gemacht. Das Modell hatte eine nicht existierende Rückerstattungsrichtlinie erfunden und einem Kunden mitgeteilt. Das Gericht entschied, dass das Unternehmen für die von seinen KI-Agenten bereitgestellten Informationen verantwortlich ist. Dieser Fall zeigte der ganzen Welt, wie das Fehlen eines strengen semantischen Echtzeit-Auditsystems zu direkten rechtlichen und finanziellen Schäden führen kann.

Grundlegende Metriken für die Bewertung in der Produktion

Das Monitoring von Modellen erfordert die kontinuierliche Analyse spezifischer Metriken wie Halluzinationsrate, Token-Latenz, semantische Konsistenz und Kosten pro Inferenz. Diese Parameter gewährleisten, dass die künstliche Intelligenz effizient und zuverlässig arbeitet und Leistungsabfälle verhindert werden.

Im Gegensatz zum traditionellen maschinellen Lernen, bei dem Metriken wie Genauigkeit oder F1-Score ausreichen, erfordern generative Modelle (LLMs) einen mehrdimensionalen Bewertungsansatz. Wenn ein Modell Text, Code oder Entscheidungen generiert, gibt es fast nie nur eine einzige richtige Antwort. Daher muss sich das Audit auf Proxy-Metriken konzentrieren, die die Qualität und Sicherheit der Ausgabe bewerten.

In modernen Architekturen wie der RAG (Retrieval-Augmented Generation) basiert das Monitoring auf der sogenannten „RAG-Triade“:

- Kontextrelevanz: Misst, ob die aus der Vektordatenbank abgerufenen Dokumente tatsächlich für die Benutzeranfrage relevant sind.

- Groundedness (Fundiertheit): Überprüft, ob die vom LLM generierte Antwort ausschließlich auf dem bereitgestellten Kontext basiert, ohne Fakten zu erfinden (Halluzinationen).

- Antwortrelevanz: Bewerten Sie, ob die endgültige Antwort die ursprüngliche Frage des Benutzers tatsächlich beantwortet und Abschweifungen vermeidet.

| Überwachungsmetrik | Technische Beschreibung | Typischer Alarmgrenzwert |

|---|---|---|

| Zeit bis zum ersten Token (TTFT) | Die Zeit, die das Modell benötigt, um das erste Wort der Antwort zu generieren. Entscheidend für die UX. | > 1,5 Sekunden |

| Toxizitätsrate | Prozentsatz der Ausgaben, die beleidigende Sprache, Voreingenommenheit oder unsichere Inhalte enthalten. | > 0,1 % |

| Token pro Sekunde (TPS) | Die Geschwindigkeit der Texterzeugung. Sie wirkt sich direkt auf die Infrastrukturkosten aus. | < 15 TPS |

Management der Agentensicherheit und des Datenschutzes

Für ein korrektes Monitoring von Modellen haben die Sicherheit der Agenten und der Datenschutz höchste Priorität. Es ist unerlässlich, Schutzmaßnahmen zu implementieren, um Prompt-Injection-Angriffe zu blockieren und sensible Daten (PII) zu anonymisieren, bevor sie das LLM erreichen, um so das Austreten kritischer Informationen zu verhindern.

Die Integration von LLM-basierten autonomen Agenten in Unternehmensprozesse hat eine neue Angriffsfläche geschaffen. Laut der offiziellen OWASP Top 10 for LLMs- Dokumentation gehören zu den kritischsten Schwachstellen Prompt Injection (bei der ein Angreifer die Anweisungen des Modells manipuliert) und Insecure Output Handling (bei dem die Ausgabe des Modells ohne Validierung von Backend-Systemen ausgeführt wird).

Um die Sicherheit der Agenten zu gewährleisten, müssen Unternehmen eine mehrschichtige Architektur (Defense in Depth) implementieren:

- Input Guardrails: Klassifizierungssysteme (oft kleinere und schnellere ML-Modelle), die die Benutzereingabe analysieren, bevor sie an das Haupt-LLM gesendet wird, und Jailbreak-Versuche blockieren.

- Dynamische Datenmaskierung: Tools zur Verhinderung von Datenverlust (Data Loss Prevention, DLP), die personenbezogene Daten (PII) wie Kreditkartennummern oder Steuernummern abfangen und unkenntlich machen und so die DSGVO-Konformität gewährleisten.

- Output Guardrails: Eine letzte Validierungsebene, die überprüft, ob die Antwort des LLM gegen Unternehmensrichtlinien verstößt oder bösartigen Code enthält, bevor sie dem Benutzer angezeigt wird.

Tools und Frameworks für die Beobachtbarkeit von LLMs

Das Ökosystem für das Monitoring von Modellen nutzt fortschrittliche Frameworks wie LangSmith, Arize AI und TruEra. Diese Tools bieten Echtzeit-Observability-Dashboards, verfolgen die Ausführung von Chains und erleichtern das Debugging der von der KI generierten Antworten.

Beobachtbarkeit (Observability) geht über einfaches Monitoring hinaus. Während Monitoring anzeigt, wann ein System ausfällt, ermöglicht Observability das Verständnis der Ursachen des Ausfalls. Im Kontext der Informatik im Bereich KI bedeutet dies, jeden einzelnen logischen Schritt einer „Chain“ oder eines Agenten inspizieren zu können.

Moderne Technologie-Stacks für LLMOps (Large Language Model Operations) umfassen:

- LangSmith / Langfuse: Wesentliche Plattformen zum Nachverfolgen von API-Aufrufen, Analysieren von Token-Kosten und Wiedergeben von Benutzersitzungen zum Debuggen von Prompts.

- Arize Phoenix: Ein ausgezeichnetes Open-Source-Tool zur Analyse der Performance von RAG-Anwendungen, das die Visualisierung von Embeddings und die Identifizierung von Abfrageclustern ermöglicht, in denen das Modell versagt.

- Giskard: Ein Framework, das auf das Testen und die Prüfung von Schwachstellen in Modellen spezialisiert ist und automatisch Testsuiten generieren kann, um Verzerrungen und Sicherheitsprobleme vor dem Einsatz in der Produktion aufzudecken.

Strategien zur Minderung von Data Drift und Degradation

Ein effektives Modellmonitoring muss den Data-Drift, also die Veränderung der Verteilung der Eingabedaten, erkennen. Die kontinuierliche Aktualisierung der Kontextvektoren und menschliche Feedbackschleifen (RLHF) sind unerlässlich, um die Leistung langfristig hoch zu halten.

Die Degradation generativer Modelle ist ein heimtückisches Phänomen. Sie äußert sich nicht in einem Serverabsturz, sondern in einem langsamen und unaufhaltsamen Qualitätsverlust der Antworten. Dies geschieht hauptsächlich aufgrund von Concept Drift : Die Welt verändert sich, die Sprache entwickelt sich weiter, aber die Gewichte des Modells bleiben auf dem Stand seines letzten Trainings eingefroren.

Um dieses Risiko zu mindern, ohne das gesamte LLM neu trainieren zu müssen (ein Vorgang mit unerschwinglichen Kosten), umfassen die effektivsten Strategien:

- Kontinuierliche RAG-Aktualisierung: Die Vektordatenbank wird stets mit den neuesten Unternehmensrichtlinien und Marktinformationen aktualisiert. Das Modell arbeitet mit aktuellen Daten, ohne dass ein Fine-Tuning erforderlich ist.

- Shadow Deployment: Eine neue Version des Prompts oder Modells parallel zur Produktionsversion ausführen und die Ergebnisse in Echtzeit vergleichen, ohne den Endbenutzer zu beeinträchtigen.

- Human-in-the-Loop (HITL): Implementierung impliziter (z. B. der Benutzer kopiert die Antwort) und expliziter (Daumen hoch/runter) Feedbackmechanismen, um wertvolle Daten für zukünftige Ausrichtungszyklen zu sammeln.

Schlussfolgerungen

Die Implementierung generativer KI im Unternehmensbereich endet nicht mit der Inbetriebnahme, sondern beginnt genau in diesem Moment. Wie wir analysiert haben, setzt das Fehlen einer strengen Modellüberwachung Unternehmen inakzeptablen Risiken aus, die von markenschädigenden Halluzinationen bis hin zu schwerwiegenden Verletzungen der Privatsphäre und der Agentensicherheit reichen.

Ein proaktiver Ansatz, der auf semantischer Beobachtbarkeit, der Implementierung robuster Guardrails und der kontinuierlichen Analyse von RAG-Metriken basiert, ist der einzig nachhaltige Weg. Nur durch die Behandlung von KI-Modellen als dynamische Entitäten, die ständige Audits erfordern, können IT-Teams sicherstellen, dass technologische Innovationen zu einem echten und sicheren Wettbewerbsvorteil führen.

Häufig gestellte Fragen

Die Überwachung eines generativen Modells bedeutet die Implementierung eines aktiven und semantischen Auditprozesses in Echtzeit, um maximale Zuverlässigkeit zu gewährleisten. Dabei geht es nicht nur um die Kontrolle von Systemprotokollen, sondern um die kontinuierliche Analyse spezifischer Metriken wie Halluzinationsrate, semantische Konsistenz und Token-Latenz.

Die Modelle unterliegen aufgrund der natürlichen Veränderung in der Datenverteilung, einem Phänomen, das als Data Drift bekannt ist, einem qualitativen Abbau. Da sich die Welt und die Sprache schnell entwickeln, ist es unerlässlich, die Kontextdatenbanken ständig zu aktualisieren und menschliches Feedback zu integrieren, um die Genauigkeit und Relevanz der Antworten aufrechtzuerhalten.

Die Bewertung erfolgt durch die Messung dreier wesentlicher Parameter, die die absolute Sicherheit des Systems gewährleisten. Es muss die Relevanz der aus der Datenbank abgerufenen Dokumente überprüft, sichergestellt werden, dass die Antwort ausschließlich auf den bereitgestellten Fakten basiert, um gefährliche Erfindungen zu vermeiden, und kontrolliert werden, dass der endgültige Text das ursprünglich gestellte Problem tatsächlich löst.

Zu den kritischsten Schwachstellen gehören die böswillige Manipulation von Basisbefehlen und die unsichere Handhabung der generierten Ergebnisse. Zum Schutz von Unternehmenssystemen ist die Implementierung einer mehrschichtigen Verteidigungsarchitektur unerlässlich, die präventive Filter für Eingaben, eine strenge Validierung von Ausgaben und eine dynamische Maskierung personenbezogener Daten umfasst.

Entwicklungsteams setzen auf fortschrittliche Observability-Frameworks, die es ermöglichen, jeden einzelnen logischen Schritt des Systems zu überprüfen. Diese spezialisierten Plattformen bieten Echtzeit-Dashboards zur Nachverfolgung von Aufrufen, zur Analyse der Betriebskosten und zur Aufdeckung möglicher Sicherheitsprobleme vor der Veröffentlichung.

Haben Sie noch Zweifel an Audit und Monitoring generativer Modelle in der Produktion: Der ultimative Leitfaden?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

- KI-Prüfkatalog: Leitfaden zur Prüfung und Gestaltung vertrauenswürdiger Künstlicher Intelligenz – Fraunhofer IAIS

- NIST Artificial Intelligence Risk Management Framework (AI RMF) – US-Regierung

- Large Language Model (LLM) – Grundlagen und Risiken (Wikipedia)

- Prompt Injection bei generativen KI-Modellen (Wikipedia)

- Retrieval-Augmented Generation (RAG) Architektur (Wikipedia)

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.