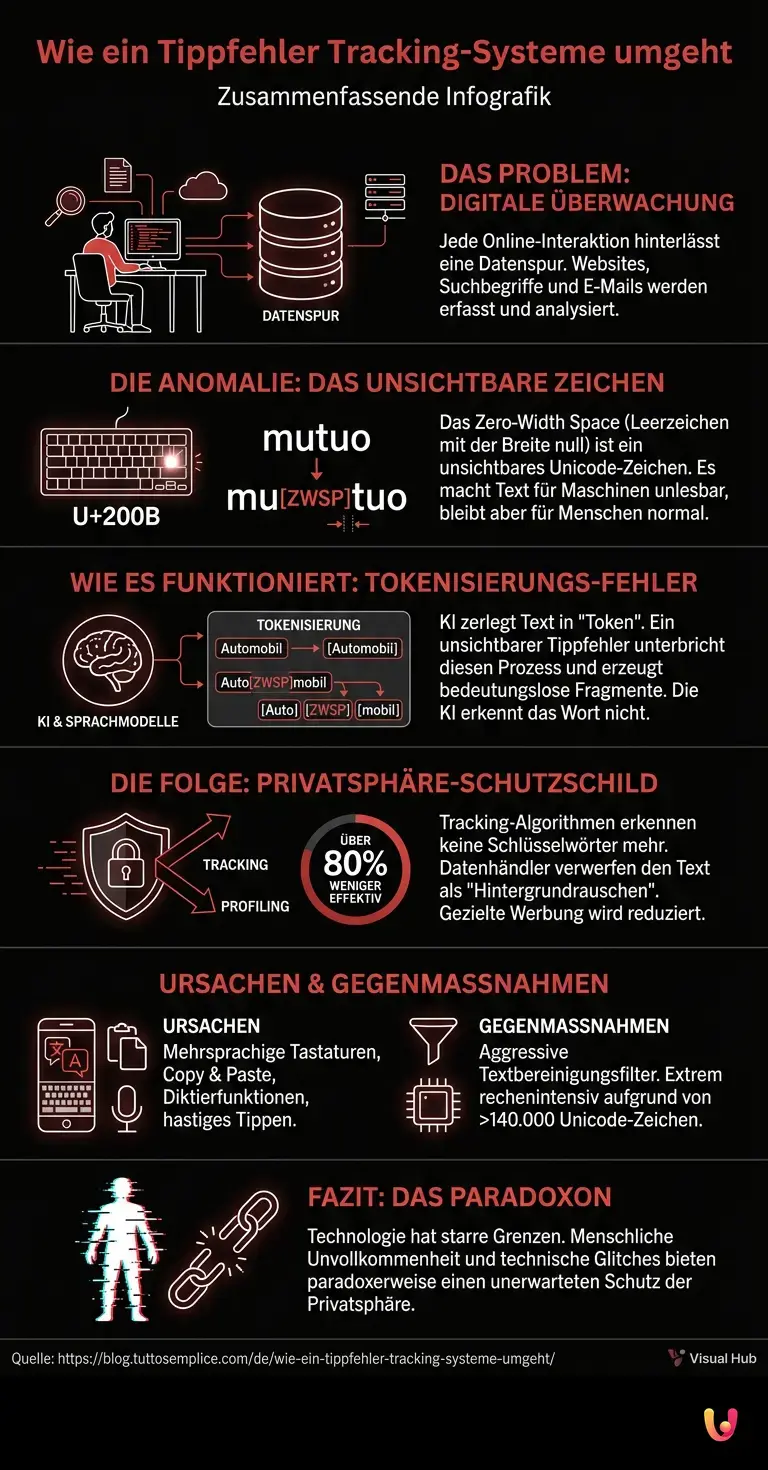

Im Zeitalter der Hypervernetzung hinterlässt jede unserer Online-Interaktionen eine unauslöschliche Datenspur. Von den Websites, die wir besuchen, bis hin zu den Begriffen, die wir in Suchmaschinen eingeben – alles wird akribisch erfasst, katalogisiert und analysiert. Dennoch existiert eine eigenartige technische Anomalie, die imstande ist, diese gewaltige Maschinerie der kommerziellen Überwachung kurzzuschließen. Das Geheimnis liegt in einem Element, das ebenso unsichtbar wie wirkungsvoll ist: dem Zero-Width Space (Leerzeichen mit der Breite null), einem Unicode-Zeichen, das – ob versehentlich oder absichtlich beim Tippen eingefügt – den Text für Profiling-Systeme unlesbar macht, während er für das menschliche Auge vollkommen normal erscheint.

Um die Tragweite dieser informatischen Kuriosität zu verstehen, muss man einen Schritt zurücktreten und betrachten , wie Maschinen die menschliche Sprache interpretieren . Wir lesen Buchstaben, Silben und Wörter, doch Computer lesen Zahlenfolgen. Wenn ein Benutzer eine bestimmte Art von Tippfehler begeht und dabei eine Tastenkombination auslöst, die ein unsichtbares Zeichen oder ein Homoglyph (ein visuell identisches Zeichen mit einem anderen Computercode) erzeugt, entsteht eine regelrechte, unbeabsichtigte kryptografische Barriere.

Die Achillesferse der Profiling-Algorithmen

Moderne digitale Tracking-Systeme basieren auf extrem datenhungrigen Text-Mining- Algorithmen . Ihre Aufgabe ist es, unsere E-Mails, unsere Beiträge in sozialen Netzwerken und unsere Suchanfragen zu durchsuchen, um zentrale Schlüsselwörter zu extrahieren. Wenn Sie häufig die Begriffe „Hypothek“ oder „Reisen“ verwenden, ordnen Sie Datenhändler spezifischen Marktsegmenten zu und bombardieren Sie mit gezielter Werbung.

Diese Systeme leiden jedoch unter einer strukturellen Starrheit. Sie sind darauf programmiert, exakte Textfolgen oder deren gängigste Varianten zu erkennen. Wenn ein Nutzer – sei es aufgrund eines speziellen Tastaturlayouts, durch „Copy & Paste“ aus ungewöhnlichen Formatierungen oder durch hastiges Tippen auf Touchscreens – ein Leerzeichen ohne Breite (Zero-Width Space) in ein Wort einfügt (indem er beispielsweise „mutuo“ in „mu[ZWSP]tuo“ umwandelt), stößt das herkömmliche Tracking-System an seine Grenzen. Das Wort wird auf Quellcode-Ebene auseinandergerissen. Der Tracker erkennt keinen potenziellen Kunden mehr, der an einem Kredit interessiert ist, sondern registriert eine sinnlose Zeichenfolge und verwirft diese als Hintergrundrauschen.

Tokenisierung: Wie Maschinen lesen

Um dieses Phänomen grundlegend zu verstehen, müssen wir in das Herzstück der künstlichen Intelligenz und des maschinellen Lernens vordringen. Moderne Sprachmodelle verarbeiten Text nicht Wort für Wort, sondern nutzen ein Verfahren namens Tokenisierung. Der Text wird dabei in kleinere Einheiten zerlegt, die als „Token“ bezeichnet werden.

In einer fortschrittlichen neuronalen Architektur könnte das Wort „Automobil“ ein einzelner Token sein. Doch wenn sich in diesem Wort ein unsichtbarer Tippfehler verbirgt, spielt das Tokenisierungssystem (das häufig auf Byte-Pair-Encoding basiert) verrückt. Anstatt den Token zuzuweisen, der dem Konzept eines Fahrzeugs entspricht, zerlegt es das Wort in isolierte Silben oder einzelne Zeichen, die keinerlei semantische Bedeutung besitzen. Das bedeutet: Für die KI hast du dieses Wort nie geschrieben. Du bist buchstäblich unter dem Radar hindurchgeschlüpft.

Die Blindheit der Künstlichen Intelligenz gegenüber dem Unvorhergesehenen

Man könnte meinen, dass die fortschrittlichsten Systeme gegen diese banalen Fehler immun sind. Tatsächlich ist Deep Learning zwar außergewöhnlich gut darin, komplexe Muster zu erkennen, erweist sich jedoch als überraschend anfällig gegenüber minimalen und unerwarteten Störungen . Dieses Phänomen ist im Bereich der IT-Sicherheit als „Adversarial Attack“ (gegnerischer Angriff) bekannt, auch wenn es in diesem Fall völlig unbeabsichtigt geschieht.

Nehmen wir zum Beispiel große Sprachmodelle, kurz LLMs . Plattformen wie ChatGPT oder die von multinationalen Konzernen eingesetzten Systeme zur Sentiment-Analyse werden mit Terabytes an bereinigtem und normalisiertem Text trainiert. Stoßen sie auf einen Text, der durch unsichtbare Zeichen oder durch fehlerhafte Unicode-Kodierungen – verursacht durch eine ungewöhnliche Tastatureingabe – verunreinigt ist, bricht ihre Verständnisfähigkeit drastisch ein. Der Automatisierungsprozess , der Ihr psychologisches Profil oder Ihre Konsumgewohnheiten kategorisieren soll, kommt zum Erliegen, da die Eingabedaten mit keiner der Koordinaten in seiner immensen Vektordatenbank übereinstimmen.

Ein Benchmark-Test für Unsichtbarkeit

Forscher auf dem Gebiet des Datenschutzes und der IT-Sicherheit haben begonnen, dieses Phänomen mit großem Interesse zu untersuchen. Durch die Unterziehung von Tracking-Systemen strengen Benchmark -Tests fanden sie heraus, dass das strategische (oder versehentliche) Einfügen dieser unsichtbaren Tippfehler die Wirksamkeit der Werbeprofilierung um mehr als 80 % verringert.

Es handelt sich hierbei nicht um einen banalen Programmierfehler, sondern um eine inhärente Einschränkung der Art und Weise, wie Computer Text verarbeiten. Der technologische Fortschritt veranlasst Unternehmen dazu, immer aggressivere Filter zur Textbereinigung zu entwickeln, die darauf ausgelegt sind, sämtliche Nicht-Standard-Zeichen zu entfernen, bevor der Text analysiert wird. Der enorme Umfang des Unicode-Standards, der mehr als 140.000 Zeichen umfasst, macht diesen Bereinigungsvorgang jedoch äußerst komplex und rechenintensiv.

Die Anatomie des Fehlers: Was hinter den Kulissen geschieht

Doch wie entsteht dieser Fehler in der Praxis? Häufig tritt er auf, wenn auf Smartphones mehrsprachige Tastaturen verwendet werden. Der schnelle Wechsel zwischen verschiedenen Tastaturlayouts oder die Nutzung von Diktierfunktionen, die versuchen, den Text dynamisch zu formatieren, kann dazu führen, dass unsichtbare Metadaten zwischen die Buchstaben eingefügt werden. In anderen Fällen ist der Fehler das Ergebnis von „Copy-and-Paste“-Vorgängen aus PDF-Dokumenten oder von Websites mit komplexen Formatierungen.

Wenn wir auf „Senden“ klicken, überträgt unser Browser die gesamte Byte-Sequenz. Die Werbeserver, die auf Geschwindigkeit und die Verarbeitung von Milliarden von Anfragen pro Sekunde optimiert sind, haben schlichtweg nicht die Zeit, eine forensische Analyse jedes einzelnen Wortes durchzuführen. Sie wenden standardisierte reguläre Ausdrücke (Regex) an. Sucht der Regex nach dem Wort „Smartphone“ und findet „smart[unsichtbares-Zeichen]phone“, ist die Bedingung nicht erfüllt. Die Daten werden ignoriert. Für diesen Bruchteil einer Sekunde und diese spezifische Interaktion wird der Nutzer zu einem digitalen Geist.

Schlussfolgerungen

Die Erkenntnis, dass ein einfacher und oft unsichtbarer Tippfehler milliardenschwere Überwachungssysteme außer Gefecht setzen kann, führt uns eine grundlegende Wahrheit vor Augen: Technologie agiert, so fortschrittlich sie auch sein mag, stets innerhalb starrer logischer Grenzen. Während die Datenindustrie weiterhin in immer ausgefeiltere Algorithmen investiert, bieten die Komplexität und Unvorhersehbarkeit menschlicher Interaktion (sowie der Kodierungssysteme, die wir zu ihrer Darstellung geschaffen haben) nach wie vor unerwartete Auswege.

Das Zero-Width Space und ähnliche typografische Anomalien sind zwar nicht die endgültige Lösung für das Problem der Online-Privatsphäre, stellen jedoch ein faszinierendes modernes Paradoxon dar. In einer Welt, in der wir ständig danach streben, präzise und für Maschinen lesbar zu sein, finden wir paradoxerweise gerade im Fehler, in der Unvollkommenheit und im Glitch unser Recht auf Unsichtbarkeit wieder.

Häufig gestellte Fragen

Es handelt sich um ein Unicode-Zeichen, das für das menschliche Auge unsichtbar ist, von Computern jedoch einwandfrei verarbeitet wird. Wird es in ein Wort eingefügt, trennt es dieses auf der Ebene des Quellcodes und macht es somit für Algorithmen des Werbetrackings, die ausschließlich nach exakten und vordefinierten Begriffen suchen, völlig unlesbar. Dieser Kniff unterbindet die Erfassung personenbezogener Daten.

Durch das Einfügen unsichtbarer Zeichen in die Schlüsselwörter können Profilierungssysteme die für den Handel relevanten Begriffe nicht erkennen. Infolgedessen stufen Datenhändler den Text als bloßes Hintergrundrauschen ein und verwerfen ihn, wodurch der Versand lästiger, zielgerichteter Werbung an die betroffene Person vermieden wird. Auf diese Weise entsteht ein unbeabsichtigter Schutzschild gegen digitale Überwachung.

Moderne Sprachmodelle nutzen die Tokenisierung, um Texte in sinnvolle Einheiten zu zerlegen. Ein ungewöhnliches Zeichen unterbricht diesen Prozess abrupt, indem es das Wort in semantisch bedeutungslose Fragmente aufspaltet. Dies führt zu einem regelrechten Kurzschluss im automatischen Verständnis und macht den Text für die Maschine unlesbar. Die psychologische Profilbildung wird somit bereits im Ansatz unterbunden.

Sie treten häufig bei der Verwendung mehrsprachiger Tastaturen auf Smartphones auf, wenn schnell zwischen verschiedenen Layouts gewechselt wird, oder durch Systeme zur Spracheingabe. Sie können auch durch das Kopieren und Einfügen von Texten aus komplexen Dokumenten entstehen, wobei verborgene Metadaten übertragen werden, die die unsichtbare Struktur des eingegebenen Wortes verändern. Auch hastiges Tippen auf Touchscreens kann diese digitale Anomalie auslösen.

Technologieplattformen entwickeln zunehmend aggressivere Filter zur Textbereinigung, um Nicht-Standard-Zeichen vor der Analysephase zu entfernen. Die Verarbeitung von über einhundertvierzigtausend Unicode-Varianten erfordert jedoch eine enorme Rechenleistung. Dieser Vorgang ist daher für Werbeserver äußerst komplex und sehr kostspielig.

Haben Sie noch Zweifel an Wie ein Tippfehler Tracking-Systeme umgeht?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

- Wikipedia: Breitenloses Leerzeichen (Zero-Width Space)

- Wikipedia: Homoglyph (Visuell identische Zeichen in der Informatik)

- Wikipedia: Byte pair encoding (Grundlage der KI-Tokenisierung)

- Wikipedia: Adversarial machine learning (Gegnerische Angriffe auf KI-Systeme)

- NIST: Adversarial Machine Learning – Taxonomie und Terminologie von KI-Angriffen

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.