En Bref (TL;DR)

Le secteur financier de 2026 évolue vers des agents IA autonomes capables de planifier et d’exécuter des actions complexes au-delà de la simple conversation.

Une architecture d’entreprise robuste doit intégrer l’orchestration logique, la mémoire à long terme et des connexions API sécurisées pour gérer les opérations bancaires critiques.

La sécurité opérationnelle dépend de contrôles d’exécution rigoureux, d’un sandboxing déterministe et d’une traçabilité complète des décisions pour garantir la conformité.

Le diable est dans les détails. 👇 Continuez à lire pour découvrir les étapes critiques et les conseils pratiques pour ne pas vous tromper.

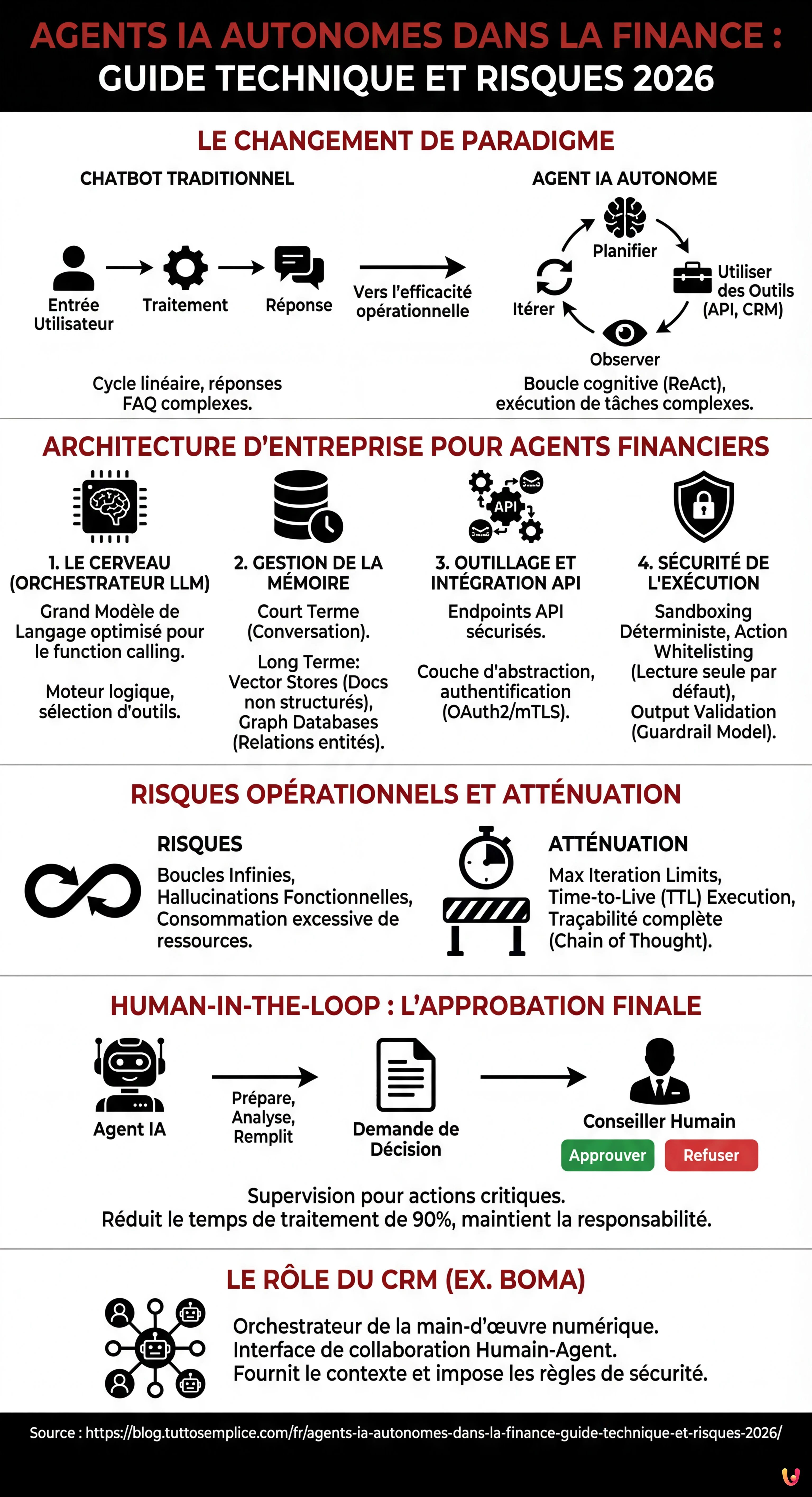

Nous sommes en 2026 et le paradigme du Service Client financier a définitivement changé. Si, il y a deux ans, l’objectif était de mettre en œuvre des chatbots conversationnels capables de répondre à des FAQ complexes, aujourd’hui la frontière s’est déplacée vers les agents IA autonomes. Nous ne parlons plus de logiciels qui parlent, mais d’entités numériques qui agissent. Dans le contexte de l’entreprise, et plus spécifiquement dans le secteur bancaire et des assurances, la capacité d’une IA à exécuter des tâches complexes – comme calculer une mensualité de prêt immobilier personnalisée, récupérer des documents manquants dans des bases de données hétérogènes et réserver un appel avec un conseiller humain – représente le nouveau standard d’efficacité opérationnelle.

Ce guide technique explore l’architecture nécessaire pour orchestrer ces agents, en analysant les défis critiques liés à la sécurité, à la mémoire à long terme et à la traçabilité des décisions dans un environnement réglementé.

De l’Automatisation Statique à l’Agent Autonome : Le Changement de Paradigme

La différence substantielle entre un chatbot traditionnel (même basé sur un LLM) et les agents IA autonomes réside dans le cycle d’exécution. Alors qu’un chatbot suit un schéma Entrée Utilisateur -> Traitement -> Réponse, un agent autonome opère selon une boucle cognitive plus complexe, souvent basée sur le modèle ReAct (Reason + Act) ou sur des architectures évoluées dérivées de frameworks comme LangChain ou AutoGPT.

Dans un scénario financier, l’agent ne se contente pas de dire « Voici le formulaire pour le prêt ». L’agent :

- Planifie : Il décompose la demande (« Je veux renégocier mon prêt ») en sous-tâches (Vérification d’identité, Analyse de la situation d’endettement actuelle, Calcul des nouveaux taux, Génération de la proposition).

- Utilise des Outils (Tools) : Il interroge les API du Core Banking, accède au CRM, utilise des calculateurs financiers.

- Observe : Il analyse la sortie des outils (ex. « Le client a une mensualité impayée »).

- Itère : Il modifie le plan en fonction de l’observation (ex. « Avant de renégocier, proposer un plan d’apurement pour la mensualité impayée »).

Architecture d’Entreprise pour Agents Financiers

Pour mettre en œuvre une main-d’œuvre numérique synthétique dans un contexte tel que le secteur bancaire, un script Python ne suffit pas. Une architecture robuste composée de quatre piliers fondamentaux est nécessaire.

1. Le Cerveau (Orchestrateur LLM)

Le cœur du système est un Grand Modèle de Langage (LLM) optimisé pour le function calling. En 2026, les modèles ne sont pas seulement des générateurs de texte, mais des moteurs logiques capables de sélectionner quel outil utiliser parmi des centaines disponibles. L’orchestration se fait via des frameworks qui gèrent le flux de pensée de l’agent, garantissant qu’il reste concentré sur l’objectif.

2. Gestion de la Mémoire à Long Terme

Un agent financier doit se souvenir. Pas seulement de la conversation actuelle (Short-term memory), mais de l’historique du client (Long-term memory). Ici, l’architecture se divise :

- Vector Stores (RAG) : Pour récupérer les politiques, contrats et documentation non structurée.

- Graph Databases : Fondamentaux pour cartographier les relations entre entités (Client -> Compte -> Cotitulaire -> Garant).

Le défi technique est la cohérence de l’état : l’agent doit savoir que le document téléchargé hier est également valide pour la demande d’aujourd’hui.

3. Outillage et Intégration API

Les agents sont inutiles sans mains. Dans la finance, les « tools » sont des endpoints API sécurisés. L’architecture doit prévoir une couche d’abstraction qui traduit l’intention de l’agent (« Vérifier le solde ») en un appel REST sécurisé, gérant l’authentification (OAuth2/mTLS) et la gestion des erreurs sans exposer de données sensibles dans le prompt.

Sécurité de l’Exécution : Le Concept de Sandboxing

La sécurité est le principal obstacle à l’adoption des agents IA autonomes. Si un agent a la permission d’effectuer des virements ou de modifier des données signalétiques, le risque d’erreurs ou de manipulations (Prompt Injection) est inacceptable.

Les stratégies d’atténuation en 2026 incluent :

- Action Whitelisting (Liste Blanche d’Actions) : L’agent peut proposer n’importe quelle action, mais ne peut exécuter de manière autonome que des actions de lecture (requêtes GET). Les actions d’écriture (POST/PUT/DELETE) nécessitent des niveaux d’autorisation supérieurs.

- Sandboxing Déterministe : L’exécution du code ou des requêtes SQL générés par l’IA se fait dans des environnements isolés et avec des permissions de lecture seule strictement limitées au contexte du client spécifique.

- Output Validation : Chaque réponse de l’agent passe par un « Guardrail Model », un modèle plus petit et spécialisé qui vérifie la conformité de la réponse aux politiques de l’entreprise avant qu’elle n’atteigne l’utilisateur.

Traçabilité et Observabilité

En cas d’audit, la banque doit pouvoir expliquer pourquoi l’agent a pris une décision. Les logs traditionnels ne suffisent pas. Il est nécessaire de mettre en œuvre des systèmes de LLM Observability qui enregistrent l’intégralité de la « Chain of Thought » (Chaîne de Pensée). Cela permet de reconstruire le raisonnement logique : « L’agent a refusé la transaction car il a détecté un schéma de dépense anormal dans l’Outil X et a appliqué la Politique Y ».

Risques Opérationnels : Boucles Infinies et Hallucinations Fonctionnelles

Un risque technique spécifique aux agents autonomes est la boucle infinie. Un agent pourrait entrer dans un cercle vicieux où il essaie de récupérer un document, échoue, réessaie, échoue à nouveau, consommant des tokens et des ressources API indéfiniment. Pour atténuer ce risque, il est essentiel de mettre en œuvre :

- Max Iteration Limits : Un arrêt forcé après un nombre prédéfini d’étapes logiques (ex. max 10 étapes pour résoudre un ticket).

- Time-to-Live (TTL) Execution : Des délais d’attente (timeouts) rigoureux pour chaque appel à des outils externes.

Human-in-the-loop : L’Approbation Finale

Malgré l’autonomie, les actions critiques nécessitent encore la supervision humaine. L’approche Human-in-the-loop (HITL) est la norme pour les opérations à fort impact (ex. approbation finale d’un prêt ou déblocage d’un compte suspendu).

Dans ce scénario, l’agent prépare tout le travail fastidieux : il collecte les données, effectue l’analyse préliminaire, remplit les formulaires et présente au conseiller humain une « Demande de Décision ». L’humain n’a plus qu’à cliquer sur « Approuver » ou « Refuser », en ajoutant éventuellement des notes. Cela réduit le temps de traitement de 90% tout en maintenant la responsabilité humaine sur les décisions finales.

Le Rôle de BOMA et l’Évolution du CRM

Dans cet écosystème, des plateformes comme BOMA ne se positionnent plus comme de simples référentiels de données, mais comme des orchestrateurs de la main-d’œuvre numérique. Le CRM du futur (et du présent 2026) est l’interface où humains et agents IA autonomes collaborent. BOMA agit comme la couche de contrôle qui fournit aux agents le contexte nécessaire (les données du client) et impose les règles d’engagement (les politiques de sécurité), transformant le CRM d’un outil passif en un collègue actif.

Conclusions

L’adoption d’agents IA autonomes dans le service client financier n’est pas une simple mise à niveau technologique, mais une restructuration opérationnelle. Elle nécessite une gouvernance rigoureuse, une architecture pensée pour la faillibilité (dégradation gracieuse) et une sécurité « by design ». Les organisations qui réussiront à équilibrer l’autonomie des agents avec le contrôle humain définiront les nouveaux standards d’efficacité et de satisfaction client pour la prochaine décennie.

Foire aux questions

La distinction fondamentale réside dans la capacité d exécution opérationnelle. Alors que les chatbots suivent un cycle linéaire d entrée et de réponse conversationnelle, les agents autonomes opèrent à travers des boucles cognitives complexes, souvent basées sur le modèle ReAct, qui leur permettent de planifier, d utiliser des outils externes et d itérer les actions en fonction des résultats. Ils ne se limitent pas à fournir des informations, mais exécutent des tâches concrètes comme le calcul de mensualités ou la récupération de documents dans des bases de données hétérogènes.

La sécurité repose sur des stratégies rigoureuses comme l Action Whitelisting, qui limite l autonomie de l agent aux seules opérations de lecture, nécessitant des autorisations supérieures pour les modifications de données. De plus, on utilise le Sandboxing Déterministe pour isoler l exécution du code et des modèles de validation de sortie, connus sous le nom de Guardrail Model, qui vérifient la conformité des réponses aux politiques de l entreprise avant qu elles n atteignent l utilisateur final.

Malgré l autonomie élevée des agents, les décisions critiques comme l approbation d un prêt ou le déblocage d un compte nécessitent la supervision humaine pour garantir la responsabilité légale et la conformité. Dans ce modèle, l agent IA effectue tout le travail préparatoire de collecte et d analyse des données, présentant au conseiller humain une demande de décision finale structurée, réduisant drastiquement les temps de traitement sans éliminer le contrôle humain.

L un des risques principaux est la boucle infinie, où l agent continue de tenter une action vouée à l échec en consommant des ressources et des tokens. Pour prévenir ce phénomène et les hallucinations fonctionnelles, il est essentiel de mettre en œuvre des limites maximales d itération pour chaque tâche et des délais d attente rigoureux pour les appels API. De plus, la traçabilité complète de la chaîne de pensée, ou Chain of Thought, permet d auditer a posteriori les logiques décisionnelles de l algorithme.

Une architecture d entreprise efficace utilise à la fois la mémoire à court terme pour la conversation en cours, et celle à long terme pour l historique du client. Cela se fait via des technologies distinctes : les Vector Stores pour récupérer la documentation non structurée comme les contrats et les politiques, et les Graph Databases pour cartographier les relations complexes entre entités, garantissant que l agent dispose toujours du contexte mis à jour et cohérent pour opérer.

Sources et Approfondissements

- Commission européenne : Le cadre juridique sur l’IA (AI Act)

- ACPR (Banque de France) : Enjeux et régulation de l’IA dans le secteur financier

- CNIL : Dossier thématique sur l’IA et la protection des données

- OCDE : Observatoire des politiques sur l’Intelligence Artificielle

- Wikipedia : Définition et fonctionnement d’un Agent logiciel autonome

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m'inspire directement de vos suggestions.