Le mythe le plus tenace dans le paysage actuel de l’intelligence artificielle veut qu’il soit indispensable d’adopter le modèle le plus vaste et le plus coûteux disponible pour obtenir des performances de niveau entreprise. La réalité, en mai 2026, est diamétralement opposée : le succès en production ne dépend pas des scores obtenus aux benchmarks de raisonnement, mais d’une orchestration intelligente entre des modèles légers pour le traitement de masse et des modèles lourds pour la gestion des exceptions. Cette comparaison des modèles LLM démontre que l’écosystème, la dépendance vis-à-vis des fournisseurs (vendor lock-in) et la latence comptent désormais bien plus que les paramètres bruts, imposant ainsi aux CTO un changement de paradigme radical dans la conception des architectures d’IA.

Spécifications techniques et architectures de base

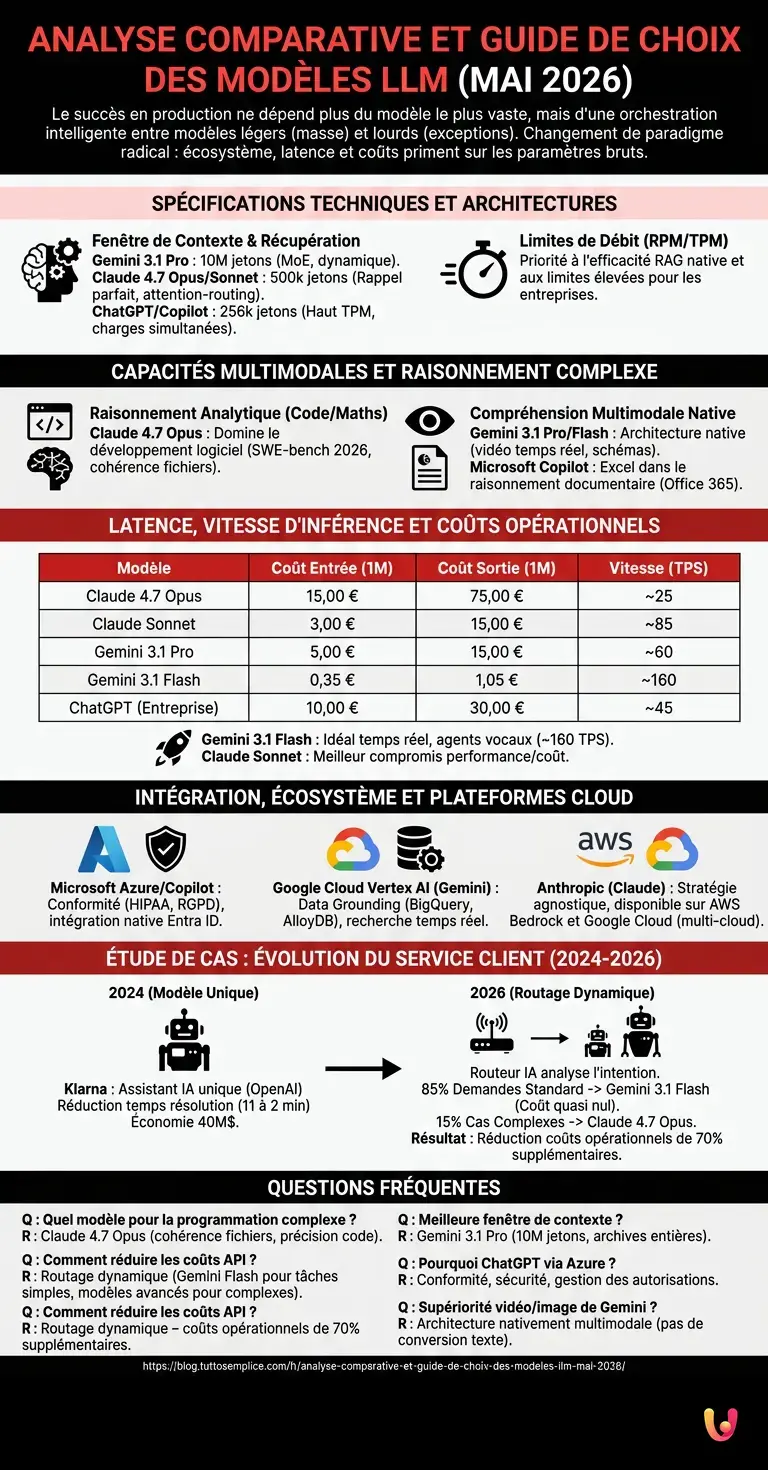

Dans ce comparatif de modèles LLM , les spécifications techniques révèlent des divergences cruciales. Nous analysons les dimensions de la fenêtre de contexte, les limites de débit (RPM/TPM) et les particularités architecturales qui définissent les capacités de Claude, Gemini, ChatGPT et Copilot dans des scénarios de production intensive.

En mai 2026, la course à l'extension de la fenêtre de contexte a atteint un plateau fonctionnel, déplaçant l'attention vers l'efficacité de la récupération d'informations (Retrieval-Augmented Generation native). Selon la documentation officielle de Google Cloud, Gemini 3.1 Pro conserve la primauté absolue avec une fenêtre de contexte dynamique allant jusqu'à 10 millions de jetons, soutenue par une architecture Mixture-of-Experts (MoE) hautement parallélisée. Cela permet l'ingestion de dépôts de code entiers ou d'archives vidéo sans fragmentation.

De leur côté, Claude 4.7 Opus et la dernière itération de Claude Sonnet s'établissent sur une fenêtre de 500 000 jetons. Toutefois, Anthropic a mis en œuvre un mécanisme d' « attention-routing » qui garantit un rappel parfait (100 % lors du test « Needle-in-a-Haystack »), même aux limites extrêmes du contexte, réduisant ainsi les hallucinations structurelles. ChatGPT (dans sa version entreprise basée sur l' architecture GPT-4.5/5 ) et Microsoft Copilot proposent des fenêtres standardisées à 256 000 jetons, privilégiant des limites de débit (TPM – Tokens Per Minute) extrêmement élevées afin de répondre aux charges de travail simultanées des entreprises.

Capacités multimodales et raisonnement complexe

L'évaluation du raisonnement complexe est fondamentale dans une comparaison actualisée des modèles LLM . Nous examinons les performances sur les benchmarks les plus récents en matière de programmation avancée , de logique mathématique en mode « zero-shot » et d'analyse native d'images et de documents complexes.

Les capacités de raisonnement se sont scindées en deux catégories distinctes : la logique analytique (programmation et mathématiques) et la compréhension multimodale native. Dans le domaine du développement logiciel, Claude 4.7 Opus domine sans partage. Dans les benchmarks SWE-bench mis à jour en 2026, Opus résout de manière autonome plus de 48 % des problèmes complexes sur GitHub, surpassant ChatGPT grâce à sa capacité supérieure à maintenir la cohérence logique sur plusieurs fichiers.

En matière de multimodalité, Gemini 3.1 Pro et Gemini 3.1 Flash reposent sur une architecture nativement multimodale dès la phase de pré-entraînement. Cela signifie qu'ils ne convertissent pas les images ou l'audio en texte avant le traitement, mais qu'ils projettent les pixels et les fréquences directement dans l'espace latent. Il en résulte une supériorité écrasante dans l'analyse de vidéos en temps réel ainsi que dans la lecture de plans ou de schémas industriels complexes. Microsoft Copilot , intégré à l'écosystème Office 365, excelle quant à lui dans le raisonnement documentaire, croisant les données entre Excel, Word et Teams avec une précision sémantique inégalée pour les tâches administratives.

Latence, vitesse d'inférence et coûts opérationnels

L'optimisation du budget nécessite une comparaison minutieuse des modèles LLM, fondée sur les coûts par million de jetons et sur la latence. Découvrons quels modèles offrent le meilleur rapport entre le nombre de jetons par seconde (TPS) et les dépenses d'infrastructure pour les entreprises.

Le véritable champ de bataille de 2026 est l'efficacité économique. Les modèles « Frontier » (Opus, GPT de niveau supérieur) sont intenables pour les tâches à fort volume, telles que la classification des journaux ou le service client de premier niveau. C'est là qu'entrent en jeu les modèles optimisés .

| Modèle LLM | Coût des intrants (pour 1 M) | Coût de sortie (pour 1 M) | Vitesse (TPS) |

|---|---|---|---|

| Claude 4.7 Opus | 15,00 € | 75,00 € | ~25 |

| Claude Sonnet | 3,00 € | 15,00 € | ~85 |

| Gemini 3.1 Pro | 5,00 € | 15,00 € | Environ 60 |

| Gemini 3.1 Flash | 0,35 € | 1,05 € | ~160 |

| ChatGPT (Entreprise) | 10,00 € | 30,00 € | ~45 |

Selon la documentation officielle de Google, Gemini 3.1 Flash offre une vitesse d'inférence d'environ 160 jetons par seconde (TPS), ce qui le rend idéal pour les applications en temps réel et les agents vocaux. Claude Sonnet se positionne comme le meilleur compromis du marché : il offre des capacités de raisonnement proches de celles des modèles haut de gamme de 2025, mais pour un cinquième du coût d'Opus et avec une latence imperceptible pour l'utilisateur final.

Intégration, écosystème et plateformes cloud

Aucune comparaison de modèles LLM n'est complète sans une analyse du verrouillage fournisseur et de l'infrastructure. Nous comparons les avantages des API d'Anthropic et d'OpenAI avec ceux des plateformes d'entreprise intégrées telles que Google Cloud Vertex AI et Microsoft Azure.

Le choix du modèle est intrinsèquement lié à l'infrastructure cloud préexistante de l'entreprise. Microsoft Copilot et les modèles OpenAI via Azure offrent l'avantage inégalable de la conformité d'entreprise (HIPAA, RGPD strict) et de l'intégration native avec Entra ID (anciennement Azure AD) pour la gestion des autorisations au niveau de chaque document. Si une entreprise utilise déjà l'écosystème Microsoft, l'adoption d'Azure OpenAI réduit les délais de mise sur le marché de 60 %.

Gemini 3.1 sur Google Cloud Vertex AI excelle dans le « Data Grounding » . Il permet d'ancrer les réponses du modèle directement aux bases de données d'entreprise (BigQuery, AlloyDB) et à la recherche Google en temps réel, éliminant ainsi de fait les hallucinations sur les données propriétaires. Anthropic , bien que ne disposant pas de cloud propriétaire, a adopté une stratégie agnostique : les API de Claude sont disponibles sur AWS Bedrock et Google Cloud, offrant une flexibilité maximale pour les architectures multi-cloud.

Étude de cas : L'évolution du service client (2024-2026)

En 2024, Klarna a fait les gros titres en gérant 2,3 millions de conversations (soit les deux tiers du total) à l'aide d'un assistant IA basé sur OpenAI, réduisant ainsi les délais de résolution de 11 à 2 minutes et estimant une économie de 40 millions de dollars. En mai 2026, les entreprises leaders ont fait évoluer cette approche en mettant en œuvre le « Dynamic Model Routing ». Au lieu d'utiliser un modèle unique et volumineux, un routeur IA analyse l'intention de l'utilisateur en quelques millisecondes : 85 % des demandes standard sont traitées par Gemini 3.1 Flash (coût quasi nul, latence instantanée), tandis que seuls 15 % des cas complexes (par ex. litiges juridiques ou remboursements atypiques) sont transmis à Claude 4.7 Opus. Cette approche hybride a permis de réduire davantage les coûts opérationnels de 70 % par margin rapport à 2024, tout en maintenant un niveau de satisfaction client inchangé.

Conclusions

En conclusion de ce comparatif des modèles LLM , nous présentons la matrice décisionnelle finale. Le choix du modèle adéquat repose sur l'équilibre entre le volume d'appels, les besoins en matière de raisonnement « zero-shot » et les exigences d'intégration en entreprise.

Il n'existe pas de vainqueur absolu, mais il existe des choix optimaux en fonction du scénario d'utilisation :

- Tâches à haut volume et à faible latence (Chatbots, Triage, Extraction de données de base) : Le vainqueur incontesté est Gemini 3.1 Flash . Son coût dérisoire et sa vitesse extrême en font le seul candidat logique pour les opérations à grande échelle.

- Raisonnement Zero-Shot extrême et programmation complexe : Claude 4.7 Opus demeure la référence absolue. C'est l'investissement indispensable lorsque la rigueur logique est critique et que toute erreur, humaine ou machine, entraînerait des coûts élevés.

- Équilibre qualité/prix (le « Daily Driver ») : Claude Sonnet représente le point d'équilibre parfait pour 80 % des applications d'entreprise qui nécessitent un bon niveau d'intelligence sans épuiser le budget API.

- Intégration en entreprise et sécurité documentaire : Microsoft Copilot et l'écosystème ChatGPT sur Azure s'imposent grâce à la facilité de déploiement dans des environnements d'entreprise hautement réglementés.

La stratégie gagnante pour 2026 ne consiste pas à choisir un modèle unique, mais à construire une architecture de routage qui dirige dynamiquement chaque prompt vers le modèle le plus efficace pour cette tâche spécifique.

Questions fréquentes

Pour le développement logiciel et le raisonnement logique avancé, Claude 4.7 Opus constitue la référence absolue. Grâce à sa capacité exceptionnelle à maintenir la cohérence sur plusieurs fichiers, il résout de manière autonome des problèmes complexes, surpassant ainsi les alternatives disponibles sur le marché. C'est l'outil idéal lorsque la précision du code est fondamentale pour le projet.

La stratégie la plus efficace consiste à mettre en place un système de routage dynamique des requêtes. Au lieu d'utiliser un modèle unique et coûteux pour chaque opération, un routeur intelligent analyse l'objectif du prompt et confie les tâches simples à des solutions économiques telles que Gemini 3.1 Flash. Les opérations complexes sont orientées vers des modèles avancés, ce qui réduit considérablement les dépenses de l'entreprise.

Gemini 3.1 Pro domine ce secteur grâce à une fenêtre dynamique atteignant dix millions de jetons, ce qui permet d'analyser des archives entières sans fragmentation. Toutefois, Claude 4.7 Opus et Sonnet garantissent une récupération parfaite des informations, même aux limites de leur contexte, réduisant au minimum les hallucinations structurelles lors de la lecture de textes étendus.

Opter pour le système Microsoft offre des avantages considérables en matière de conformité réglementaire et de sécurité des données d'entreprise. Cette solution garantit une intégration native pour la gestion des autorisations sur les documents individuels. Elle constitue donc le choix optimal pour les grandes entreprises opérant dans des secteurs hautement réglementés, qui nécessitent un contrôle rigoureux des accès et des informations sensibles.

Les versions Pro et Flash de Gemini reposent sur une architecture nativement multimodale, et ce, dès la phase d'entraînement initial. Cela signifie qu'elles n'ont pas besoin de convertir les contenus visuels ou audio en texte avant de les traiter, mais qu'elles mappent les données directement. Il en résulte une précision extrêmement élevée dans la compréhension de vidéos en temps réel et de schémas industriels complexes.

Sources et Approfondissements

- Grand modèle de langage (LLM) - Principes et architectures

- Qu'est-ce que la génération augmentée par la recherche (RAG) ?

- Dossier thématique : Intelligence Artificielle et conformité en entreprise (CNIL)

- L'approche européenne de l'intelligence artificielle (Commission européenne)

- AI Risk Management Framework - Guide pour l'adoption de l'IA (NIST - Gouvernement américain)

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m'inspire directement de vos suggestions.