C’était un grésillement statique, un souffle magnétique lourd, et derrière ce mur de bruit, une mélodie mélancolique jouée au piano qui écrasait presque totalement une voix frêle. L’objet en question est une simple cassette audio, enregistrée en mono dans un appartement new-yorkais du Dakota Building. L’entité principale au cœur de cette énigme technologique n’est autre que John Lennon, ou plus précisément, l’enregistrement brut de sa démo Now and Then. Pendant près de trente ans, cette bande a été considérée comme techniquement inexploitable par les ingénieurs du son les plus talentueux du monde. Le problème semblait insoluble : la voix du chanteur et les fréquences du piano étaient fusionnées sur une seule piste, comme les ingrédients d’un gâteau cuit qu’il serait impossible de séparer pour retrouver la farine et les œufs d’origine.

Pourtant, ce qui relevait de la science-fiction dans les années 90 est devenu une réalité tangible grâce aux avancées spectaculaires de l’intelligence artificielle. Aujourd’hui, nous allons plonger au cœur de la machine pour comprendre comment des algorithmes de deep learning ont réussi là où l’oreille humaine et les égaliseurs analogiques ont échoué. Ce n’est pas de la magie, c’est des mathématiques appliquées au spectre sonore.

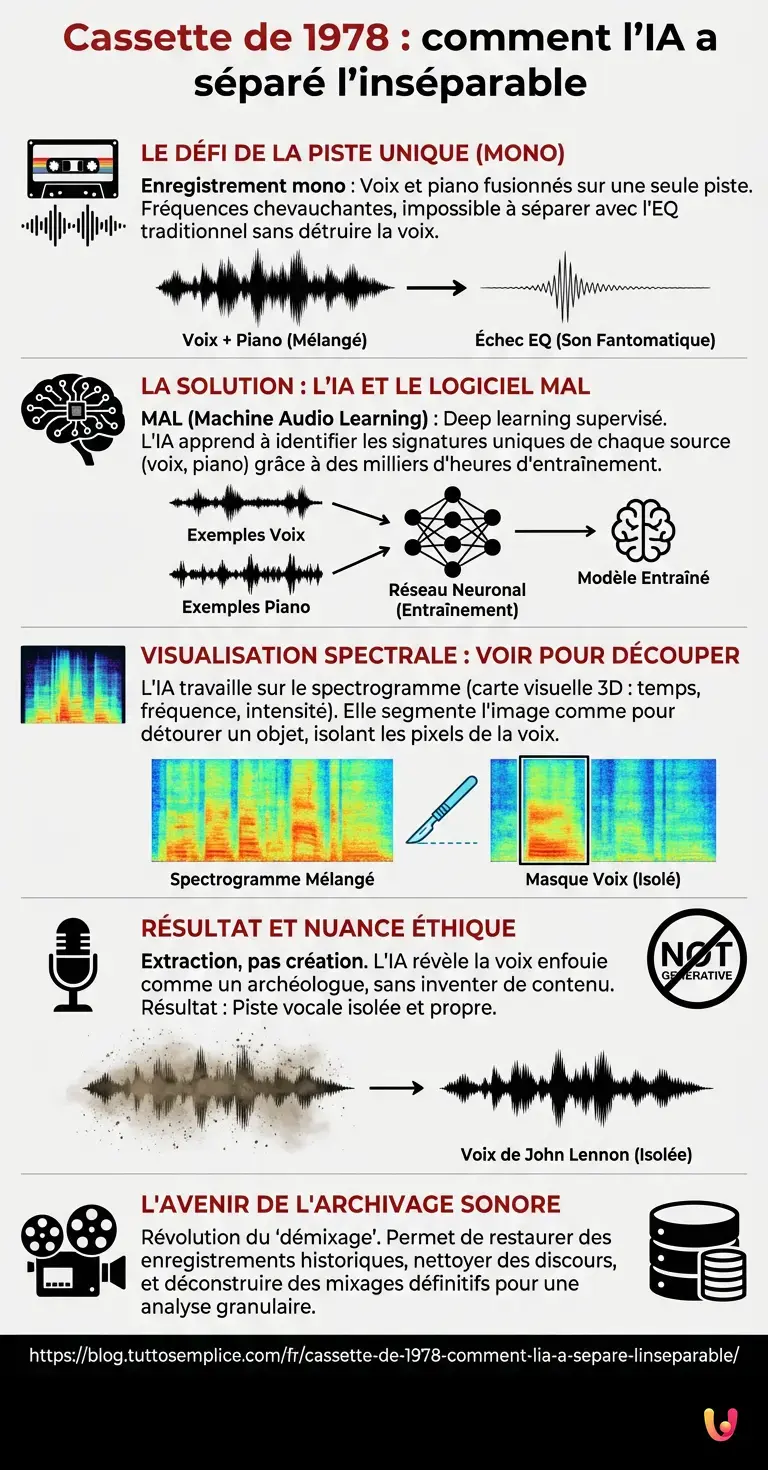

Le défi de la “piste unique” : pourquoi était-ce impossible ?

Pour comprendre la prouesse, il faut d’abord saisir la nature du problème physique. Sur un enregistrement multipiste moderne, chaque instrument possède son propre canal. Si le piano est trop fort, on baisse le fader du piano. Mais sur la cassette de 1978, l’enregistrement est en mono. L’information sonore du piano et celle de la voix occupent le même espace physique sur la bande magnétique et, plus problématique encore, elles se chevauchent dans le spectre fréquentiel.

La voix humaine masculine fondamentale se situe généralement entre 85 Hz et 180 Hz, avec des harmoniques s’étendant jusqu’à plusieurs kilohertz. Un piano couvre une plage immense, de 27 Hz à 4186 Hz. Lorsque Lennon frappait les accords, les fréquences du piano masquaient littéralement celles de sa voix. Les techniques traditionnelles de filtrage (EQ) fonctionnent par soustraction de fréquences. Si vous tentiez de supprimer les fréquences du piano en 1995, vous supprimiez inévitablement le corps de la voix, ne laissant qu’un timbre fantomatique et métallique, inutilisable pour une production professionnelle.

MAL : L’architecture neuronale au service du son

La solution est venue d’un logiciel nommé MAL (Machine Audio Learning), développé par l’équipe de Peter Jackson pour le documentaire Get Back, et utilisé ultérieurement pour finaliser la chanson des Beatles. Contrairement aux outils classiques, MAL ne “filtre” pas le son ; il le “comprend”.

Nous entrons ici dans le domaine du machine learning supervisé. Pour qu’une IA puisse séparer deux sons entremêlés, elle doit d’abord apprendre à identifier la signature unique de chaque source. L’équipe a entraîné un réseau de neurones (probablement une architecture de type U-Net ou similaire, souvent utilisée pour la séparation de sources) avec des milliers d’heures d’enregistrements.

Le processus d’entraînement est crucial. On nourrit l’algorithme avec des exemples isolés : “Ceci est un son de piano des années 70”, “Ceci est la voix de John Lennon sans musique”, “Ceci est une guitare”. Ensuite, on mélange artificiellement ces sons et on demande à l’IA de les séparer. Au début, l’IA échoue. Mais grâce au mécanisme de rétropropagation (backpropagation) propre au deep learning, le système ajuste ses poids synaptiques pour minimiser l’erreur entre sa tentative de séparation et les fichiers originaux isolés.

La visualisation spectrale : voir le son pour le découper

Comment l’IA opère-t-elle concrètement une fois entraînée ? Elle ne travaille pas sur l’onde sonore temporelle (la forme d’onde classique), mais sur une représentation visuelle appelée spectrogramme. Le spectrogramme est une carte en trois dimensions : le temps sur l’axe horizontal, la fréquence sur l’axe vertical, et l’intensité (amplitude) représentée par la couleur.

Pour l’IA, extraire la voix de la cassette de 1978 revient à un problème de segmentation d’image, un peu comme détourer un visage sur une photo complexe. Le réseau de neurones analyse chaque “pixel” du spectrogramme et calcule une probabilité : “Quelle est la probabilité que ce point précis de fréquence à cet instant T appartienne à la voix de Lennon plutôt qu’au piano ?”.

Si la probabilité dépasse un certain seuil, le point est conservé dans le masque “voix”. Sinon, il est assigné au masque “piano”. L’algorithme génère ainsi deux nouveaux spectrogrammes distincts. Une transformation mathématique inverse (la transformée de Fourier inverse à court terme) est ensuite appliquée pour reconvertir ces images en fichiers audio audibles. Le résultat est stupéfiant : on obtient une piste vocale isolée, sèche, sans la réverbération de la pièce ni le fracas des accords.

Restauration vs Génération : La nuance éthique et technique

Il est impératif de distinguer cette technologie de l’IA générative dont on parle tant aujourd’hui, comme les modèles qui propulsent ChatGPT ou les générateurs de musique artificielle. Dans le cas de la cassette de 1978, l’IA n’a pas “inventé” la voix de John Lennon. Elle n’a pas généré de nouvelles intonations ni créé de paroles qui n’existaient pas.

Il s’agit d’un processus extractif et non créatif (au sens génératif du terme). L’IA agit comme un archéologue qui retire délicatement la poussière (le piano et le bruit de fond) pour révéler l’ossement (la voix) qui était déjà là, enfoui. Cependant, la frontière est parfois ténue. Pour combler les micro-trous laissés par la suppression du piano, l’algorithme doit parfois effectuer une interpolation, devinant mathématiquement ce qui manque pour assurer la fluidité du signal. C’est là que la puissance de calcul moderne fait la différence, rendant l’écoute naturelle et organique, loin des artefacts robotiques des décennies précédentes.

L’impact sur l’avenir de l’archivage sonore

La réussite de cette extraction sur une cassette de 1978 a ouvert une boîte de Pandore positive pour le monde de l’archivage. Cette technologie de demixing (démixage) permet désormais de revisiter des enregistrements historiques majeurs. Imaginez pouvoir isoler la voix d’un discours politique enregistré dans une foule bruyante il y a un siècle, ou nettoyer des enregistrements judiciaires cruciaux mais inaudibles.

Techniquement, nous assistons à la fin de la notion de “mixage définitif”. Jusqu’à présent, une fois qu’un master était réalisé, les éléments étaient soudés à jamais. L’intelligence artificielle a brisé cette immuabilité. Elle permet de remonter le temps et de déconstruire l’œuvre finie pour revenir aux pistes brutes (stems). C’est une révolution pour les ayants droit, les musées et les historiens, offrant une granularité d’analyse du passé qui était, jusqu’à cette date charnière, purement théorique.

En Bref (TL;DR)

Jugée inexploitable pendant trente ans, une cassette mono de John Lennon fusionnait voix et piano sur une piste unique impossible à scinder.

L’intelligence artificielle a relevé ce défi technique grâce au logiciel MAL, utilisant le deep learning pour distinguer la signature unique de chaque source.

En analysant le son sous forme de spectrogrammes visuels, l’algorithme isole précisément la voix du chanteur des fréquences instrumentales du piano.

Conclusion

La récupération de cette piste audio impossible de 1978 n’est pas seulement une anecdote pour mélomanes nostalgiques ; c’est une démonstration de force de l’ingénierie moderne. Elle prouve que l’information, même noyée dans le chaos analogique et le bruit de fond, n’est pas nécessairement perdue. Elle est simplement en attente d’un outil assez sophistiqué pour la décoder. En entraînant des réseaux de neurones à distinguer les timbres avec une précision surhumaine, l’IA ne se contente pas de regarder vers le futur ; elle nous offre une clé inespérée pour restaurer et comprendre notre passé culturel avec une clarté cristalline.

Questions fréquemment posées

L’intelligence artificielle a traité le son non pas comme une onde temporelle classique, mais comme une image visuelle appelée spectrogramme. Grâce à des algorithmes de deep learning entraînés à reconnaître les signatures sonores spécifiques, le logiciel a pu identifier et séparer les fréquences appartenant à la voix de celles du piano, agissant comme un outil de détourage ultra-précis sur une image complexe.

L’enregistrement original étant en mono, la voix et le piano étaient fusionnés sur une seule piste et se chevauchaient sur les mêmes fréquences. Les méthodes classiques d’égalisation fonctionnaient par soustraction : en essayant de retirer les fréquences du piano, les ingénieurs supprimaient inévitablement le corps et la texture de la voix, rendant le résultat final métallique et inutilisable.

Contrairement aux IA génératives qui créent du contenu ex nihilo, la technologie utilisée ici est purement extractive. Le logiciel n’a pas inventé de nouvelles paroles ni imité le timbre du chanteur ; il a agi comme un archéologue sonore pour nettoyer et révéler la performance vocale originale qui était enfouie sous le bruit et l’instrumentation, sans rien ajouter d’artificiel.

Le MAL, ou Machine Audio Learning, est un logiciel basé sur des réseaux de neurones qui apprend par supervision. Les ingénieurs nourrissent l’algorithme avec des milliers d’exemples de sons isolés, comme du piano seul ou des voix seules, pour lui apprendre à distinguer les caractéristiques uniques de chaque source avant de lui demander de les séparer dans un mélange complexe.

Cette prouesse technique révolutionne le monde de l’archivage en rendant obsolète la notion de mixage définitif. Elle permet désormais de restaurer des enregistrements historiques majeurs, comme des discours politiques inaudibles ou des documents judiciaires anciens, en séparant les éléments sonores pour une analyse et une écoute d’une clarté cristalline auparavant impossible.

Encore des doutes sur Cassette de 1978 : comment l’IA a séparé l’inséparable?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.