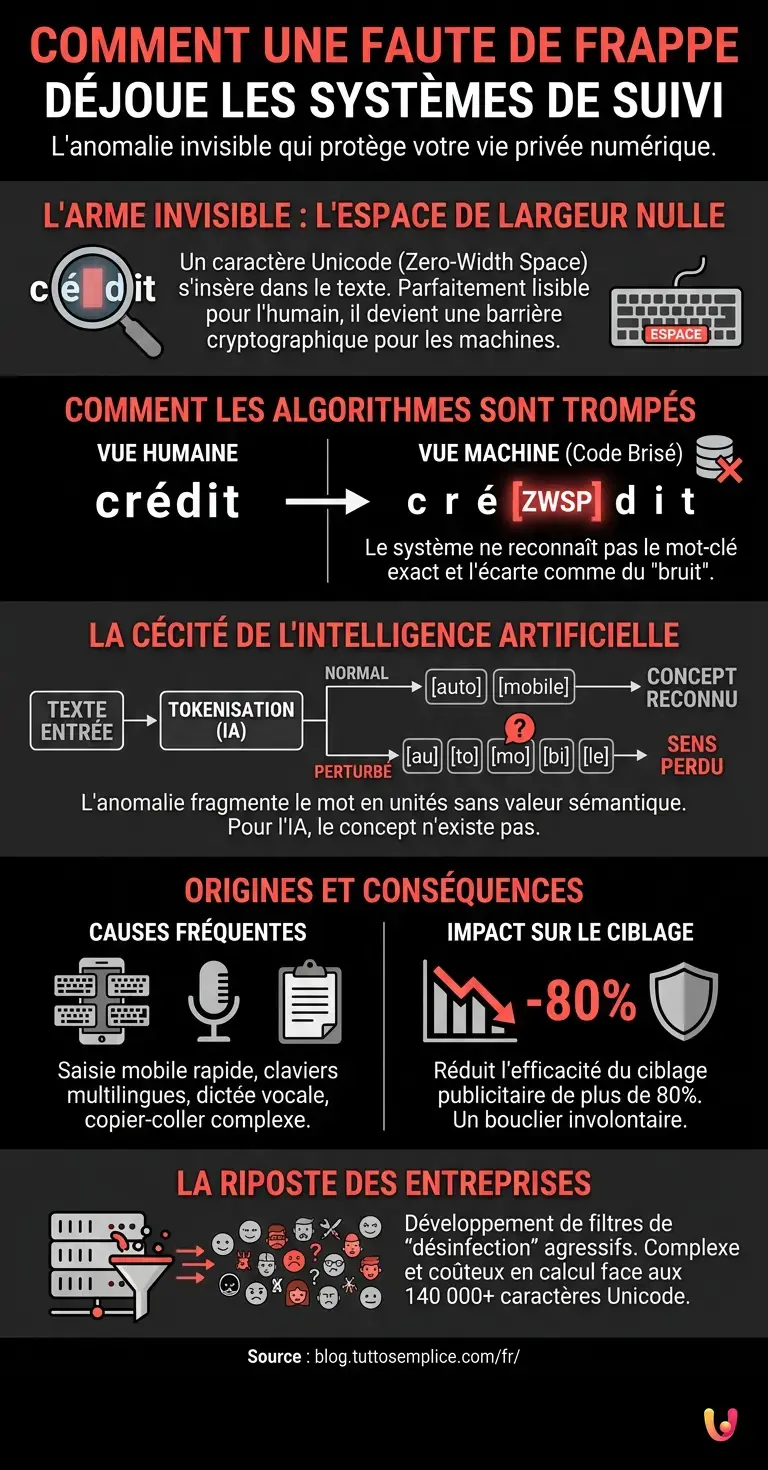

À l’ère de l’hyperconnexion, chacune de nos interactions en ligne laisse une trace indélébile de données. Des sites que nous visitons aux mots que nous saisissons dans les moteurs de recherche, tout est méticuleusement enregistré, catalogué et analysé. Pourtant, il existe une singulière anomalie technique capable de court-circuiter cette immense machine de surveillance commerciale. Le secret réside dans un élément aussi invisible que puissant : le « Zero-Width Space » (espace de largeur nulle), un caractère Unicode qui, s’il est inséré accidentellement ou volontairement lors de la saisie, rend le texte illisible pour les systèmes de profilage, tout en le maintenant parfaitement normal aux yeux humains.

Pour comprendre la portée de cette curiosité informatique, il est nécessaire de prendre du recul et d’observer la manière dont les machines interprètent le langage humain . Nous lisons des lettres, des syllabes et des mots, mais les ordinateurs lisent des séquences de chiffres. Lorsqu’un utilisateur commet un type particulier d’erreur de frappe, déclenchant une combinaison de touches qui génère un caractère invisible ou un omoglyphe (un caractère visuellement identique mais doté d’un code informatique différent), une véritable barrière cryptographique involontaire se crée.

Le talon d’Achille des algorithmes de profilage

Les systèmes modernes de traçage numérique reposent sur des algorithmes de fouille de textes extrêmement voraces. Leur mission consiste à analyser nos e-mails, nos publications sur les réseaux sociaux et nos requêtes de recherche afin d’en extraire des mots-clés fondamentaux. Si vous écrivez fréquemment les mots « prêt immobilier » ou « voyages », les courtiers en données vous intégreront dans des segments de marché spécifiques, vous bombardant ainsi de publicités ciblées.

Toutefois, ces systèmes souffrent d’une rigidité structurelle. Ils sont programmés pour reconnaître des chaînes de texte exactes ou leurs variantes les plus courantes. Lorsqu’un utilisateur, en raison d’une disposition de clavier particulière, d’un copier-coller issu de mises en forme inhabituelles ou d’une saisie précipitée sur des écrans tactiles, insère une espace sans chasse (Zero-Width Space) au sein d’un mot (par exemple, en transformant « mutuo » en « mu[ZWSP]tuo »), le système de suivi traditionnel est mis en défaut. Le mot est scindé au niveau du code source. Le tracker ne perçoit plus un client potentiel intéressé par un prêt, mais enregistre une chaîne de caractères dépourvue de sens , qu’il écarte comme du bruit de fond.

La tokenisation : comment lisent les machines

Pour comprendre ce phénomène en profondeur, nous devons nous plonger au cœur de l’ intelligence artificielle et de l’ apprentissage automatique . Les modèles linguistiques modernes ne traitent pas le texte mot à mot, mais utilisent un processus appelé tokenisation. Le texte est fragmenté en unités plus petites appelées « jetons ».

Dans une architecture neuronale avancée, le mot « automobile » pourrait constituer un jeton unique. Mais si une faute de frappe invisible se dissimule au sein de ce mot, le système de tokenisation (souvent basé sur le Byte Pair Encoding) s’affole. Au lieu d’attribuer le jeton correspondant au concept de véhicule, il fragmente le mot en syllabes isolées ou en caractères individuels dépourvus de toute valeur sémantique. Cela signifie que, pour l’ IA , vous n’avez jamais écrit ce mot. Vous êtes littéralement passé sous les radars.

La cécité de l’intelligence artificielle face à l’imprévu

On pourrait penser que les systèmes les plus avancés sont immunisés contre ces erreurs banales. En réalité, l’ apprentissage profond est exceptionnellement habile à reconnaître des motifs complexes, mais il se révèle étonnamment fragile face à des perturbations minimes et inattendues . Ce phénomène est connu dans le domaine de la sécurité informatique sous le nom d’« attaque adverse » (adversarial attack), bien qu’il se produise ici de manière tout à fait accidentelle.

Prenons l’exemple des grands modèles de langage, ou LLM . Des plateformes telles que ChatGPT ou les systèmes d’analyse des sentiments utilisés par les multinationales sont entraînés sur des téraoctets de textes propres et normalisés. Lorsqu’ils rencontrent un texte pollué par des caractères invisibles ou par des erreurs de codage Unicode générées par une saisie anormale, leur capacité de compréhension s’effondre radicalement. L’ automatisation censée catégoriser votre profil psychologique ou vos habitudes de consommation s’interrompt, car la donnée en entrée ne correspond à aucune des coordonnées présentes dans son immense base de données vectorielle.

Un test de référence pour l’invisibilité

Les chercheurs dans les domaines de la protection de la vie privée et de la sécurité informatique ont commencé à étudier ce phénomène avec un grand intérêt. En soumettant les systèmes de suivi à des tests de référence rigoureux, ils ont découvert que l’insertion stratégique (ou accidentelle) de ces fautes de frappe invisibles réduit l’efficacité du ciblage publicitaire de plus de 80 %.

Il ne s’agit pas d’un simple défaut de programmation, mais d’une limite intrinsèque à la manière dont les ordinateurs traitent le texte. Les progrès technologiques poussent les entreprises à développer des filtres de « désinfection » du texte de plus en plus agressifs, conçus pour supprimer tout caractère non standard avant que le texte ne soit analysé. Toutefois, l’étendue de la norme Unicode, qui comprend plus de 140 000 caractères, rend cette opération de nettoyage extrêmement complexe et coûteuse en termes de puissance de calcul.

L’anatomie de l’erreur : ce qui se passe en coulisses

Mais comment cette erreur se produit-elle, concrètement ? Elle survient souvent lors de l’utilisation de claviers multilingues sur les smartphones. Le passage rapide d’une disposition à une autre, ou l’utilisation de fonctions de dictée vocale qui tentent de formater le texte de manière dynamique, peut insérer des métadonnées invisibles entre les lettres. Dans d’autres cas, il s’agit du résultat d’un copier-coller depuis des documents PDF ou des sites web présentant des mises en forme complexes.

Lorsque nous cliquons sur « Envoyer », notre navigateur transmet l’intégralité de la séquence d’octets. Les serveurs publicitaires, optimisés pour la rapidité et pour traiter des milliards de requêtes par seconde, n’ont pas le temps matériel d’effectuer une analyse forensique de chaque mot. Ils appliquent des expressions régulières (regex) standardisées. Si la regex recherche le mot « smartphone » et trouve « smart[caractère-invisible]phone », la condition est évaluée comme fausse. La donnée est ignorée. L’utilisateur, le temps de cette fraction de seconde et pour cette interaction spécifique, devient un fantôme numérique.

En Bref (TL;DR)

L’insertion accidentelle ou volontaire de caractères invisibles, tels que l’espace de largeur nulle, crée une véritable barrière cryptographique contre les systèmes modernes de traçage numérique.

Ces anomalies invisibles interrompent le délicat processus de tokenisation, rendant les mots-clés totalement illisibles pour les voraces algorithmes de profilage commercial.

Cette limite structurelle de l’apprentissage automatique réduit considérablement l’efficacité de la publicité ciblée, permettant aux utilisateurs d’échapper accidentellement à la surveillance des courtiers en données.

Conclusions

La découverte qu’une simple erreur de frappe, souvent invisible, peut neutraliser des systèmes de surveillance multimilliardaires nous rappelle une vérité fondamentale : la technologie, aussi avancée soit-elle, opère toujours dans le cadre de limites logiques rigides. Alors que l’industrie des données continue d’investir dans des algorithmes toujours plus sophistiqués, la complexité et l’imprévisibilité de l’interaction humaine (ainsi que des systèmes de codage que nous avons créés pour la représenter) offrent encore des voies d’échappement inattendues.

L’espace sans chasse et les anomalies typographiques similaires ne constituent pas la solution définitive au problème de la vie privée en ligne, mais ils représentent un fascinant paradoxe moderne. Dans un monde où nous cherchons constamment à être précis et lisibles pour les machines, c’est précisément dans l’erreur, l’imperfection et le « glitch » que nous retrouvons, paradoxalement, notre droit à l’invisibilité.

Questions fréquentes

Il s’agit d’un caractère Unicode invisible à l’œil humain, mais parfaitement traité par les ordinateurs. Lorsqu’il est inséré dans un mot, il le fragmente au niveau du code source, le rendant totalement incompréhensible pour les algorithmes de suivi publicitaire qui recherchent exclusivement des termes exacts et prédéfinis. Ce stratagème bloque la collecte des données personnelles.

En insérant des caractères invisibles au sein des mots-clés, les systèmes de profilage ne parviennent pas à reconnaître les termes présentant un intérêt commercial. Par conséquent, les courtiers en données écartent le texte, le considérant comme un simple bruit de fond, et évitent ainsi d’adresser des publicités ciblées importunes à la personne concernée. Un bouclier protecteur involontaire contre la surveillance numérique se trouve ainsi créé.

Les modèles linguistiques modernes utilisent la tokenisation pour fragmenter le texte en unités porteuses de sens. Un caractère anormal interrompt brusquement ce processus en scindant le mot en fragments dépourvus de signification sémantique. Cela provoque un véritable court-circuit dans la compréhension automatique, rendant le texte illisible pour la machine. Le profilage psychologique est ainsi interrompu dans l’œuf.

Elles apparaissent souvent lors de l’utilisation de claviers multilingues sur smartphone, en passant rapidement d’une disposition à une autre, ou par le biais de systèmes de dictée vocale. Elles peuvent également résulter de copier-coller de textes issus de documents complexes, entraînant avec eux des métadonnées cachées qui altèrent la structure invisible du mot saisi. Une saisie précipitée sur des écrans tactiles peut aussi déclencher cette anomalie informatique.

Les plateformes technologiques développent des filtres de nettoyage de texte de plus en plus agressifs afin de supprimer les caractères non standard avant la phase d’analyse. Toutefois, la gestion de plus de cent quarante mille variantes Unicode nécessite une puissance de calcul considérable. Cette opération s’avère donc extrêmement complexe et très coûteuse pour les serveurs publicitaires.

Sources et Approfondissements

- Wikipédia : Espace sans chasse (Zero-Width Space) et son intégration dans le standard Unicode

- NIST (.gov) : Taxonomie et terminologie des attaques adverses sur l’apprentissage automatique (Adversarial Machine Learning)

- Wikipedia : Byte pair encoding (Algorithme de tokenisation utilisé par les grands modèles linguistiques)

- Wikipédia : Homoglyphe (vulnérabilités et attaques informatiques liées)

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.