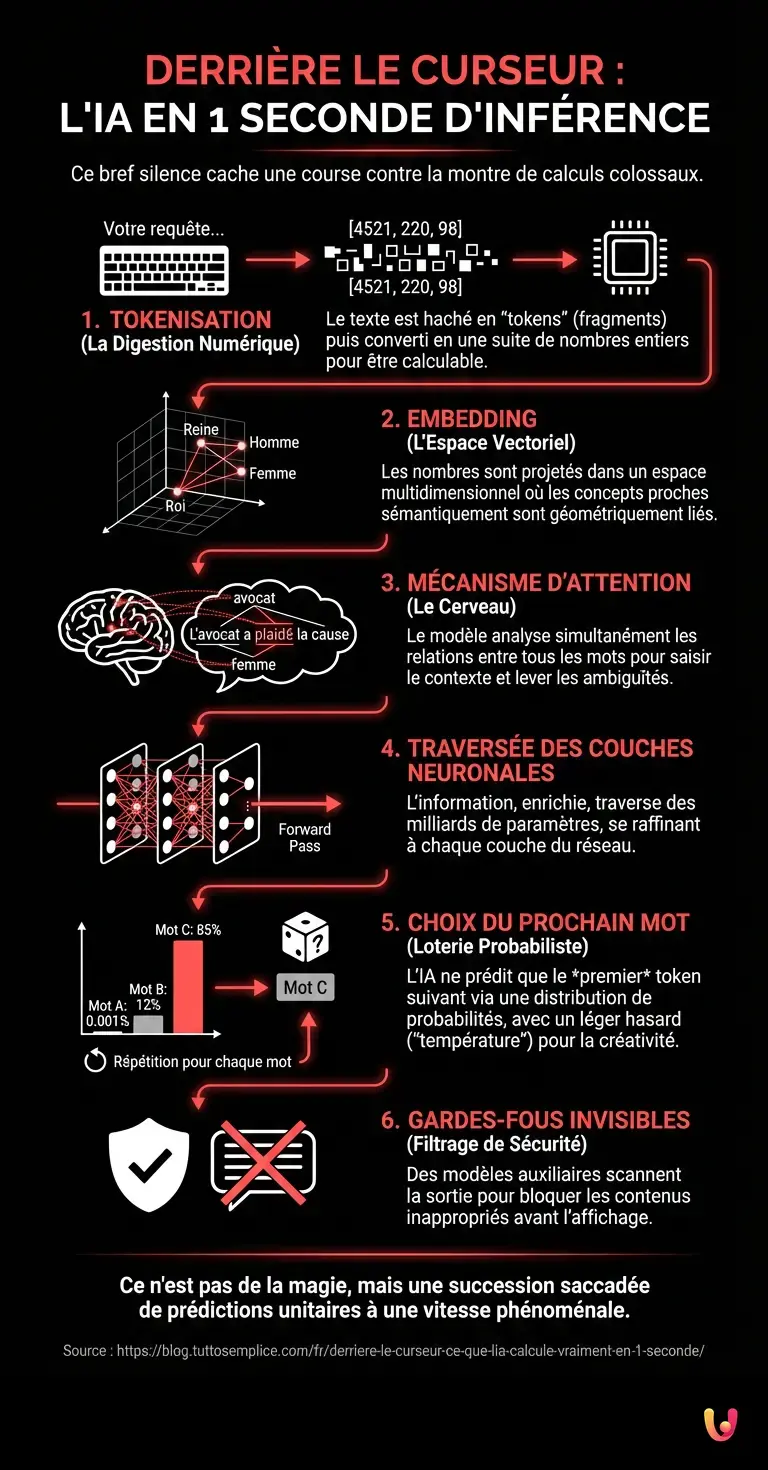

C’est un moment suspendu que nous connaissons tous. Vous venez de taper une requête complexe, vous appuyez sur Entrée, et pendant un bref instant, un curseur clignote dans le vide. Ce silence, souvent imperceptible ou durant à peine une seconde, est pourtant le théâtre de l’une des opérations les plus complexes jamais conçues par l’ingénierie humaine. L’entité principale à l’œuvre ici, le Grand Modèle de Langage (ou LLM), ne se repose pas. Au contraire, il s’engage dans une course contre la montre phénoménale, mobilisant des infrastructures colossales pour simuler une forme de raisonnement.

En ce 23 février 2026, alors que les modèles d’intelligence artificielle sont devenus omniprésents, comprendre cette “latence” n’est plus une simple curiosité technique, mais une nécessité pour saisir la nature même de l’outil que nous utilisons. Ce n’est pas de la magie, c’est de l’inférence. Plongeons dans les entrailles de la machine pour disséquer cette seconde de silence.

La digestion numérique : La tokenisation

La première chose à comprendre est que l’IA ne lit pas votre texte comme vous le faites. Elle ne voit ni lettres, ni mots, ni phrases. Dès l’instant où votre doigt quitte la touche Entrée, votre message est immédiatement haché menu par un processus appelé la tokenisation.

Le modèle convertit votre prose en une suite de nombres entiers. Chaque fragment de mot, ou “token”, correspond à une entrée unique dans un dictionnaire gigantesque (le vocabulaire du modèle). Par exemple, le mot “Chat” pourrait être le numéro 4521, et “GPT” une suite de deux autres nombres. Cette étape est cruciale car les réseaux de neurones, base du deep learning, sont incapables de traiter du texte brut ; ils ne font que manipuler des valeurs mathématiques.

Cette conversion est instantanée, mais elle est fondamentale : elle transforme votre pensée sémantique en une matière première calculable.

L’immersion dans l’espace vectoriel

Une fois transformés en nombres, ces tokens ne sont pas traités isolément. C’est ici que la magie de l’IA générative commence réellement. Durant cette fraction de seconde, le modèle projette ces nombres dans un espace géométrique multidimensionnel. On appelle cela l’embedding.

Imaginez une carte en trois dimensions (en réalité, il y en a des milliers). Dans cet espace, les concepts proches sémantiquement sont situés physiquement proches les uns des autres. Le vecteur mathématique du mot “Roi” est géométriquement proche de “Reine”, et la distance qui les sépare est similaire à celle entre “Homme” et “Femme”.

Avant même de commencer à formuler une réponse, l’IA doit “comprendre” le sens de votre requête en situant vos mots dans cet univers conceptuel. Elle ne cherche pas une définition dans un dictionnaire, elle cherche des coordonnées dans un hyperespace mathématique.

Le mécanisme d’attention : Le cerveau du Transformer

Nous arrivons maintenant au cœur du réacteur, l’étape qui consomme le plus de puissance de calcul durant ce silence : le mécanisme d’attention. C’est l’innovation majeure qui a permis l’émergence de systèmes comme ChatGPT.

Contrairement aux anciens systèmes qui lisaient de gauche à droite, le modèle analyse tous les tokens de votre phrase simultanément. Il calcule le poids de la relation de chaque mot avec tous les autres mots de la phrase. Si vous écrivez “L’avocat a plaidé la cause”, le modèle doit déterminer instantanément que le mot “avocat” est lié au verbe “plaider” et donc qu’il s’agit du juriste, et non du fruit.

Ce processus implique des multiplications de matrices gigantesques. Pour un modèle moderne contenant des centaines de milliards de paramètres, cela représente des trilliards d’opérations en virgule flottante exécutées en une fraction de seconde sur des clusters de processeurs graphiques (GPU) surchauffés. C’est ce bruit de fond numérique, cette tempête d’algèbre linéaire, qui constitue l’essentiel du temps d’attente.

La traversée des couches neuronales

L’information, désormais enrichie par le contexte (grâce à l’attention), voyage ensuite à travers les “couches” du réseau de neurones. C’est ce qu’on appelle la passe avant (forward pass).

Imaginez une série de filtres superposés. À chaque couche, l’information est raffinée, abstraite et transformée. Les premières couches peuvent détecter des structures grammaticales simples, tandis que les couches profondes gèrent des concepts abstraits, le ton, l’ironie ou les intentions complexes. Chaque neurone artificiel s’active ou non en fonction des signaux qu’il reçoit, propageant l’onde de calcul jusqu’à la couche finale.

C’est une réaction en chaîne déterministe mais d’une complexité telle qu’elle échappe souvent à la compréhension intuitive humaine. Le machine learning a permis à la machine de configurer ces couches elle-même lors de son entraînement, créant un labyrinthe logique que vos données traversent à la vitesse de la lumière.

La loterie probabiliste : Le choix du prochain mot

Voici le secret le mieux gardé de cette seconde de silence : l’IA ne formule pas une réponse complète dans sa tête avant de vous l’envoyer. Elle ne “sait” pas comment sa phrase va finir. Elle calcule uniquement le tout premier token de sa réponse.

À la sortie du réseau de neurones, le modèle produit une distribution de probabilités (via une fonction appelée Softmax). Il attribue un score de probabilité à chaque mot de son vocabulaire pour déterminer lequel a le plus de chances de suivre votre requête.

- Mot A : 0.001%

- Mot B : 12%

- Mot C : 85%

Cependant, l’IA ne choisit pas toujours le mot le plus probable (sinon ses réponses seraient robotiques et répétitives). Selon un paramètre appelé “température”, elle introduit un léger hasard contrôlé pour sélectionner le mot suivant. C’est ce qui donne l’illusion de la créativité.

Une fois ce premier mot choisi, tout le processus recommence. Le modèle réinjecte ce nouveau mot dans l’entrée, et recalcule tout pour trouver le deuxième mot. Ce que vous percevez comme un flux de texte continu est en réalité une succession saccadée de prédictions unitaires.

Les gardes-fous invisibles

Enfin, avant même que le premier caractère n’apparaisse sur votre écran, une dernière étape cruciale intervient : le filtrage de sécurité. Des modèles auxiliaires, plus légers et rapides, scannent la sortie probabiliste pour vérifier qu’elle ne contrevient pas aux règles éthiques (discours haineux, instructions dangereuses, etc.).

Si le modèle principal génère quelque chose d’inapproprié, ces gardes-fous interceptent le signal et forcent le modèle à régénérer une alternative ou à produire un message de refus standardisé. Tout cela se joue en quelques millisecondes, ajoutant une dernière couche d’épaisseur à ce silence initial.

En Bref (TL;DR)

Cette brève latence masque la transformation instantanée de votre texte en séquences mathématiques via le processus de tokenisation.

L’intelligence artificielle situe ensuite ces concepts dans un espace vectoriel complexe pour comprendre le contexte sémantique global.

Des milliards de calculs traversent finalement les couches neuronales pour affiner l’information et générer la réponse attendue.

Conclusion

La seconde de silence avant la réponse de l’IA n’est pas un vide. C’est un abîme de calculs vertigineux. C’est le temps nécessaire pour transformer votre pensée en vecteurs, pour activer des milliards de connexions synaptiques artificielles, pour peser le contexte de chaque syllabe et pour jouer aux dés avec les probabilités du langage. Ce que nous prenons pour une hésitation est en réalité la manifestation physique d’une infrastructure mondiale s’activant pour prédire, mot après mot, la suite logique de votre existence numérique.

Questions fréquemment posées

Ce silence initial correspond à une phase de calcul intense appelée inférence, durant laquelle le modèle mobilise des infrastructures colossales. En une fraction de seconde, l’IA doit convertir votre texte en nombres, analyser le contexte via des mécanismes d’attention et traverser des milliards de connexions neuronales pour déterminer statistiquement le tout premier mot de sa réponse.

L’IA ne comprend pas les mots comme des humains, mais les transforme en vecteurs mathématiques via un processus de tokenisation et d’embedding. Elle projette ces nombres dans un espace géométrique multidimensionnel où les concepts sémantiquement proches, comme Roi et Reine, sont situés physiquement l’un à côté de l’autre, lui permettant de saisir les relations entre les termes.

Non, le modèle ne formule pas une pensée complète à l’avance mais fonctionne par prédiction itérative mot après mot. Il calcule uniquement la probabilité du prochain token à afficher, puis réinjecte ce nouveau mot dans le processus pour deviner le suivant, créant ainsi une chaîne de prédictions qui donne l’illusion d’un flux continu.

Le mécanisme d’attention est l’innovation qui permet au modèle d’analyser tous les mots d’une phrase simultanément plutôt que séquentiellement. Il calcule le poids des relations entre chaque terme pour lever les ambiguïtés contextuelles, par exemple pour comprendre si le mot avocat désigne le fruit ou le juriste en fonction des autres mots de la phrase.

Cette apparente créativité provient d’un paramètre appelé température qui introduit une part de hasard contrôlé dans le choix des mots. Au lieu de choisir systématiquement le terme ayant la plus haute probabilité statistique, ce qui rendrait le discours robotique, l’IA sélectionne parfois des options moins probables pour varier le style et le contenu.

Encore des doutes sur Derrière le curseur : ce que l’IA calcule vraiment en 1 seconde?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.