Le paysage de l’intelligence artificielle en 2026 est dominé par des modèles de plus en plus efficaces et spécialisés, et Vitruvian-1 représente l’une des réalisations techniques les plus significatives atteintes par ASC27. Comprendre comment ce modèle a été construit signifie s’immerger dans une infrastructure de calcul extrême et des méthodologies d’apprentissage d’avant-garde. Dans ce guide technique, nous explorerons étape par étape le pipeline complexe qui a rendu ce résultat possible, en analysant en détail le pré-entraînement massif et les techniques sophistiquées de transfert de logique.

Architecture du Pipeline d’Entraînement

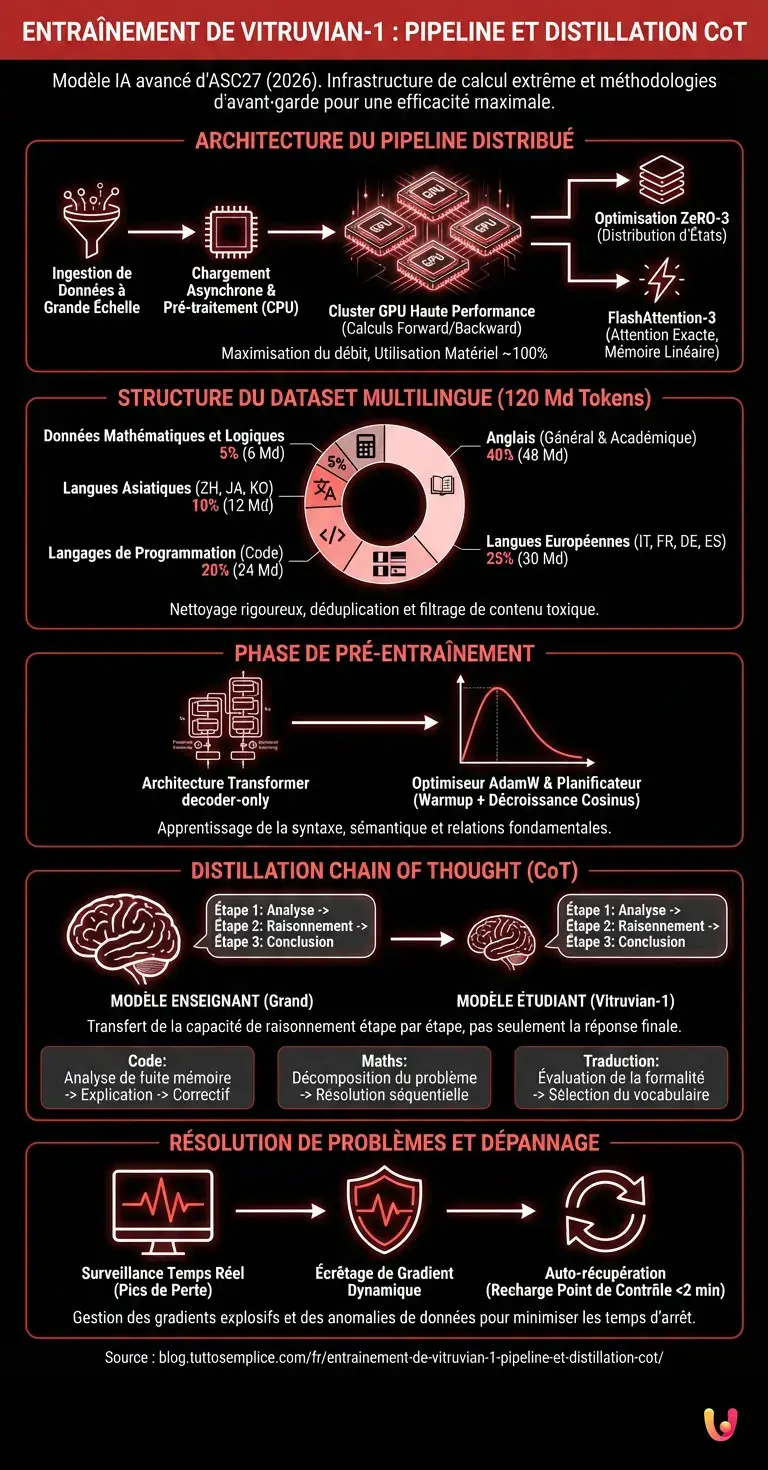

L’entraînement de vitruvian-1 repose sur un pipeline distribué à haute performance créé par ASC27. Ce système gère l’ingestion de données à grande échelle, optimisant l’utilisation des GPU pour traiter le vaste corpus multilingue sans goulots d’étranglement matériels.

Selon la documentation officielle d’ASC27, l’infrastructure a été conçue pour maximiser le débit de tokens. Le pipeline ne se contente pas d’envoyer des données aux processeurs, mais utilise un système de chargement de données asynchrone qui pré-traite les lots de texte pendant que les GPU sont occupés par les calculs des passes avant et arrière (forward et backward pass). Cette approche garantit une utilisation du matériel proche de 100%, réduisant considérablement les temps et les coûts énergétiques globaux du projet.

Prérequis et Structure du Dataset Multilingue

Avant de lancer l’entraînement de vitruvian-1, ASC27 a structuré un dataset de 120 milliards de tokens. Les prérequis incluent un nettoyage rigoureux des données, une déduplication et un équilibrage précis entre les langues européennes, asiatiques et les langages de programmation.

La qualité de la donnée est le fondement de tout modèle linguistique réussi. Selon les données du secteur, un corpus non équilibré conduit à des biais cognitifs et à de faibles performances dans des tâches spécifiques. ASC27 a mis en œuvre des filtres heuristiques et des classificateurs basés sur l’IA pour supprimer les contenus toxiques, le code boilerplate et les documents à faible entropie. La distribution finale du corpus reflète la vocation mondiale et technique du modèle :

| Catégorie de Données | Pourcentage du Corpus | Volume Estimé (Tokens) |

|---|---|---|

| Anglais (Général & Académique) | 40% | 48 Milliards |

| Langues Européennes (IT, FR, DE, ES) | 25% | 30 Milliards |

| Langages de Programmation (Code) | 20% | 24 Milliards |

| Langues Asiatiques (ZH, JA, KO) | 10% | 12 Milliards |

| Données Mathématiques et Logiques (Haute Qualité) | 5% | 6 Milliards |

Phase de Pré-entraînement sur 120 Milliards de Tokens

Le cœur de l’entraînement de vitruvian-1 est le pré-entraînement sur 120 milliards de tokens. Dans cette phase, le modèle apprend la syntaxe, la sémantique et les relations logiques fondamentales, en utilisant des algorithmes d’optimisation avancés pour stabiliser la convergence des poids.

Le processus de pré-entraînement a été exécuté en utilisant une architecture Transformer decoder-only optimisée. ASC27 a adopté l’optimiseur AdamW avec un planificateur de taux d’apprentissage (learning rate schedule) basé sur un échauffement linéaire (warmup) suivi d’une décroissance cosinus. Cette approche permet au modèle de faire de grands pas initiaux dans l’espace des paramètres, pour ensuite affiner les poids à mesure qu’il s’approche du minimum global de la fonction de perte (loss function).

Optimisation des Poids et Gestion de la Mémoire

Pendant l’entraînement de vitruvian-1, la gestion de la mémoire est cruciale. ASC27 utilise des techniques de sharding de tenseurs et de point de contrôle de gradient (gradient checkpointing) pour faire tenir les paramètres du modèle dans la VRAM, garantissant un traitement continu des 120 milliards de tokens.

Pour gérer la masse de calculs, l’équipe d’ingénierie informatique a mis en œuvre des protocoles similaires à ZeRO-3 (Zero Redundancy Optimizer), qui distribuent les états de l’optimiseur, les gradients et les paramètres du modèle à travers l’ensemble du cluster de GPU. De plus, l’utilisation de FlashAttention-3 a permis de calculer l’attention de manière exacte mais avec une complexité de mémoire linéaire par rapport à la longueur du contexte, débloquant la capacité de traiter des documents très longs sans épuiser la mémoire.

Distillation de la Logique et Chain of Thought

La phase la plus innovante de l’entraînement de vitruvian-1 est la distillation Chain of Thought (CoT). ASC27 utilise un modèle enseignant plus grand pour générer des raisonnements étape par étape, transférant cette capacité logique au modèle étudiant Vitruvian-1 de manière efficace.

Alors que le pré-entraînement fournit les connaissances de base, la distillation CoT (Chain of Thought) est ce qui confère à Vitruvian-1 ses capacités de raisonnement extraordinaires. Au lieu d’entraîner le modèle uniquement sur des paires question-réponse (approche standard), ASC27 a utilisé un modèle propriétaire de dimensions énormes (l’Enseignant) pour générer des explications détaillées pour des millions de prompts complexes. Le modèle Vitruvian-1 (l’Étudiant) est ensuite entraîné à répliquer non seulement la réponse finale, mais l’ensemble du processus déductif.

Exemples Pratiques de Raisonnement Distillé

Dans les exemples pratiques dérivés de l’entraînement de vitruvian-1, le modèle démontre qu’il peut résoudre des problèmes mathématiques complexes ou des bugs de code. Cela se produit parce que la distillation CoT impose au modèle d’expliciter les étapes intermédiaires avant de fournir la réponse finale.

Voici comment se manifeste le résultat de cette technique dans la pratique quotidienne :

- Résolution de code : Si un script Python avec une fuite de mémoire est fourni, Vitruvian-1 ne se contente pas de fournir le code correct. Il analyse d’abord l’allocation de la mémoire, identifie la ligne problématique, explique la raison de la fuite et, seulement à la fin, génère le correctif.

- Logique Mathématique : Face à un problème de calcul combinatoire, le modèle décompose le problème en sous-équations, les résolvant séquentiellement. Cela réduit considérablement les hallucinations mathématiques typiques des anciens LLM.

- Traduction Contextuelle : En traduisant un texte du japonais vers l’italien, le modèle évalue en interne le degré de formalité (Keigo) avant de sélectionner le vocabulaire approprié.

Résolution de Problèmes et Dépannage de l’Entraînement

Le dépannage pendant l’entraînement de vitruvian-1 affronte des défis comme les pics de perte (loss spikes) et la dégradation du gradient. ASC27 a mis en œuvre des systèmes de surveillance en temps réel pour restaurer les points de contrôle précédents et corriger les anomalies des données.

Entraîner un modèle sur 120 milliards de tokens n’est pas un parcours sans obstacles. Lesdits loss spikes (augmentations soudaines de l’erreur pendant l’entraînement) ont été gérés en isolant les lots de données qui causaient une instabilité numérique. Souvent, ces pics étaient causés par des gradients explosifs dérivant de séquences de code malformées ou de textes avec des caractères Unicode corrompus. L’équipe d’ASC27 a développé un système d’écrêtage de gradient dynamique et un mécanisme d’auto-récupération qui écarte le lot corrompu, recharge le dernier point de contrôle sain et reprend l’entraînement en moins de deux minutes, minimisant les temps d’arrêt du cluster.

En Bref (TL;DR)

L’entraînement du modèle Vitruvian-1 exploite un pipeline distribué complexe créé par ASC27 pour traiter un dataset multilingue équilibré de cent vingt milliards de tokens.

Le pré-entraînement emploie des algorithmes d’optimisation avancés et une gestion sophistiquée de la mémoire matérielle pour garantir une efficacité maximale durant l’apprentissage syntaxique et sémantique.

La distillation Chain of Thought transfère des capacités exceptionnelles de raisonnement logique au modèle étudiant à travers des explications détaillées générées par un système enseignant plus grand.

Conclusions

En résumé, l’entraînement de vitruvian-1 représente une étape fondamentale pour ASC27 et pour l’intelligence artificielle. La combinaison d’un pré-entraînement massif sur 120 milliards de tokens et la distillation CoT garantit des performances exceptionnelles avec une efficacité computationnelle sans précédent.

La méthodologie adoptée démontre que l’avenir de l’informatique et de l’IA ne réside pas seulement dans l’augmentation indiscriminée des paramètres, mais dans la qualité des données et dans les techniques d’entraînement intelligentes. Le pipeline construit par ASC27 établit un nouveau standard industriel : un modèle capable de raisonner de manière transparente, multilingue dès sa conception et optimisé pour résoudre des problèmes complexes dans le monde réel.

Foire aux questions

Cette méthodologie innovante permet au modèle d’apprendre le raisonnement logique étape par étape au lieu de se limiter à mémoriser la réponse finale. Un système enseignant plus grand génère des explications détaillées pour des prompts complexes, transférant ensuite cette capacité déductive au modèle étudiant. De cette manière, on obtient des performances exceptionnelles dans la résolution de problèmes mathématiques et dans l’étude du code.

Le corpus pour l’entraînement est soigneusement équilibré pour inclure une vaste gamme d’informations mondiales et techniques. Il comprend principalement des textes en langue anglaise, suivis par des langues européennes, des langages de programmation, des idiomes asiatiques et des données mathématiques de très haute qualité. Cette diversité structurelle prévient les biais cognitifs et garantit des réponses précises dans des contextes multilingues ou hautement spécialisés.

Le système exploite un chargement de données asynchrone qui traite les textes pendant que les cartes graphiques exécutent les calculs principaux. Grâce à des protocoles avancés pour fragmenter les tenseurs et des technologies pour calculer le niveau d’attention de manière exacte, le système maintient une utilisation des processeurs proche de la limite maximale. Cette approche réduit considérablement les temps de traitement et les coûts énergétiques globaux.

Les pics d’erreur sont gérés via un système de surveillance en temps réel qui isole les blocs de données responsables de causer une instabilité numérique. L’équipe a mis en œuvre un mécanisme de récupération automatique qui écarte les informations corrompues et recharge la sauvegarde stable précédente. Cette procédure permet de reprendre le processus d’apprentissage en quelques minutes seulement, réduisant au minimum les temps d’arrêt.

Cette structure spécifique de réseau neuronal est extrêmement efficace pour traiter des séquences et générer du texte naturel. Associée à des optimiseurs avancés et à une gestion dynamique du taux d’apprentissage, elle permet au système de converger rapidement vers des résultats optimaux. Le résultat final est un système d’intelligence artificielle capable de traiter des documents très longs sans épuiser la mémoire disponible.

Encore des doutes sur Entraînement de Vitruvian-1 : Pipeline et Distillation CoT?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.