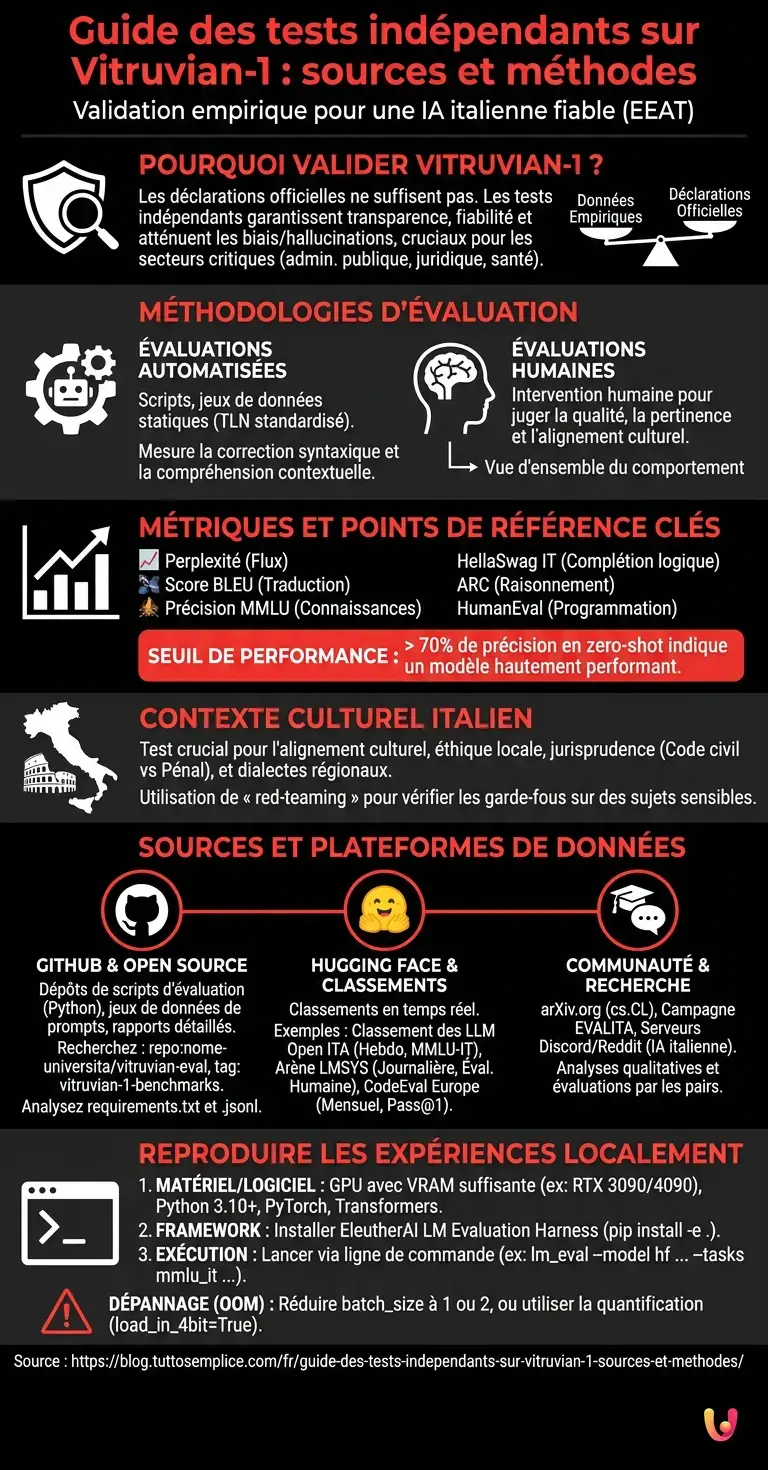

L’écosystème de l’intelligence artificielle a vu émerger Vitruvian-1 comme l’un des modèles fondamentaux les plus prometteurs du paysage européen et italien . Cependant, pour les développeurs, les chercheurs et les entreprises du secteur informatique, les déclarations officielles des créateurs du logiciel ne suffisent pas. Il est essentiel de baser leurs décisions architecturales sur des données empiriques et vérifiables. Ce guide technique explore en détail où trouver, comment interpréter et comment reproduire les preuves scientifiques et les benchmarks de tiers relatifs à ce modèle linguistique.

L’importance de la validation pour les modèles d’IA italiens

Pour évaluer les capacités réelles du modèle, il est essentiel d’analyser les tests indépendants vitruvian-1 . Ces évaluations impartiales, menées par la communauté scientifique, permettent de mesurer les performances du logiciel en dehors des environnements de développement officiels, garantissant ainsi transparence et fiabilité.

Dans le contexte de l’informatique moderne, le gain d’information provenant de sources non affiliées est le pilier de l’EEAT (Expérience, Autorité, Fiabilité, Transparence). Selon les données sectorielles actualisées à 2026, les grands modèles linguistiques (LLM) entraînés sur des corpus spécifiques à une langue, comme l’italien, ont tendance à présenter des biais ou des limitations que les benchmarks généralistes en anglais peinent à détecter. S’appuyer sur des évaluations externes permet d’atténuer le risque d’hallucinations dans des environnements de production critiques , tels que l’administration publique, le secteur juridique ou le secteur médico-sanitaire.

Méthodologies d’évaluation pour Vitruvian-1

Les méthodologies appliquées dans les tests indépendants Vitruvian-1 reposent sur des cadres standardisés pour le traitement du langage naturel (TLN). Les chercheurs utilisent des jeux de données spécifiques à la langue italienne, mesurant non seulement la correction syntaxique, mais aussi la compréhension du contexte culturel et réglementaire.

L’évaluation d’un modèle d’IA n’est pas un processus monolithique. Les méthodologies recommandées par la communauté open source se divisent en évaluations automatisées (basées sur des scripts et des ensembles de données statiques) et en évaluations humaines (avec intervention humaine). Les deux approches sont nécessaires pour obtenir une vue d’ensemble du comportement du logiciel.

Métriques standard et points de référence linguistiques

L’analyse des tests indépendants Vitruvian-1 montre que les métriques les plus utilisées incluent la perplexité, le score BLEU et la précision sur les tâches MMLU traduites. Ces indicateurs quantitatifs offrent un aperçu objectif des capacités de raisonnement du logiciel par rapport à d’autres modèles concurrents.

Les chercheurs indépendants s’appuient sur des suites d’évaluation rigoureuses. Parmi les tests les plus fréquents, on trouve HellaSwag IT (pour la complétion logique de phrases), ARC (AI2 Reasoning Challenge) adapté à l’italien, et des benchmarks spécifiques à la programmation comme HumanEval. Selon la documentation officielle des principaux frameworks de test, dépasser le seuil de 70 % de précision dans ces tests en mode zero-shot est un indicateur d’un modèle hautement performant.

Évaluation du contexte culturel italien

Un aspect crucial des tests indépendants de Vitruvian-1 concerne l’alignement culturel. Les évaluateurs indépendants testent le logiciel sur des dilemmes éthiques locaux, la jurisprudence italienne et les dialectes régionaux, s’assurant ainsi que l’intelligence artificielle ne se limite pas à traduire des concepts anglo-saxons.

Contrairement aux modèles globaux, une IA développée en se concentrant sur l’Italie doit comprendre les nuances de notre système juridique (par exemple, la différence entre le Code civil et le Code pénal) et les dynamiques socioculturelles. Les référentiels académiques incluent souvent des ensembles de données de « red-teaming » conçus spécifiquement pour forcer le modèle à générer des réponses sur des sujets sensibles italiens, vérifiant ainsi l’efficacité de ses garde-fous (filtres de sécurité).

Dépôts officiels et plateformes de partage

Les résultats des tests indépendants Vitruvian-1 sont régulièrement publiés sur des référentiels publics et des plateformes d’apprentissage automatique. L’accès à ces bases de données permet aux développeurs de consulter les journaux originaux, de télécharger les poids du modèle et de vérifier la reproductibilité des expériences.

Pour ceux qui recherchent des preuves concrètes, le web offre des plateformes spécifiques où la transparence est la règle. Il ne suffit pas de lire un article de synthèse ; un véritable professionnel de l’informatique doit analyser les données brutes.

Plateformes open source et GitHub

Sur GitHub, on trouve de nombreux dépôts consacrés aux tests indépendants vitruvian-1 . Les chercheurs y téléchargent des scripts d’évaluation en Python, des jeux de données de prompts et des rapports détaillés, facilitant ainsi la collaboration et l’identification d’éventuels biais ou hallucinations du logiciel.

Pour trouver ces ressources, il est conseillé d’utiliser des requêtes de recherche avancées sur GitHub, telles que repo:nome-universita/vitruvian-eval ou de rechercher des tags spécifiques comme vitruvian-1-benchmarks . Au sein de ces dépôts, les fichiers essentiels à analyser sont les fichiers requirements.txt (pour comprendre l’environnement de test) et les fichiers .jsonl contenant les sorties générées par le modèle lors des sessions d’inférence.

Hugging Face et classements indépendants

La plateforme Hugging Face héberge plusieurs classements où les tests indépendants vitruvian-1 sont comparés en temps réel. Les sections dédiées aux modèles fondamentaux italiens affichent les scores agrégés, permettant de filtrer les résultats en fonction de tâches spécifiques de traitement du langage.

Hugging Face est devenu le standard de facto pour le partage de modèles et de jeux de données. Vous trouverez ci-dessous un tableau récapitulatif des principaux types de classements où vous pouvez trouver des informations sur Vitruvian-1 :

| Classement des noms | Objectif principal | Indicateurs clés | Fréquence de mise à jour |

|---|---|---|---|

| Classement des LLM Open ITA | Modèles en langue italienne | MMLU-IT, HellaSwag-IT, RAG | Hebdomadaire |

| Arène des chatbots LMSYS (IT) | Évaluation humaine (classement Elo) | Test A/B en aveugle | Journalière |

| CodeEval Europe | Génération de code source | Pass@1, Pass@10 (Python, C++) | Mensuel |

Communauté et forums de recherche académique

Pour discuter des tests indépendants Vitruvian-1 , les chercheurs se réunissent au sein de communautés spécialisées et de forums académiques. Des plateformes comme arXiv pour les articles scientifiques et des serveurs Discord dédiés à l’IA italienne constituent les principales sources pour obtenir des analyses qualitatives et des évaluations par les pairs.

Outre les données quantitatives, l’analyse qualitative est indispensable. Les communautés offrent un contexte précieux pour interpréter les chiffres. Voici les canaux recommandés :

- arXiv.org : En cherchant « Vitruvian-1 » dans la section

cs.CL(Calcul et langage), il est possible d’accéder à des prépublications académiques qui analysent l’architecture et les performances du modèle avec rigueur scientifique. - Campagne EVALITA : l’initiative italienne pour l’évaluation des technologies du langage parlé et écrit est une référence. Les rapports des participants incluent souvent des tests sur des modèles de pointe.

- Serveurs Discord et Reddit : des communautés comme

r/LocalLLaMAou des serveurs Discord de développeurs italiens d’IA hébergent des discussions techniques sur l’optimisation de la quantification des modèles et les résultats obtenus sur du matériel grand public.

Comment reproduire les expériences sur son propre matériel

La reproduction des tests indépendants Vitruvian-1 nécessite un environnement logiciel correctement configuré et des ressources matérielles adéquates. En utilisant des frameworks comme LM Evaluation Harness, les développeurs peuvent exécuter les benchmarks localement, validant ainsi de première main les métriques déclarées par la communauté.

La véritable essence de l’Information Gain en informatique est la reproductibilité. Voici les étapes fondamentales pour réaliser les tests de manière autonome :

1. Configuration matérielle et logicielle requise : Une carte graphique (GPU) avec une mémoire vidéo (VRAM) suffisante est nécessaire (par exemple, NVIDIA RTX 3090/4090 pour les modèles quantifiés en 4 bits ou 8 bits) ou l’accès à un cluster cloud. Côté logiciel, Python 3.10+, PyTorch et la bibliothèque Transformers à jour sont indispensables.

2. Installation du framework d’évaluation : L’outil le plus accrédité est EleutherAI LM Evaluation Harness . L’installation se fait en clonant le dépôt officiel et en lançant la commande pip install -e . dans l’environnement virtuel.

3. Exécution du test : Via la ligne de commande, il est possible de lancer l’évaluation en spécifiant le modèle et les tâches souhaitées. Un exemple de commande standard est :

lm_eval --model hf --model_args pretrained=nome-org/vitruvian-1 --tasks mmlu_it --device cuda:0 --batch_size 8

Dépannage : Si une erreur de mémoire insuffisante (OOM) survient pendant l’exécution, il est conseillé de réduire la batch_size à 1 ou 2, ou d’utiliser des techniques de quantification en ajoutant l’argument load_in_4bit=True aux paramètres du modèle. Si les résultats diffèrent considérablement des résultats officiels, vérifiez que le modèle de prompt utilisé par le framework correspond exactement à celui utilisé pour l’entraînement de Vitruvian-1 (par exemple, ChatML ou des formats personnalisés).

En Bref (TL;DR)

S’appuyer sur des tests indépendants du modèle Vitruvian-1 est essentiel pour garantir la transparence et des décisions fondées sur des données empiriques vérifiables.

Les chercheurs mesurent les performances à l’aide de métriques standardisées, tout en évaluant la compréhension approfondie du contexte réglementaire et culturel italien.

Les développeurs et les professionnels peuvent consulter les résultats sur des plateformes open source comme GitHub pour vérifier la reproductibilité des expériences.

Conclusions

En résumé, la recherche de tests indépendants de Vitruvian-1 nécessite l’exploration des dépôts GitHub, des classements sur Hugging Face et des publications académiques. S’appuyer sur des sources tierces et des communautés open source est la seule méthode rigoureuse pour valider les capacités réelles de ce logiciel italien.

L’adoption de modèles linguistiques avancés ne peut se faire sans une phase d’audit technique approfondie. Comme nous l’avons vu, les ressources à la disposition des développeurs en 2026 sont vastes et hautement spécialisées. Qu’il s’agisse de consulter les métriques sur un tableau de classement ou d’exécuter des scripts de validation sur le serveur de l’entreprise , l’approche scientifique et indépendante reste la meilleure garantie pour intégrer l’intelligence artificielle de manière sûre, éthique et performante.

Foire aux questions

Les résultats des évaluations impartiales sont facilement accessibles sur des plateformes collaboratives open source comme GitHub et Hugging Face. En consultant les classements spécifiques aux modèles linguistiques italiens, les développeurs peuvent analyser les données brutes, comparer les métriques de performance et vérifier la validité des expériences menées par la communauté scientifique indépendante.

Une évaluation culturelle précise garantit que le modèle prenne en compte les spécificités de notre pays, telles que le système juridique et les dynamiques sociales, sans se limiter à la simple traduction de concepts anglo-saxons. Cette approche réduit le risque de réponses inappropriées et assure que le logiciel soit sûr et fiable pour une utilisation dans des secteurs critiques comme l’administration publique.

Pour effectuer les évaluations de manière autonome, il est nécessaire de disposer d’une carte graphique avec une mémoire suffisante et d’installer des frameworks spécifiques dédiés aux tests des modèles linguistiques. Via la ligne de commande, il est possible de lancer les scripts d’évaluation sur les jeux de données souhaités, en vérifiant personnellement les métriques déclarées et en s’assurant de la reproductibilité totale des expériences.

Les chercheurs mesurent les capacités du logiciel en analysant des indicateurs quantitatifs objectifs, notamment la perplexité et la précision sur des tâches spécifiques traduites en italien. Le dépassement du seuil de 70 % de précision en mode zéro-shot sur ces tests standardisés indique un niveau de raisonnement logique et linguistique hautement compétitif.

Si le système épuise la mémoire disponible pendant les sessions d’inférence, il est conseillé de réduire la taille du lot de traitement à des valeurs minimales. Alternativement, il est possible d’appliquer des techniques de quantification sur quatre ou huit bits pour alléger la charge de calcul sur le matériel, tout en maintenant un excellent niveau de précision dans les résultats finaux.

Encore des doutes sur Guide des tests indépendants sur Vitruvian-1 : sources et méthodes?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Sources et Approfondissements

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.