L’intelligence artificielle a fait une entrée fracassante dans nos vies, transformant notre façon de travailler, d’étudier et de communiquer. Des assistants vocaux qui allument les lumières de la maison aux chatbots avancés qui rédigent des e-mails à notre place, le confort est indéniable. Cependant, cette révolution numérique soulève une question fondamentale souvent ignorée : que deviennent nos données personnelles ?

Chaque fois que nous interagissons avec une IA générative, nous fournissons des informations. Parfois, ce sont des données anodines, d’autres fois des détails sensibles sur notre santé, nos finances ou nos opinions politiques. Dans le contexte européen, et plus particulièrement en France, la question de la confidentialité n’est pas seulement technique, mais profondément culturelle et réglementaire. Nous vivons à une époque où la tradition de la discrétion se heurte à l’innovation du partage total.

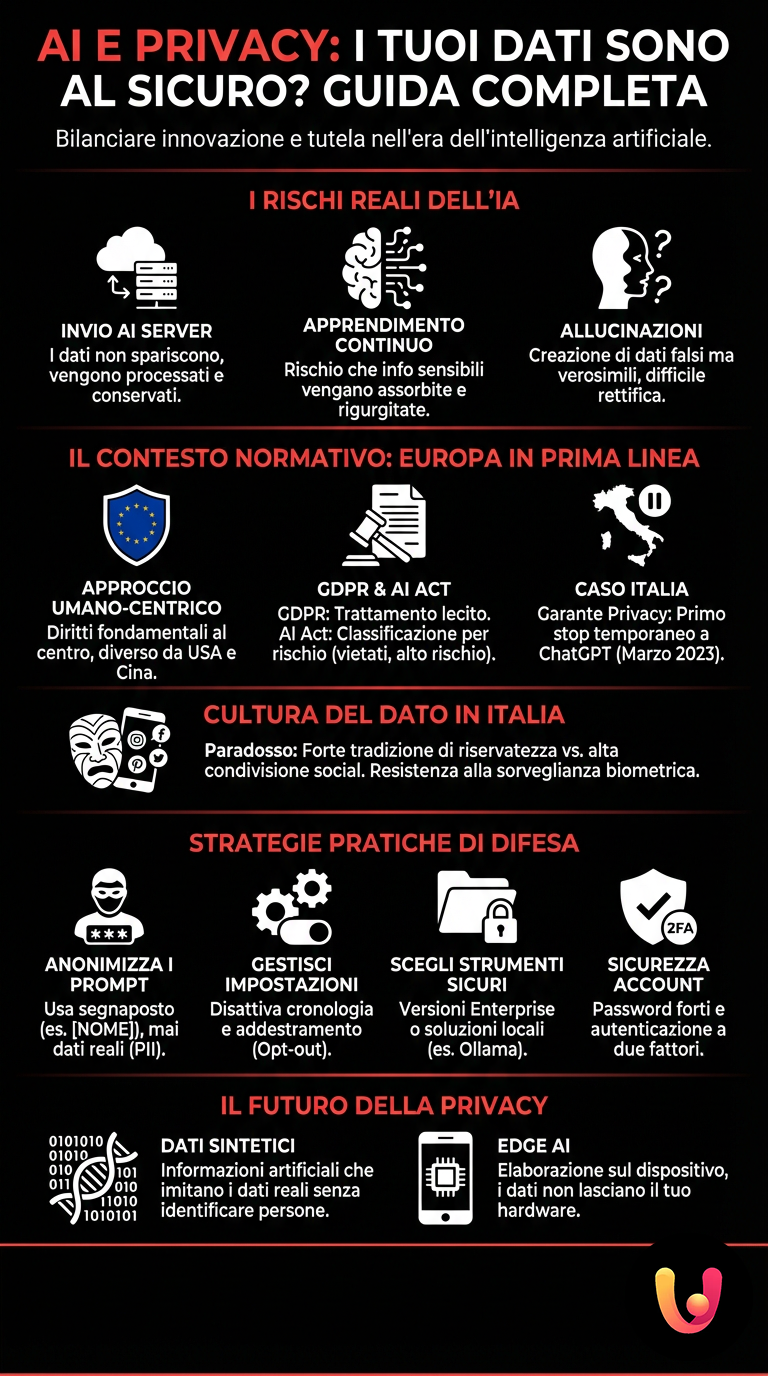

Dans cet article, nous analyserons les risques réels pour la vie privée à l’ère de l’IA, en examinant les réglementations en vigueur comme le RGPD et le nouvel AI Act, et nous fournirons des conseils pratiques pour naviguer dans cet océan numérique sans faire naufrage. Nous comprendrons comment équilibrer l’efficacité des outils modernes avec la protection nécessaire de notre identité numérique, en explorant également les meilleures pratiques pour une utilisation sécurisée de l’IA générative.

Le contexte réglementaire : la France et l’Europe en première ligne

L’Europe s’est distinguée au niveau mondial par une approche de la technologie « centrée sur l’humain ». Contrairement au modèle américain, axé sur le marché, ou au modèle chinois, axé sur l’État, le modèle européen place les droits fondamentaux au cœur de ses préoccupations. Le Règlement Général sur la Protection des Données (RGPD) est la pierre angulaire de cette défense.

Le RGPD stipule que les données personnelles doivent être traitées de manière licite, loyale et transparente. Cependant, l’entraînement des grands modèles de langage (LLM) se fait souvent sur d’énormes ensembles de données extraits du web (scraping), soulevant des doutes sur la légitimité du consentement. Si l’IA a « lu » vos publications sur les réseaux sociaux d’il y a dix ans pour apprendre à parler, a-t-elle violé votre vie privée ?

Le Garante, l’autorité italienne de protection des données, a été la première au monde, en mars 2023, à bloquer temporairement ChatGPT. Cet acte a déclenché un débat mondial sur la nécessité de règles claires pour l’entraînement des algorithmes.

Aujourd’hui, avec l’approbation de l’AI Act, l’Union Européenne classe les systèmes d’intelligence artificielle en fonction du risque. Les systèmes qui manipulent le comportement humain ou exploitent les vulnérabilités sont interdits, tandis que ceux à haut risque (comme l’IA utilisée dans le recrutement ou la justice) doivent respecter des obligations très strictes de transparence et de sécurité.

Comment l’IA gère (et risque de diffuser) vos données

Pour comprendre les risques, nous devons comprendre comment ces systèmes fonctionnent. Lorsque vous écrivez à un chatbot, vos mots ne disparaissent pas dans le néant. Ils sont envoyés aux serveurs du fournisseur, traités et, dans de nombreux cas, conservés. Les entreprises utilisent ces conversations à deux fins principales : améliorer le modèle et surveiller la sécurité.

Le risque de l’apprentissage continu

De nombreux utilisateurs croient à tort que l’IA est un conteneur étanche. En réalité, il existe un risque que les informations fournies par les utilisateurs soient absorbées par le modèle et potentiellement régurgitées dans des conversations avec d’autres utilisateurs. Si un médecin saisit les données d’un patient pour obtenir de l’aide pour un diagnostic, ou si un avocat télécharge un contrat confidentiel, ces données pourraient entrer dans le cycle d’apprentissage.

Pour atténuer ce risque, il est fondamental de connaître les paramètres de confidentialité des outils que nous utilisons. De nombreuses plateformes offrent désormais la possibilité d’exclure ses propres conversations de l’entraînement, mais c’est souvent une option à activer manuellement (opt-out). Pour ceux qui recherchent un contrôle maximal, l’utilisation de solutions locales est préférable : un guide utile à ce sujet est celui concernant Ollama et DeepSeek en local, qui explique comment faire tourner l’IA sur son propre matériel sans envoyer de données vers le cloud.

Hallucinations et fausses données

Un autre risque pour la vie privée est paradoxal : la création de données fausses mais vraisemblables. Les IA peuvent « halluciner », attribuant à des personnes réelles des actions jamais accomplies ou des citations jamais prononcées. Cela peut nuire à la réputation en ligne d’un individu, créant un profil numérique déformé difficile à rectifier, étant donné que le « droit à l’oubli » est complexe à appliquer au sein d’un réseau neuronal.

Tradition et Innovation : La culture méditerranéenne de la donnée

En France, comme en Italie, le rapport à la vie privée est complexe. D’un côté, il existe une forte culture de la confidentialité familiale et personnelle. De l’autre, nous sommes l’un des peuples les plus actifs sur les réseaux sociaux et prompts à adopter les nouvelles technologies mobiles. Cette dichotomie crée un terrain fertile pour les risques.

Notre tradition juridique et culturelle tend à protéger la dignité de la personne. Dans le contexte de l’IA, cela se traduit par une forte résistance contre la surveillance biométrique et la reconnaissance faciale indiscriminée dans les espaces publics, des pratiques que l’AI Act limite fortement. Nous voulons l’innovation, mais pas au prix de devenir des numéros dans une base de données.

Les petites et moyennes entreprises françaises, épine dorsale de l’économie, se trouvent souvent démunies. L’adoption d’outils d’IA pour le marketing ou la gestion client se fait parfois sans une véritable analyse d’impact sur la protection des données (AIPD), exposant à la fois l’entreprise et les clients à des violations réglementaires.

Stratégies pratiques pour protéger votre vie privée

Il n’est pas nécessaire d’arrêter d’utiliser l’intelligence artificielle pour être en sécurité. Il suffit d’adopter une approche consciente et défensive. Voici quelques stratégies concrètes à appliquer immédiatement.

Anonymisation des prompts

La règle d’or est : ne jamais saisir de données d’identification personnelle (PII – Personally Identifiable Information) dans un prompt. Au lieu d’écrire « Rédige un e-mail pour le client Jean Dupont, né le 12/05/1980, numéro de sécurité sociale… », utilisez des espaces réservés comme « [NOM CLIENT] » ou des données fictives. L’IA travaillera sur la structure et le contenu logique, et vous pourrez insérer les données réelles plus tard, hors ligne.

Gestion de l’historique et des paramètres

Vérifiez régulièrement les paramètres de votre compte. Sur des plateformes comme ChatGPT ou Gemini, vous pouvez désactiver l’historique des conversations. Cela empêche que les conversations soient sauvegardées à long terme et utilisées pour l’entraînement. Si vous utilisez l’IA pour le travail, vérifiez si votre entreprise dispose d’un plan « Entreprise » : ces versions garantissent contractuellement que les données ne seront pas utilisées pour entraîner les modèles publics.

Choisir le bon outil

Toutes les IA ne se valent pas. Certaines sont conçues spécifiquement pour la confidentialité et la sécurité, tandis que d’autres sont plus « ouvertes ». Avant de confier vos données à un service, lisez la politique de confidentialité ou consultez des comparatifs fiables, comme celui que vous trouverez dans notre article sur ChatGPT, Gemini et Copilot, pour comprendre quelle plateforme offre les meilleures garanties pour vos besoins.

Cybersécurité et IA : Un lien indissociable

La confidentialité n’existe pas sans sécurité. Les bases de données des entreprises d’IA sont des cibles de choix pour les cybercriminels. Si un pirate informatique violait les serveurs d’un fournisseur de services d’IA, des millions de conversations privées pourraient être exposées. Il est essentiel de protéger ses comptes avec des mots de passe forts et l’authentification à deux facteurs (2FA).

De plus, l’IA elle-même est utilisée pour créer des attaques plus sophistiquées, comme des e-mails de phishing hautement personnalisés et sans fautes de grammaire, ou des deepfakes vocaux pour des arnaques téléphoniques. Pour approfondir la manière de se défendre contre ces menaces évoluées, nous vous conseillons de lire notre guide sur comment protéger sa vie privée et ses données en ligne.

La sensibilisation est la première ligne de défense. Un utilisateur informé est un utilisateur difficile à tromper et à profiler.

L’avenir : Confidentialité synthétique et Edge AI

L’avenir de la confidentialité dans l’IA pourrait résider dans de nouvelles technologies. Les « données synthétiques » sont des informations créées artificiellement qui imitent les statistiques des données réelles sans contenir d’informations sur des personnes réelles. Cela permet d’entraîner les IA sans violer la vie privée de quiconque.

Une autre tendance est l’Edge AI, c’est-à-dire le traitement des données directement sur l’appareil de l’utilisateur (smartphone ou PC) plutôt que dans le cloud. Les nouveaux processeurs (NPU) intégrés dans les ordinateurs modernes vont dans cette direction. Cela réduit considérablement le risque de fuite de données, car les informations ne quittent jamais votre appareil. Pour ceux qui doivent gérer de grandes quantités de données personnelles, il est fondamental de considérer également où celles-ci sont stockées, en évaluant des stratégies de sauvegarde sécurisée et de cloud privé.

En Bref (TL;DR)

Nous analysons comment les chatbots gèrent les informations des utilisateurs et offrons des conseils pratiques pour protéger les données sensibles lors de l’utilisation de l’IA générative.

Découvrez comment les chatbots gèrent vos informations et quelles stratégies adopter pour protéger votre vie privée en ligne.

Découvrez des conseils pratiques pour protéger vos données sensibles et utiliser l’IA générative sans risque pour votre vie privée.

Conclusion

L’intelligence artificielle représente une opportunité extraordinaire de croissance et de simplification, mais dans le contexte européen et français, elle ne peut se passer du respect de la personne. La confidentialité n’est pas un obstacle à l’innovation, mais la condition nécessaire pour que l’innovation soit durable et démocratique.

Protéger ses données requiert un mélange de conscience réglementaire, d’hygiène numérique et d’utilisation d’outils appropriés. En continuant à nous informer et à exiger la transparence des entreprises technologiques, nous pouvons profiter des avantages de l’IA sans sacrifier notre liberté numérique. La technologie doit rester un outil au service de l’homme, et jamais l’inverse.

Questions fréquentes

En France et en Europe, les services d’IA doivent respecter le RGPD, garantissant des standards de transparence élevés. Cependant, les conversations peuvent être utilisées pour entraîner les modèles si vous ne modifiez pas les paramètres. Il est fondamental d’éviter de saisir des données sensibles, de santé ou bancaires dans les conversations.

La plupart des chatbots, y compris ceux d’OpenAI et de Google, proposent des options spécifiques dans les paramètres appelées Contrôles des données. En désactivant l’historique des conversations ou l’option d’entraînement du modèle, vous empêchez que vos conversations soient utilisées pour améliorer l’algorithme.

Le risque principal est la fuite de données d’entreprise confidentielles. Si vous téléchargez des documents internes sur des versions publiques et gratuites des chatbots, ces informations pourraient devenir une partie de la connaissance de l’IA. À des fins professionnelles, il est conseillé d’utiliser des versions Entreprise qui garantissent la confidentialité des données.

L’AI Act est le premier règlement au monde qui classe les systèmes d’IA en fonction du risque. Il impose des obligations strictes de transparence et de sécurité pour les systèmes à haut risque et interdit les pratiques qui menacent les droits fondamentaux, assurant que l’innovation technologique ne bafoue pas la vie privée des citoyens européens.

Oui, en vertu du droit à l’oubli prévu par le RGPD, les utilisateurs peuvent demander la suppression de leurs données personnelles. Les plateformes doivent fournir des formulaires ou des paramètres accessibles pour supprimer le compte ou retirer des conversations spécifiques des serveurs.

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.