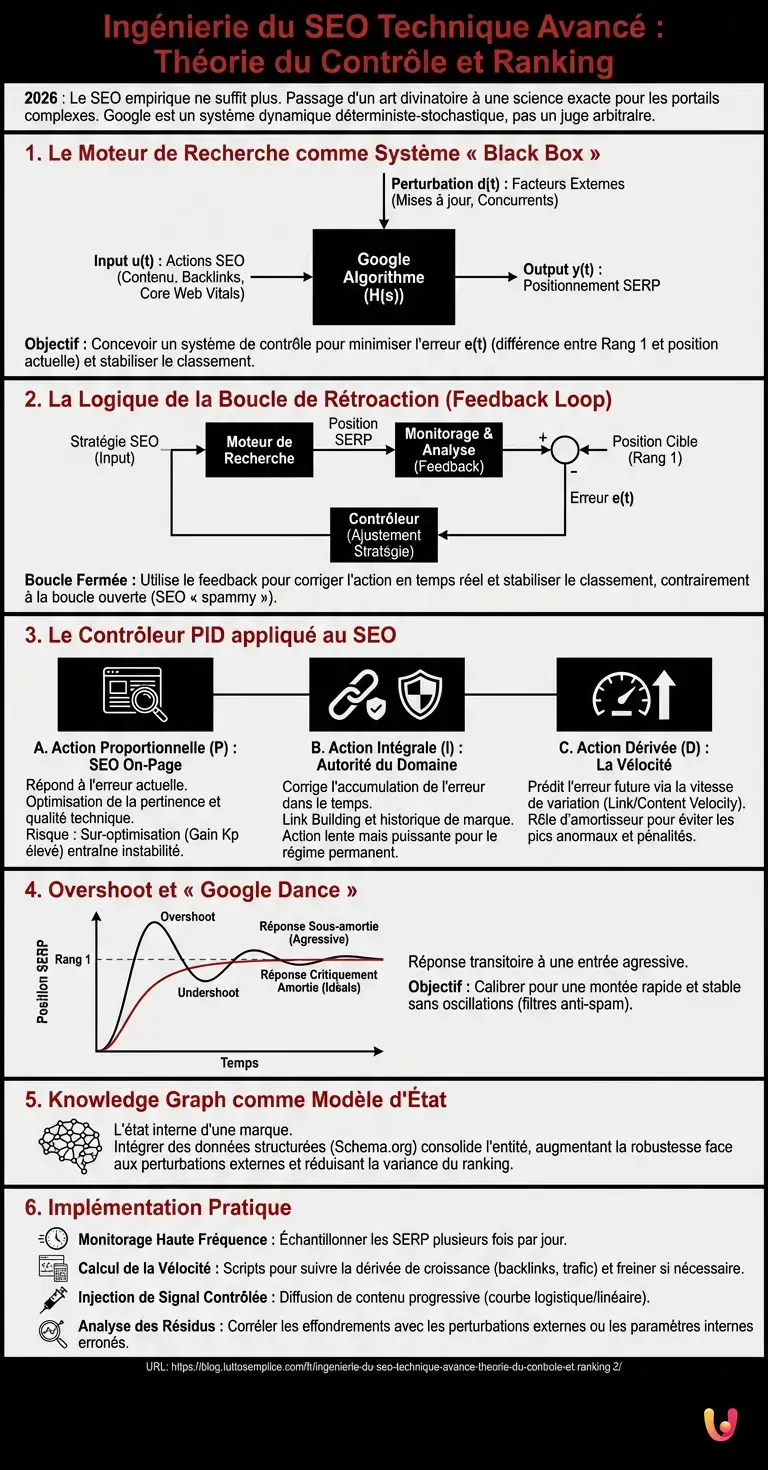

Nous sommes en 2026 et l’approche empirique du référencement organique ne suffit plus. Pour les CTO et les spécialistes qui gèrent des portails à haute complexité, le seo technique avancé doit évoluer de l’art divinatoire vers une science exacte. Dans ce contexte, l’entité principale avec laquelle nous interagissons, Google, ne doit pas être vue comme un juge arbitraire, mais comme un système dynamique déterministe-stochastique. Cet article propose un changement de paradigme radical : l’application de la Théorie du Contrôle Automatique et de l’Ingénierie des Systèmes pour décoder, prédire et stabiliser les fluctuations des SERP.

1. Le Moteur de Recherche comme Système « Black Box »

En ingénierie électronique, un système dont on ne connaît pas la structure interne mais dont les entrées et les sorties sont observables est défini comme une Black Box (Boîte Noire). L’algorithme de classement de Google répond parfaitement à cette définition.

Nous pouvons modéliser le processus SEO à travers une fonction de transfert H(s), où :

- Input u(t) : L’ensemble de nos actions (publication de contenu, acquisition de backlinks, optimisation des Core Web Vitals).

- Output y(t) : Le positionnement dans la SERP pour une requête donnée.

- Perturbation d(t) : Facteurs externes (mises à jour de l’algorithme, actions des concurrents, volatilité de la requête).

L’objectif du seo technique avancé n’est pas simplement de maximiser l’input, mais de concevoir un système de contrôle qui minimise l’erreur e(t), c’est-à-dire la différence entre la position souhaitée (Rang 1) et la position actuelle, en garantissant la stabilité du système dans le temps.

2. La Logique de la Boucle de Rétroaction (Feedback Loop)

Un système en boucle ouverte (open loop) agit sans vérifier le résultat. C’est l’erreur classique du SEO « spammy » : lancer des milliers de liens et espérer. Un système en boucle fermée (closed loop), en revanche, utilise le feedback (rétroaction) pour corriger l’action en temps réel.

Pour stabiliser le classement, nous devons implémenter une boucle de rétroaction qui surveille constamment les SERP et adapte la stratégie d’entrée. C’est ici qu’intervient le concept de contrôleur PID.

3. Le Contrôleur PID appliqué au SEO

Le contrôleur PID (Proportionnel-Intégral-Dérivé) est le mécanisme de rétroaction le plus répandu dans l’industrie pour contrôler des variables comme la température ou la vitesse. Nous pouvons mapper les trois composantes du PID sur les dynamiques de classement :

A. Action Proportionnelle (P) : Le SEO On-Page

L’action proportionnelle répond à l’erreur actuelle. En termes SEO, cela correspond à l’optimisation On-Page et à la pertinence du contenu.

- Fonctionnement : Si le classement est bas, j’augmente la densité sémantique et la qualité technique.

- Risque (Gain Kp trop élevé) : Si l’on exagère avec l’action proportionnelle (ex. bourrage de mots-clés ou sur-optimisation agressive), le système devient instable. Google détecte l’anomalie et le classement commence à osciller violemment.

B. Action Intégrale (I) : L’Autorité du Domaine

L’action intégrale corrige l’accumulation de l’erreur dans le temps. En SEO, cela est représenté par le Link Building et la Brand Authority historique.

- Fonctionnement : Même si le On-Page est parfait, sans « histoire » (l’intégrale dans le temps des signaux de confiance), le classement n’atteint pas la cible. L’action intégrale est lente mais puissante : elle élimine l’erreur en régime permanent.

- Dynamique : Les backlinks n’agissent pas instantanément ; ils ont un temps de latence (inertie du système). Un bon ingénieur SEO sait attendre que l’action intégrale atteigne son régime avant de modifier à nouveau les entrées.

C. Action Dérivée (D) : La Vélocité

C’est la composante la plus critique pour le seo technique avancé moderne. L’action dérivée prédit l’erreur future en se basant sur la vitesse de variation.

- Application : Google analyse la dérivée première de vos signaux (Link Velocity, Content Velocity).

- Le rôle d’amortisseur : Si vous acquérez 1000 liens en un jour, la dérivée grimpe en flèche. Un algorithme bien conçu (Google Penguin ou les modernes SpamBrain) interprétera ce pic comme une tentative de manipulation.

- Stratégie : Utiliser la logique dérivée pour « freiner » l’acquisition de liens lorsque la croissance est trop rapide, évitant ainsi l’Overshoot (le dépassement de la cible suivi d’un effondrement ou d’une pénalité).

4. Overshoot et « Google Dance » : Analyse de la Réponse Échelon

Lorsque nous lançons un nouveau site ou une campagne agressive, nous appliquons une entrée échelon au système. La réponse de Google n’est jamais immédiate et linéaire, mais présente souvent un comportement oscillatoire amorti, connu empiriquement sous le nom de « Google Dance ».

Du point de vue de la Théorie des Systèmes, il s’agit d’un transitoire. Si le système est sous-amorti (trop d’agressivité, trop de liens en peu de temps), le classement montera rapidement (overshoot) pour ensuite s’effondrer sous la position d’équilibre (undershoot) et osciller. L’objectif est de calibrer les entrées pour obtenir une réponse critiquement amortie : une montée rapide vers la première page sans oscillations qui activeraient les filtres anti-spam.

5. Knowledge Graph comme Modèle d’État

Au-delà de la fonction de transfert, les systèmes complexes s’analysent via l’espace d’état. Pour une marque, l’« état interne » est représenté par sa présence dans le Knowledge Graph.

Intégrer des données structurées (Schema.org) et consolider l’entité dans le Knowledge Graph agit comme un stabilisateur du système. Une entité bien définie dans le graphe de Google réduit la variance de la sortie (ranking) face aux perturbations externes (mises à jour de l’algorithme). Mathématiquement, un Knowledge Graph solide augmente la robustesse du système, rendant le positionnement moins sensible au bruit de fond des SERP.

6. Implémentation Pratique : Du Modèle à la Stratégie

Comment traduire cette théorie en opérationnel pour une stratégie de seo technique avancé ?

- Monitorage à Haute Fréquence : Il ne suffit pas de vérifier le classement une fois par jour. Utilisez des API pour échantillonner les SERP plusieurs fois par jour afin de reconstruire la courbe de réponse du système.

- Calcul de la Vélocité (Dérivée) : Créez des scripts (Python/R) qui calculent la dérivée de la croissance des backlinks et du trafic. Si la pente dépasse un seuil de sécurité (déterminé par l’analyse des concurrents dans le top 3), interrompez l’acquisition (feedback négatif).

- Injection de Signal Contrôlée : Ne publiez pas 50 articles en un jour. Diffusez du contenu en suivant une courbe logistique ou linéaire constante pour maintenir l’action dérivée sous contrôle.

- Analyse des Résidus : Si le classement s’effondre sans raison apparente, analysez la corrélation avec les perturbations externes (mises à jour). Si l’effondrement est systémique, votre modèle (site) a des paramètres internes erronés (ex. dette technique, UX pauvre).

En Bref (TL;DR)

La gestion de portails complexes nécessite d’abandonner l’art divinatoire pour embrasser l’Ingénierie des Systèmes et la Théorie du Contrôle Automatique.

Google doit être interprété comme un système dynamique « black box » où les actions SEO servent d’entrées pour stabiliser les fluctuations des SERP.

L’application du contrôleur PID permet de calibrer parfaitement le contenu, l’autorité et la vitesse pour éviter les pénalités et garantir une croissance constante.

Conclusions

Traiter le SEO comme une discipline humaniste est obsolète. En appliquant les principes de la Théorie du Contrôle, nous transformons l’optimisation en un processus d’ingénierie mesurable et prévisible. En modélisant Google comme un système dynamique et en utilisant des contrôleurs logiques pour gérer nos entrées, nous pouvons minimiser le risque de pénalités et maximiser la stabilité du positionnement à long terme, transformant la volatilité en un paramètre gérable.

Foire aux questions

Traiter le moteur de recherche comme un système dynamique permet de passer d une approche empirique à une science exacte. En modélisant le processus avec des fonctions de transfert et des boucles de rétroaction, il est possible de prédire les fluctuations des SERP et de minimiser l erreur de positionnement, garantissant une stabilité que les stratégies traditionnelles ne peuvent offrir.

La méthode PID équilibre trois forces : l action Proportionnelle gère le SEO On Page en fonction de l erreur actuelle ; l action Intégrale soigne l autorité historique du domaine ; l action Dérivée contrôle la vitesse de croissance. Ce mélange prévient les oscillations violentes et les pénalités dues à une optimisation trop agressive.

Ce comportement oscillatoire est une réponse transitoire du système à une entrée soudaine, comme un lancement massif de liens. Pour l éviter, il faut calibrer les entrées pour obtenir une réponse critiquement amortie, montant vers la première page sans dépasser la cible et sans activer les filtres antispam pour excès de vitesse.

Le Knowledge Graph agit comme un modèle d état qui définit l identité de la marque. Consolider sa propre entité dans le graphe de Google augmente la robustezza du site contre les perturbations externes, comme les mises à jour algorithmiques, réduisant la variance du classement et rendant la présence en ligne plus solide sur le long terme.

Surveiller la dérivée première de la croissance des backlinks permet de détecter des pics anormaux que Google interpréterait comme une manipulation. En maintenant la vitesse d acquisition sous un seuil de sécurité calculé sur les concurrents, on évite l overshoot et on simule une croissance naturelle, protégeant le site des effondrements soudains.

Encore des doutes sur Ingénierie du SEO Technique Avancé : Théorie du Contrôle et Ranking?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Sources et Approfondissements

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.