Lorsque vous tapez une question sur votre clavier ou que vous dictez une commande à votre smartphone, l’action semble éthérée, presque magique. La réponse s’affiche instantanément, semblant provenir d’un nuage immatériel. Pourtant, cette interaction avec l’intelligence artificielle repose sur une infrastructure physique colossale, dont l’appétit pour les ressources naturelles est bien réel. Loin d’être virtuel, le « Cloud » est constitué de béton, de câbles, de processeurs en surchauffe et, surtout, de fluides. Aujourd’hui, nous allons disséquer une métrique environnementale souvent ignorée au profit de l’empreinte carbone : l’empreinte hydrique. Quelle est la quantité d’eau exacte consommée pour générer une seule réponse de votre assistant virtuel ? La réponse réside dans les méandres de la thermodynamique et de la gestion thermique des centres de données.

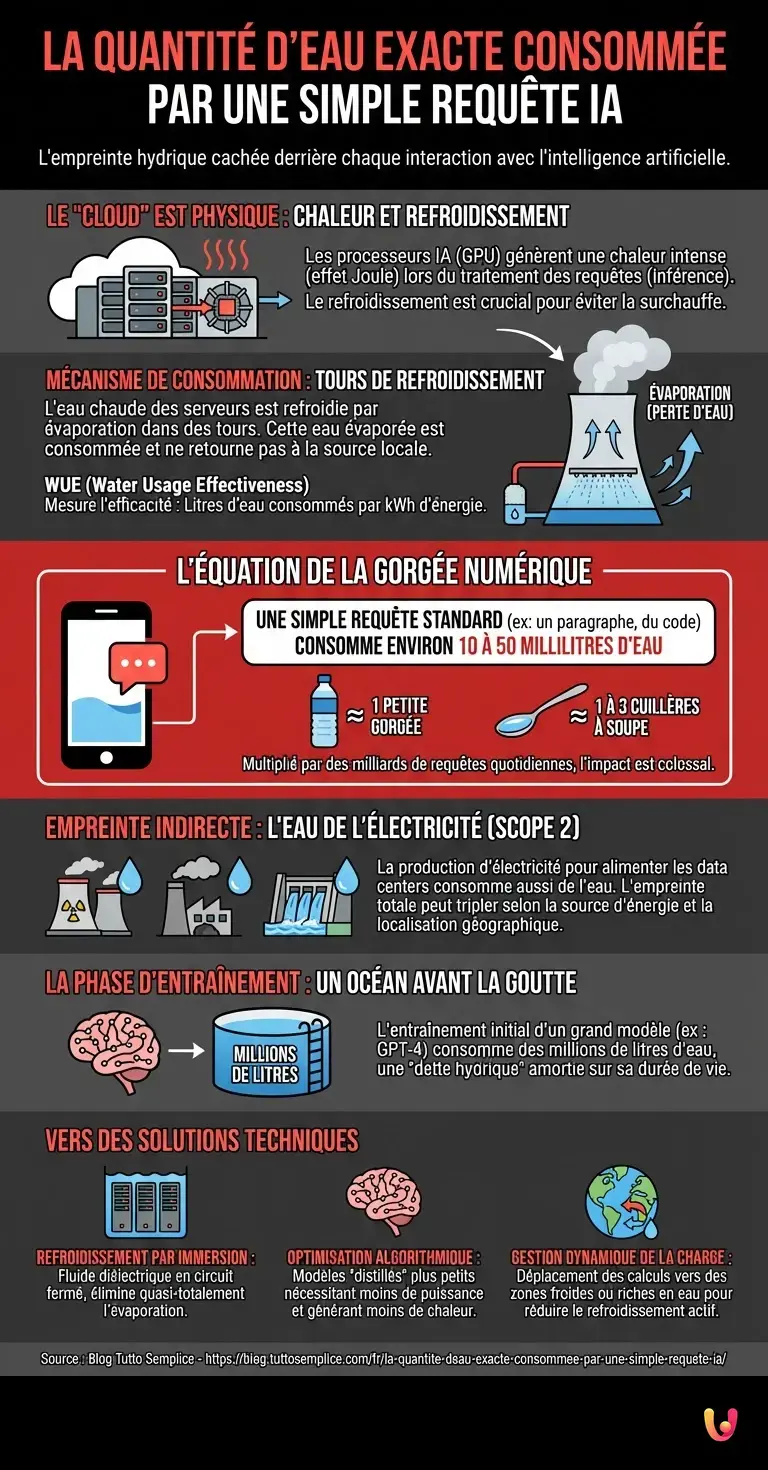

La thermodynamique de l’inférence : pourquoi l’IA a-t-elle soif ?

Pour comprendre pourquoi une simple requête textuelle consomme de l’eau, il faut plonger au cœur du matériel informatique. Les modèles de deep learning et d’IA générative, tels que ceux propulsant ChatGPT ou ses concurrents, fonctionnent sur des milliers de processeurs graphiques (GPU) interconnectés. Ces puces sont des monstres de puissance de calcul, effectuant des milliards d’opérations matricielles par seconde pour prédire le mot suivant de votre réponse.

Or, en vertu de l’effet Joule, tout courant électrique traversant un conducteur dégage de la chaleur. Lorsque des milliers de GPU tournent à plein régime pour traiter une inférence (le processus de génération d’une réponse), la densité thermique au sein des serveurs atteint des niveaux critiques. Si cette chaleur n’est pas évacuée immédiatement, les composants fondent ou se mettent en sécurité, arrêtant le service.

C’est ici qu’intervient l’eau. Bien que le refroidissement par air existe, il est souvent insuffisant ou énergétiquement inefficace pour les densités de puissance des supercalculateurs modernes dédiés au machine learning. Les opérateurs de centres de données se tournent donc vers des systèmes de refroidissement liquide ou évaporatif, beaucoup plus efficaces pour transférer les calories excédentaires.

Le mécanisme de consommation : WUE et tours de refroidissement

Dans l’industrie, l’efficacité de l’utilisation de l’eau est mesurée par un indicateur clé : le WUE (Water Usage Effectiveness). Il calcule le nombre de litres d’eau consommés par kilowattheure (kWh) d’énergie utilisée par le data center. Il est crucial de distinguer ici le « prélèvement » (l’eau prise puis rejetée, souvent plus chaude) de la « consommation » (l’eau qui s’évapore et ne retourne pas directement à la source locale).

La majorité de la consommation d’eau liée à l’IA provient des tours de refroidissement. Le principe est simple mais gourmand : l’eau chaude provenant du circuit de refroidissement des serveurs est pulvérisée dans une tour où elle rencontre un flux d’air. Une partie de cette eau s’évapore, absorbant une quantité massive d’énergie thermique (chaleur latente de vaporisation), ce qui refroidit l’eau restante qui repart vers les serveurs. Cette vapeur qui s’échappe des toits des data centers représente une perte nette d’eau liquide pour le bassin versant local.

L’équation de la gorgée numérique

Alors, combien cela représente-t-il pour votre question ? Des chercheurs de l’Université de Californie à Riverside et de l’Université du Texas à Arlington ont mené des études approfondies pour quantifier ce phénomène. Leurs modélisations, qui font autorité dans le domaine technique, ont établi une corrélation directe entre la consommation énergétique d’un modèle de langage et son évaporation d’eau.

Selon ces estimations, un centre de données moyen aux États-Unis consomme environ 500 millilitres d’eau (l’équivalent d’une petite bouteille standard) pour chaque tranche de 20 à 50 requêtes simples. Si l’on affine ce calcul pour isoler une seule réponse standard (un paragraphe d’explication, du code, ou un résumé), la consommation s’élève à une fourchette comprise entre 10 et 50 millilitres d’eau.

Cela peut sembler dérisoire à l’échelle individuelle — l’équivalent d’une à trois cuillères à soupe d’eau ou d’une petite gorgée. Cependant, il faut multiplier ce chiffre par les milliards de requêtes quotidiennes effectuées à travers le monde. De plus, ce chiffre ne concerne que la consommation directe (Scope 1) liée au refroidissement sur site.

L’empreinte indirecte : l’eau de l’électricité

L’analyse technique ne serait pas complète sans aborder le « Scope 2 », c’est-à-dire l’eau consommée pour produire l’électricité qui alimente les GPU. Les centrales électriques, qu’elles soient nucléaires, au charbon ou au gaz, utilisent également d’énormes quantités d’eau pour leurs cycles thermodynamiques et leur refroidissement. Les barrages hydroélectriques, quant à eux, subissent l’évaporation de leurs réservoirs.

Si votre requête est traitée par un centre de données alimenté par une électricité « assoiffée », l’empreinte hydrique totale de votre réponse peut tripler, voire quadrupler. La localisation géographique du serveur qui traite votre demande est donc déterminante. Une requête traitée en Irlande (climat frais, refroidissement naturel possible une partie de l’année) aura une empreinte hydrique radicalement différente d’une requête traitée en Arizona ou au Texas, où l’évaporation est maximale et l’électricité souvent thermique.

La phase d’entraînement : un océan avant la goutte

Il est également important de noter que le chiffre de 10 à 50 ml concerne uniquement la phase d’inférence (l’utilisation de l’outil). Avant même que vous ne posiez votre première question, le modèle a dû être entraîné. L’entraînement d’un modèle comme GPT-4 a nécessité des mois de calculs intensifs.

Les rapports techniques estiment que l’entraînement d’un grand modèle de langage consomme autant d’eau que ce qui est nécessaire pour remplir une tour de refroidissement nucléaire standard, soit plusieurs millions de litres d’eau douce évaporés. Cette « dette hydrique » est amortie sur la durée de vie du modèle, mais elle constitue le socle invisible de chaque interaction future.

Vers des solutions techniques : refroidissement par immersion et IA sobre

Face à ce constat et aux risques de stress hydrique, l’industrie technologique ne reste pas inactive. Des innovations majeures sont en cours de déploiement pour réduire ce ratio eau/requête :

- Le refroidissement par immersion diphasique : Au lieu d’utiliser de l’eau et de l’air, les serveurs sont plongés directement dans un bain de fluide diélectrique (non conducteur) qui bout à basse température. La vapeur est condensée en circuit fermé, éliminant presque totalement la consommation d’eau par évaporation.

- L’optimisation algorithmique : Des modèles plus petits, dits « distillés », permettent de fournir des réponses de qualité similaire pour des requêtes simples avec une fraction de la puissance de calcul, et donc de la chaleur générée.

- La gestion dynamique de la charge : Les algorithmes déplacent désormais les calculs non urgents vers des data centers situés dans des zones où la température ambiante est plus basse ou l’eau plus abondante, réduisant ainsi le besoin de refroidissement actif.

En Bref (TL;DR)

Derrière la magie du virtuel, les infrastructures physiques de l’IA dégagent une chaleur intense exigeant un refroidissement liquide constant.

Les centres de données utilisent l’évaporation pour dissiper cette énergie thermique, entraînant une perte nette d’eau mesurée par le WUE.

Des études révèlent qu’une seule réponse générée par l’IA consomme l’équivalent d’une petite gorgée d’eau, impactant les ressources locales.

Conclusion

La prochaine fois que vous solliciterez votre assistant virtuel pour rédiger un e-mail ou résumer un texte, visualisez cette petite gorgée d’eau, entre 10 et 50 millilitres, s’évaporant instantanément d’une tour de refroidissement quelque part dans le monde. C’est le prix physique de notre confort numérique. Si l’intelligence artificielle promet de résoudre des problèmes complexes, y compris environnementaux, elle n’échappe pas aux lois de la physique : toute intelligence, même artificielle, a besoin d’énergie pour fonctionner et d’eau pour survivre à sa propre chaleur. La prise de conscience de cette matérialité est la première étape vers une utilisation plus sobre et une conception technologique plus durable.

Questions fréquemment posées

Selon les recherches universitaires, une simple interaction standard avec un modèle de langage génératif entraîne l’évaporation d’environ 10 à 50 millilitres d’eau. Ce volume correspond à l’eau nécessaire pour refroidir les serveurs qui surchauffent lors du traitement des calculs complexes, un chiffre qui varie selon l’efficacité énergétique du centre de données et le climat local.

L’infrastructure physique du Cloud repose sur des milliers de processeurs graphiques qui dégagent une chaleur intense par effet Joule lorsqu’ils effectuent des calculs. Pour éviter la surchauffe et la panne du matériel, les opérateurs utilisent souvent des tours de refroidissement évaporatif, un système efficace mais gourmand qui dissipe la chaleur en faisant s’évaporer de grandes quantités d’eau dans l’atmosphère.

Le WUE, ou Water Usage Effectiveness, est l’indicateur clé qui mesure l’efficacité de l’utilisation de l’eau dans les centres de données. Il calcule le nombre de litres d’eau consommés par kilowattheure d’énergie utilisée, permettant de distinguer l’eau simplement prélevée de l’eau réellement consommée par évaporation, cette dernière étant définitivement perdue pour le bassin versant local.

Il faut distinguer deux phases : l’entraînement initial d’un grand modèle consomme des millions de litres d’eau, comparable au remplissage d’une tour de refroidissement nucléaire. Cependant, bien que la consommation par requête unique soit faible, le volume total de l’utilisation quotidienne (l’inférence) par des milliards d’utilisateurs finit par représenter une empreinte hydrique colossale sur le long terme.

L’industrie développe plusieurs innovations comme le refroidissement par immersion diphasique, où les serveurs baignent dans un fluide en circuit fermé, éliminant presque l’évaporation. D’autres stratégies incluent l’optimisation algorithmique pour créer des modèles moins énergivores et le déplacement dynamique des calculs vers des zones géographiques plus froides ou riches en eau pour limiter le besoin de refroidissement actif.

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.