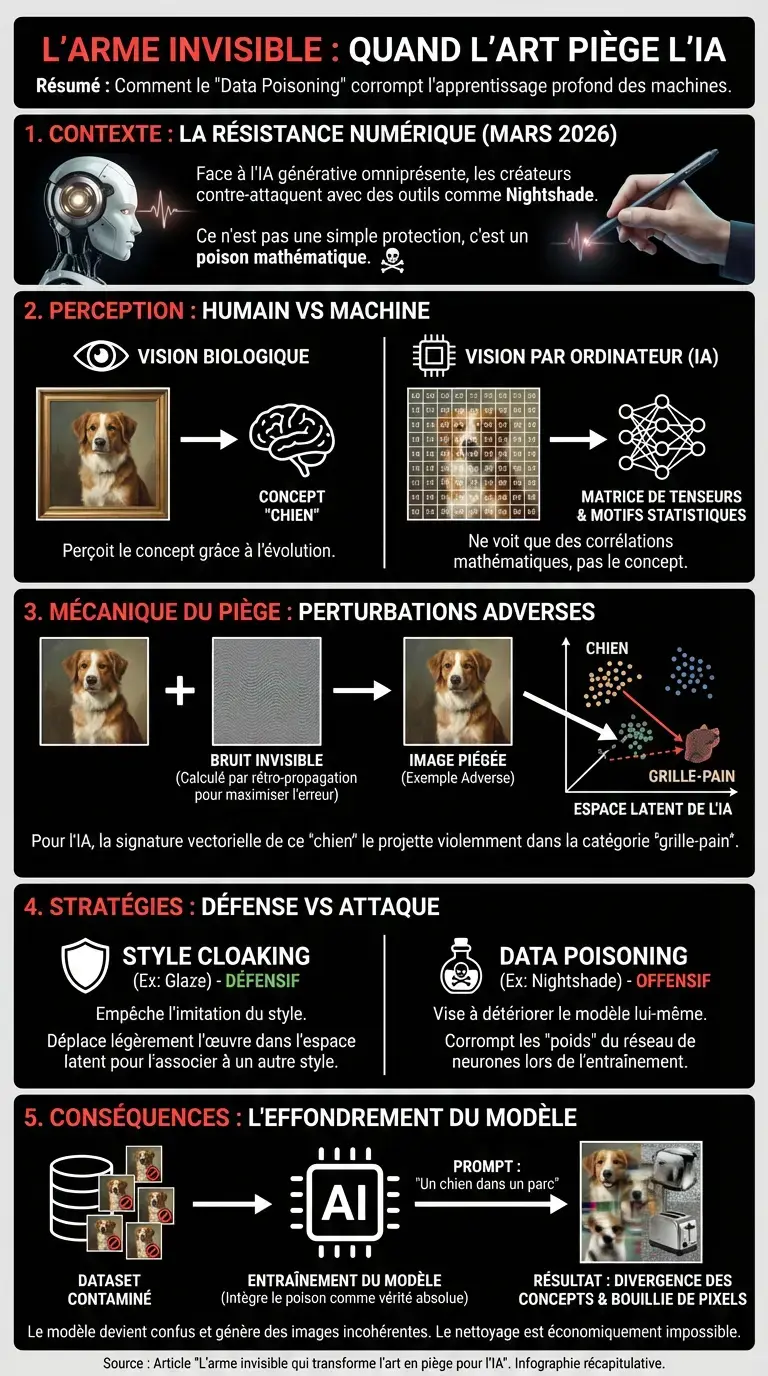

C’est une guerre silencieuse qui se joue au niveau du pixel, bien en deçà de ce que l’œil humain peut percevoir. Alors que nous sommes en mars 2026 et que l’intelligence artificielle générative a envahi chaque recoin de la création numérique, une résistance technique s’est organisée. L’entité principale au cœur de cette contre-attaque se nomme Nightshade (et ses successeurs), un outil logiciel devenu l’arme de prédilection des créateurs. Ce que le grand public ignore souvent, c’est que cette “encre invisible” n’est pas une simple protection de droits d’auteur, mais un véritable poison mathématique conçu pour corrompre l’apprentissage profond des machines. Comment une image parfaitement claire pour vous peut-elle devenir un cauchemar hallucinatoire pour une IA ? Plongée dans les entrailles du data poisoning.

La mécanique de la perception : Humain vs Machine

Pour comprendre comment fonctionne ce piège, il faut d’abord saisir la différence fondamentale entre la vision biologique et la vision par ordinateur (computer vision) utilisée dans le machine learning. Lorsque vous regardez une peinture représentant un chien, votre cerveau identifie le concept “chien” grâce à des millions d’années d’évolution biologique.

Pour un modèle d’IA, qu’il s’agisse d’un système de diffusion ou d’un réseau de neurones convolutifs (CNN), cette image n’est qu’une matrice de tenseurs, une grille de valeurs numériques représentant l’intensité des pixels (Rouge, Vert, Bleu). L’IA n’a aucune conscience du “chien”. Elle apprend à reconnaître des motifs statistiques (bords, textures, formes) qu’elle associe, via des milliards de paramètres, au mot-clé “chien” dans son espace latent.

C’est précisément cette dépendance aux corrélations mathématiques strictes que les artistes exploitent désormais. L’encre invisible n’est pas une substance, mais une perturbation structurelle des données.

Les perturbations adverses : le piratage de l’espace latent

Le secret technique derrière ces outils réside dans ce que l’on appelle les “exemples adverses” (adversarial examples). En cybersécurité de l’IA, cela consiste à modifier très légèrement les données d’entrée pour induire le modèle en erreur, tout en gardant la modification imperceptible pour un observateur humain.

Imaginez l’espace latent d’une IA générative comme une immense carte multidimensionnelle. Dans un coin, tous les vecteurs mathématiques représentant des “chats” sont regroupés. Dans un autre, ceux des “chiens”. Lorsqu’un artiste applique un traitement comme Nightshade à son œuvre, l’algorithme calcule une couche de bruit spécifique. Ce bruit n’est pas aléatoire. Il est calculé par rétro-propagation du gradient (gradient descent) pour maximiser l’erreur du modèle.

Concrètement, l’outil prend l’image d’un chien et demande : “Quels pixels dois-je modifier de façon infinitésimale pour que, mathématiquement, cette image ressemble à un grille-pain pour le réseau de neurones ?”. Le résultat est une image qui ressemble toujours à un chien pour nous, mais dont la signature vectorielle la projette violemment dans la catégorie “grille-pain” de l’espace latent de l’IA.

Du bouclier au poison : la stratégie du chaos

Il existe deux niveaux dans cette technologie de camouflage, souvent confondus par le grand public mais techniquement distincts : le style cloaking (camouflage de style) et le data poisoning (empoisonnement de données).

Le premier, popularisé par des outils comme Glaze, vise à empêcher l’IA d’imiter le style d’un artiste spécifique. Il déplace légèrement l’œuvre dans l’espace latent pour qu’elle soit associée à un style différent (par exemple, faire passer une peinture à l’huile pour du fusain aux yeux de l’algorithme). C’est une mesure défensive.

Le second, incarné par l’approche de l’encre invisible offensive, est bien plus radical. Il vise à détériorer le modèle lui-même. Si une entreprise entraîne sa prochaine version de modèle (similaire aux itérations futures de DALL-E ou des concurrents graphiques de ChatGPT) sur un dataset contenant un pourcentage significatif de ces images piégées, les conséquences sont désastreuses.

Les “poids” du réseau de neurones (les connexions qui stockent la mémoire de l’IA) sont ajustés incorrectement. Le modèle apprend que la structure visuelle d’un chien correspond au mot “chat”, ou qu’un paysage impressionniste correspond à “voiture”. C’est ce qu’on appelle la divergence des concepts.

Pourquoi le Deep Learning est-il si vulnérable ?

On pourrait penser que les modèles de deep learning, avec leur puissance de calcul phénoménale, pourraient simplement “voir à travers” ce bruit. Or, c’est paradoxalement leur précision qui fait leur faiblesse. Ces modèles sont entraînés pour être extrêmement sensibles aux caractéristiques de haute fréquence (les détails fins des textures).

L’encre invisible s’insère justement dans ces hautes fréquences. Elle modifie les corrélations entre le texte (le prompt) et l’image. Lorsqu’un modèle génératif est entraîné sur ces données corrompues, il ne se contente pas d’ignorer l’image : il l’intègre comme une vérité fondamentale. Contrairement à un humain qui peut douter, une IA considère ses données d’entraînement comme la réalité absolue.

Si suffisamment d’images sont “empoisonnées”, le modèle subit un effondrement partiel. Lorsqu’un utilisateur demandera ensuite “un chien dans un parc”, l’IA, confuse par ses poids contradictoires, générera une bouillie de pixels mêlant des caractéristiques de chiens, de grille-pains et de bruit pur. Le coût pour nettoyer un dataset ainsi contaminé est astronomique, car il faudrait vérifier manuellement chaque image, annulant l’avantage principal du scraping de données massif.

En Bref (TL;DR)

Les créateurs utilisent désormais des poisons mathématiques comme Nightshade pour corrompre l’apprentissage des machines sans altérer la perception visuelle humaine.

Des modifications invisibles transforment la signature mathématique des œuvres, forçant l’intelligence artificielle à mal interpréter ce qu’elle voit lors de son entraînement.

Au-delà de la simple protection, cette stratégie offensive vise à saboter les futurs modèles d’IA en introduisant un chaos conceptuel irréversible.

Conclusion

L’utilisation de cette “encre invisible” marque un tournant majeur dans l’histoire de l’informatique. Elle transforme les images, autrefois simples données passives, en agents actifs de résistance. Pour les ingénieurs en intelligence artificielle, c’est un rappel brutal que la robustesse des modèles de machine learning reste un défi non résolu. Tant que les réseaux de neurones percevront le monde à travers des vecteurs mathématiques et non par la compréhension sémantique réelle, ils resteront vulnérables à ces illusions mathématiques. En 2026, la toile n’est plus seulement un support pour l’art, c’est devenu un champ de mines cryptographique.

Questions fréquemment posées

Le data poisoning est une technique offensive qui insère des perturbations invisibles dans les images pour corrompre l apprentissage des modèles. Contrairement à une simple protection, cette méthode modifie la signature vectorielle de l image, forçant l IA à associer visuellement un objet, comme un chien, à un concept totalement différent, tel qu un grille-pain, ce qui détériore durablement la précision du modèle génératif.

Bien que souvent confondus, ces outils ont des objectifs distincts. Glaze utilise le camouflage de style, une mesure défensive qui empêche l IA d imiter la patte artistique d un créateur en déplaçant l œuvre dans l espace latent. À l inverse, Nightshade agit comme un poison offensif visant à endommager le fonctionnement même du modèle en faussant les poids du réseau de neurones lors de son entraînement futur.

La vulnérabilité réside dans la manière dont le Deep Learning analyse les images via des matrices de tenseurs et non par une compréhension sémantique. Les modèles sont extrêmement sensibles aux hautes fréquences et aux corrélations mathématiques strictes. En insérant du bruit calculé par rétro-propagation dans ces détails fins, on crée un exemple adverse qui reste imperceptible pour l œil humain mais qui modifie radicalement la catégorisation mathématique de l image par la machine.

L intégration d images piégées entraîne une divergence des concepts, où le modèle apprend des associations erronées qu il considère comme des vérités absolues. Si le pourcentage de données corrompues est significatif, cela peut provoquer un effondrement partiel du modèle, le rendant incapable de générer des images cohérentes. Le nettoyage d un tel dataset devient alors économiquement et techniquement prohibitif car il nécessite une vérification manuelle massive.

Encore des doutes sur L’arme invisible qui transforme l’art en piège pour l’IA?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Sources et Approfondissements

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.