Chaque jour, vous prononcez en moyenne entre 15 000 et 20 000 mots. Que ce soit lors d’un appel téléphonique, en dictant un message vocal ou en interagissant avec un assistant virtuel, votre voix est votre principal outil de communication. Pourtant, au-delà des mots et des émotions que vous pensez transmettre, vos cordes vocales diffusent un flux continu de données physiologiques invisibles. C’est ici qu’entre en jeu une entité scientifique fascinante : les biomarqueurs vocaux. Ces infimes variations acoustiques, totalement imperceptibles pour l’oreille humaine, constituent une véritable signature clinique que la technologie moderne est désormais capable de décoder.

L’oreille humaine est une merveille de l’évolution, optimisée pour comprendre le langage, capter les intonations et filtrer le bruit de fond. Cependant, elle est biologiquement incapable de percevoir des micro-tremblements de l’ordre de la milliseconde ou des variations de fréquence de quelques hertz. Pendant des décennies, ces informations sont restées perdues dans les ondes sonores. Aujourd’hui, grâce à la puissance de calcul moderne et à l’intelligence artificielle, ce paradigme a radicalement changé. La machine n’écoute plus seulement ce que vous dites ; elle analyse la mécanique intime de votre corps à travers la façon dont vous le dites.

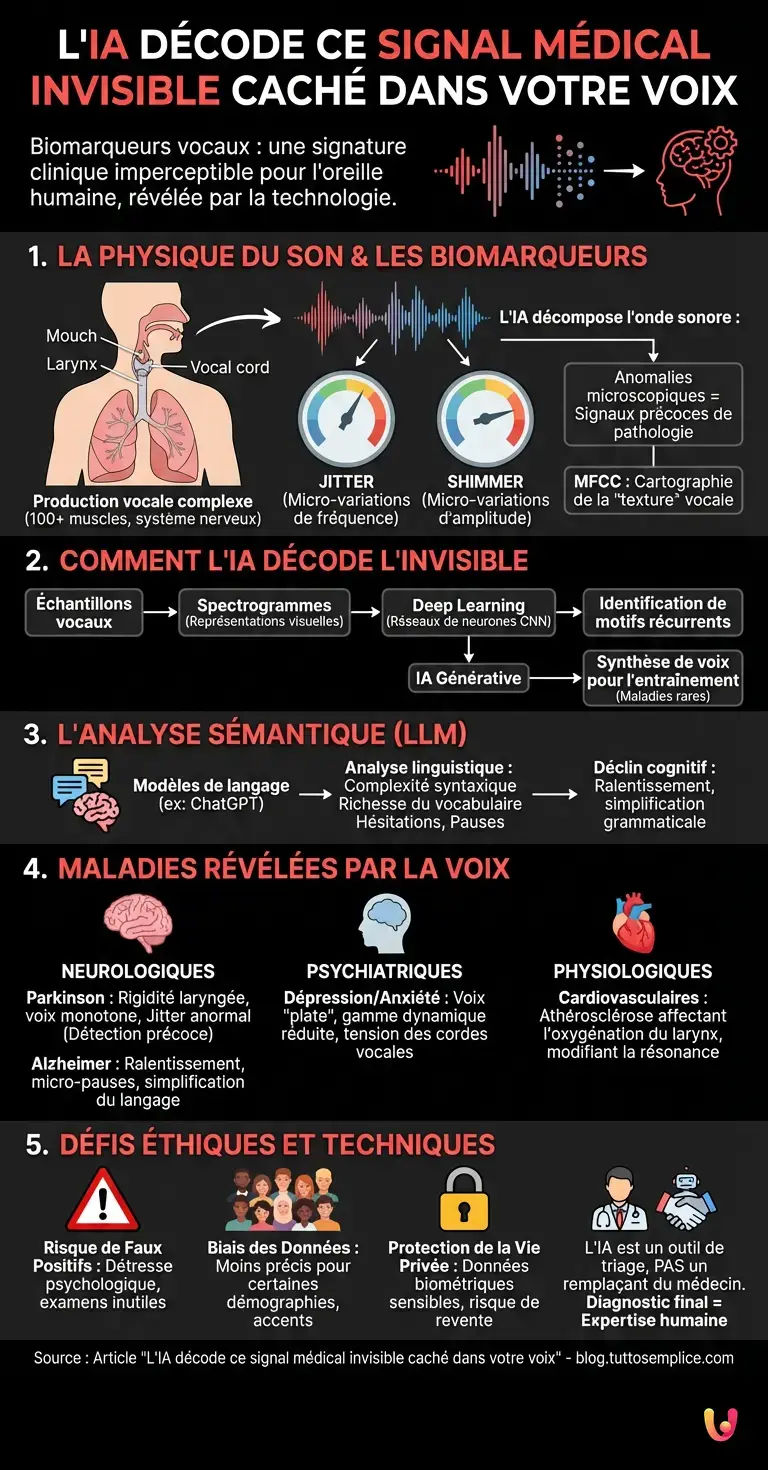

La physique du son : ce que nous ne pouvons pas entendre

Pour comprendre comment une simple phrase peut révéler votre avenir médical, il faut d’abord plonger dans la biomécanique de la phonation. La production de la voix est un processus extraordinairement complexe qui nécessite la coordination synchronisée de plus de 100 muscles, allant du diaphragme aux lèvres, en passant par le larynx et la langue. Ce système est directement contrôlé par le système nerveux central et périphérique, notamment par le nerf vague (le dixième nerf crânien), qui innerve les cordes vocales et se trouve également connecté au cœur et aux poumons.

Lorsque vous parlez, l’air expulsé par vos poumons fait vibrer vos cordes vocales. Cette vibration génère une onde sonore fondamentale, qui est ensuite modulée par les cavités de résonance de votre gorge, de votre bouche et de votre nez. L’IA ne se contente pas d’enregistrer cette onde ; elle la décompose mathématiquement. Les algorithmes recherchent des anomalies microscopiques dans deux paramètres acoustiques fondamentaux : le Jitter et le Shimmer.

Le Jitter correspond aux micro-variations de la fréquence de la voix d’un cycle vibratoire à l’autre. Le Shimmer, quant à lui, mesure les micro-variations de l’amplitude (le volume) entre ces mêmes cycles. À ces mesures s’ajoutent les MFCC (Mel-Frequency Cepstral Coefficients), une représentation mathématique du spectre vocal qui permet de cartographier la “texture” unique de la voix. Une personne en parfaite santé aura des valeurs de Jitter et de Shimmer extrêmement stables. Mais si une pathologie commence à affecter le système nerveux, le système respiratoire ou le système cardiovasculaire, cette stabilité est compromise bien avant que le patient ne ressente le moindre symptôme.

Comment l’intelligence artificielle décode-t-elle l’invisible ?

Extraire ces données acoustiques n’est que la première étape. Le véritable exploit technologique réside dans l’interprétation de ces signaux. C’est ici que le machine learning (apprentissage automatique) entre en scène. Historiquement, les médecins tentaient d’établir des corrélations manuelles entre la voix et la maladie, une tâche fastidieuse et limitée par les biais humains. Aujourd’hui, les chercheurs nourrissent des algorithmes avec des millions d’échantillons vocaux provenant de patients sains et de patients diagnostiqués avec diverses pathologies.

Le processus repose massivement sur le deep learning (apprentissage profond), une sous-catégorie de l’IA qui utilise des réseaux de neurones artificiels inspirés du cerveau humain. Les fichiers audio sont souvent transformés en spectrogrammes, des représentations visuelles des fréquences sonores au fil du temps. Des réseaux de neurones convolutifs (CNN), initialement conçus pour la reconnaissance d’images, “regardent” ces spectrogrammes pour identifier des motifs récurrents. Le réseau apprend par lui-même que telle combinaison de micro-tremblements, associée à une certaine rigidité spectrale, est statistiquement corrélée à l’apparition future d’une maladie spécifique.

De plus, l’émergence de l’IA générative a accéléré cette recherche. L’un des défis majeurs en médecine est le manque de données pour les maladies rares. Les modèles génératifs peuvent désormais synthétiser des voix artificielles présentant des biomarqueurs spécifiques, permettant d’entraîner les algorithmes de diagnostic de manière beaucoup plus robuste sans compromettre la confidentialité des patients réels.

L’analyse sémantique : quand ChatGPT s’en mêle

L’analyse acoustique pure (le son de la voix) est redoutable, mais elle devient encore plus puissante lorsqu’elle est couplée à l’analyse sémantique et linguistique (le choix des mots et la structure des phrases). C’est le domaine de prédilection des grands modèles de langage (LLM) comme ChatGPT.

Lorsqu’un patient parle, un modèle d’AI avancé peut transcrire le discours en temps réel et analyser la complexité syntaxique, la richesse du vocabulaire, la durée des pauses entre les mots et les hésitations. Par exemple, une diminution subtile de l’utilisation de verbes d’action ou une augmentation des pronoms indéfinis (“chose”, “truc”) combinée à des pauses de quelques millisecondes supplémentaires pour chercher ses mots, constitue un signal d’alarme sémantique. En fusionnant les réseaux de neurones acoustiques (qui détectent les tremblements physiques) et les modèles de langage (qui détectent le déclin cognitif), les chercheurs créent des outils de diagnostic multimodaux d’une précision inédite.

De Parkinson à la dépression : ce que votre voix révèle

Mais concrètement, quelles sont ces maladies que l’algorithme peut lire dans notre avenir médical ? Les applications cliniques des biomarqueurs vocaux se divisent en trois grandes catégories : neurologiques, psychiatriques et physiologiques.

La maladie de Parkinson : C’est l’un des domaines les plus documentés. Parkinson est caractérisée par une dégénérescence des neurones dopaminergiques, entraînant une rigidité musculaire. Bien avant que les tremblements des mains n’apparaissent, cette rigidité affecte les muscles minuscules du larynx. La voix devient très légèrement monotone, perd en intensité et présente un Jitter anormal. L’IA peut détecter ces anomalies des années avant le diagnostic clinique traditionnel, offrant une fenêtre cruciale pour des traitements neuroprotecteurs précoces.

La maladie d’Alzheimer et le déclin cognitif : Ici, c’est la combinaison de l’acoustique et de la linguistique qui prime. Les algorithmes repèrent un ralentissement imperceptible du débit de parole, des micro-pauses anormales et une simplification de la structure grammaticale. La charge cognitive nécessaire pour formuler une pensée complexe se reflète directement dans la fluidité vocale.

La santé mentale : La dépression, l’anxiété et le trouble de stress post-traumatique (TSPT) modifient la tension des cordes vocales et le rythme respiratoire. Une personne souffrant de dépression sévère présentera souvent une voix qualifiée de “plate” par l’algorithme, avec une gamme dynamique (la variation de volume et de ton) considérablement réduite. L’IA peut suivre l’évolution de ces paramètres au fil du temps pour évaluer l’efficacité d’un traitement antidépresseur ou prédire une rechute.

Les maladies cardiovasculaires : C’est peut-être la découverte la plus surprenante. Des études récentes ont démontré que les patients présentant un risque élevé de maladie coronarienne possèdent des caractéristiques vocales spécifiques. L’explication réside dans le système nerveux autonome. L’athérosclérose (le durcissement des artères) et les problèmes cardiaques affectent subtilement la circulation sanguine et l’oxygénation des tissus, y compris ceux du larynx, modifiant ainsi la résonance de la voix d’une manière que seule une machine peut quantifier.

Que se passe-t-il si la machine se trompe ? Les défis éthiques et techniques

Face à une technologie aussi intrusive et puissante, une question légitime se pose : que se passe-t-il si l’algorithme se trompe ? Le risque de “faux positifs” est l’un des défis majeurs de la médecine prédictive. Annoncer à un patient sain que sa voix indique un risque imminent de développer la maladie d’Alzheimer pourrait provoquer une détresse psychologique immense, sans compter les examens médicaux invasifs et coûteux qui s’ensuivraient inutilement.

De plus, la question des biais dans les données d’entraînement est critique. Si un modèle de deep learning est entraîné majoritairement sur des voix d’hommes caucasiens de 40 ans, il risque d’être beaucoup moins précis pour diagnostiquer une femme asiatique de 70 ans. Les accents, les dialectes, les particularités anatomiques individuelles et même la qualité du microphone du smartphone utilisé pour capter la voix sont autant de variables qui peuvent fausser l’analyse.

C’est pourquoi la communauté scientifique insiste sur le fait que l’IA ne doit pas remplacer le médecin, mais agir comme un outil de triage ou un système d’alerte précoce. Les biomarqueurs vocaux sont comparables à un thermomètre ultra-sophistiqué : ils indiquent qu’une anomalie est en cours de développement, mais le diagnostic final et le plan de traitement doivent toujours relever de l’expertise clinique humaine.

Enfin, la protection de la vie privée est un enjeu colossal. Nos voix sont des données biométriques uniques. Si nos smartphones, nos enceintes connectées ou nos applications de visioconférence analysent en permanence notre santé en arrière-plan, à qui appartiennent ces données médicales ? Les entreprises technologiques pourraient-elles vendre ces profils de risque à des compagnies d’assurance ? La législation devra évoluer rapidement pour encadrer strictement l’utilisation de l’analyse vocale prédictive.

En Bref (TL;DR)

Notre voix diffuse en continu des biomarqueurs vocaux, d’infimes variations acoustiques imperceptibles à l’oreille humaine cachant des données physiologiques cruciales.

L’intelligence artificielle analyse la mécanique intime de votre corps en traquant des micro-tremblements invisibles dans les ondes sonores de chaque phrase.

Grâce au machine learning, ces signaux invisibles sont interprétés pour prédire et diagnostiquer des pathologies bien avant l’apparition des premiers symptômes.

Conclusion

La convergence entre la phonétique, la neurologie et l’informatique de pointe a ouvert une nouvelle ère dans la médecine préventive. Ce détail inaudible dans votre voix, cette infime variation de fréquence ou de rythme, est une fenêtre ouverte sur le fonctionnement interne de votre corps. Grâce aux avancées fulgurantes du machine learning et de l’analyse sémantique, notre smartphone se transforme progressivement en un stéthoscope numérique permanent, capable de lire notre avenir médical dans les ondes sonores de nos conversations quotidiennes.

Alors que la technologie continue de s’affiner, le défi des prochaines années ne sera plus seulement technique, mais éthique et réglementaire. Il s’agira de trouver le juste équilibre entre l’incroyable potentiel de sauver des vies grâce à un diagnostic ultra-précoce et la nécessité absolue de protéger l’intimité de nos échanges. Une chose est sûre : la prochaine fois que vous laisserez un message vocal, rappelez-vous que vous transmettez bien plus que de simples mots. Vous partagez, à votre insu, le bulletin de santé de votre avenir.

Questions fréquemment posées

Un biomarqueur vocal correspond à une infime variation acoustique présente dans la voix, qui reste totalement imperceptible pour les oreilles humaines. La technologie moderne analyse ces micro-tremblements et ces changements de fréquence pour détecter des anomalies physiologiques invisibles. Ces signaux sonores permettent ainsi de diagnostiquer des pathologies graves bien avant le début des tout premiers symptômes physiques.

Les algorithmes actuels sont capables de repérer de nombreuses pathologies neurologiques, psychiatriques et physiologiques à partir de simples enregistrements. Ils détectent notamment la maladie de Parkinson, le déclin cognitif lié au syndrome Alzheimer, la dépression sévère, et même certains risques de maladies cardiovasculaires. Cette détection ultra-précoce offre aux patients une fenêtre de temps cruciale pour commencer des traitements adaptés.

Le système commence par décomposer mathématiquement les ondes sonores pour mesurer des paramètres acoustiques fondamentaux, comme les micro-variations de fréquence et de volume. Ensuite, les modèles informatiques étudient ces données sous forme de spectrogrammes visuels pour repérer des anomalies. Enfin, ces résultats physiques sont souvent croisés avec une analyse sémantique approfondie du vocabulaire et de la syntaxe.

Nos voix constituent des données biométriques uniques qui révèlent des informations extrêmement intimes sur notre état de santé général. Si nos téléphones ou nos enceintes connectées analysent notre condition médicale en permanence, le risque de voir ces profils revendus à des compagnies privées devient une préoccupation réelle. Une législation stricte est donc absolument indispensable pour encadrer cette nouvelle forme de médecine prédictive.

Non, la communauté scientifique affirme clairement que cette technologie innovante ne doit en aucun cas remplacer le professionnel de santé. Elle agit plutôt comme un système préventif ou un outil de triage médical extrêmement sophistiqué. Le diagnostic final, tout comme le choix du plan de traitement, relèveront toujours de la décision humaine et du savoir médical.

Encore des doutes sur L’IA décode ce signal médical invisible caché dans votre voix?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Sources et Approfondissements

- Reconnaissance automatique de la parole (Traitement du signal vocal et IA) – Wikipédia

- Biomécanique de la phonation et fonctionnement des cordes vocales – Wikipédia

- Apprentissage profond (Deep Learning) et réseaux de neurones artificiels – Wikipédia

- L’OMS appelle à une utilisation sûre et éthique de l’IA dans le domaine de la santé – Organisation Mondiale de la Santé

- Éthique et gouvernance de l’intelligence artificielle pour la santé – Organisation mondiale de la Santé (OMS)

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.