Quiconque a déjà partagé sa vie avec un chien ou un chat s’est inévitablement posé cette question en croisant son regard : que se passe-t-il réellement dans sa tête ? Nous observons nos compagnons à quatre pattes avec une attention fascinée, persuadés de comprendre leurs joies, leurs peurs ou leurs attentes. Pourtant, sous cette apparente complicité, se cache une réalité biologique déconcertante. Votre animal vous transmet en permanence des signaux d’une complexité inouïe, des données brutes que votre cerveau humain est tout simplement incapable de traiter. C’est ici qu’intervient la vision par ordinateur, l’entité principale de cette révolution technologique et une branche fascinante de l’intelligence artificielle qui vient de franchir un cap historique dans la communication inter-espèces.

Pendant des décennies, les éthologues et les vétérinaires se sont heurtés à un mur perceptif. Les animaux ne parlent pas, et leur langage corporel, bien que documenté, reste sujet à l’interprétation humaine, souvent biaisée par notre propre anthropomorphisme. Mais récemment, les avancées spectaculaires de l’IA ont permis de mettre en lumière un détail profondément troublant, un phénomène qui se produit des centaines de fois par jour juste sous nos yeux, sans que nous n’en ayons jamais eu conscience. Pour comprendre ce que la machine a enfin réussi à décoder, il faut d’abord comprendre pourquoi nous étions aveugles.

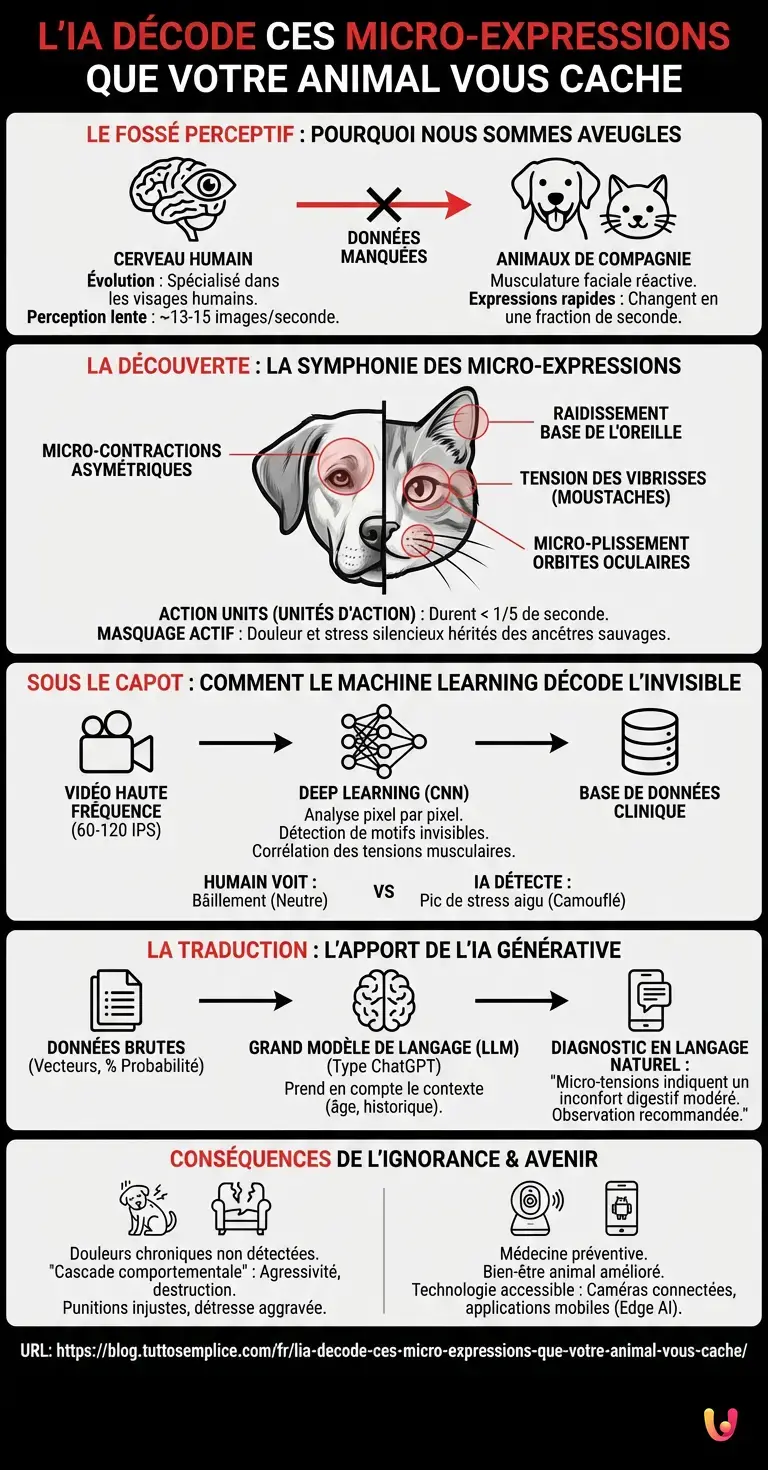

Le fossé perceptif : Pourquoi notre cerveau est aveugle

L’évolution a façonné le cerveau humain pour exceller dans la reconnaissance des visages de ses semblables. Notre cortex visuel est une machine redoutable pour identifier un sourire subtil, un froncement de sourcils ou une moue dubitative chez un autre être humain. Cependant, cette spécialisation a un coût : nous sommes neurologiquement inadaptés pour lire les expressions faciales des autres espèces avec le même niveau de granularité.

De plus, la fréquence de rafraîchissement de notre perception visuelle (environ 13 à 15 images par seconde pour le traitement conscient des expressions) est trop lente. Les animaux de compagnie, en particulier les prédateurs domestiqués comme les chats et les chiens, possèdent une musculature faciale extrêmement réactive. Leurs expressions peuvent changer en une fraction de seconde. Lorsque vous regardez votre chat qui semble simplement fixer le vide, votre cerveau lisse l’image pour créer une perception continue. Vous manquez ainsi une quantité phénoménale de données biométriques qui s’affichent et disparaissent en quelques millisecondes.

Le détail troublant révélé : La symphonie des micro-expressions

Quel est donc ce détail troublant que la machine a mis en évidence ? Il s’agit des micro-expressions faciales asymétriques liées à la douleur et au stress silencieux. La découverte est vertigineuse : nos animaux de compagnie passent une grande partie de leur temps à masquer activement leur vulnérabilité, un héritage direct de leurs ancêtres sauvages pour qui montrer la douleur signifiait devenir une proie.

Cependant, ce masquage n’est pas parfait. Il se traduit par des micro-contractions involontaires et asymétriques de muscles faciaux très spécifiques. Un léger raidissement de la base de l’oreille gauche, une tension imperceptible des vibrisses (moustaches) d’un seul côté du museau, ou un micro-plissement autour des orbites oculaires. Ces mouvements, appelés Action Units (Unités d’Action) dans le jargon scientifique, durent moins d’un cinquième de seconde. Pour un œil humain, l’animal semble parfaitement détendu ou neutre. C’est ce décalage qui est troublant : un chien ou un chat peut être en train de hurler de douleur ou d’anxiété à travers son visage, tout en restant parfaitement silencieux et immobile, et son propriétaire n’y verra que du feu.

Sous le capot : Comment le Machine Learning décode l’invisible

Pour percer ce mystère, les chercheurs ne pouvaient pas se contenter d’une simple observation vidéo. Ils ont dû faire appel au machine learning, et plus spécifiquement au deep learning (apprentissage profond). L’architecture technique repose sur des Réseaux de Neurones Convolutifs (CNN), des algorithmes conçus pour analyser des images pixel par pixel et en extraire des motifs invisibles à l’œil nu.

Comment ça marche concrètement ? Le processus commence par l’ingestion de milliers d’heures de vidéos d’animaux dans des contextes cliniques vérifiés (animaux sains, animaux souffrant de pathologies spécifiques, animaux en situation de stress). Le modèle de deep learning applique ensuite des filtres mathématiques sur chaque image. Les premières couches du réseau neuronal détectent des éléments simples : les contours, les contrastes, les ombres. Les couches plus profondes assemblent ces éléments pour identifier des formes complexes : la courbure exacte d’une moustache, l’angle millimétrique d’une paupière.

La véritable magie de l’AI (Artificial Intelligence) opère lors de la phase d’inférence. La machine ne se fatigue jamais et ne cligne pas des yeux. Elle analyse le flux vidéo à 60, voire 120 images par seconde. Elle est capable de corréler la tension simultanée du muscle abaisseur de l’oreille et du muscle releveur de la lèvre supérieure, de calculer la durée exacte de cette contraction, et de la comparer à des millions d’autres occurrences dans sa base de données. Là où l’humain voit un chat qui baille, l’algorithme détecte un pic de stress aigu camouflé par un comportement de substitution.

La traduction du signal : L’apport de l’IA générative

Identifier une micro-expression est une prouesse technique, mais restituer cette information de manière compréhensible pour le grand public en est une autre. C’est ici qu’intervient la synergie avec l’IA générative. Les données brutes issues des modèles de vision par ordinateur se présentent sous forme de vecteurs mathématiques et de pourcentages de probabilité (ex: Action Unit 27 détectée avec 94% de confiance).

Pour combler le fossé entre la donnée clinique et le propriétaire de l’animal, les développeurs intègrent désormais de grands modèles de langage (LLM). En utilisant des architectures similaires à celles qui propulsent ChatGPT, le système traduit ces matrices de données en un diagnostic comportemental en langage naturel. L’algorithme génératif prend en compte le contexte (l’âge de l’animal, l’heure de la journée, l’historique médical) et formule une explication claire. Au lieu d’afficher un graphique incompréhensible, l’application sur le smartphone du propriétaire expliquera : “Au cours des 10 dernières minutes, les micro-tensions autour du museau de votre chien indiquent un inconfort digestif modéré. Ce n’est pas une urgence, mais une observation attentive est recommandée.”

Que se passe-t-il si nous ignorons ces signaux ?

La capacité de l’intelligence artificielle à lire ces détails troublants soulève une question fondamentale : quelles sont les conséquences de notre ignorance passée ? Pendant des siècles, des millions d’animaux ont souffert de douleurs chroniques (arthrose précoce, douleurs dentaires, troubles gastro-intestinaux) sans que leurs propriétaires, pourtant aimants, ne s’en aperçoivent.

Ignorer ces micro-signaux conduit souvent à ce que les vétérinaires appellent la “cascade comportementale”. Un animal qui souffre en silence et dont les signaux de détresse faciale ne sont pas reçus finira par modifier son comportement macroscopique. Le chat deviendra soudainement agressif lors du brossage, ou le chien commencera à détruire le mobilier. Souvent, ces comportements sont interprétés à tort comme des problèmes d’éducation ou de la “jalousie”, entraînant des punitions qui ne font qu’aggraver la détresse psychologique de l’animal. Le décodage de ces micro-expressions par la machine offre donc une opportunité sans précédent de faire de la médecine préventive et d’améliorer radicalement le bien-être animal.

De l’algorithme au salon : L’avenir de la communication inter-espèces

Aujourd’hui, cette technologie sort des laboratoires de recherche vétérinaire pour s’inviter dans nos salons. Des caméras connectées dotées de puces d’intelligence artificielle embarquées (Edge AI) commencent à faire leur apparition sur le marché. Elles surveillent l’animal pendant l’absence de ses maîtres, analysant en temps réel ses micro-expressions pour dresser un bilan émotionnel et physique de la journée.

Le secret derrière cette démocratisation réside dans l’optimisation des algorithmes. Il y a encore quelques années, faire tourner un modèle de vision par ordinateur capable de détecter des micro-mouvements nécessitait des serveurs surpuissants. Aujourd’hui, grâce à la miniaturisation et à l’efficacité accrue du code, un simple smartphone dirigé vers le visage de votre animal peut effectuer cette analyse complexe en quelques secondes.

En Bref (TL;DR)

Notre cerveau humain est biologiquement incapable de percevoir les expressions faciales ultra-rapides et complexes émises quotidiennement par nos animaux de compagnie.

L’intelligence artificielle révèle que nos animaux masquent leur vulnérabilité et leur douleur par des micro-expressions asymétriques invisibles à l’œil nu.

La vision par ordinateur et l’apprentissage profond analysent désormais ces vidéos pixel par pixel pour traduire ce langage inter-espèces inédit.

Conclusion

Le décodage des micro-expressions animales par l’intelligence artificielle marque un tournant décisif dans notre relation avec le monde vivant. Ce détail troublant — le fait que nos compagnons nous parlent en permanence de leurs douleurs et de leurs peurs à travers des frémissements musculaires invisibles à nos yeux — nous rappelle les limites de notre propre biologie. Loin de déshumaniser notre relation avec nos animaux de compagnie, la technologie agit ici comme une prothèse d’empathie. En traduisant l’invisible, la machine nous offre le plus beau des cadeaux : la possibilité de comprendre enfin, avec une précision scientifique, les besoins silencieux de ceux qui partagent notre vie.

Questions fréquemment posées

Notre cerveau est biologiquement programmé pour décoder les visages humains et notre perception visuelle reste trop lente. Les chiens et les chats possèdent une musculature faciale très réactive dont les expressions changent en une fraction de seconde, rendant ces signaux totalement invisibles à notre oeil nu.

Les algorithmes analysent des micro-contractions musculaires asymétriques et involontaires qui durent une fraction de seconde. Ces mouvements infimes, comme le raidissement au niveau de la base auriculaire ou la tension des moustaches, révèlent souvent un état de stress silencieux ou une douleur que votre compagnon tente de cacher.

Le système utilise le deep learning pour analyser des vidéos à haute fréquence et repérer les anomalies musculaires. Ensuite, une intelligence artificielle générative traduit ces données mathématiques complexes en un diagnostic comportemental simple et compréhensible directement sur le smartphone du propriétaire.

Un animal qui souffre en silence finira par développer des troubles du comportement comme une agressivité soudaine ou la destruction du mobilier. Ces réactions sont souvent mal interprétées comme des problèmes de dressage, ce qui peut entraîner des punitions injustes et aggraver la détresse psychologique du chien ou du chat.

Cette technologie sort déjà des laboratoires pour arriver dans nos foyers grâce aux caméras connectées et aux applications mobiles. La miniaturisation des algorithmes permet désormais aux smartphones de traiter les expressions de votre compagnon en temps réel pour évaluer son bien-être physique et émotionnel.

Encore des doutes sur L’IA décode ces micro-expressions que votre animal vous cache?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Sources et Approfondissements

- Vision par ordinateur : principes et fonctionnement (Wikipédia)

- Facial Action Coding System (FACS) et Unités d’Action (Wikipedia)

- Échelles de grimace (Grimace scale) : évaluation de la douleur par les expressions faciales animales (Wikipedia)

- Éthologie : l’étude scientifique du comportement animal (Wikipédia)

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.