Nous sommes le 23 février 2026, et la frontière entre la biologie et le numérique n’a jamais été aussi ténue. Imaginez une photographie. Non pas prise avec un objectif, ni générée par une commande textuelle, mais extraite brute, directement depuis les impulsions électriques de votre cortex visuel. Ce qui relevait de la science-fiction il y a encore quelques années est devenu une réalité technique fascinante grâce à l’intégration de modèles comme Stable Diffusion dans le domaine des neurosciences. C’est ici, dans cette convergence entre l’imagerie médicale et l’intelligence artificielle générative, que réside l’une des prouesses les plus troublantes de notre époque : la capacité de la machine à « voir » ce que vous voyez, sans jamais passer par vos yeux.

Le signal BOLD : L’écho bruyant de la pensée

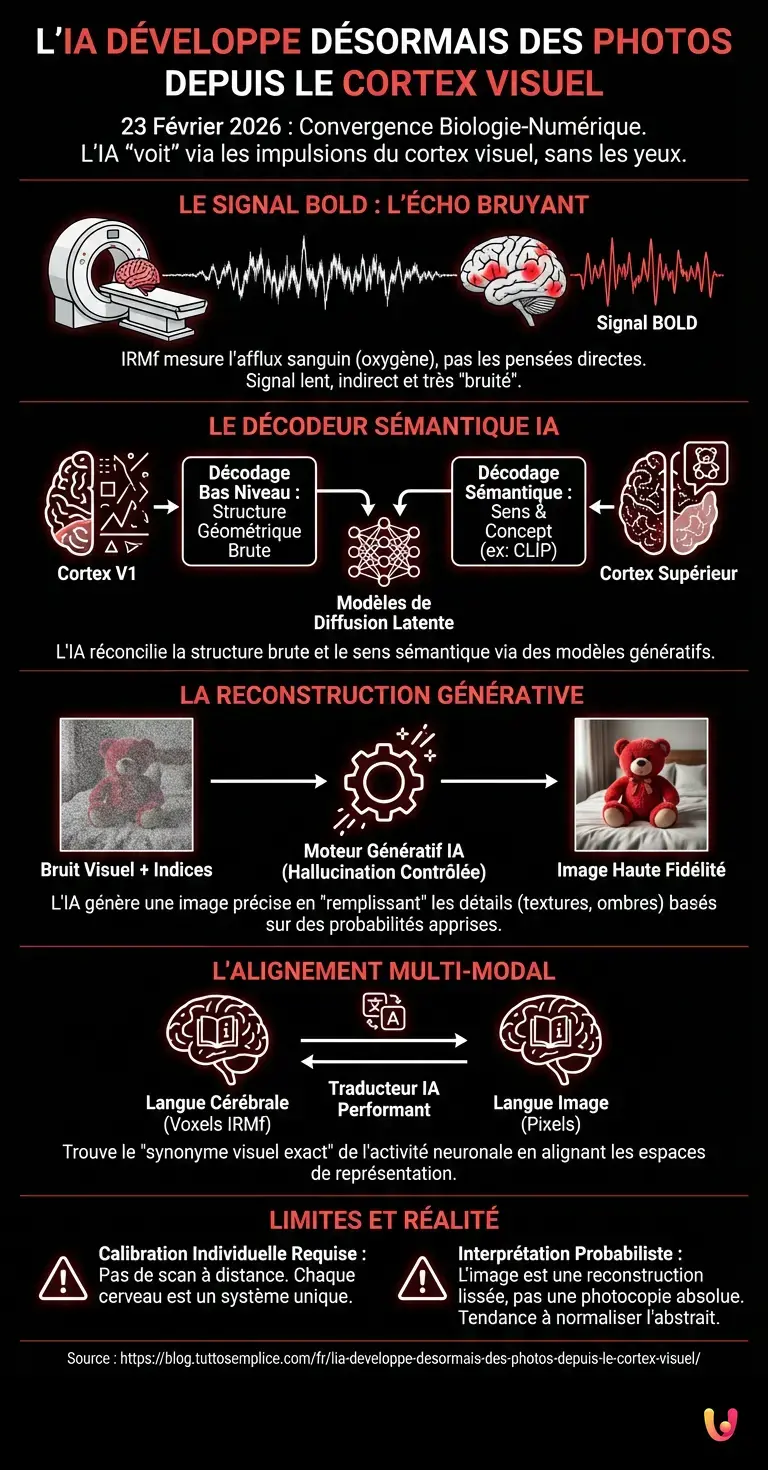

Pour comprendre comment une IA peut peindre vos pensées, il faut d’abord comprendre la nature des données qu’elle ingère. Contrairement à une caméra qui capture des photons, le processus commence par une IRMf (Imagerie par Résonance Magnétique fonctionnelle). Cette machine ne lit pas les pensées ; elle mesure le signal BOLD (Blood-Oxygen-Level Dependent).

Lorsque vous regardez une image – disons, un ours en peluche rouge – vos neurones consomment de l’oxygène. L’IRMf cartographie cet afflux sanguin dans votre cerveau. Le problème ? Ce signal est extrêmement « bruité », lent et indirect. C’est un peu comme essayer de deviner la mélodie jouée par un orchestre en écoutant uniquement les vibrations du sol à l’extérieur de la salle de concert. Jusqu’à l’avènement du deep learning avancé, les scientifiques ne pouvaient reconstruire que des formes floues, des taches indistinctes qui ressemblaient vaguement à l’objet observé.

Le décodeur sémantique : Quand l’IA comble les vides

Le secret de l’image « exacte » réside dans un changement de paradigme technique. Au lieu d’essayer de traduire pixel par pixel l’activité cérébrale (une tâche impossible vu la faible résolution de l’IRMf), les chercheurs ont utilisé des modèles de diffusion latente, la technologie derrière les générateurs d’art modernes.

Le processus se divise en deux flux distincts que l’algorithme doit réconcilier :

- Le décodage de bas niveau : L’IA analyse l’activité dans le cortex visuel primaire (V1). Cette zone traite les lignes, les orientations et les contrastes. L’IA en extrait la structure géométrique brute de l’image.

- Le décodage sémantique (Haut niveau) : C’est ici que la magie du machine learning opère. L’IA analyse les zones supérieures du cortex visuel (comme le cortex occipital latéral) qui ne traitent pas les pixels, mais le sens. Elle ne voit pas « du rouge et des courbes », elle comprend le concept « ours en peluche ».

En utilisant des modèles entraînés sur des millions d’images et leurs descriptions textuelles (comme le système CLIP d’OpenAI), l’IA fait correspondre l’activité cérébrale à des vecteurs mathématiques dans un espace latent. Elle ne « devine » pas l’image ; elle traduit une signature biologique en une représentation vectorielle.

La reconstruction : Du bruit au chef-d’œuvre

Une fois que l’IA dispose de ces deux informations (la structure approximative et le sens sémantique), elle active son moteur génératif. C’est là que la différence avec les méthodes classiques est flagrante. L’IA ne se contente pas de coller les morceaux ; elle hallucine de manière contrôlée l’image finale en se basant sur les probabilités apprises.

Si votre cerveau émet le signal du concept « tour d’horloge » avec une structure verticale, l’IA va générer une image de Big Ben ou d’une tour similaire avec une fidélité photographique. Ce qui est stupéfiant, c’est que l’image résultante possède les mêmes textures, les mêmes ombres et la même perspective que l’image que vous aviez sous les yeux. L’IA a utilisé sa connaissance encyclopédique du monde visuel pour « remplir » les détails que l’IRMf n’avait pas pu capturer.

Pourquoi l’image est-elle si « exacte » ?

La curiosité principale réside dans cette précision troublante. Comment l’IA peut-elle savoir que l’ours était rouge et non bleu ? La réponse technique réside dans l’alignement multi-modal. Les modèles de deep learning actuels ont appris à aligner l’espace des représentations cérébrales avec l’espace des représentations d’images.

Imaginez deux dictionnaires : l’un en « langue cérébrale » (voxels d’IRMf) et l’autre en « langue image » (pixels). L’IA a construit un traducteur si performant qu’elle peut trouver le synonyme visuel exact de votre activité neuronale. Si l’image reconstruite est si fidèle, c’est parce que le modèle ne part pas de zéro : il part d’un bruit visuel qu’il « dé-bruite » progressivement en se guidant sur les indices sémantiques extraits de votre cerveau. C’est une forme de télépathie assistée par ordinateur.

Les limites et le mythe de la lecture de pensée universelle

Il est crucial, en tant que vulgarisateur technique, de poser les limites de cette technologie en 2026. Non, ChatGPT ou ses successeurs ne peuvent pas scanner votre cerveau à distance. Cette prouesse technique nécessite une calibration individuelle. L’IA doit d’abord apprendre comment votre cerveau spécifique encode le concept de « chien » ou de « voiture ». Chaque cerveau est un système de cryptage unique.

De plus, l’IA générative a tendance à lisser la réalité. Si vous regardez une image très étrange ou abstraite que le modèle n’a jamais rencontrée lors de son entraînement, il tentera de la « normaliser » pour qu’elle ressemble à quelque chose de connu. L’image extraite est donc une interprétation probabiliste de votre perception, et non une photocopie neuronale absolue.

En Bref (TL;DR)

L’intelligence artificielle générative réussit désormais à reconstruire des images photographiques directement extraites de l’activité neuronale du cortex visuel humain.

Les chercheurs couplent l’imagerie IRMf avec des modèles de diffusion pour convertir les signaux cérébraux complexes en scènes visuelles d’une précision stupéfiante.

Cette prouesse technique repose sur un décodage sémantique avancé capable de traduire des impulsions biologiques en chefs-d’œuvre numériques fidèles à la réalité.

Conclusion

L’image exacte extraite d’un cerveau sans passer par les yeux n’est pas de la magie, mais le triomphe de la statistique et de la modélisation sémantique. En couplant la puissance de résolution des modèles de diffusion avec les données bruitées de l’imagerie cérébrale, nous avons ouvert une fenêtre sur l’expérience subjective. Ce n’est pas seulement l’image que l’IA récupère, c’est le sens que votre cerveau lui a donné. Alors que nous avançons dans cette ère de transparence neurale, la question n’est plus de savoir si la machine peut voir nos pensées, mais ce que nous ferons de cette intimité dévoilée.

Questions fréquemment posées

L IA utilise une combinaison d imagerie par résonance magnétique fonctionnelle et de modèles de diffusion latente pour interpréter l activité neuronale. Elle analyse le signal BOLD pour extraire la structure géométrique brute et le sens sémantique, puis génère une image haute fidélité en comblant les lacunes grâce à ses probabilités apprises.

Non, cette technologie ne permet pas de scanner un cerveau a distance ou a l insu de la personne. Le processus nécessite une machine IRMf volumineuse et surtout une calibration individuelle poussée, car chaque cerveau encode les concepts comme chien ou voiture de manière unique.

L IA fonctionne sur un principe probabiliste et non comme une photocopieuse neuronale. Si le signal cérébral est flou ou l image observée trop abstraite, le modèle tend a normaliser le résultat en se basant sur sa connaissance encyclopédique pour créer une image cohérente qui ressemble a ce qu il connait deja.

Le signal BOLD mesure l afflux sanguin et la consommation d oxygène par les neurones lorsque vous regardez un objet. Bien que ce signal soit bruité et lent, il sert de donnée brute que l IA nettoie et traduit en vecteurs mathématiques pour comprendre a la fois les formes et le concept sémantique de l image perçue.

Cette technique consiste a faire correspondre l espace des représentations cérébrales avec celui des images numériques. L IA agit comme un traducteur ultra performant capable de trouver le synonyme visuel exact de votre activité neuronale, permettant de passer du bruit biologique a une image claire et texturée.

Encore des doutes sur L’IA développe désormais des photos depuis le cortex visuel?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Sources et Approfondissements

- Article Wikipédia sur l’Imagerie par Résonance Magnétique fonctionnelle (IRMf) et le signal BOLD

- Article Wikipédia sur le fonctionnement du modèle d’IA générative Stable Diffusion

- Ressource officielle du NIH (National Institutes of Health) sur la technologie IRM

- Cadre de l’UNESCO sur l’éthique des neurotechnologies et la confidentialité mentale

- Article Wikipédia détaillant le décodage neuronal et la reconstruction d’images

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.