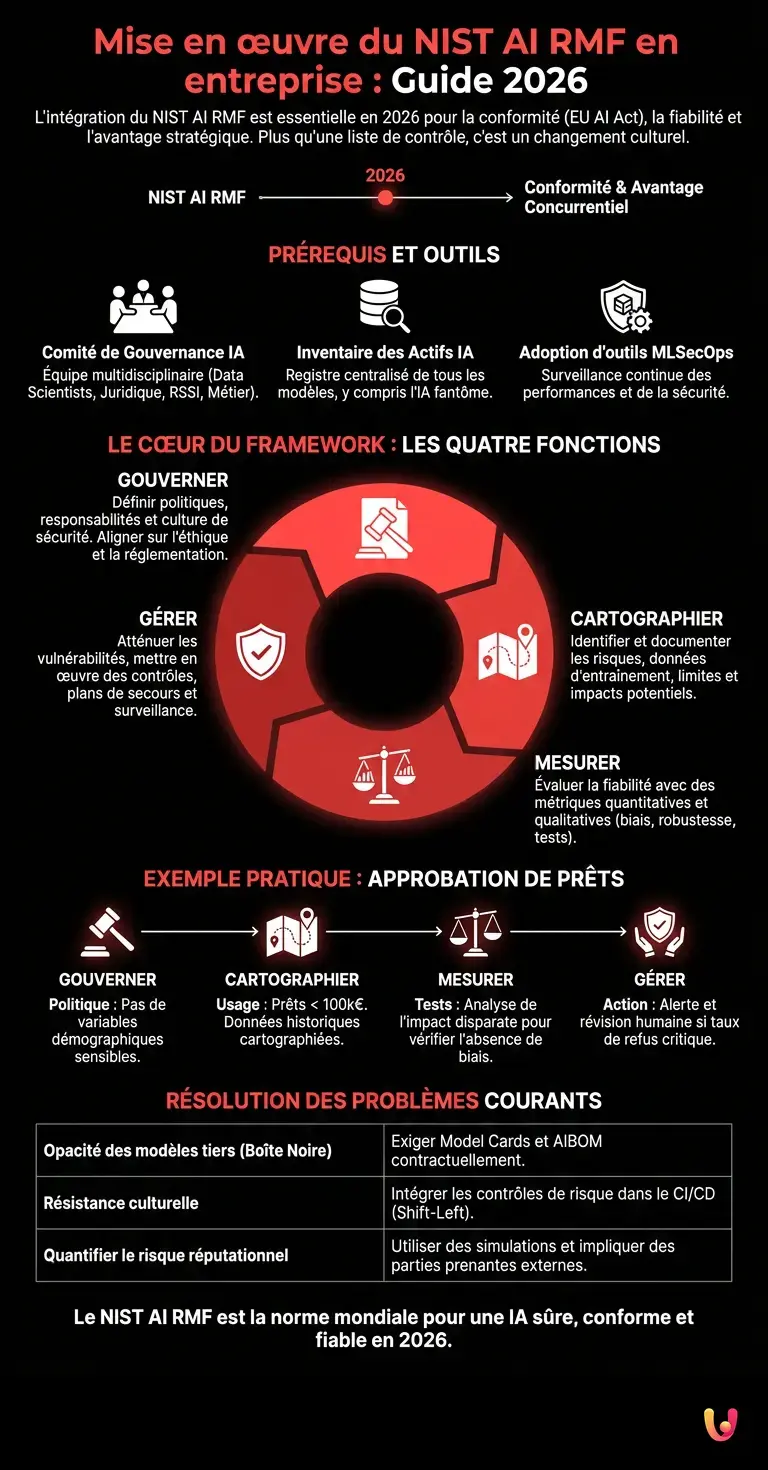

L’intégration du NIST AI RMF (Artificial Intelligence Risk Management Framework) constitue aujourd’hui le pilier fondamental pour toute organisation souhaitant développer, acquérir ou intégrer des systèmes d’intelligence artificielle. Dans le contexte technologique de 2026, marqué par la pleine opérationnalité de l’EU AI Act et la prolifération de modèles génératifs complexes , la gestion des risques n’est plus une option, mais un impératif stratégique. Ce guide technique fournit un parcours structuré pour adopter le cadre, transformant la conformité réglementaire en un avantage concurrentiel tangible grâce à une solide gouvernance de l’IA .

Introduction à la gestion des risques de l’IA

L’adoption du NIST AI RMF représente la norme mondiale en 2026 pour gouverner l’intelligence artificielle de manière sûre. Ce cadre permet aux entreprises de cartographier, de mesurer et de gérer les risques liés à l’IA, garantissant ainsi la conformité réglementaire et la fiabilité des systèmes technologiques.

Selon la documentation officielle du National Institute of Standards and Technology (NIST), le cadre est conçu pour être indépendant du secteur et évolutif. Il ne s’agit pas d’une simple liste de contrôle de sécurité, mais d’un changement culturel impliquant toute la structure de l’entreprise, du conseil d’administration aux développeurs de machine learning. En 2026, l’alignement entre le NIST RMF traditionnel et les spécificités de l’intelligence artificielle nécessite une compréhension approfondie de concepts tels que l’interprétabilité des modèles, la confidentialité des données d’entraînement et l’atténuation des biais algorithmiques.

Prérequis et outils pour la conformité

Avant de mettre en œuvre le NIST AI RMF , il est essentiel d’établir une gouvernance d’entreprise solide en matière d’IA. Les prérequis incluent la formation d’un comité d’éthique multidisciplinaire, l’adoption d’un logiciel d’audit algorithmique et la cartographie de l’infrastructure de données existante.

Pour lancer le processus avec succès, les organisations doivent se doter d’un écosystème d’outils et de compétences appropriés. L’approche « Zero-to-Hero » nécessite de préparer le terrain au sein de l’entreprise en suivant les étapes opérationnelles suivantes :

- Constitution du comité de gouvernance de l’IA : une équipe interfonctionnelle composée de scientifiques des données, de conseillers juridiques, de RSSI et de représentants des activités commerciales.

- Inventaire des actifs d’IA : Création d’un registre centralisé (registre d’IA) de tous les modèles utilisés, y compris les services tiers (IA fantôme).

- Adoption d’outils MLSecOps : Intégration de plateformes pour la surveillance continue des performances et de la sécurité des modèles en production.

| Catégorie Instrument | Fonction dans le framework | Exemple d’application 2026 |

|---|---|---|

| Plateformes d’IA TRiSM | Surveillance et confiance | Détection en temps réel de la dérive des données et des biais. |

| Logiciel GRC (Gouvernance, Risque, Conformité) | Gestion des politiques | Alignement automatique entre les politiques internes et les exigences de la loi européenne sur l’IA. |

| Scanner de vulnérabilités LLM | Sécurité technique | Prévention des attaques par injection de prompt et des fuites de données. |

Le cœur du framework : les quatre fonctions

L’architecture du NIST AI RMF repose sur quatre fonctions interconnectées : Gouverner, Cartographier, Mesurer et Gérer. Cette structure circulaire et continue garantit une surveillance constante du cycle de vie de l’intelligence artificielle, réduisant ainsi les biais et les vulnérabilités opérationnelles .

Ces fonctions ne sont pas séquentielles, mais fonctionnent de manière synergique. Leur mise en œuvre exige des méthodologies rigoureuses et une documentation traçable, essentielles pour réussir d’éventuels audits de conformité.

Gouverner : Créer une culture de la sécurité

La fonction « Gouvernance » du NIST AI RMF définit les politiques d’entreprise et les responsabilités légales. Elle constitue le cœur de la gouvernance de l’IA , car elle aligne les stratégies d’intelligence artificielle sur les valeurs éthiques, la tolérance au risque et les réglementations en vigueur.

À ce stade, la direction de l’entreprise doit clairement définir les responsabilités pour chaque système d’IA. Les actions clés incluent la rédaction d’un code d’éthique pour l’IA, la définition des niveaux de risque acceptables (Risk Appetite Statement) et la création de canaux de communication transparents pour signaler les anomalies algorithmiques sans crainte de représailles.

Carte : Identifier les risques des modèles

Grâce à la phase « Map » du NIST AI RMF , les organisations cataloguent chaque système d’IA utilisé. Cette étape nécessite de documenter les données d’entraînement, les limites du modèle et les impacts négatifs potentiels sur les utilisateurs finaux ou sur l’entreprise.

Le mappage est souvent l’étape la plus complexe. Selon les données du secteur, plus de 60 % des entreprises ignorent l’étendue réelle de leur surface d’attaque en matière d’IA. Il est nécessaire de documenter :

- Le contexte d’utilisation prévu (Intended Use) et les utilisations inappropriées prévisibles.

- L’origine et la qualité des jeux de données d’entraînement et de validation.

- La chaîne d’approvisionnement du logiciel (AI Bill of Materials – AIBOM).

Mesure : Évaluer l’impact de l’intelligence artificielle

La phase « Mesure » du cadre de gestion des risques de l’IA (AI RMF) du NIST utilise des métriques quantitatives et qualitatives pour tester la fiabilité des modèles. Elle inclut des tests de résistance, des analyses de biais et des évaluations de robustesse, garantissant que l’IA fonctionne dans les paramètres de sécurité prédéfinis.

Les mesures doivent être objectives et reproductibles. Les équipes techniques doivent mettre en œuvre des métriques d’équité, de précision, d’interprétabilité et de résistance aux attaques adverses (Adversarial Machine Learning). L’utilisation de « red teaming » spécifique à l’IA est devenue une norme de facto en 2026 pour valider la robustesse des modèles génératifs avant leur mise en production.

Gérer : Atténuer les vulnérabilités

La fonction « Manage » du NIST AI RMF fournit des lignes directrices pour répondre aux risques identifiés. Les entreprises mettent en œuvre des contrôles techniques, des plans de secours et une surveillance continue pour désactiver ou corriger les systèmes d’IA en cas d’anomalies.

La gestion active des risques nécessite la création de playbooks de réponse aux incidents liés à l’IA. Si un modèle commence à produire des résultats discriminatoires ou des hallucinations nuisibles , les systèmes de disjoncteurs doivent intervenir automatiquement pour dégrader le service en toute sécurité (dégradation progressive) ou transférer le contrôle à un opérateur humain (Human-in-the-Loop).

Exemples pratiques d’adoption en entreprise

L’application du NIST AI RMF dans des scénarios réels démontre sa polyvalence. Qu’il s’agisse d’un chatbot basé sur un LLM pour le service client ou d’ algorithmes de notation financière , le cadre standardise les processus de validation et de mise en production.

Considérons un établissement bancaire qui implante un nouveau système d’approbation de prêts hypothécaires basé sur l’apprentissage automatique. En utilisant le framework :

- Gouvernance : Le comité stipule que le modèle ne doit pas utiliser de variables démographiques sensibles.

- Carte : Il est documenté que le modèle sera utilisé uniquement pour des prêts inférieurs à 100 000 euros et les données historiques utilisées sont cartographiées.

- Mesure : Des tests statistiques sont effectués pour vérifier l’absence de biais à l’encontre de minorités spécifiques (analyse de l’impact disparate).

- Gestion : une alerte automatique est déclenchée si le taux de refus pour un groupe démographique donné dépasse un seuil critique, activant ainsi une révision humaine.

Résolution des problèmes courants

Lors de l’intégration du NIST AI RMF , les entreprises rencontrent souvent des obstacles tels que le manque de transparence des fournisseurs ou la mauvaise qualité des données. La résolution de ces problèmes nécessite des audits tiers et une mise à jour continue des politiques du NIST RMF .

| Problème rencontré (Dépannage) | Solution stratégique |

|---|---|

| Opacité des modèles tiers (boîte noire) | Exiger contractuellement les Model Cards et les AIBOM des fournisseurs avant l’acquisition. |

| Résistance culturelle des équipes de développement | Intégrer les contrôles de risque directement dans les pipelines CI/CD (Shift-Left Security) afin de ne pas ralentir les mises en production. |

| Difficulté à quantifier le risque réputationnel | Utiliser des cadres de simulation de scénarios et impliquer des parties prenantes externes (par exemple, des associations de consommateurs) dans la phase de mesure. |

En Bref (TL;DR)

L’adoption du NIST AI RMF en 2026 est indispensable pour gérer les risques liés à l’intelligence artificielle et garantir la pleine conformité au règlement européen sur l’IA (EU AI Act).

Pour entamer ce processus, une gouvernance d’entreprise solide est nécessaire, soutenue par un comité d’éthique multidisciplinaire et des outils avancés d’audit algorithmique.

Le cœur du cadre comprend quatre fonctions synergiques essentielles pour gouverner, cartographier, mesurer et gérer en permanence l’ensemble du cycle de vie des modèles.

Conclusions

La mise en œuvre réussie du NIST AI RMF en 2026 ne sera pas seulement une obligation de conformité, mais aussi un avantage concurrentiel. Les entreprises qui maîtrisent la gouvernance de l’IA renforcent la confiance, innovent en toute sécurité et se préparent aux futures évolutions réglementaires.

La gestion des risques dans l’intelligence artificielle est un voyage continu, pas une destination finale. En adoptant les fonctions Gouverner, Cartographier, Mesurer et Gérer, les organisations informatiques peuvent maximiser la valeur des technologies émergentes tout en protégeant leurs utilisateurs, leurs données et leur réputation sur le marché mondial. L’investissement actuel dans des cadres structurés comme celui du NIST représente la meilleure assurance contre les incertitudes technologiques de demain.

Foire aux questions

Le cadre NIST AI RMF représente une norme mondiale pour la gestion des risques liés à l’intelligence artificielle. Ce système permet aux organisations de cartographier, de mesurer et de gouverner les modèles, garantissant ainsi la conformité aux réglementations européennes et améliorant la sécurité technologique globale.

L’architecture repose sur quatre fonctions continues et synergiques appelées Gouverner, Cartographier, Mesurer et Gérer. Ces phases permettent d’établir des politiques éthiques, de cataloguer les systèmes en place, d’évaluer les impacts à l’aide de mesures objectives et d’atténuer les vulnérabilités opérationnelles en temps opportun.

Pour lancer le processus, il est fondamental d’établir une gouvernance d’entreprise solide en créant un comité d’éthique multidisciplinaire. Il est ensuite nécessaire de cartographier l’infrastructure de données existante et d’adopter des outils spécifiques pour le suivi continu des performances et de la sécurité des modèles.

Pour pallier le manque de transparence des fournisseurs externes, le cadre suggère de demander contractuellement une documentation spécifique avant l’acquisition. Des outils tels que les Model Cards et les nomenclatures logicielles s’avèrent essentiels pour comprendre les limites et les données d’entraînement des modèles opaques.

L’adoption de ce cadre standardise les processus de validation et de gestion des risques, facilitant grandement le respect des exigences légales européennes. Grâce à des logiciels de gouvernance dédiés, les entreprises peuvent traduire leurs politiques internes en actions conformes aux directives internationales.

Encore des doutes sur Mise en œuvre du NIST AI RMF en entreprise : Guide 2026?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Sources et Approfondissements

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.