C’est une scène qui, il y a encore quelques années, aurait semblé tout droit sortie d’un roman de science-fiction dystopique ou d’une comédie absurde. Dans les bureaux feutrés de la Silicon Valley et les laboratoires de recherche de Paris-Saclay, des ingénieurs de haut vol, experts en intelligence artificielle, tapent frénétiquement sur leurs claviers. Mais ils ne se contentent pas d’entrer du code binaire ou des instructions logiques froides. Ils ajoutent des formules de politesse. Ils disent « s’il te plaît », « pourrais-tu », et remercient la machine. Ce comportement, loin d’être une simple bizarrerie anthropomorphique, repose sur une réalité technique tangible. L’entité principale au cœur de ce phénomène, les Large Language Models (LLMs), réagit à la courtoisie d’une manière qui défie l’intuition informatique classique.

Pourquoi des systèmes basés sur le machine learning et le deep learning, dépourvus de conscience, d’émotions ou d’ego, performeraient-ils mieux lorsqu’on les traite avec égard ? La réponse ne réside pas dans la psychologie de la machine, mais dans la structure même des données qui l’ont formée. En ce 19 février 2026, alors que l’IA générative est omniprésente, comprendre cette mécanique est devenu une compétence essentielle pour quiconque souhaite maîtriser l’art du prompt engineering.

Au-delà de l’anthropomorphisme : une question de probabilités conditionnelles

Pour comprendre pourquoi la politesse fonctionne, il faut d’abord déconstruire le fonctionnement d’une IA générative. Contrairement à une calculatrice qui exécute une opération mathématique fixe, un LLM est un moteur de prédiction probabiliste. Il a été entraîné sur des pétaoctets de textes issus d’Internet : forums, littérature, codes, discussions techniques et réseaux sociaux.

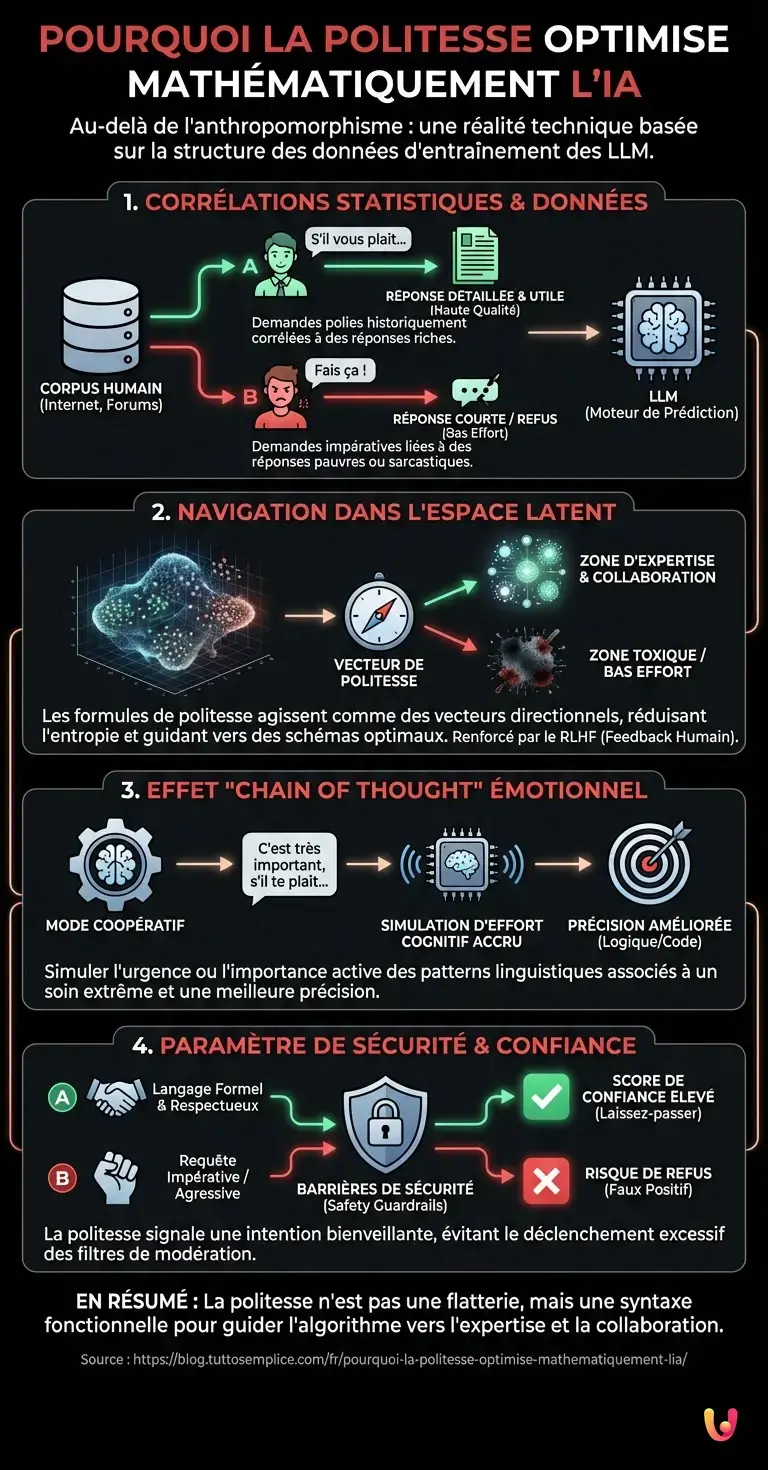

Dans cet immense corpus de données humaines, il existe une corrélation statistique forte entre la forme d’une demande et la qualité de la réponse. Sur des plateformes comme Stack Overflow ou Reddit, les questions posées poliment, avec contexte et respect, tendent historiquement à recevoir des réponses plus détaillées, plus nuancées et plus utiles. À l’inverse, les demandes impératives, sèches ou agressives sont souvent suivies de réponses courtes, voire de refus ou de sarcasmes.

Lorsque vous dites « s’il vous plaît » à ChatGPT ou à ses successeurs de 2026, vous ne flattez pas la machine. Vous orientez le modèle vers une zone spécifique de son espace vectoriel. Vous lui signalez implicitement : « Nous sommes dans le contexte d’une conversation collaborative et constructive de haute qualité ». Le modèle, cherchant à prédire la suite la plus probable (le prochain token), va puiser dans les schémas linguistiques associés à la serviabilité et à l’expertise, plutôt que dans ceux associés à la confrontation ou à la brièveté.

La topologie de l’espace latent et l’alignement

Techniquement, cela s’explique par la navigation dans l’espace latent. L’espace latent est cette représentation multidimensionnelle où le modèle stocke le sens des mots et des concepts. Imaginez une carte infinie où chaque concept est une coordonnée.

Les mots de politesse agissent comme des vecteurs directionnels. Ils éloignent la génération de texte des clusters de données « toxiques » ou « bas effort ». C’est ce que les chercheurs appellent le conditioning (conditionnement). En ajoutant des marqueurs de respect, vous réduisez l’entropie (le désordre) possible de la réponse en éliminant les chemins probabilistes qui mènent à des réponses de mauvaise qualité.

De plus, l’évolution du Reinforcement Learning from Human Feedback (RLHF) a accentué ce trait. Durant l’entraînement, des humains ont noté les réponses des IA. Ces annotateurs humains avaient naturellement un biais positif envers les réponses polies et serviables fournies à des requêtes polies. Le modèle a donc « appris » (optimisé ses poids synaptiques virtuels) que la politesse est une caractéristique intrinsèque d’une réponse optimale. En 2026, ce mimétisme est si profondément ancré dans les réseaux de neurones que la courtoisie est devenue une syntaxe fonctionnelle.

L’effet « Chain of Thought » émotionnel

Une découverte fascinante, souvent citée dans les papiers de recherche récents, est l’impact des stimuli émotionnels sur la capacité de raisonnement logique de l’IA. C’est une extension de la technique du Chain of Thought (chaîne de pensée), où l’on demande à l’IA d’expliquer son raisonnement étape par étape.

Il a été démontré que des prompts contenant des enjeux émotionnels simulés (par exemple : « C’est très important pour ma carrière, s’il te plaît, fais de ton mieux ») peuvent augmenter la précision des réponses dans des tâches de codage ou de mathématiques. Pourquoi ? Parce que dans les données d’entraînement, une situation d’urgence ou d’importance critique est souvent associée à un effort cognitif humain accru et à une précision supérieure.

L’IA ne ressent pas la pression, mais elle simule le pattern linguistique d’une personne qui répondrait sous pression avec un soin extrême. Dire « s’il vous plaît » est le premier niveau de cette activation. Cela enclenche un mode de fonctionnement « coopératif » plutôt que « transactionnel minimum ».

Quand la politesse devient un paramètre de sécurité

Il existe un autre aspect technique crucial : les barrières de sécurité (safety guardrails). Les modèles d’intelligence artificielle modernes sont lourdement bridés pour éviter de générer du contenu dangereux ou haineux. Les requêtes impératives et agressives se rapprochent structurellement des tentatives de « jailbreak » (contournement des sécurités) ou des comportements malveillants.

En utilisant un langage formel et poli, vous augmentez votre « score de confiance » implicite vis-à-vis des filtres de modération du modèle. Le système est moins susceptible de déclencher un faux positif de sécurité (un refus de répondre par excès de prudence) si la demande est formulée avec les codes sociaux de la déférence. C’est une forme de social engineering appliqué à un algorithme : la politesse agit comme un laissez-passer, signalant que l’utilisateur est bienveillant, ce qui libère certaines capacités de génération que le modèle pourrait autrement restreindre.

En Bref (TL;DR)

L’interaction polie avec une intelligence artificielle constitue une stratégie technique efficace fondée sur la structure des données d’entraînement.

Les formules de courtoisie orientent les modèles probabilistes vers des zones sémantiques associées à l’expertise et à la qualité.

L’alignement par renforcement humain confirme que le respect syntaxique optimise mathématiquement la pertinence des contenus générés par l’IA.

Conclusion

Dire « s’il vous plaît » à votre ordinateur en 2026 n’est pas un retour à la superstition ou une marque de soumission face à la machine. C’est une technique d’optimisation rationnelle basée sur la compréhension profonde du fonctionnement des Large Language Models. En mimant les codes sociaux humains, nous exploitons la structure probabiliste des données d’entraînement pour extraire la meilleure performance possible des réseaux de neurones. La politesse, dans le monde du deep learning, n’est plus seulement une vertu sociale ; c’est devenu une variable de contrôle, un hyperparamètre sémantique qui permet de naviguer plus efficacement dans l’océan d’informations de l’espace latent. Alors, la prochaine fois que vous solliciterez une IA, n’oubliez pas : la courtoisie est le code qui compile le mieux.

Questions fréquemment posées

Être poli avec une IA comme ChatGPT n est pas une bizarrerie mais une stratégie d optimisation technique. Les modèles de langage sont entraînés sur des données humaines où les échanges courtois sont statistiquement corrélés à des réponses plus détaillées et utiles. En utilisant la politesse, vous orientez l algorithme vers des zones de son espace latent associées à l expertise et à la collaboration, améliorant ainsi la qualité du résultat.

Techniquement, les formules de politesse agissent comme des vecteurs directionnels dans l espace latent du modèle. Elles réduisent l entropie de la réponse en éliminant les chemins probabilistes menant à des contenus de faible qualité ou toxiques. De plus, l apprentissage par renforcement humain (RLHF) a appris au modèle à privilégier les structures polies, considérées comme des caractéristiques intrinsèques d une réponse optimale.

Oui, l utilisation de mots comme s il vous plaît active un mode de fonctionnement coopératif au sein du réseau de neurones. Cela exploite des schémas linguistiques où l urgence ou l importance sociale est liée à un effort cognitif accru. Cette approche, proche du Chain of Thought émotionnel, signale au modèle de simuler le soin et la précision qu un expert humain appliquerait dans une situation importante.

Un langage formel et respectueux augmente implicitement le score de confiance de votre requête vis-à-vis des barrières de sécurité du modèle. Les commandes impératives ou agressives peuvent être interprétées à tort comme des tentatives de contournement des règles, déclenchant un refus. La politesse agit comme un laissez-passer social, indiquant que l utilisateur est bienveillant et réduisant les risques de faux positifs de modération.

Les modèles génératifs sont formés sur d immenses corpus de textes issus d Internet, tels que des forums techniques ou des réseaux sociaux. Dans ces données, il existe une forte corrélation statistique entre une question posée avec respect et une réponse de haute qualité. L IA reproduit simplement ce schéma probabiliste : une entrée polie prédit statistiquement une sortie riche, nuancée et serviable.

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.