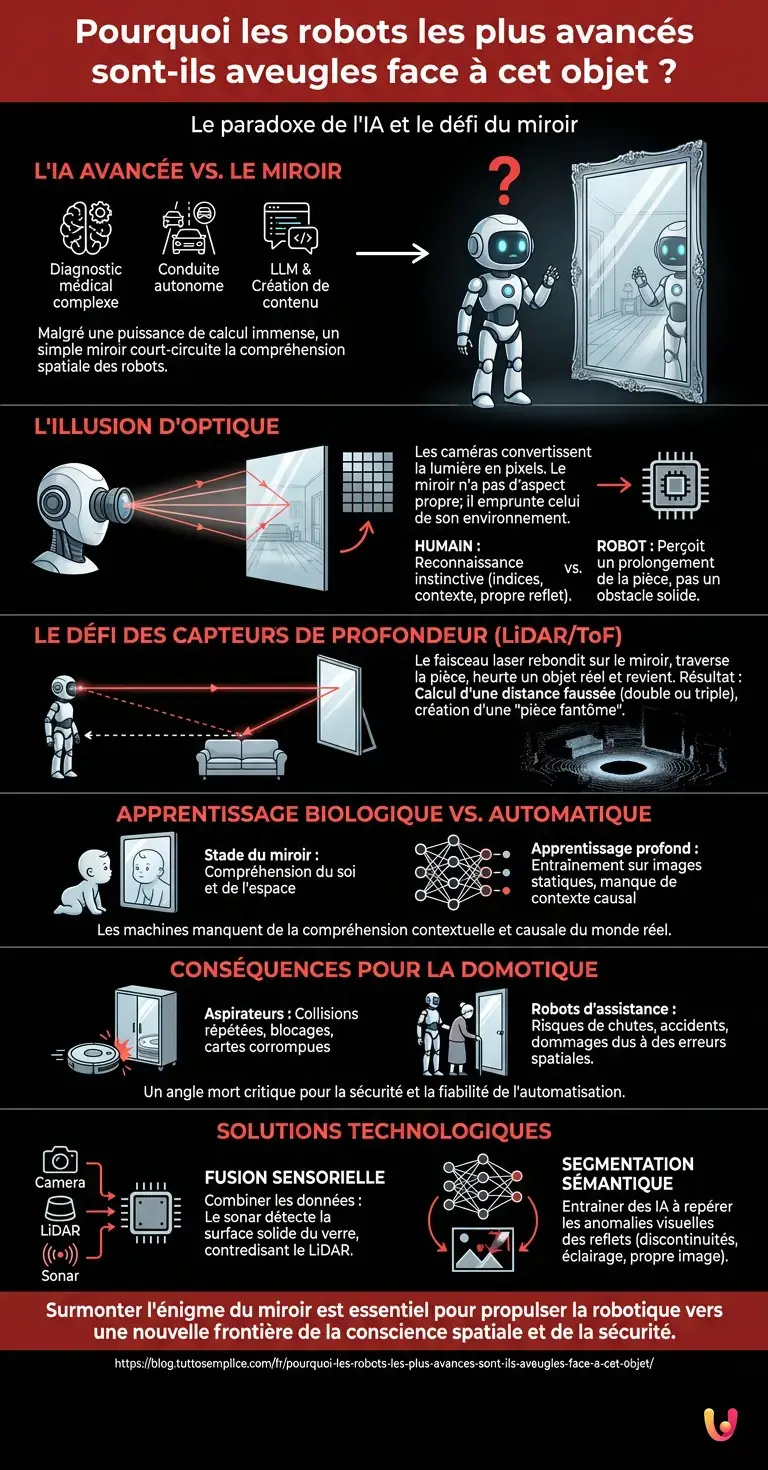

Nous vivons à une époque où l’ intelligence artificielle semble ne plus avoir de frontières. Les systèmes modernes sont capables de diagnostiquer des pathologies complexes en analysant des radiographies en une fraction de seconde, de conduire des automobiles dans la circulation chaotique des métropoles et même de soutenir des conversations philosophiques. Alors qu’un LLM (Large Language Model) tel que ChatGPT peut générer des essais impeccables sur la physique quantique ou rédiger du code informatique avancé, il existe un paradoxe fascinant dans le domaine de la robotique et de la vision artificielle. Si nous transférons cette immense puissance de calcul dans un robot physique et que nous le laissons libre d’explorer une habitation ordinaire, il existe un objet du quotidien, banal et omniprésent, qui court-circuitera sa compréhension de l’espace : le miroir . Ce simple élément de décoration représente aujourd’hui l’un des plus grands angles morts pour les cerveaux synthétiques.

Pour comprendre la portée de cette curiosité technologique, nous devons nous pencher sur la manière dont les machines « voient » et interprètent le monde qui les entoure. Il ne s’agit pas d’un simple défaut de programmation, mais d’une limite intrinsèque liée à la physique de la lumière et à la nature même des modèles actuels d’apprentissage automatique . Résoudre l’énigme du miroir revient à propulser la technologie vers une nouvelle frontière de la conscience spatiale.

L’illusion d’optique qui trompe les machines

Pour un être humain, reconnaître une surface réfléchissante est une action quasi instinctive. Notre cerveau utilise une série d’indices visuels et contextuels : le cadre, les légers reflets à la surface du verre, la position de l’objet (par exemple, au-dessus d’un lavabo) et, surtout, la présence de notre propre image reflétée. Pour une IA , cependant, le processus de vision est radicalement différent. Les caméras d’un robot domestique capturent la lumière et la convertissent en une grille bidimensionnelle de pixels, chacun possédant une valeur numérique correspondant à une couleur.

Lorsque les algorithmes de vision par ordinateur analysent cette grille, ils recherchent des motifs, des contours et des textures pour identifier les objets. Le problème fondamental du miroir est qu’il ne possède pas d’aspect visuel propre : sa nature consiste à emprunter l’apparence de l’environnement qui l’entoure. Par conséquent, lorsqu’un robot regarde une armoire à glace, ses capteurs optiques ne détectent pas un obstacle solide, mais perçoivent un prolongement de la pièce. Ils voient un autre sol, d’autres murs et d’autres meubles. L’illusion d’optique est parfaite : la machine est convaincue qu’il existe un espace ouvert et navigable là où, en réalité, se trouve une barrière de verre et d’argent.

Architecture neuronale et le défi de la profondeur

On pourrait penser que le problème se limite aux seules caméras traditionnelles et que les capteurs de profondeur avancés peuvent aisément contourner cet obstacle. Malheureusement, la réalité physique vient encore compliquer les choses. De nombreux systèmes de navigation autonome s’appuient sur le LiDAR (Light Detection and Ranging) ou sur des capteurs ToF (Time of Flight). Ces dispositifs émettent des impulsions de lumière laser ou infrarouge et mesurent le temps qu’elles mettent à rebondir sur les objets et à revenir, calculant ainsi la distance avec une extrême précision.

Toutefois, l’ architecture neuronale qui traite ces données se heurte aux lois de l’optique. Lorsque le faisceau laser d’un LiDAR frappe un miroir, il ne rebondit pas sur la surface pour revenir vers le capteur. Au contraire, il est réfléchi selon l’angle d’incidence, traverse la pièce, heurte un objet réel (tel qu’un canapé situé derrière le robot), rebondit à nouveau sur le miroir et finit par revenir au capteur. Le résultat ? Le robot calcule une distance double ou triple par rapport à la distance réelle. Dans le « nuage de points » tridimensionnel généré par le cerveau synthétique, le miroir disparaît complètement, remplacé par un trou noir ou par une pièce fantôme qui s’étend au-delà du mur. Ce phénomène crée une dissonance cognitive pour la machine : les capteurs tactiles ou les pare-chocs signalent une collision, mais la carte numérique insiste sur le fait que la voie est libre.

Pourquoi l’apprentissage automatique échoue-t-il là où un enfant excelle ?

La difficulté des machines à gérer les reflets met en évidence un fossé abyssal entre l’apprentissage biologique et l’ apprentissage automatique . En psychologie du développement humain, il existe une phase cruciale connue sous le nom de « stade du miroir », théorisée par le psychanalyste Jacques Lacan. Vers l’âge de 18 mois, l’enfant apprend à reconnaître que l’image reflétée n’est pas un autre enfant, mais lui-même. Cette révélation exige une compréhension complexe du soi, de l’espace et de la physique fondamentale.

Les systèmes d’ apprentissage profond actuels, aussi sophistiqués soient-ils, manquent de cette compréhension causale et contextuelle du monde . Ils sont entraînés sur des millions d’images statiques, apprenant à associer certains motifs de pixels à des étiquettes spécifiques (par ex. « chat », « chaise », « porte »). Si l’ensemble de données d’entraînement ne comprend pas une quantité massive d’exemples spécifiques de miroirs dans toutes les conditions d’éclairage et d’angle possibles, le réseau de neurones ne développera jamais le concept abstrait de « surface réfléchissante ». La machine ignore qu’elle existe, elle ne sait pas à quoi elle ressemble et, par conséquent, elle ne peut utiliser sa propre image reflétée comme indice pour déduire la présence d’un miroir.

Les conséquences pour la domotique

Cet angle mort ne constitue pas seulement une curiosité académique, mais a des répercussions pratiques immédiates dans le domaine de l’ automatisation . Les robots aspirateurs haut de gamme, qui cartographient nos intérieurs avec une précision millimétrique, se comportent souvent de manière anormale en présence de miroirs toute hauteur ou de portes-fenêtres très réfléchissantes. Ils peuvent tenter à maintes reprises de traverser la vitre, se retrouver bloqués dans des boucles infinies en essayant de nettoyer une « pièce » inexistante, ou encore corrompre la carte numérique de l’habitation en superposant la géométrie réelle à la géométrie réfléchie.

Pour l’industrie de la robotique, surmonter cet obstacle est devenu une véritable référence . Il ne s’agit pas seulement d’éviter qu’un aspirateur ne se raye, mais de garantir la sécurité des futurs robots d’assistance. Imaginez un robot humanoïde conçu pour assister les personnes âgées ou en situation de handicap : une erreur de calcul spatial provoquée par un reflet pourrait entraîner des chutes, des accidents ou des dommages sur des objets fragiles. La capacité à identifier de manière fiable les surfaces transparentes et réfléchissantes est devenue un indicateur fondamental pour évaluer la fiabilité des nouveaux systèmes de navigation autonome.

Au-delà du reflet : les solutions du progrès technologique

Comment les ingénieurs et les chercheurs abordent-ils ce problème ? Le progrès technologique favorise l’émergence de solutions multimodales, qui ne reposent pas sur un seul type de capteur. L’une des stratégies les plus prometteuses est la fusion sensorielle (*sensor fusion*). En combinant les données visuelles des caméras, les mesures du LiDAR et, surtout, les capteurs à ultrasons (sonars), les robots sont en mesure de croiser les informations. Alors que la lumière traverse le verre ou s’y réfléchit, les ondes sonores rebondissent sur la surface solide. Si le LiDAR indique un « espace libre » mais que le sonar signale un « obstacle à 10 centimètres », l’algorithme apprend à déduire la présence d’un miroir ou d’une vitre.

Par ailleurs, les chercheurs développent des réseaux de neurones spécialisés dans la « segmentation sémantique des surfaces réfléchissantes ». Au lieu de rechercher uniquement des objets solides, ces réseaux sont entraînés à repérer les anomalies visuelles caractéristiques des miroirs : discontinuités dans les bords du sol, différences d’éclairage entre le reflet et l’environnement réel, ainsi que la présence du robot lui-même dans l’image. L’objectif est d’apprendre aux machines non seulement à observer, mais aussi à déduire le contexte, en les dotant d’une sorte de « bon sens spatial » artificiel.

En Bref (TL;DR)

Malgré l’incroyable puissance de l’intelligence artificielle moderne, les robots les plus avancés ne parviennent pas à reconnaître un objet domestique courant tel que le miroir.

Les caméras et les capteurs laser interprètent les surfaces réfléchissantes comme des extensions navigables de l’espace, créant ainsi de dangereuses illusions d’optique et des cartographies tridimensionnelles totalement erronées.

Cet obstacle met en évidence une lacune profonde de l’apprentissage automatique, qui reconnaît les motifs visuels mais est dépourvu de la conscience spatiale des êtres humains.

Conclusions

Le miroir constitue une métaphore parfaite de l’état actuel de l’intelligence artificielle. Il nous rappelle que, malgré les progrès extraordinaires réalisés dans le traitement du langage naturel et le calcul abstrait, l’interaction physique avec le monde réel et chaotique demeure un défi redoutable. Les machines peuvent calculer les orbites des planètes ou simuler le repliement des protéines, mais elles trébuchent face à une illusion d’optique qu’un enfant de deux ans sait déjouer. Résoudre le problème de l’angle mort domestique ne signifie pas seulement améliorer nos appareils électroménagers, mais franchir une étape fondamentale vers la création de cerveaux synthétiques dotés d’une véritable conscience spatiale. Jusqu’à ce moment-là, le miroir continuera de refléter non seulement nos pièces, mais aussi les limites fascinantes de la technologie que nous cherchons à créer.

Questions fréquentes

Les robots aspirateurs peinent à reconnaître les surfaces réfléchissantes, car leurs capteurs optiques et laser sont induits en erreur. Au lieu de détecter un obstacle solide, les caméras perçoivent le reflet de la pièce comme un espace ouvert, ce qui amène l’appareil à tenter de traverser la vitre.

Lorsque le faisceau laser d’un système de navigation frappe une surface réfléchissante, il ne revient pas directement en arrière, mais rebondit vers d’autres objets dans la pièce. Cette erreur de mesure laisse croire à la machine qu’il existe un espace vide beaucoup plus profond, créant ainsi des pièces inexistantes sur sa carte numérique.

Les ingénieurs adoptent la fusion sensorielle, une technique qui combine caméras, lasers et capteurs à ultrasons. Comme les ondes sonores rebondissent sur le verre, contrairement à la lumière, le système croise les données pour détecter la présence d’un obstacle et corriger le défaut visuel.

Un être humain fait appel à son intuition et au contexte pour comprendre qu’il se trouve face à une surface réfléchissante, en reconnaissant sa propre image. Les systèmes artificiels analysent uniquement des motifs de pixels et, sans un entraînement spécifique à ces anomalies visuelles, ne parviennent pas à appréhender le concept de reflet.

L’incapacité à cartographier correctement les surfaces réfléchissantes constitue un grave problème de sécurité pour les robots d’assistance. Une erreur de calcul spatial pourrait entraîner des collisions, des chutes ou des dommages aux objets fragiles, rendant ainsi indispensable le développement d’une conscience spatiale avancée.

Sources et Approfondissements

- Vision par ordinateur et analyse d’images (Wikipédia)

- Technologie LiDAR et ses principes physiques de réflexion (Wikipédia)

- What is LIDAR? (National Oceanic and Atmospheric Administration – USA.gov)

- Fonctionnement des capteurs temps de vol (ToF) (Wikipédia)

- Cartographie et localisation simultanées (SLAM) pour la navigation robotique (Wikipédia)

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.