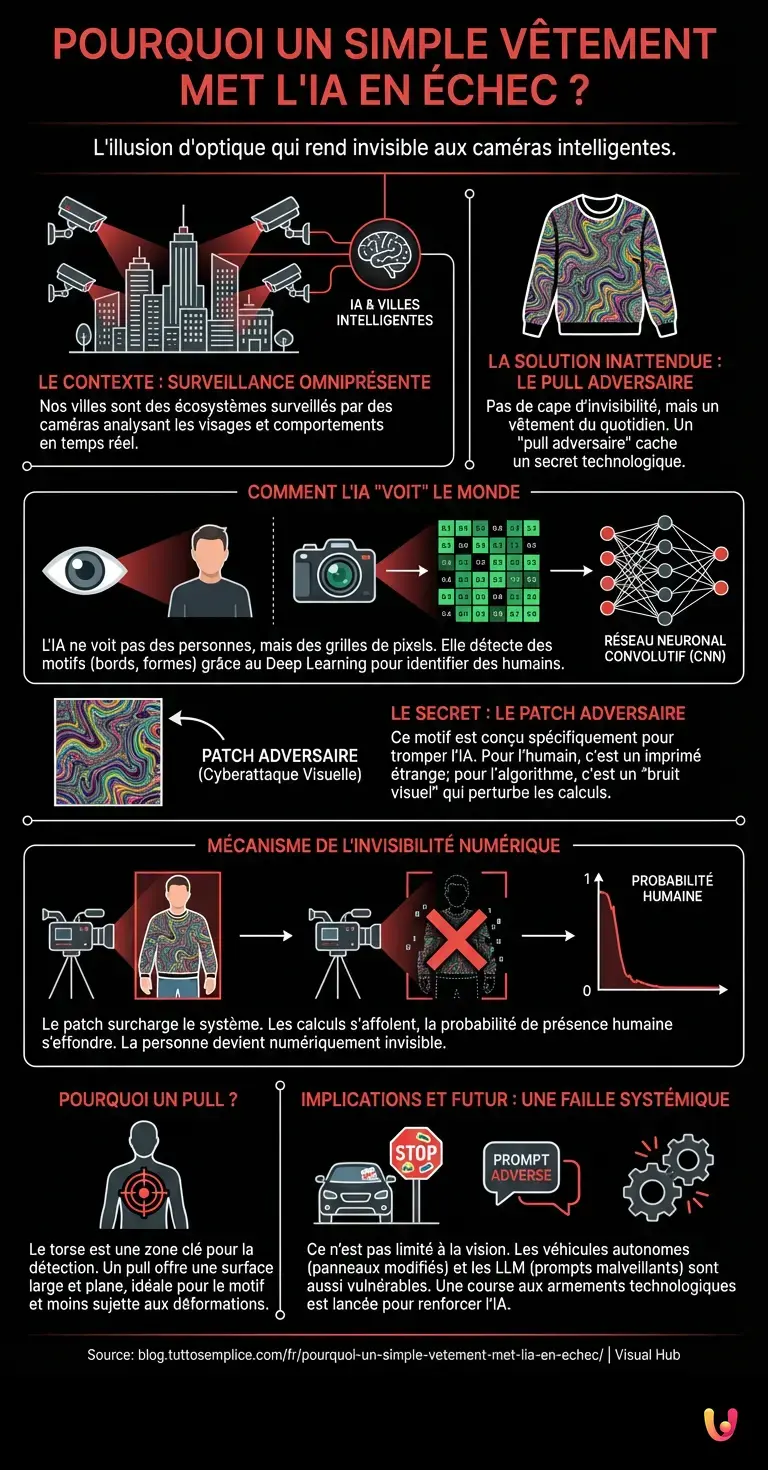

Nous vivons à une époque où l’espace public est constamment surveillé. Nos villes sont devenues des écosystèmes intelligents, parsemés de caméras de sécurité de dernière génération capables non seulement d’enregistrer des images, mais aussi de les analyser en temps réel. Elles reconnaissent les visages, suivent les mouvements, identifient les comportements anormaux. Face à cette surveillance omniprésente, la réaction instinctive pourrait être d’imaginer des solutions de science-fiction pour protéger sa vie privée, comme des capes d’invisibilité ou des dispositifs de brouillage électromagnétique. Pourtant, la réponse la plus efficace et la plus surprenante se trouve dans un objet du quotidien, connu des experts en sécurité informatique sous le nom de « pull adversaire » . Ce vêtement simple, apparemment inoffensif, cache un secret technologique capable de mettre en panne les systèmes de vision artificielle les plus avancés de la planète.

Pour comprendre comment un simple vêtement peut déjouer des systèmes de surveillance ayant coûté des millions de dollars en recherche et développement, il faut prendre du recul et analyser la manière dont les machines « voient » le monde . L’ intelligence artificielle n’a ni yeux, ni cerveau biologique capable d’interpréter la lumière et les formes de manière intuitive. La vision artificielle repose sur des modèles mathématiques et statistiques complexes.

L’œil numérique : comment les machines « voient »

Lorsqu’une caméra filme une rue, elle ne voit pas des « personnes » ou des « voitures ». Elle voit une grille de pixels, chacun ayant une valeur numérique qui représente sa couleur et son intensité lumineuse. C’est là qu’intervient l’ apprentissage automatique . Grâce à un entraînement sur des millions d’images pré-étiquetées, les systèmes apprennent à reconnaître des motifs spécifiques. Si un groupe de pixels présente certaines variations de contraste, de bords et de gradients, le système calcule la probabilité que cet amas de données représente un être humain.

Ce processus est rendu possible grâce au deep learning et, plus particulièrement, à une architecture neuronale spécifique connue sous le nom de Réseau Neuronal Convolutif (CNN). Ces réseaux analysent l’image par couches : les premières couches reconnaissent les lignes et les bords simples, les couches intermédiaires identifient les formes géométriques, et les couches finales assemblent ces éléments pour reconnaître des objets complexes, comme un visage ou la silhouette d’un corps humain. Des systèmes réputés comme YOLO (You Only Look Once) sont capables d’effectuer ces opérations en quelques fractions de seconde, en dessinant des « bounding box » (boîtes de délimitation) autour des personnes identifiées dans la vidéo.

Le secret révélé : la science du pull adversaire

Si l’ IA se base sur des motifs visuels pour identifier un être humain, que se passe-t-il si nous lui fournissons un motif spécifiquement conçu pour la tromper ? C’est exactement le principe du pull adversaire. Il ne s’agit pas d’un tissu magique qui dévie la lumière, mais d’un vêtement imprimé avec une image très particulière, définie techniquement comme un « patch adversaire » (adversarial patch).

Aux yeux d’un être humain, le pull apparaît simplement comme un vêtement avec un imprimé étrange, peut-être un peu psychédélique ou abstrait. Il pourrait ressembler à une image floue de personnes sur un marché, ou à un collage de formes géométriques colorées. Mais pour les algorithmes de détection d’objets, cet imprimé est une véritable cyberattaque visuelle.

Les chercheurs ont utilisé la même intelligence artificielle pour générer ces imprimés. Ils ont demandé à un algorithme de créer une image contenant les caractéristiques visuelles exactes (gradients, contrastes, intersections de lignes) que les réseaux neuronaux associent à « quelque chose qui n’est pas une personne », ou de générer un tel « bruit visuel » qu’il surcharge le système de classification. Lorsqu’une personne porte ce pull, la caméra capture la scène. Le réseau neuronal commence à analyser les pixels. Cependant, lorsqu’il arrive à la zone du buste couverte par le pull, les calculs mathématiques s’affolent. Les valeurs de probabilité indiquant la présence d’un être humain s’effondrent drastiquement. Le système décide simplement qu’il n’y a personne. La personne devient, à tous égards numériques, invisible.

Pourquoi un pull, précisément ?

Le choix du vêtement n’est pas fortuit. Les systèmes de détection piétonne reposent fortement sur l’identification du torse et des épaules, car ce sont les parties du corps les plus larges et les plus visibles, moins sujettes aux occlusions que les jambes ou les bras. Couvrir cette zone critique avec un patch adversaire maximise l’efficacité de l’illusion. De plus, un pull ou un sweat-shirt offrent une surface large et relativement plane pour imprimer le motif, garantissant que l’image ne se déforme pas excessivement avec les mouvements du corps, ce qui pourrait compromettre son efficacité.

Des tests menés dans plusieurs laboratoires universitaires ont démontré que ces vêtements réussissent à déjouer les systèmes de surveillance avec des taux de réussite étonnants, surpassant brillamment tous les critères de sécurité standard utilisés pour évaluer la robustesse des logiciels de vision par ordinateur.

Au-delà de la surveillance : les implications pour l’avenir.

La découverte de cette vulnérabilité soulève des questions profondes qui dépassent largement le simple désir de contourner une caméra de sécurité. Elle démontre que les systèmes d’intelligence artificielle, aussi avancés soient-ils, perçoivent la réalité d’une manière fondamentalement étrangère à la nôtre. Ce sont des machines statistiques, et à ce titre, elles peuvent être trompées en exploitant leurs propres règles mathématiques.

Ce phénomène des « attaques adverses » ne se limite pas à la vision par ordinateur. C’est un problème systémique qui concerne l’ensemble du domaine de l’intelligence artificielle. Par exemple, dans le domaine de l’ automatisation et des véhicules autonomes, des chercheurs ont démontré qu’il suffit d’appliquer quelques petits autocollants noirs sur un panneau « Stop » pour faire croire à la voiture qu’il s’agit d’un panneau de limitation de vitesse, avec des conséquences potentiellement désastreuses.

Dans le domaine du traitement automatique du langage naturel (TALN), la situation est similaire. Les grands modèles linguistiques ( LLM) , comme GPT-3 (et donc ChatGPT ), peuvent être victimes de « prompts adverses » (souvent appelés jailbreaks). En insérant des séquences de mots spécifiques, apparemment inoffensives ou dénuées de sens pour un humain, il est possible de contourner les filtres de sécurité du modèle, le forçant à générer des réponses qui lui seraient normalement interdites. La logique de base est la même que pour le pull : fournir une entrée (visuelle ou textuelle) qui exploite les angles morts de l’architecture du modèle.

La course aux armements technologiques

Le progrès technologique dans ce domaine a déclenché une véritable course aux armements entre ceux qui développent des systèmes d’intelligence artificielle et ceux qui cherchent à les contourner. D’un côté, les ingénieurs travaillent à rendre les réseaux neuronaux plus robustes, en les entraînant à reconnaître et à ignorer les patchs adverses. De l’autre, les chercheurs (et potentiellement les malfaiteurs) développent des modèles toujours plus sophistiqués, capables de s’adapter à différents angles, conditions de lumière et même de tromper les capteurs infrarouges.

Cette dynamique est fondamentale pour l’amélioration de la technologie. Découvrir qu’un simple pull peut aveugler un système de sécurité oblige les développeurs à ne pas tenir pour acquise l’infaillibilité de leurs créations. Cela nous rappelle que l’intelligence artificielle est un outil puissant, mais fragile, et que son intégration dans des infrastructures critiques exige une compréhension approfondie de ses limites intrinsèques.

En Bref (TL;DR)

Nos villes sont surveillées par des caméras intelligentes, mais un simple pull peut protéger notre vie privée en trompant l’intelligence artificielle.

Les systèmes de vision par ordinateur analysent les pixels pour reconnaître les piétons, mais ils sont induits en erreur par des motifs spécifiques appelés « patchs adverses ».

En portant ces vêtements avec des motifs visuels ciblés sur le torse, l’algorithme est perturbé et l’individu devient numériquement invisible aux caméras.

Conclusions

Le pull anti-reconnaissance faciale représente un fascinant paradoxe de notre ère numérique : la technologie la plus complexe et sophistiquée peut être mise à genoux par un simple morceau de coton imprimé. Ce vêtement n’est pas seulement une astuce curieuse pour échapper à Big Brother, mais la manifestation physique d’une vulnérabilité mathématique. Il nous apprend que, tandis que l’intelligence artificielle continue d’évoluer et de pénétrer tous les aspects de notre vie, notre compréhension de la façon dont ces machines « pensent » et « voient » doit évoluer de pair. L’invisibilité, aujourd’hui, ne nécessite pas de magie, mais seulement la bonne combinaison de pixels imprimés sur un vêtement du quotidien.

Foire aux questions

Un pull anti-surveillance est un vêtement spécial conçu pour tromper les systèmes de surveillance basés sur l’intelligence artificielle. Il présente un motif particulier, appelé « patch adversarial », qui génère du bruit visuel et perturbe les algorithmes de détection. En portant ce vêtement, les calculs mathématiques de la caméra sont faussés et la personne devient de facto invisible au système numérique.

Les systèmes de vision artificielle ne perçoivent pas le monde comme les humains, mais analysent une grille de pixels en évaluant les couleurs et l’intensité lumineuse. Grâce à des réseaux neuronaux convolutifs, les algorithmes recherchent des motifs spécifiques tels que les contrastes et les formes géométriques typiques du corps humain. Si ces éléments mathématiques correspondent aux données d’entraînement, le logiciel identifie la présence d’un piéton.

Les logiciels de détection de piétons se concentrent principalement sur l’identification du torse et des épaules, car ce sont les parties du corps les plus larges et les moins sujettes aux obstacles visuels. Un pull offre une surface étendue et relativement plane, idéale pour accueillir l’impression du motif adverse sans trop le déformer pendant les mouvements. Couvrir cette zone critique maximise les chances de succès de l’illusion d’optique numérique.

Le problème des vulnérabilités mathématiques concerne l’ensemble du domaine de l’apprentissage automatique, et pas seulement les caméras de sécurité. Dans le secteur des véhicules autonomes, de petits autocollants sur un panneau de signalisation peuvent complètement altérer la perception du véhicule, causant de graves dangers. Les modèles linguistiques avancés peuvent également subir des manipulations similaires via des séquences de texte spécifiques conçues pour contourner les filtres de sécurité.

Une véritable course technologique oppose actuellement les créateurs de systèmes de sécurité et ceux qui conçoivent des méthodes pour les contourner. Les ingénieurs informaticiens travaillent constamment à rendre les réseaux neuronaux plus robustes, en les entraînant à reconnaître et à ignorer les schémas trompeurs. Cette dynamique est essentielle pour découvrir les limites intrinsèques de la technologie et améliorer la fiabilité des infrastructures critiques du futur.

Encore des doutes sur Pourquoi un simple vêtement met l’IA en échec ??

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.