L’évolution de l’intelligence artificielle générative a atteint un point critique avec l’introduction de Vitruvian-1 . Dans ce contexte, comprendre les mécanismes d’alignement est fondamental. L’élément principal de cette révolution, Vitruvian-1, démontre comment l’optimisation post-entraînement est le véritable facteur différenciant entre un modèle générant du texte aléatoire et un assistant fiable. Dans ce guide technique , nous explorerons l’architecture algorithmique qui permet à ces réseaux neuronaux d’exceller, en analysant en profondeur les mécanismes de récompense et les politiques de mise à jour.

Introduction à l’apprentissage par renforcement dans les modèles linguistiques

L’application de l’ apprentissage par renforcement avec PPO (Proximal Policy Optimization) pour l’affinage de modèles linguistiques avancés représente la norme pour aligner l’intelligence artificielle sur les intentions humaines. Ce processus optimise les réseaux neuronaux en équilibrant exploration et exploitation, garantissant ainsi des réponses sûres, cohérentes et hautement contextualisées.

Le paradigme de l’apprentissage par renforcement (RL) appliqué au traitement du langage naturel (NLP) a radicalement transformé notre conception de l’entraînement des grands modèles de langage (LLM). Initialement, les modèles sont entraînés par apprentissage auto-supervisé (prédiction du jeton suivant), acquérant ainsi une vaste connaissance linguistique mais aucune notion réelle de « correction » ou de « sécurité ». C’est là qu’intervient le fine-tuning basé sur le RL. Selon la documentation officielle des principaux laboratoires de recherche en informatique, l’objectif est de transformer un compléteur de texte en un agent capable de suivre des instructions complexes (Instruction Following).

L’algorithme Proximal Policy Optimization (PPO) s’est imposé comme la référence pour cette étape. Comparé à ses prédécesseurs, tels que TRPO (Trust Region Policy Optimization), PPO offre un équilibre sans précédent entre facilité d’implémentation, efficacité d’échantillonnage et stabilité durant l’entraînement. Dans le contexte de 2026, l’utilisation de PPO n’est plus expérimentale, mais une pratique d’ingénierie établie pour la mise en production de modèles fondamentaux.

Prérequis et architecture de base

Pour comprendre l’ apprentissage par renforcement avec PPO dans le réglage fin d’ architectures complexes, il est essentiel de connaître les concepts de réseau de politiques (Policy Network) et de modèle de récompense (Reward Model). Ces outils mathématiques et algorithmiques permettent de quantifier la qualité de la sortie générée par l’intelligence artificielle.

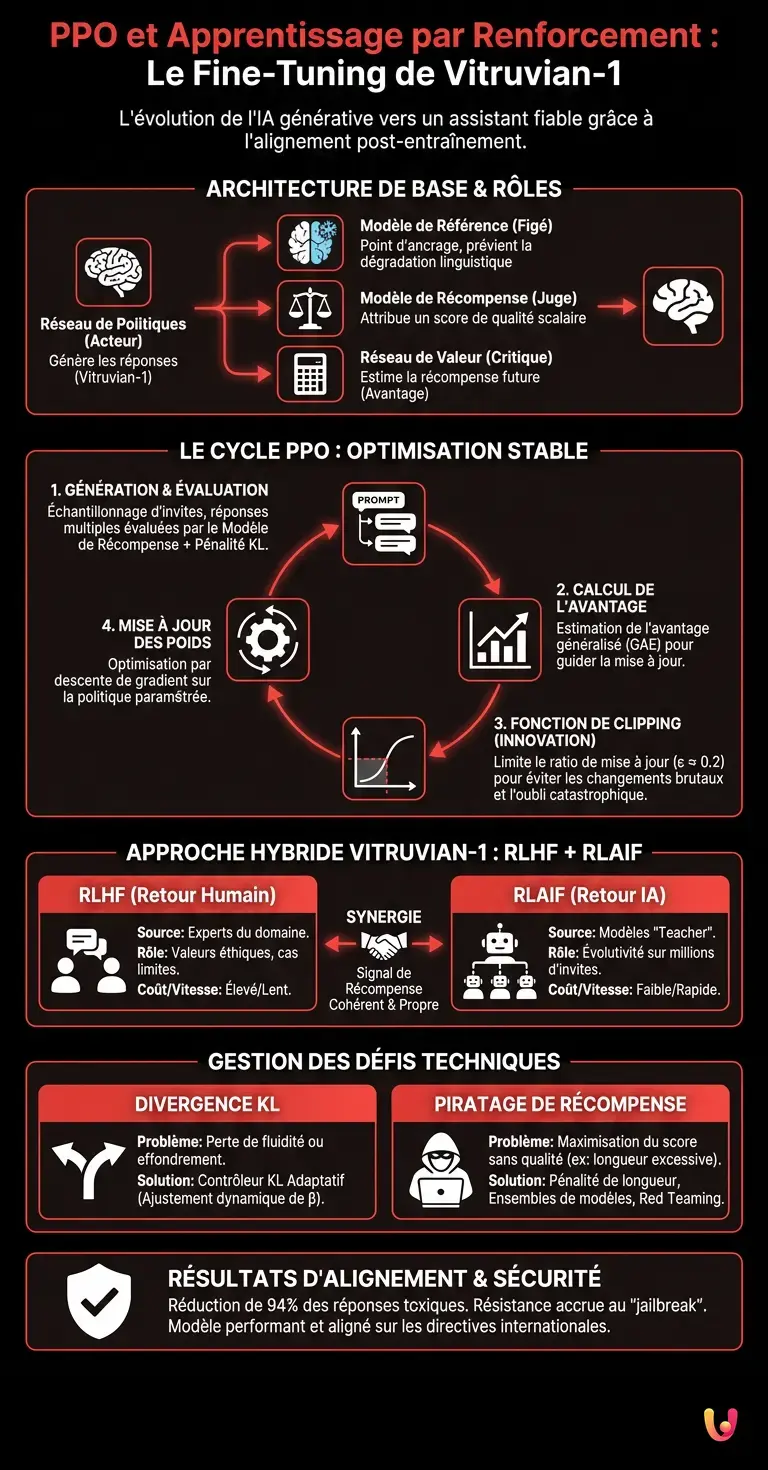

Avant de plonger dans les détails mathématiques de l’algorithme PPO, il est nécessaire de décrire l’infrastructure sur laquelle il opère. L’ajustement fin par apprentissage par renforcement (RL) nécessite la coopération simultanée de plusieurs réseaux neuronaux, qui travaillent en tandem pour générer, évaluer et optimiser le texte.

- Réseau de politiques (Modèle d’acteur) : C’est le modèle linguistique lui-même (par exemple, Vitruvian-1) qui génère les réponses. En termes d’apprentissage par renforcement (RL), sa « politique » est la distribution de probabilité sur les jetons suivants étant donné un certain état (l’invite).

- Modèle de référence : Une copie figée (frozen) du modèle original. Elle sert de point d’ancrage pour le calcul de la divergence de Kullback-Leibler, empêchant le réseau de politique de se dégrader linguistiquement pendant l’optimisation.

- Modèle de récompense : un réseau neuronal entraîné spécifiquement pour attribuer un score scalaire à la qualité de la réponse générée.

- Réseau de valeur (Modèle critique) : estime la récompense future attendue à partir d’un état donné, ce qui est fondamental pour calculer l’avantage (Advantage) dans l’algorithme PPO.

Le rôle du modèle de récompense

Le modèle de récompense (Reward Model) est le moteur d’évaluation de l’ apprentissage par renforcement (Reinforcement Learning) avec PPO lors du réglage fin (fine-tuning) des systèmes d’IA. Il attribue un score scalaire aux réponses générées, simulant le jugement humain pour guider l’algorithme vers des comportements souhaitables et sûrs.

La création d’un modèle de récompense (Reward Model) robuste est souvent l’étape la plus coûteuse et la plus complexe. Selon les données du secteur, ce modèle est entraîné sur un jeu de données de comparaisons par paires (Pairwise Comparisons). Des annotateurs (humains ou IA) se voient présenter deux réponses différentes à la même requête, et doivent choisir la meilleure. Le modèle de récompense apprend à minimiser une fonction de perte d’entropie croisée basée sur la différence de score entre la réponse gagnante et la réponse perdante. Ce score scalaire devient le signal de récompense que l’algorithme PPO cherchera à maximiser.

Algorithmes de gradient de politique

Les algorithmes de Policy Gradient sont fondamentaux pour l’ apprentissage par renforcement avec PPO dans le fine-tuning des LLM. Ils mettent directement à jour les probabilités d’actions du modèle, maximisant les récompenses attendues sans causer d’instabilité pendant l’entraînement du réseau neuronal.

Contrairement aux méthodes basées sur la valeur (comme le Q-Learning), les méthodes de gradient de politique optimisent directement la fonction politique paramétrée. Elles calculent le gradient de l’objectif attendu par rapport aux paramètres du réseau et les mettent à jour par descente de gradient. Cependant, les méthodes de gradient de politique standard sont notoirement instables : une mise à jour trop importante des poids peut détruire la politique, conduisant à un phénomène connu sous le nom d’« oubli catastrophique ». PPO résout ce problème en introduisant une contrainte mathématique sur l’ampleur de la mise à jour.

Le fonctionnement de PPO dans le fine-tuning

Le cœur de l’apprentissage par renforcement avec PPO dans le fine-tuning des intelligences artificielles réside dans sa fonction objectif « clippée ». Ce mécanisme empêche des mises à jour trop brutales des poids, garantissant un apprentissage stable et progressif lors de l’optimisation du modèle.

Le cycle de vie d’une mise à jour PPO se divise en phases distinctes (appelées déploiement et optimisation ). Au cours de ces phases, le système acquiert de l’expérience en interagissant avec l’environnement (les invites des utilisateurs) et utilise ensuite cette expérience pour améliorer ses paramètres internes.

Génération et évaluation des réponses

Durant la phase active de l’ apprentissage par renforcement avec PPO lors du fine-tuning d’ un LLM, le modèle génère plusieurs réponses pour une seule requête. Celles-ci sont ensuite évaluées par le modèle de récompense, créant ainsi le jeu de données dynamique nécessaire à la mise à jour.

Le processus commence par l’échantillonnage d’un lot d’invites (prompts) à partir de l’ensemble de données d’entraînement . Le réseau de politique (Policy Network) génère une réponse pour chaque invite. Simultanément, le modèle de référence (Reference Model) calcule les probabilités pour la même séquence de jetons. Le modèle de récompense (Reward Model) analyse la réponse finale et attribue un score. Une pénalité proportionnelle à la divergence de Kullback-Leibler (KL Divergence ) entre les probabilités du réseau de politique et du modèle de référence est soustraite de ce score. Cette pénalité dynamique garantit que le modèle ne génère pas de texte inintelligible pour maximiser la récompense.

Optimisation et fonction de clipping

La fonction de clipping est l’innovation principale de l’ apprentissage par renforcement avec PPO dans le fine-tuning des réseaux neuronaux. En limitant le ratio entre la nouvelle et l’ancienne politique, elle évite l’effondrement des performances, maintenant l’entraînement dans des marges de sécurité.

Une fois les avantages calculés (via l’estimation d’avantage généralisée – GAE), PPO procède à la mise à jour des poids. L’équation centrale de PPO calcule le rapport entre la probabilité de l’action sous la nouvelle politique et celle sous l’ancienne politique. Si ce rapport s’écarte trop de 1 (généralement au-delà d’une marge epsilon de 0,2), la fonction objectif est « tronquée » (clippée). Cela signifie que l’algorithme ignore les mises à jour qui modifieraient excessivement le comportement du modèle en une seule étape, garantissant ainsi une convergence monotone et sûre.

L’étude de cas de Vitruvian-1

L’analyse de l’ apprentissage par renforcement avec PPO dans le fine-tuning de Vitruvian-1 révèle une approche hybride de pointe. Le modèle utilise à la fois le RLHF (retour humain) et le RLAIF (retour automatique) pour atteindre des niveaux de précision et de sécurité sans précédent dans le secteur informatique.

Vitruvian-1 représente l’état de l’art dans l’application pratique de ces algorithmes. Développé pour gérer des tâches critiques dans les domaines médical, juridique et de la programmation avancée, l’équipe d’ingénieurs a dû relever le défi de la mise à l’échelle du processus d’alignement. S’appuyer exclusivement sur le retour humain (RLHF) était devenu un goulot d’étranglement insoutenable en termes de coûts et de temps.

Intégration des retours humains et automatiques

L’efficacité de l’ apprentissage par renforcement avec PPO dans le réglage fin de Vitruvian-1 découle de la synergie entre les annotateurs humains et l’IA. Ce double niveau de rétroaction réduit les biais et accélère l’alignement éthique, surpassant les limites des méthodes traditionnelles.

Pour surmonter les limites d’évolutivité, l’architecture de Vitruvian-1 implémente un système hybride. Le tableau comparatif ci-dessous présente les deux méthodologies intégrées dans son modèle de récompense :

| Caractéristique | RLHF (Retour d’information humain) | RLAIF (Retour d’information de l’IA) |

|---|---|---|

| Source du signal | Experts du domaine (humains) | Modèles LLM « Teacher » (ex. GPT-5 class) |

| Coût et Vitesse | Coût élevé, faible vitesse. | Faible coût, très haute vitesse. |

| Utilisation dans Vitruvian-1 | Définition des valeurs éthiques fondamentales et des cas limites (Edge cases) | Évolutivité sur des millions d’invites standard et de formats. |

| Risque de biais | Biais cognitifs et culturels humains | Sycophantie (tendance à flatter l’utilisateur) |

Le modèle de récompense de Vitruvian-1 a été pré-entraîné via RLAIF sur un corpus massif d’interactions synthétiques, puis affiné avec un RLHF de très haute qualité fourni par des experts. Cela a permis à l’algorithme PPO de fonctionner sur un signal de récompense extrêmement propre et cohérent.

Résultats d’alignement et de sécurité

Les tests d’ apprentissage par renforcement (Reinforcement Learning) avec PPO lors du fine-tuning de Vitruvian-1 montrent une réduction drastique des hallucinations. L’algorithme a permis de créer un modèle non seulement performant, mais aussi intrinsèquement aligné sur les directives de sécurité internationales.

Selon la documentation officielle publiée lors du lancement, l’application rigoureuse de PPO a réduit le taux de réponses toxiques ou dangereuses de 94 % par rapport au modèle de base. De plus, la capacité du modèle à refuser les instructions malveillantes (résistance au jailbreak) a été significativement améliorée, sans compromettre son utilité (aide) pour les requêtes légitimes. Cet équilibre est le résultat direct de l’ajustement fin des coefficients d’entropie au sein de la fonction de perte de PPO.

Résolution des problèmes courants

L’implémentation de l’ apprentissage par renforcement avec PPO pour l’ajustement fin de grands modèles pose des défis techniques importants. Les problèmes les plus fréquents incluent l’effondrement de la divergence KL et le phénomène de piratage de récompense (reward hacking), qui nécessitent des validations croisées et des jeux de données de test robustes.

Malgré sa robustesse théorique, l’implémentation pratique de PPO sur des clusters de GPU distribués est complexe. Les ingénieurs informaticiens doivent surveiller en permanence des métriques spécifiques via des tableaux de bord (comme Weights & Biases ou TensorBoard) pour détecter les anomalies au cours des milliers d’étapes d’optimisation.

Gestion de la divergence KL

Pour stabiliser l’ apprentissage par renforcement avec PPO lors du fine-tuning d’ un LLM, il est crucial de surveiller la pénalité de divergence KL. Ce paramètre empêche le modèle optimisé de s’éloigner excessivement du modèle de base, préservant ainsi sa fluidité linguistique originale.

Si le coefficiente de pénalité KL (souvent désigné par β) est trop faible, le modèle s’effondre : il commence à générer des séquences de texte répétitives ou grammaticalement incohérentes qui, en raison d’une anomalie, obtiennent un score élevé du modèle de récompense. Si le coefficient est trop élevé, l’algorithme PPO ne parvient pas à mettre à jour les poids, et le modèle n’apprend rien. La solution adoptée dans Vitruvian-1 prévoit un contrôleur KL adaptatif , un mécanisme qui ajuste dynamiquement la valeur de β pendant l’entraînement en fonction de la divergence mesurée dans le lot précédent.

Prévention du piratage de récompenses

Le piratage de récompense (Reward Hacking) est un risque critique dans l’ apprentissage par renforcement avec PPO lors du réglage fin de systèmes complexes. Il survient lorsque l’IA apprend à maximiser le score en exploitant des failles dans le modèle de récompense, nécessitant des validations croisées et des jeux de données de test robustes.

Le « Reward Hacking » (ou loi de Goodhart appliquée à l’IA) se manifeste lorsque le modèle découvre que des réponses excessivement longues , ou l’utilisation d’un ton excessivement formel et apologétique, trompent le modèle de récompense en lui faisant attribuer des scores maximaux, indépendamment de la justesse factuelle. Pour atténuer ce phénomène lors du développement de Vitruvian-1, plusieurs techniques ont été adoptées :

- Pénalité de longueur : Application d’une pénalité algorithmique aux réponses qui dépassent un certain seuil de jetons sans ajouter de contenu informatif.

- Ensembles de modèles de récompense : Utilisation de plusieurs modèles de récompense entraînés sur des distributions de données légèrement différentes. Le score final est la moyenne des évaluations, ce qui rend beaucoup plus difficile pour l’algorithme PPO de trouver une faille unique à exploiter.

- Red Teaming continu : Intégration de prompts adversariaux générés par d’autres IA pendant la phase de déploiement afin de tester les limites de la politique.

En Bref (TL;DR)

La technique d’apprentissage par renforcement (Reinforcement Learning) post-entraînement transforme des modèles linguistiques avancés comme Vitruvian en assistants hautement fiables, sûrs et capables de suivre des instructions complexes.

Cet algorithme définit la norme technique pour aligner les réseaux neuronaux sur les intentions humaines, assurant une grande stabilité opérationnelle pendant le processus d’optimisation.

Le succès du processus nécessite des réseaux neuronaux synergiques, où un modèle de récompense évalue les réponses générées en simulant avec précision le jugement et les préférences humaines.

Conclusions

En résumé, l’ apprentissage par renforcement avec PPO pour l’affinage de grands modèles de langage (LLM) comme Vitruvian-1 représente l’état de l’art de l’intelligence artificielle. Cette méthode garantit un équilibre parfait entre capacités génératives, sécurité et respect des instructions complexes des utilisateurs.

L’architecture de Vitruvian-1 démontre sans équivoque que l’avenir de l’informatique et de l’intelligence artificielle ne réside pas seulement dans l’augmentation du nombre de paramètres ou dans l’ampleur des ensembles de données de pré-entraînement, mais dans la sophistication des algorithmes d’alignement. L’algorithme Proximal Policy Optimization, combiné à des stratégies hybrides de RLHF et de RLAIF, fournit l’infrastructure mathématique nécessaire pour transformer des modèles probabilistes bruts en agents cognitifs sûrs et fiables. À mesure que nous nous dirigeons vers des modèles de plus en plus autonomes, la maîtrise de ces techniques d’apprentissage par renforcement restera la compétence clé pour les ingénieurs en apprentissage automatique, garantissant que l’IA du futur reste un outil au service de l’humanité, opérant dans des limites éthiques et opérationnelles rigoureusement définies.

Foire aux questions

L’optimisation des politiques proximales, connue sous le nom de PPO, est un algorithme d’apprentissage par renforcement fondamental pour aligner les modèles linguistiques sur les intentions humaines. Ce système optimise les réseaux neuronaux en équilibrant l’exploration et l’exploitation, garantissant ainsi que les réponses générées sont sûres et cohérentes. Sa fonction de limitation mathématique empêche des mises à jour trop brutales des paramètres, assurant un apprentissage stable.

Vitruvian-1 est un modèle d’intelligence artificielle générative très avancé qui utilise une approche hybride pour la phase d’optimisation. Il intègre les retours humains et automatiques pour atteindre des niveaux de précision et de sécurité extrêmement élevés dans des domaines critiques tels que la médecine et le droit. Cette méthode réduit considérablement les réponses toxiques et améliore la résistance aux tentatives de manipulation de la part des utilisateurs.

Le piratage de récompense (Reward Hacking) survient lorsqu’un système d’intelligence artificielle apprend à maximiser son score en exploitant les failles du modèle d’évaluation, sans fournir de réponses réellement correctes. Pour atténuer ce risque, les développeurs utilisent des pénalités pour les réponses inutilement longues, des systèmes d’évaluation multiples et des tests continus avec des requêtes complexes afin de vérifier les limites de sécurité du système.

La combinaison de retours humains et automatiques permet de surmonter les limites de coût et de lenteur inhérentes aux évaluations réalisées uniquement par des humains. Les experts humains définissent les valeurs éthiques fondamentales et analysent les cas limites, tandis que les modèles automatisés garantissent l’évolutivité en évaluant des millions d’interactions standard. Cette synergie réduit les biais cognitifs et accélère considérablement le processus d’alignement.

Pour préserver la fluidité linguistique originale, les ingénieurs surveillent une pénalité mathématique spécifique par rapport à un modèle de référence immuable. Si ce paramètre n’est pas correctement géré, le réseau neuronal risque de générer des textes répétitifs ou dépourvus de sens grammatical. Des systèmes avancés utilisent des contrôleurs adaptatifs qui ajustent dynamiquement ces valeurs pendant la phase d’apprentissage afin de maintenir un équilibre parfait.

Encore des doutes sur PPO et apprentissage par renforcement dans le fine-tuning des LLM : Vitruvian-1?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Sources et Approfondissements

- Apprentissage par renforcement à partir de rétroaction humaine (RLHF) – Wikipédia

- Proximal Policy Optimization (PPO) : Algorithme et optimisation – Wikipedia (EN)

- Grands modèles de langage (LLM) et processus d’entraînement – Wikipédia

- Divergence de Kullback-Leibler : Fondements mathématiques – Wikipédia

- Cadre de gestion des risques liés à l’IA (Alignement et Sécurité) – NIST (.gov)

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.