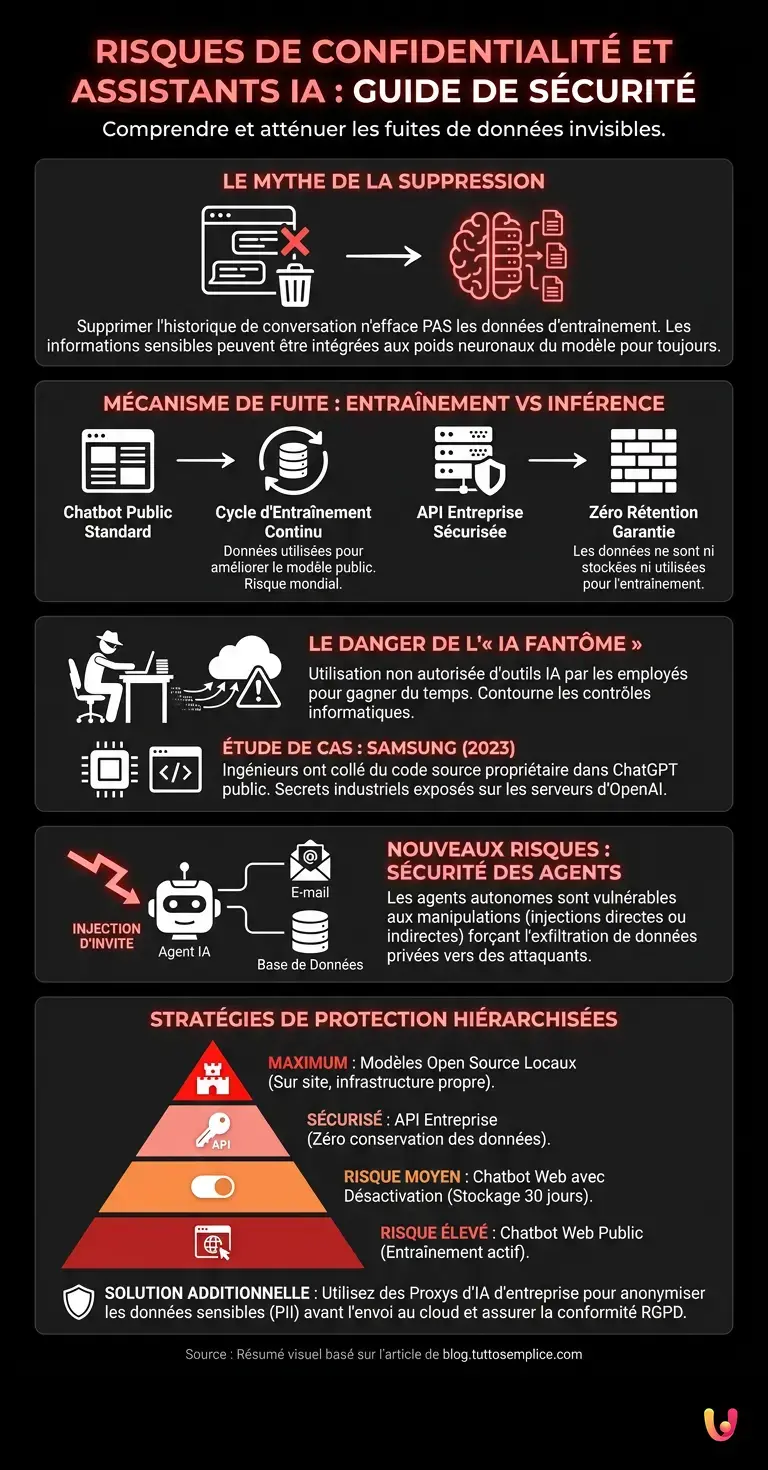

Le faux mythe le plus dangereux concernant la confidentialité et l’intelligence artificielle est de croire que supprimer l’historique d’une conversation efface les données fournies. En réalité, si une information sensible est traitée par un modèle génératif sans les protections d’entreprise adéquates, elle peut être intégrée aux poids neuronaux du système lors des phases de fine-tuning ou d’apprentissage continu. La suppression ne supprime que l’interface visuelle pour l’utilisateur, mais le risque de fuite de données demeure permanent, exposant les secrets industriels à quiconque sait formuler la requête appropriée.

Sélectionnez le type de données et le modèle utilisé pour évaluer le risque d’exposition des informations.

Comment les modèles linguistiques gèrent-ils les données sensibles ?

Lors de l’analyse de la confidentialité de l’intelligence artificielle , il est essentiel de comprendre que les modèles linguistiques n’« oublient » pas facilement . Les données saisies dans les invites peuvent être utilisées pour un réentraînement continu, exposant ainsi les informations de l’entreprise à des utilisateurs externes lors de sessions ultérieures et compromettant la confidentialité.

Les grands modèles de langage (LLM) tels que GPT-4, Claude ou Gemini fonctionnent en deux phases distinctes : l’entraînement (training) et l’inférence (génération de la réponse). Le problème survient lorsque les plateformes grand public utilisent les données d’inférence pour alimenter les cycles d’entraînement suivants. Selon la documentation officielle d’OpenAI, les conversations effectuées via l’interface web standard (sans désactivation) peuvent être examinées par des modérateurs humains et utilisées pour améliorer le modèle.

Cela signifie que si un utilisateur saisit un contrat confidentiel pour en demander un résumé, des fragments de ce contrat pourraient apparaître dans les résultats si un autre utilisateur, à l’autre bout du monde, formule une requête statistiquement corrélée. La gestion des données sensibles nécessite donc une migration obligatoire vers des solutions Entreprise garantissant contractuellement la rétention zéro des données .

Le phénomène de la fuite de données en entreprise

Les fuites de données liées à la confidentialité et à l’intelligence artificielle surviennent lorsque les employés collent du code source, des données financières ou des informations sur les clients dans des chatbots publics. Cela transforme des outils de productivité en failles de sécurité majeures pour toute l’infrastructure informatique.

Le phénomène de l’ IA fantôme (l’utilisation non autorisée d’outils d’IA par les employés) est aujourd’hui la principale cause de fuite de données. Poussés par le besoin d’optimiser leur travail, les employés contournent les contrôles informatiques en fournissant aux algorithmes des informations couvertes par des accords de confidentialité (NDA).

Étude de cas réelle : La fuite de données de Samsung (2023)

Au printemps 2023, la division semi-conducteurs de Samsung a enregistré trois incidents de sécurité distincts en moins d’un mois. Des ingénieurs de l’entreprise avaient collé du code source propriétaire et des enregistrements de réunions internes sur ChatGPT afin d’identifier des bugs et de générer des comptes rendus. Comme l’utilisation se faisait via l’interface grand public, les secrets industriels de Samsung se sont retrouvés sur les serveurs d’entraînement d’OpenAI, obligeant l’entreprise sud-coréenne à interdire temporairement l’utilisation de l’IA générative sur les appareils professionnels.

Sécurité des agents et vulnérabilité des invites

La sécurité des agents représente la nouvelle frontière de la confidentialité de l’intelligence artificielle . Lorsque les agents d’IA opèrent de manière autonome et accèdent aux bases de données d’entreprise, le risque d’extraction non autorisée de données via des injections de prompt augmente de manière exponentielle.

Avec l’évolution de l’ IA conversationnelle vers l’ IA agentique (systèmes capables d’exécuter des actions, de lire des e-mails, d’interroger des bases de données et d’envoyer des messages), le périmètre de sécurité s’est élargi. Un attaquant n’a plus besoin de violer un serveur ; il lui suffit de manipuler l’agent IA.

- Injection directe d’invite : L’utilisateur malveillant fournit des instructions qui remplacent les directives système de l’IA , la forçant à révéler des données sensibles présentes dans son contexte.

- Injection indirecte d’instructions : L’agent IA lit un document externe (par exemple, une page web ou un e-mail) contenant des instructions malveillantes cachées. L’IA exécute ces instructions à l’insu de l’utilisateur, ce qui peut potentiellement permettre l’exfiltration de données privées vers des serveurs externes.

Pour garantir la sécurité des agents , il est essentiel de mettre en œuvre des architectures Human-in-the-Loop (HITL), où les actions critiques nécessitent toujours une validation humaine, et d’isoler les environnements d’exécution des agents (sandboxing).

Stratégies d’atténuation et configurations sécurisées

Pour garantir une solide protection de la vie privée dans le domaine de l’intelligence artificielle , les entreprises doivent adopter des politiques strictes. L’utilisation d’API avec des accords de non-formation et la mise en œuvre de filtres DLP (Data Loss Prevention) sont des étapes techniques obligatoires pour atténuer les risques.

La prévention des fuites de données exige une approche à plusieurs niveaux. Il ne suffit pas de bloquer les URL des chatbots au niveau du pare-feu, car les alternatives prolifèrent quotidiennement. Il est nécessaire de mettre en œuvre des solutions structurelles :

| Approche | Niveau de sécurité | Impact sur la vie privée |

|---|---|---|

| Chatbot Web pour Consommateurs | Bas | Données utilisées pour l’entraînement. Risque élevé de fuite. |

| Chatbot Web avec option de désactivation | Moyen | Les données n’entraînent pas le modèle, mais restent sur les serveurs pendant 30 jours. |

| Accès via API (Entreprise) | Haut | Aucune conservation des données. Les données ne sont ni stockées ni utilisées. |

| Modèles Open Source locaux (ex. LLaMA) | Massimo | Les données ne quittent jamais l’infrastructure de l’entreprise (sur site). |

De plus, l’adoption de proxys d’IA d’entreprise permet d’intercepter les requêtes des employés, d’anonymiser les données sensibles (comme les numéros de cartes de crédit ou les codes fiscaux) avant qu’elles n’atteignent le cloud du LLM , et de maintenir un journal d’audit complet pour la conformité RGPD.

Conclusions

La gestion de la confidentialité de l’intelligence artificielle ne peut pas être déléguée au bon sens des utilisateurs individuels. Comme nous l’avons analysé, l’utilisation quotidienne de modèles génératifs expose les organisations à des risques concrets de fuite de données et de vulnérabilités liées à la sécurité des agents. La transition vers une utilisation consciente de l’IA nécessite l’abandon des outils grand public dans le cadre professionnel au profit de solutions d’entreprise, d’API sécurisées ou de modèles exécutés localement. Ce n’est qu’à travers une infrastructure Zero Trust appliquée aux invites et une formation continue du personnel qu’il est possible d’exploiter l’énorme potentiel de l’informatique générative sans compromettre le patrimoine informationnel de l’entreprise.

Foire aux questions

Pour protéger les informations sensibles, il est essentiel d’éviter les versions publiques des chatbots. Les entreprises doivent adopter des solutions de niveau entreprise garantissant une conservation des données nulle, utiliser des modèles open source installés sur leurs propres serveurs locaux ou mettre en œuvre des filtres de prévention pour bloquer la transmission d’informations confidentielles. Seule une approche structurée garantit une sécurité totale.

Supprimer les conversations ne fait que masquer l’affichage pour l’utilisateur du service, mais n’efface pas les informations des serveurs du fournisseur. Si les données ont été traitées par un modèle sans protections d’entreprise, elles ont pu être intégrées aux poids neuronaux du système lors de la phase d’apprentissage continu. Cela signifie que les secrets industriels restent potentiellement accessibles à d’autres personnes lors de sessions futures.

Ce terme désigne l’utilisation non autorisée d’outils génératifs par le personnel de l’entreprise sans le consentement du service informatique. Cela représente une menace sérieuse car les employés, dans le but d’accélérer leurs tâches quotidiennes, pourraient saisir des contrats, du code source ou des données clients sur des plateformes publiques. Un tel comportement transforme des outils utiles en failles de sécurité majeures pour l’ensemble du réseau informatique.

Les agents autonomes accédant à des bases de données ou lisant des courriels peuvent subir des cyberattaques via des instructions malveillantes cachées dans des documents externes. Un attaquant peut forcer le système à ignorer les directives de sécurité et à exfiltrer des documents privés vers des serveurs non autorisés. Pour atténuer ce risque, une supervision humaine est absolument nécessaire pour approuver chaque opération critique.

Le respect des réglementations exige l’adoption de proxys d’entreprise capables d’anonymiser les données personnelles avant leur arrivée sur les serveurs distants. Il est également nécessaire de conclure des accords précis avec les fournisseurs pour empêcher l’entraînement sur les données saisies. Enfin, les entreprises doivent tenir des registres de contrôle complets pour démontrer leur pleine conformité aux lois en vigueur sur la protection des données.

Encore des doutes sur Risques de confidentialité et de fuite de données avec les assistants IA : Guide de sécurité?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Sources et Approfondissements

- L’intelligence artificielle et la protection des données personnelles (CNIL)

- Cadre de gestion des risques liés à l’IA – AI RMF (NIST – Gouvernement des États-Unis)

- Intelligence artificielle et protection des données personnelles (CNIL)

- Shadow IT : définition et risques pour la sécurité de l’information (Wikipédia)

- Injection de prompt (Prompt injection) et vulnérabilités des modèles de langage (Wikipédia)

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.